一. 定义

逻辑回归是一种二分类算法,分类结果为0,1,与感知器不同,它是一种软分类,表达接近某一类别的程度,而不完全是简单的“是某种分类类别或不是”。它的数学定义如下:

其中h(x)为目标函数,g(z)为sigmod函数,h(x)表示的含义可表示如下:

即给定样本接近于1的的程度

实际案例:

如下散点图,我们有一个预先标记好标签值,即分类类别的测试集,我们尝试找出一条分类边界,通过它可以判别样本点更接近于哪一类分类。

二.决策边界

h(x)=0.5,大于0.5表示分类结果越接近于1,小于0.5表示分类结果越接近于0

三. 代价函数

若仍使用线性回归中的代价函数函数,由于它是非凸的,存在多个极小值,并不适用于逻辑回归。

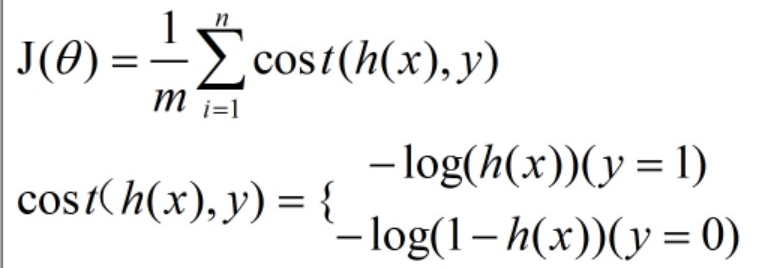

在逻辑回归中我们使用如下的代价函数:

对于cost函数,我们可以通过画出其函数图像来确定它的作用

可以看到,在y=1的情况下,h(x)越接近于1,所花费的代价越小,在h(x)=1时,代价为0;在y=0的情况下,h(x)越接近于0,所花费的代价越小,在h(x)=0时,所花费的代价为0,所以这是很好的描述误差的函数。

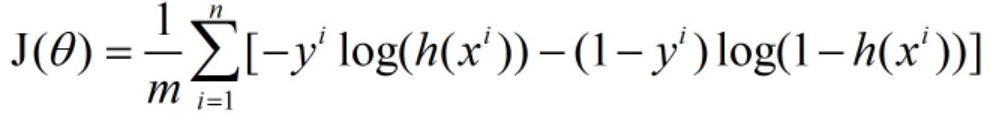

我们可以将代价函数进一步简化为如下的形式。

可以看到在y=0,y=1是函数退化到原来的cost函数。

四.梯度下降

**

梯度下降具有与线性回归相同的形式,只不过是目标函数h(x)变化了。

五. 使用正则化的逻辑回归

其代价函数变为:

梯度下降过程为

六.多元分类

当分类类别有n个的时候,可将其作为n个二分类问题,通过求其目标函数h(x),选择目标函数返回值最大的作为其分类结果。

具体示例如下所示:

对于如下的三分类问题,有三个分类类别1,2,3,我们训练三个分类器,在给定样本时,通过计算三个目标函数,h1(x),h2(x),h3(x),选较大者作为分类结果。