第一步:安装ssh并设置免密登录

第二步:配置JDK环境

第三步:设置Hadoop

我下载的Hadoop版本是2.10.1,可以从这里下载,下载好后放到Downloads文件夹。

进行解压并放入/usr/local目录下,并将文件夹hadoop-2.10.1改为hadoop:

cd /home/sunergao/Downloads tar xzf hadoop-2.10.1.tar.gz sudo mv /home/sunergao/Downloads/hadoop-2.10.1 /usr/local sudo mv hadoop-2.10.1 hadoop

修改Hadoop环境变量

sudo vim ~/.bashrc

按i进行编辑,并在文件最下方粘贴以下命令

export HADOOP_HOME=/usr/local/hadoop

按esc键,输入 :wq 以保存退出

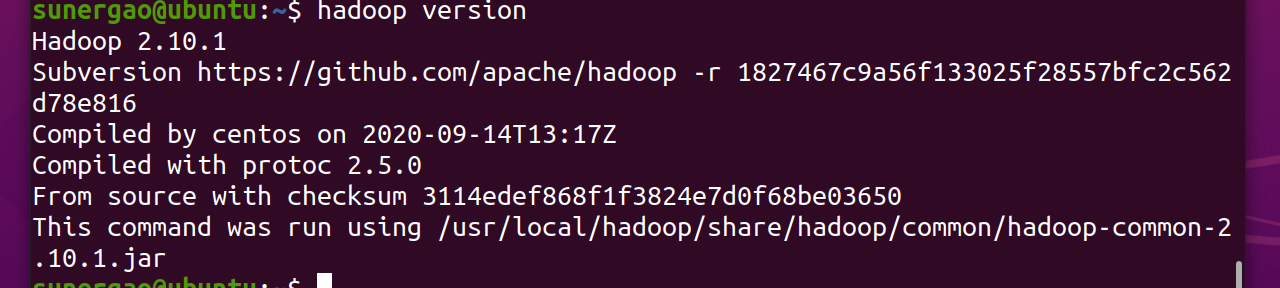

查看是否安装正常

hadoop version

出现以下信息表示正常工作

- 模拟分布式安装Hadoop

输入以下命令打开文件

sudo vim ~/.bashrc

按i进行编辑,并在文件最下方粘贴以下命令

export HADOOP_HOME=/usr/local/hadoop export HADOOP_MAPRED_HOME=$HADOOP_HOME export HADOOP_COMMON_HOME=$HADOOP_HOME export HADOOP_HDFS_HOME=$HADOOP_HOME export YARN_HOME=$HADOOP_HOME export HADOOP_COMMON_LIB_NATIVE_DIR=$HADOOP_HOME/lib/native export PATH=$PATH:$HADOOP_HOME/sbin:$HADOOP_HOME/bin export HADOOP_INSTALL=$HADOOP_HOME

提交所有更改到当前正在运行的系统

source ~/.bashrc

- Hadoop配置

1.进入hadoop文件

cd $HADOOP_HOME/etc/hadoop

重新设置hadoop-env.sh文件的java环境变量

sudo vim hadoop-env.sh

将以下命令粘贴到打开文件的最下方,保存并退出(参考前面的编辑粘贴操作)

注:jdk版本号应该改成你自己的

export JAVA_HOME=/usr/local/jdk1.8.0_144

2.打开core-site.xml

sudo vim core-site.xml

在

fs.defaultFS hdfs://localhost:9000

3.打开hdfs-site.xml

sudo vim hdfs-site.xml

在

dfs.replication 1

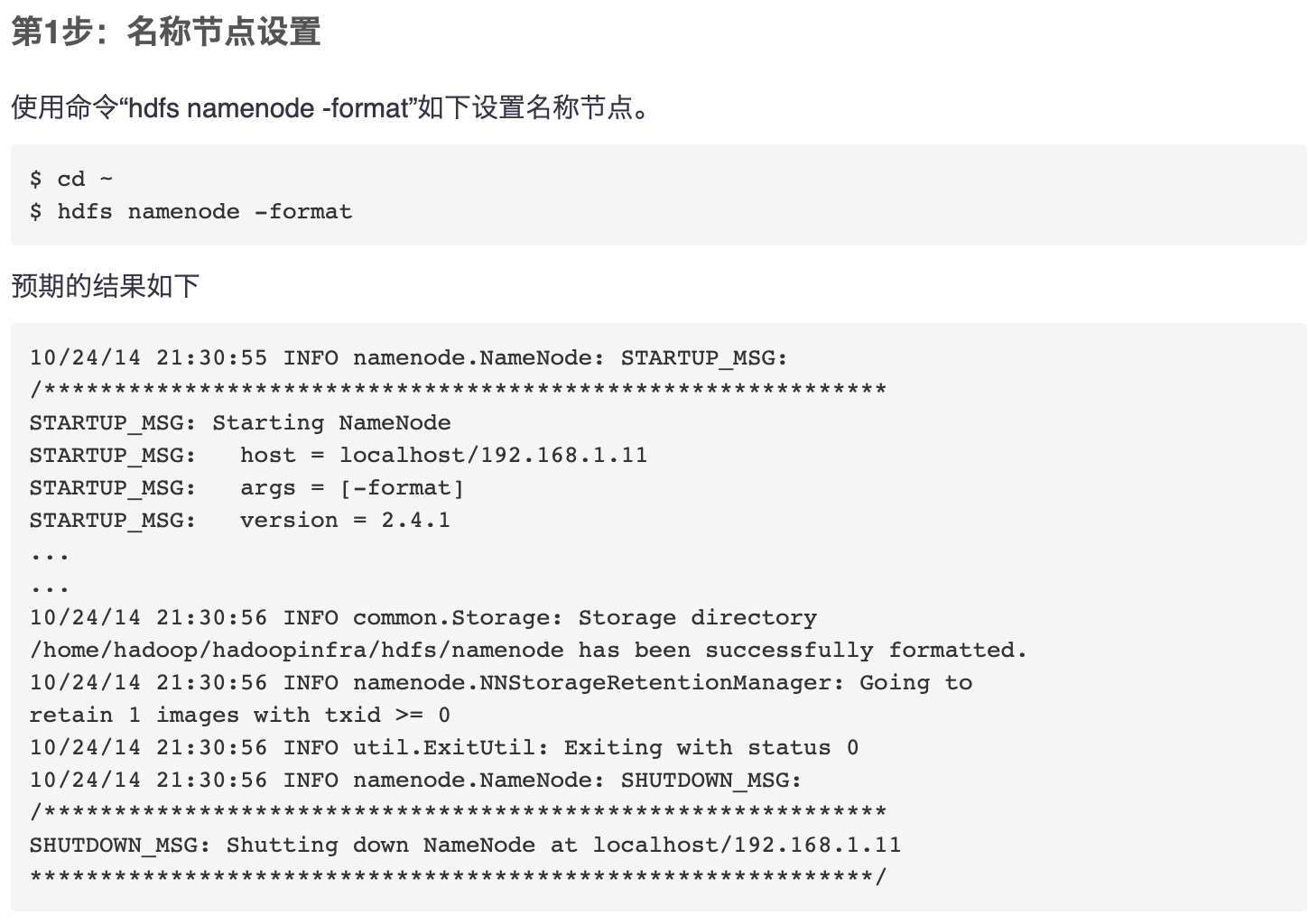

- 验证Hadoop安装

以下操作看截图(因为在这一步之前这篇教程“错误”太多,或许版本的原因,或许是电脑的原因,并且存在大量语句不通顺问题,着实令人头疼)

至此Hadoop的环境配置到此结束!

虽然内容不多,但题主却花了三四天的时间才貌似配置完毕(因为里面还有点小问题,影响不大)。总结一下,教程还是用心找找,不然“错误”太多很浪费时间,遇到问题要总结经验,并且做好笔记,以防下次碰到相同问题。好了,洗脚睡觉—2020.12.4 23:32