什么是webgl?

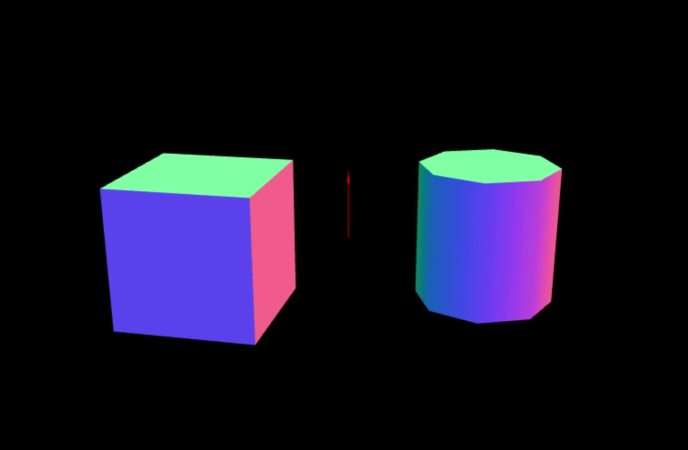

WebGL(全写Web Graphics Library)是一种3D绘图协议,这种绘图技术标准允许把JavaScript和OpenGL ES 2.0结合在一起,通过增加OpenGL ES 2.0的一个JavaScript绑定,WebGL可以为HTML5 Canvas提供硬件3D加速渲染,这样Web开发人员就可以借助系统显卡来在浏览器里更流畅地展示3D场景和模型了,还能创建复杂的导航和数据视觉化。显然,WebGL技术标准免去了开发网页专用渲染插件的麻烦,可被用于创建具有复杂3D结构的网站页面,甚至可以用来设计3D网页游戏等等。

现在,我们知道了WebGL是一个底层的标准,在这些标准被定义之后,Chrome、Firefox之类的浏览器实现了这些标准。然后,程序员就能通过JavaScript代码,在网页上实现三维图形的渲染了。如果这对你来说还是太抽象,别着急,稍后我们会用具体的例子来说明。

什么是Three.js库

Three.js是一个实现可视化的核心组件。在 Three.js 中,操纵场景图的最主要类是Object3D类。所有场景图中的节点都有名字和ID,可以通过DOM获得。使用JQuery主要为了与 DOM 元素交互和事件处理。

《基于HTML5与 WebGL的机器人3D环境下的运动学仿真》目前,比较流行的WebGL框架有Three.js、PhiloGL、Babylon.js、SceneJS等。每个框架都有自己的特点。其中,Three.js是一个轻量级的用于在浏览器中创建3D计算机图形图像应用程序的JavaScript库。本文选用Three.js来开发系统,主要是因为 Three.js是目前应用最广泛的 WebGL框架,其文档资料也是最丰富的,而且完全采用JavaScript编写而成 ,非常适用于三维网页的开发。 《基于WebGL的交互平台设计与实现》

框架层是对3D引擎的封装。主要由第三方类库:Three.js、Sim.js 和 Stats.js 组成。 a.Three.js 是对 WebGL API的封装,提供了场景、光照、纹理、材质、模型的生成、加载与转换、以及矩阵运算等强大功能。 b.Sim.js 是对 Three.js 的进一步封装,更加面向对象。提供了 Sim.Object、Sim.Publisher、Sim.App 等功能强大的类,提高了代码的重用性。 c.Stats 提供了画面质量统计监控功能。 《基于WebGL的网上虚拟太阳系漫游系统的设计与实现》

那么,Three.js究竟能用来干什么呢?

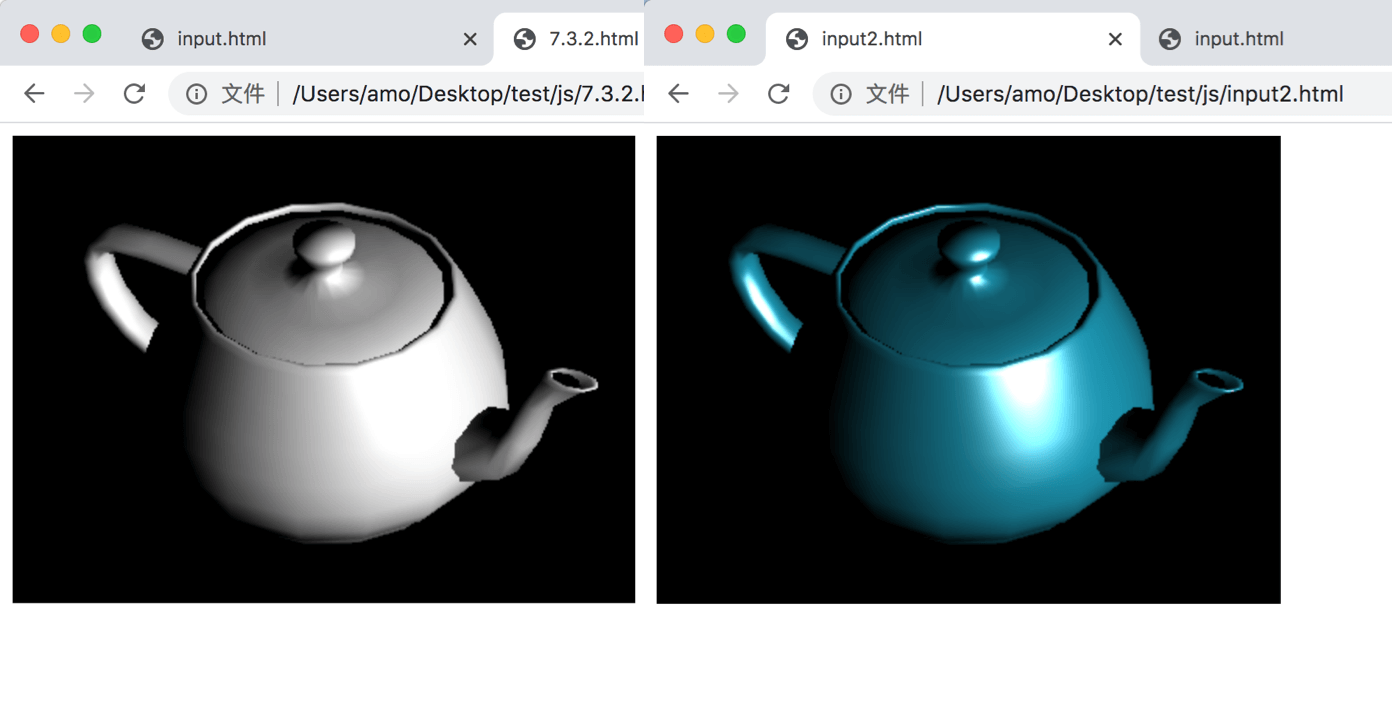

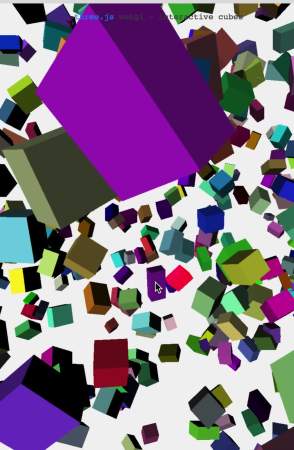

Three.js封装了底层的图形接口,使得程序员能够在无需掌握繁冗的图形学知识的情况下,也能用简单的代码实现三维场景的渲染。汽车游戏

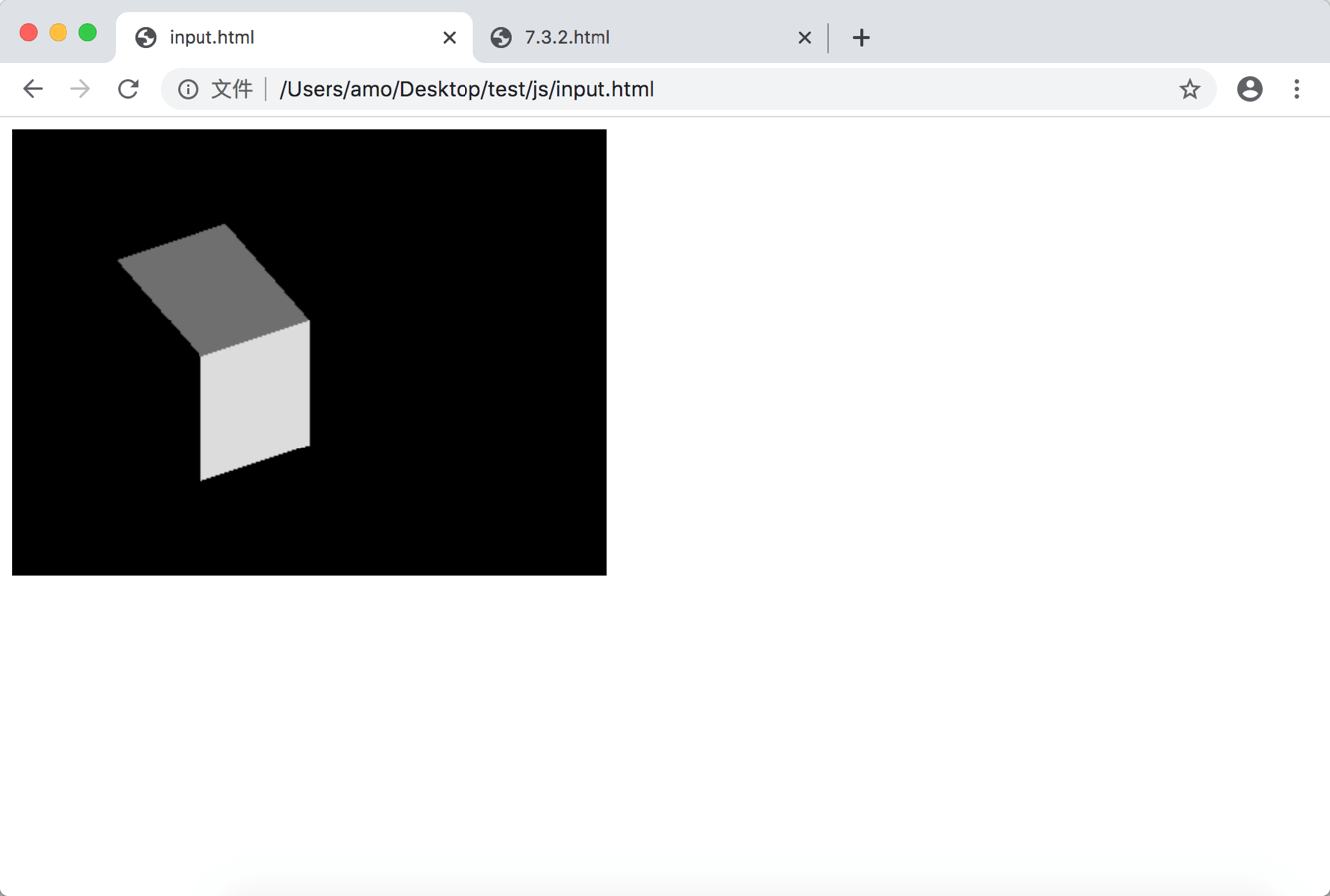

WebGL vs. Three.js

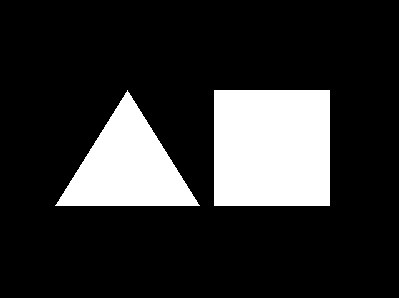

var renderer = new THREE.WebGLRenderer({canvas: document.getElementById('mainCanvas')});renderer.setClearColor(0x000000); // blackvar scene = new THREE.Scene();var camera = new THREE.PerspectiveCamera(45, 4 / 3, 1, 1000);camera.position.set(0, 0, 5);camera.lookAt(new THREE.Vector3(0, 0, 0));scene.add(camera);var material = new THREE.MeshBasicMaterial({color: 0xffffff // white});// planevar planeGeo = new THREE.PlaneGeometry(1.5, 1.5);var plane = new THREE.Mesh(planeGeo, material);plane.position.x = 1;scene.add(plane);// trianglevar triGeo = new THREE.Geometry();triGeo.vertices = [new THREE.Vector3(0, -0.8, 0),new THREE.Vector3(-2, -0.8, 0), new THREE.Vector3(-1, 0.8, 0)];triGeo.faces.push(new THREE.Face3(0, 2, 1));var triangle = new THREE.Mesh(triGeo, material);scene.add(triangle);renderer.render(scene, camera);

var gl;function initGL(canvas) {try {gl = canvas.getContext("experimental-webgl");gl.viewportWidth = canvas.width;gl.viewportHeight = canvas.height;} catch (e) {}if (!gl) {alert("Could not initialise WebGL, sorry :-(");}}function getShader(gl, id) {var shaderScript = document.getElementById(id);if (!shaderScript) {return null;}var str = "";var k = shaderScript.firstChild;while (k) {if (k.nodeType == 3) {str += k.textContent;}k = k.nextSibling;}var shader;if (shaderScript.type == "x-shader/x-fragment") {shader = gl.createShader(gl.FRAGMENT_SHADER);} else if (shaderScript.type == "x-shader/x-vertex") {shader = gl.createShader(gl.VERTEX_SHADER);} else {return null;}gl.shaderSource(shader, str);gl.compileShader(shader);if (!gl.getShaderParameter(shader, gl.COMPILE_STATUS)) {alert(gl.getShaderInfoLog(shader));return null;}return shader;}var shaderProgram;function initShaders() {var fragmentShader = getShader(gl, "shader-fs");var vertexShader = getShader(gl, "shader-vs");shaderProgram = gl.createProgram();gl.attachShader(shaderProgram, vertexShader);gl.attachShader(shaderProgram, fragmentShader);gl.linkProgram(shaderProgram);if (!gl.getProgramParameter(shaderProgram, gl.LINK_STATUS)) {alert("Could not initialise shaders");}gl.useProgram(shaderProgram);shaderProgram.vertexPositionAttribute = gl.getAttribLocation(shaderProgram, "aVertexPosition");gl.enableVertexAttribArray(shaderProgram.vertexPositionAttribute);shaderProgram.pMatrixUniform = gl.getUniformLocation(shaderProgram, "uPMatrix");shaderProgram.mvMatrixUniform = gl.getUniformLocation(shaderProgram, "uMVMatrix");}var mvMatrix = mat4.create();var pMatrix = mat4.create();function setMatrixUniforms() {gl.uniformMatrix4fv(shaderProgram.pMatrixUniform, false, pMatrix);gl.uniformMatrix4fv(shaderProgram.mvMatrixUniform, false, mvMatrix);}var triangleVertexPositionBuffer;var squareVertexPositionBuffer;function initBuffers() {triangleVertexPositionBuffer = gl.createBuffer();gl.bindBuffer(gl.ARRAY_BUFFER, triangleVertexPositionBuffer);var vertices = [0.0, 1.0, 0.0,-1.0, -1.0, 0.0,1.0, -1.0, 0.0];gl.bufferData(gl.ARRAY_BUFFER, new Float32Array(vertices), gl.STATIC_DRAW);triangleVertexPositionBuffer.itemSize = 3;triangleVertexPositionBuffer.numItems = 3;squareVertexPositionBuffer = gl.createBuffer();gl.bindBuffer(gl.ARRAY_BUFFER, squareVertexPositionBuffer);vertices = [1.0, 1.0, 0.0,-1.0, 1.0, 0.0,1.0, -1.0, 0.0,-1.0, -1.0, 0.0];gl.bufferData(gl.ARRAY_BUFFER, new Float32Array(vertices), gl.STATIC_DRAW);squareVertexPositionBuffer.itemSize = 3;squareVertexPositionBuffer.numItems = 4;}function drawScene() {gl.viewport(0, 0, gl.viewportWidth, gl.viewportHeight);gl.clear(gl.COLOR_BUFFER_BIT | gl.DEPTH_BUFFER_BIT);mat4.perspective(45, gl.viewportWidth / gl.viewportHeight, 0.1, 100.0, pMatrix);mat4.identity(mvMatrix);mat4.translate(mvMatrix, [-1.5, 0.0, -7.0]);gl.bindBuffer(gl.ARRAY_BUFFER, triangleVertexPositionBuffer);gl.vertexAttribPointer(shaderProgram.vertexPositionAttribute, triangleVertexPositionBuffer.itemSize, gl.FLOAT, false, 0, 0);setMatrixUniforms();gl.drawArrays(gl.TRIANGLES, 0, triangleVertexPositionBuffer.numItems);mat4.translate(mvMatrix, [3.0, 0.0, 0.0]);gl.bindBuffer(gl.ARRAY_BUFFER, squareVertexPositionBuffer);gl.vertexAttribPointer(shaderProgram.vertexPositionAttribute, squareVertexPositionBuffer.itemSize, gl.FLOAT, false, 0, 0);setMatrixUniforms();gl.drawArrays(gl.TRIANGLE_STRIP, 0, squareVertexPositionBuffer.numItems);}function webGLStart() {var canvas = document.getElementById("lesson01-canvas");initGL(canvas);initShaders();initBuffers();gl.clearColor(0.0, 0.0, 0.0, 1.0);gl.enable(gl.DEPTH_TEST);drawScene();}

从上面的代码我们不难发现,使用原生WebGL接口实现同样功能需要5倍多的代码量,而且很多代码对于没有图形学基础的程序员是很难看懂的。由这个例子我们可以看出,使用Three.js开发要比WebGL更快更高效。尤其对图形学知识不熟悉的程序员而言,使用Three.js能够降低学习成本,提高三维图形程序开发的效率。

开始使用Three.js

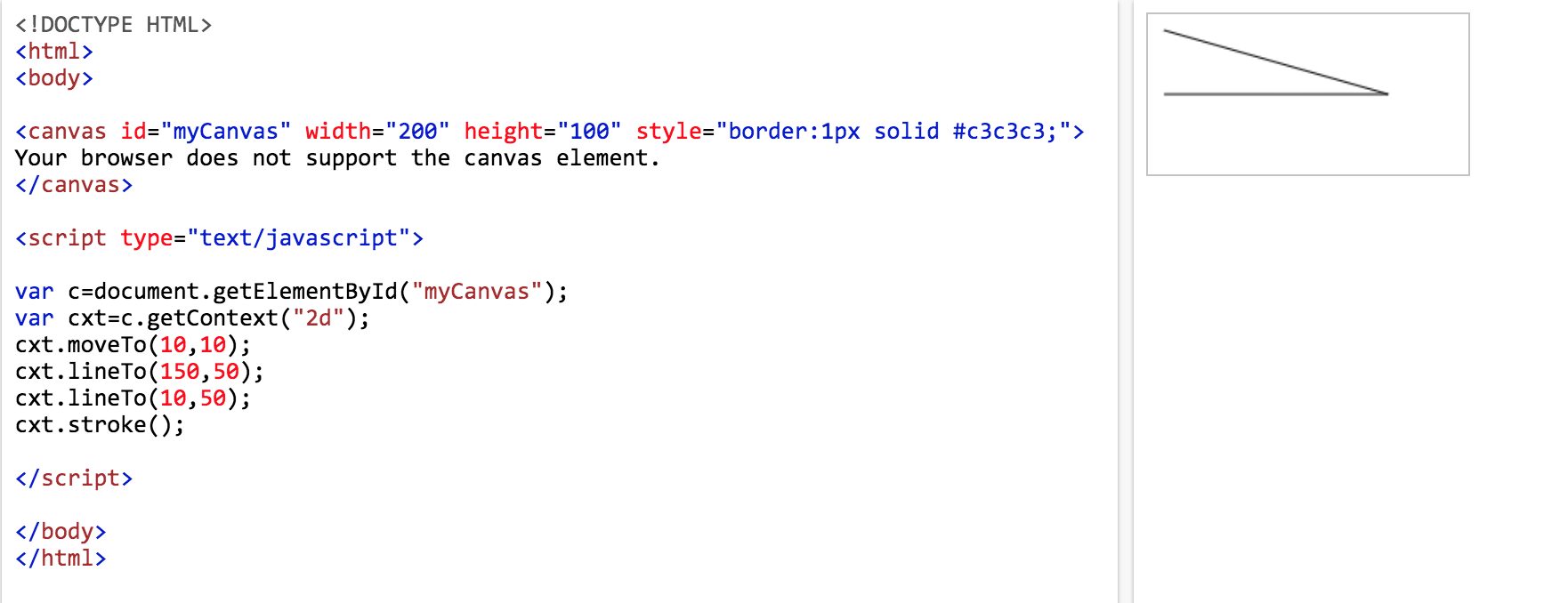

HTML5canvas标签

HTML5 的 canvas 元素使用 JavaScript 在网页上绘制图像。画布是一个矩形区域,您可以控制其每一像素。canvas 拥有多种绘制路径、矩形、圆形、字符以及添加图像的方法。 —w3c

创建canvas元素、通过javascript绘制、线条绘制、圆形绘制、渐变背景、将图形放到画布。

Three.js 库(下载)

Three.js 三大组件介绍

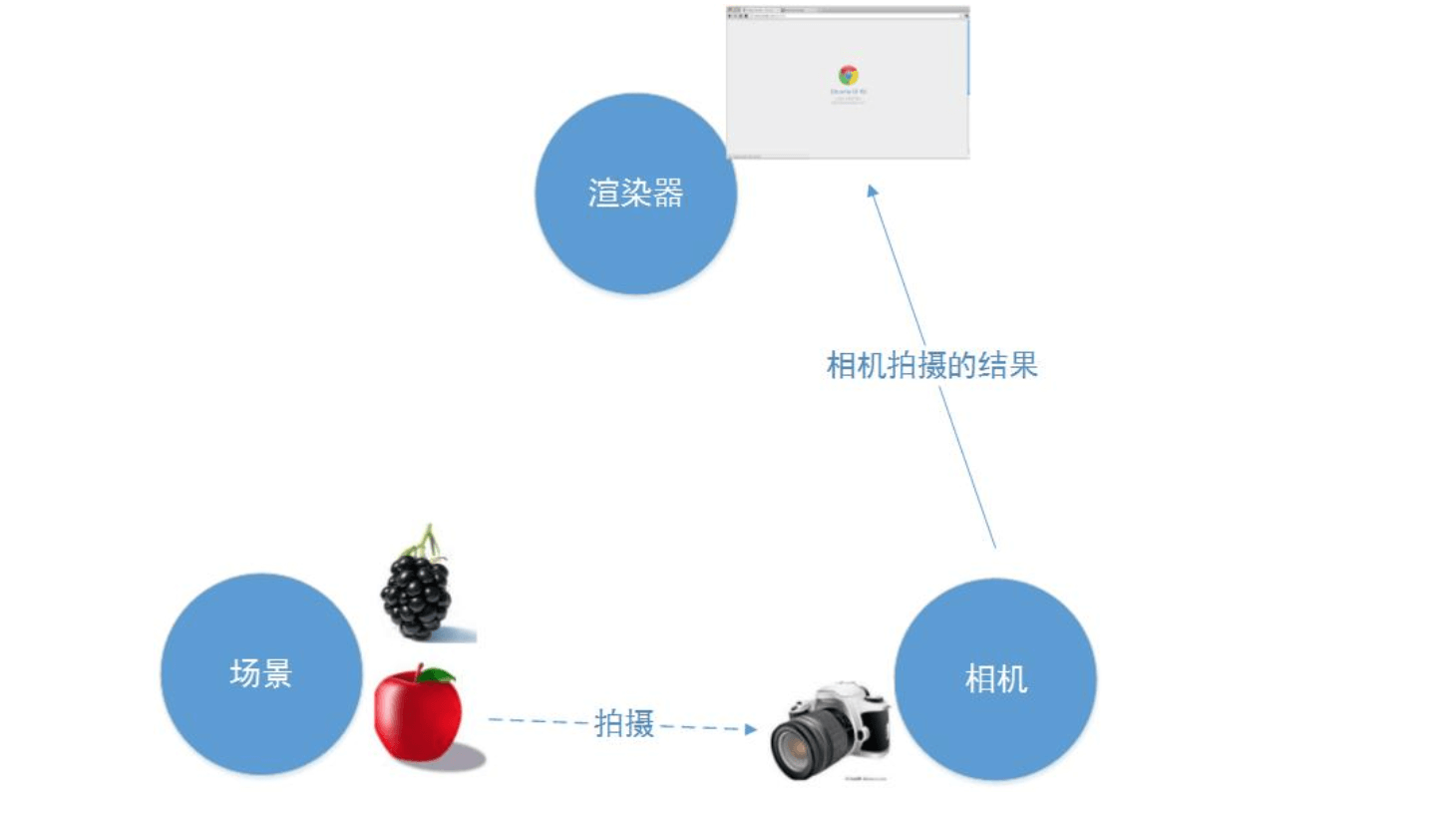

Three.js中的场景是一个物体的容器,开发者可以将需要的角色放入场景中。

同时,角色自身也管理着其在场景中的位置。相机的作用就是面对场景,在场景中取一个合适的景,把它拍下来。渲染器的作用就是将相机拍摄下来的图片,放到浏览器中去显示。

<!DOCTYPE html><html><head><title></title><style>canvas { width: 100%; height: 100% }</style><script src="js/three.js"></script></head><body><script>var scene = new THREE.Scene();var camera = new THREE.PerspectiveCamera(75, window.innerWidth/window.innerHeight, 0.1, 1000);var renderer = new THREE.WebGLRenderer();renderer.setSize(window.innerWidth, window.innerHeight);document.body.appendChild(renderer.domElement);var geometry = new THREE.CubeGeometry(1,1,1);var material = new THREE.MeshBasicMaterial({color: 0x00ff00});var cube = new THREE.Mesh(geometry, material); scene.add(cube);camera.position.z = 5;function render() {requestAnimationFrame(render);cube.rotation.x += 0.1;cube.rotation.y += 0.1;renderer.render(scene, camera);}render();</script></body></html>

相机

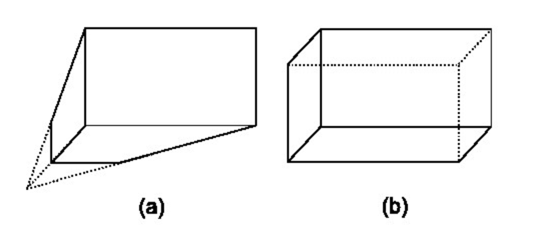

正交投影vs透视投影

举个简单的例子来说明正交投影与透视投影照相机的区别。使用透视投影照相机获得的结果是类似人眼在真实世界中看到的有“近大远小”的效果(如下图中的(a));而使用正交投影照相机获得的结果就像我们在数学几何学课上老师教我们画的效果,对于在三维空间内平行的线,投影到二维空间中也一定是平行的(如下图中的(b))。

那么,你的程序需要正交投影还是透视投影的照相机呢?

一般说来,对于制图、建模软件通常使用正交投影,这样不会因为投影而改变物体比例;而对于其他大多数应用,通常使用透视投影,因为这更接近人眼的观察效果。当然,照相机的选择并没有对错之分,你可以更具应用的特性,选择一个效果更佳的照相机。

Three.js基本元素

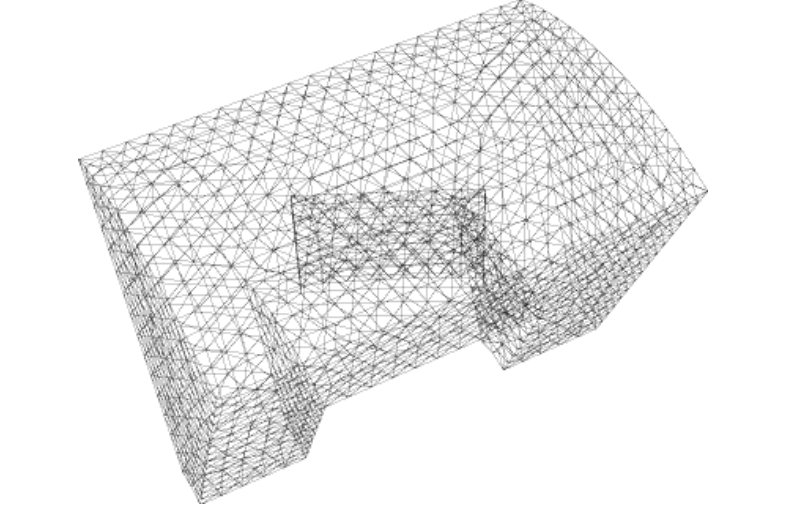

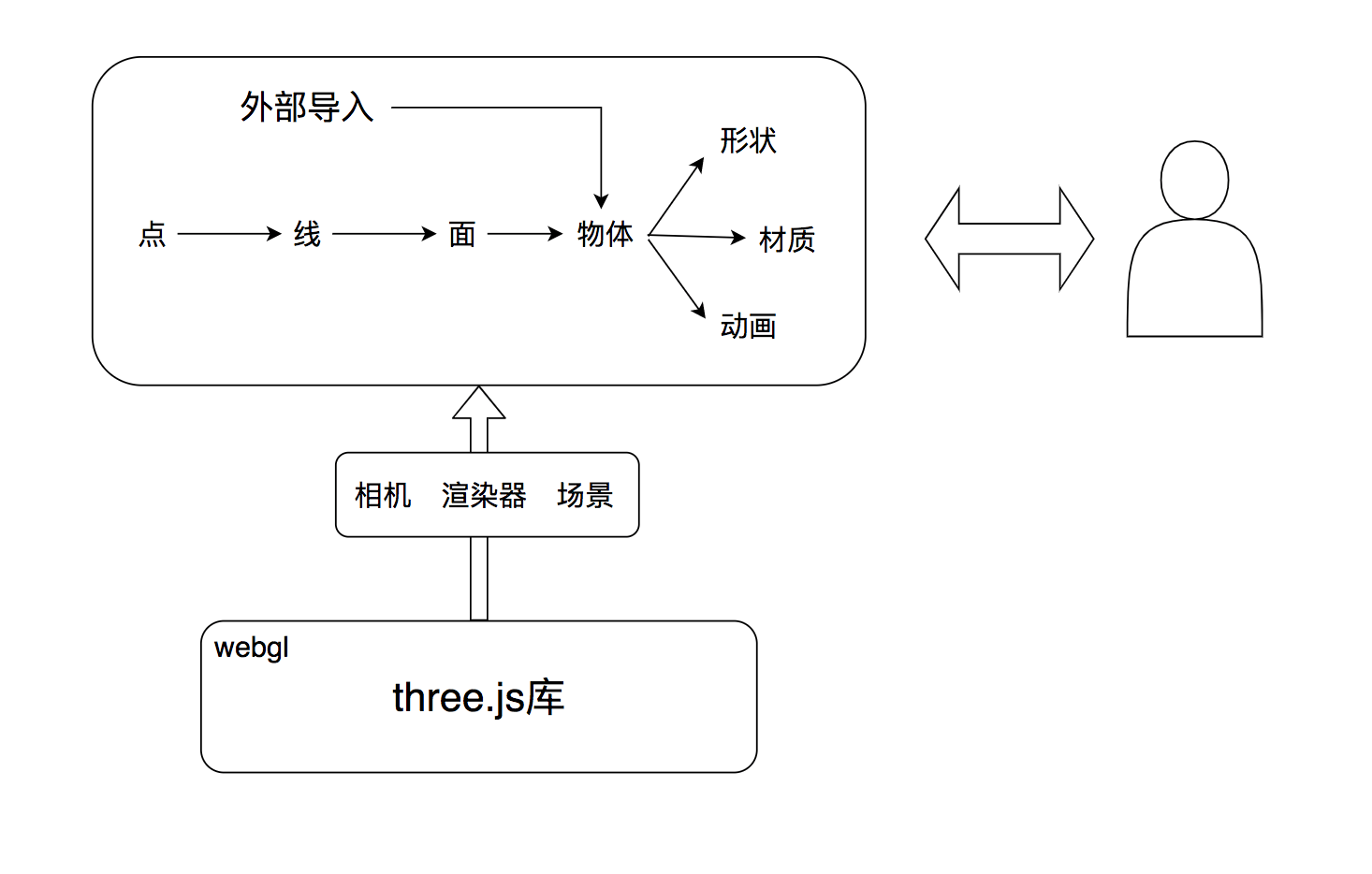

在计算机世界里,3D世界是由点组成,两个点能够组成一条直线,三个不在一条直线上的点就能够组成一个三角形面,无数三角形面就能够组成各种形状的物体,如下图:

我们通常把这种网格模型叫做Mesh模型。给物体贴上皮肤,或者专业点就叫做纹理,那么这个物体就活灵活现了。最后无数的物体就组成了我们的3D世界。

定义一个点

var point1 = new THREE.Vecotr3(4,8,9);

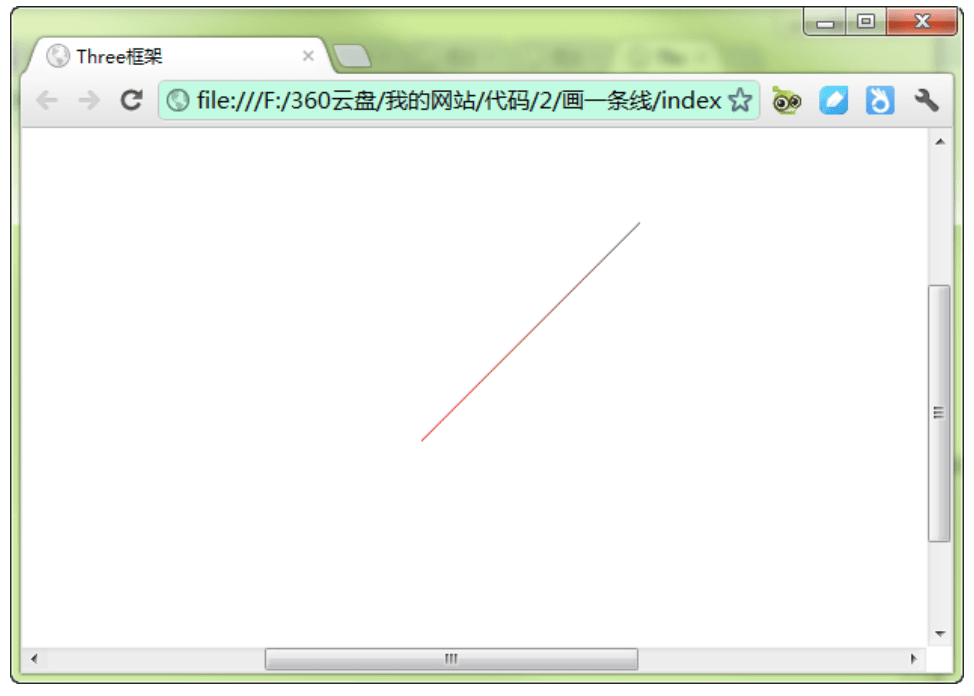

定义一条线

var p1 = new THREE.Vector3( -100, 0, 100 );var p2 = new THREE.Vector3( 100, 0, -100 );geometry.vertices.push(p1);geometry.vertices.push(p2);geometry.colors.push( color1, color2 );var line = new THREE.Line( geometry, material, THREE.LinePieces );scene.add(line);

- 定义点P1、P2

- 加入几何体

- 上色

- 创建线条

- 加入场景

定义面

for ( var i = 0; i <= 20; i ++ ) {var line = new THREE.Line( geometry, new THREE.LineBasicMaterial( { color: 0x000000, opacity: 0.2 } ) );line.position.z = ( i * 50 ) - 500;scene.add( line );var line = new THREE.Line( geometry, new THREE.LineBasicMaterial( { color: 0x000000, opacity: 0.2 } ) );line.position.x = ( i * 50 ) - 500;line.rotation.y = 90 * Math.PI / 180;scene.add( line );}

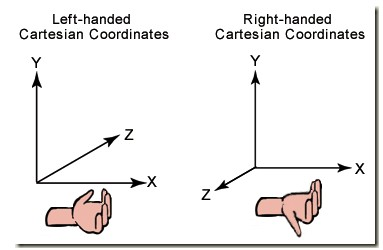

坐标系

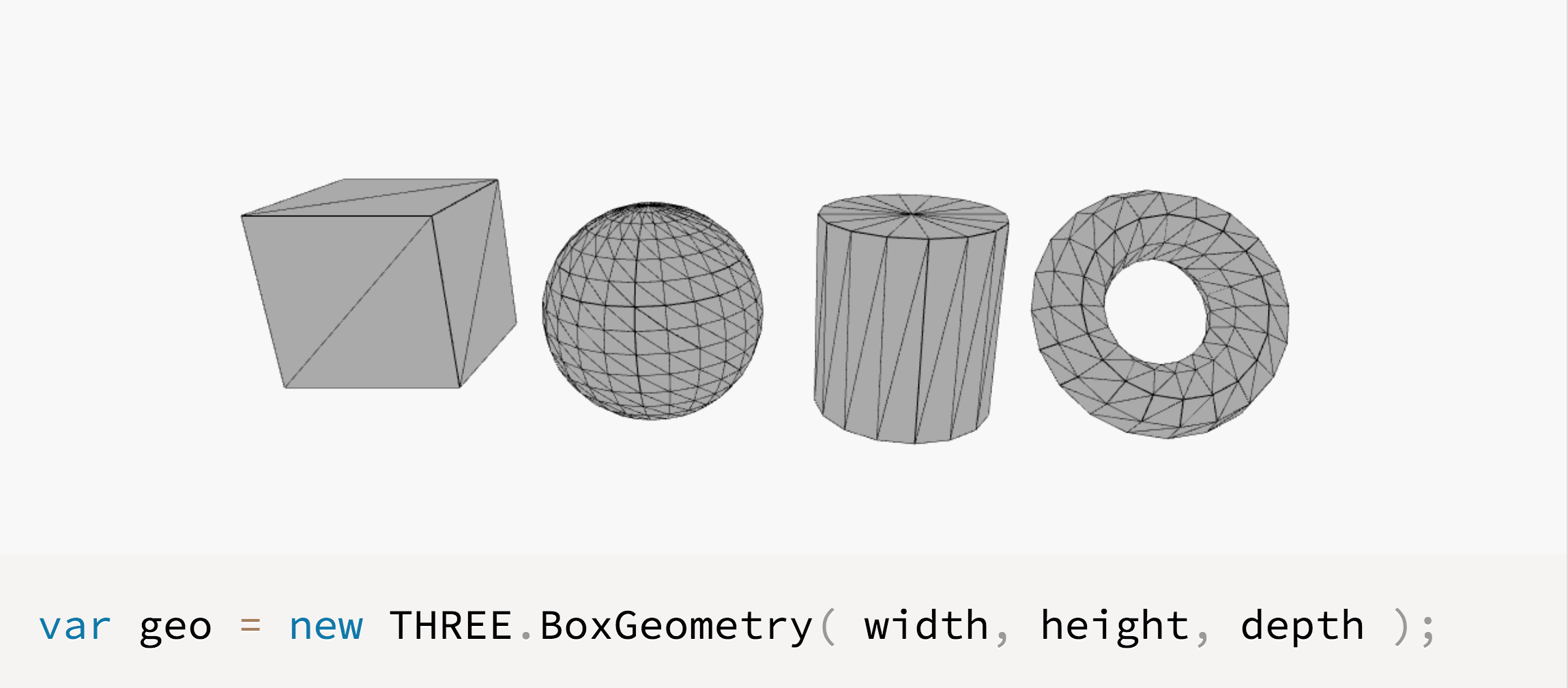

定义几何形状

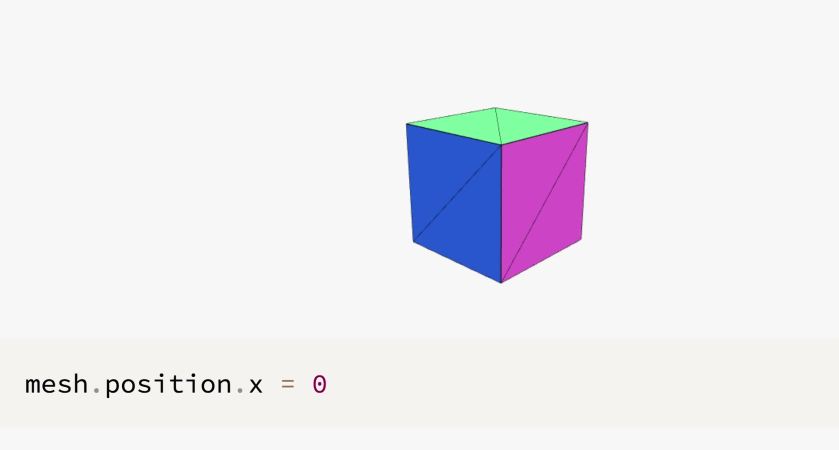

这里,width是x方向上的长度;height是y方向上的长度;depth是z方向上的长度;

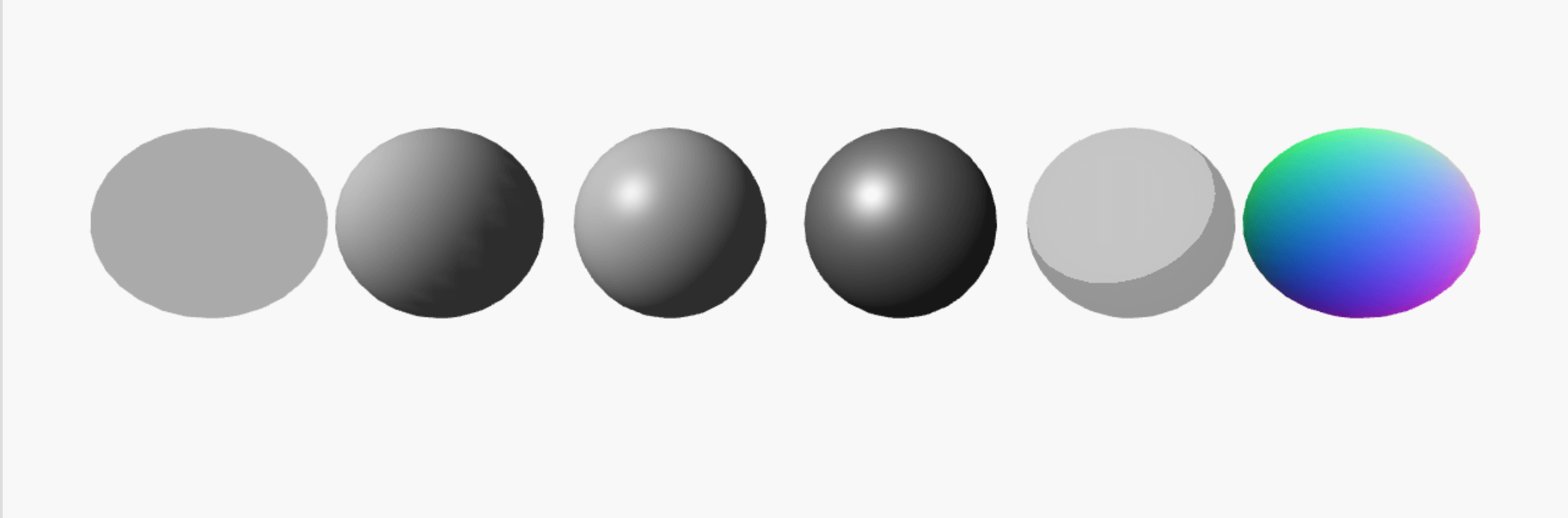

材质

new THREE.MeshBasicMaterial({color: 0xffff00,opacity: 0.75});

动画

function draw() {mesh.rotation.y = (mesh.rotation.y + 0.01) % (Math.PI * 2);renderer.render(scene, camera);}id = setInterval(draw, 20);

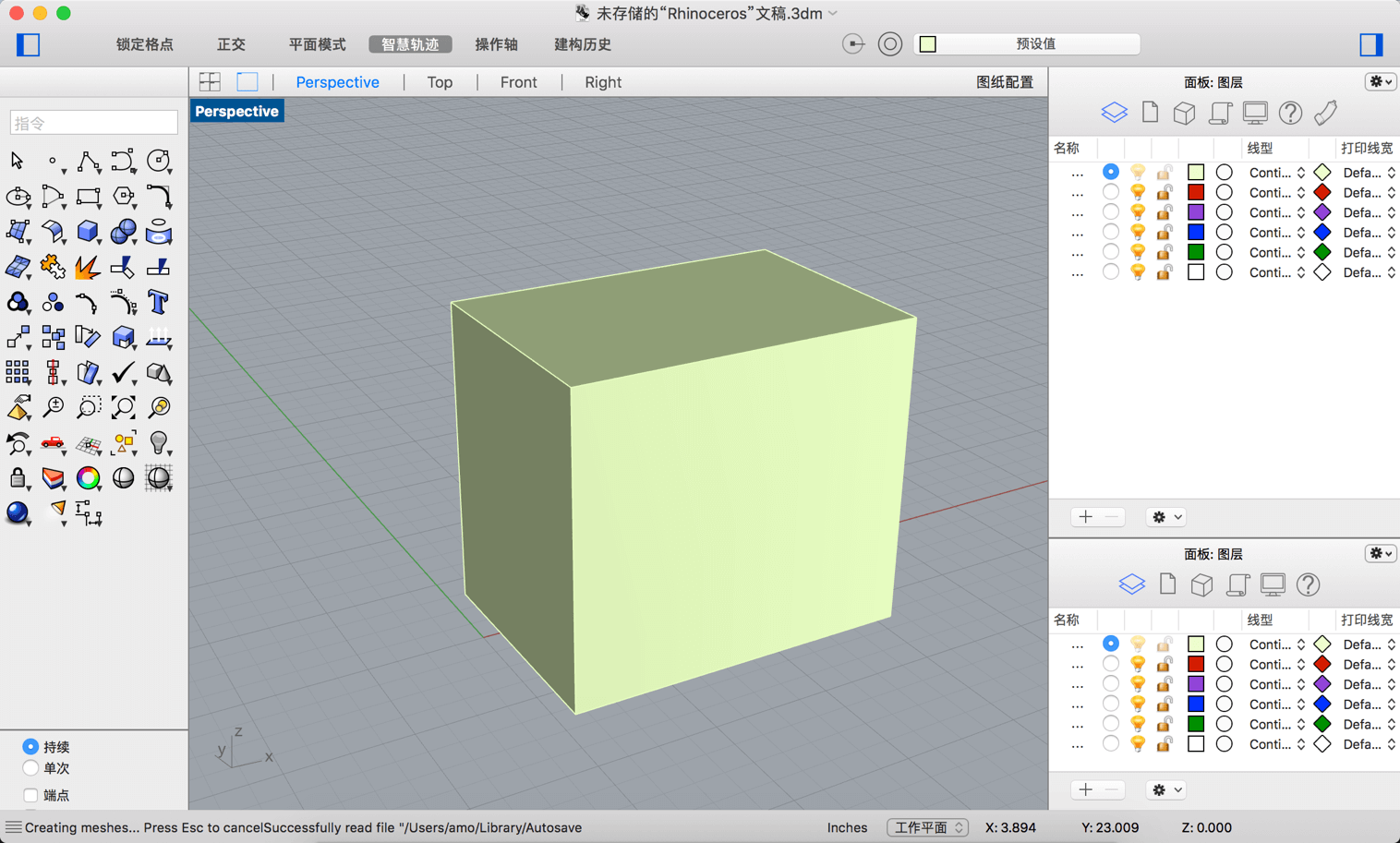

外部导入

使用Three.js创建常见几何体是十分方便的,但是对于人或者动物这样非常复杂的模型使用几何体组合就非常麻烦了。因此,Three.js允许用户导入由3ds Max等工具制作的三维模型,并添加到场景中。

var loader = new THREE.OBJLoader();loader.load('../lib/port.obj', function(obj) {mesh = obj; //储存到全局变量中scene.add(obj);});

材质导入

var loader = new THREE.OBJMTLLoader();loader.addEventListener('load', function(event) {var obj = event.content;mesh = obj;scene.add(obj);});loader.load('../lib/port.obj', '../lib/port.mtl');

组合

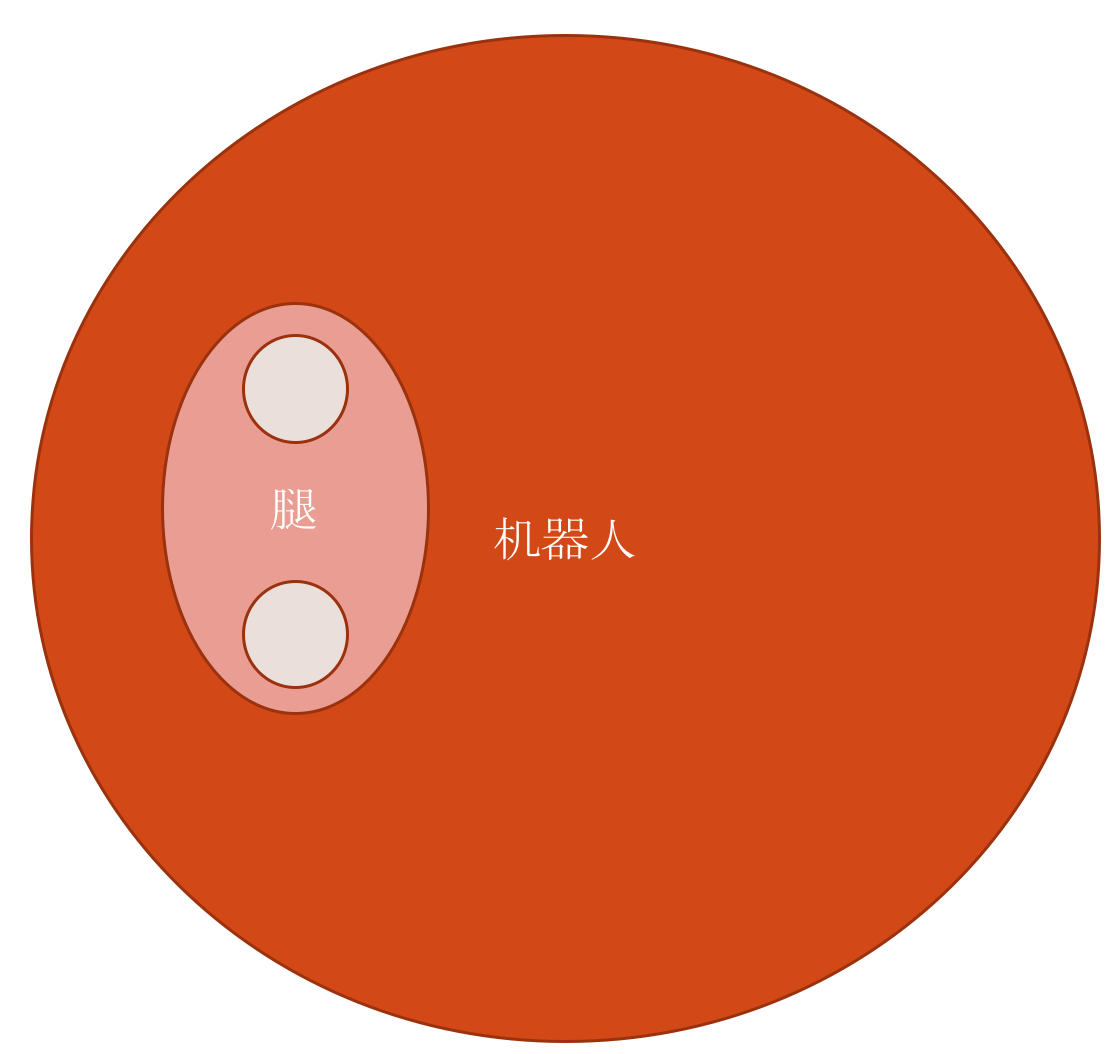

这里以一个机器人三维模型来说下层级模型的概念,比如一整个机器人通过一个组对象Group表示,然后一条腿用一个组对象Group表示,一条腿假设包含大腿和小腿两个网格模型Mesh,大腿和小腿两个网格模型可以作为父对象腿Group的两个字对象,Group表示的两条腿又可以作为机器人Group的两个子对象,这样的话就构成了机器人——腿——大腿、小腿三个层级。

就像一颗树一样可以一直分叉,如果根对象机器人的位置变化,那么腿也会跟着变化。对于Threejs中一样,如果Mesh是Group的子对象,如果Group平移变化,Mesh的位置同样跟着父对象Group平移变化。演示

var cubeA = new THREE.Mesh( geometry, material );cubeA.position.set( 100, 100, 0 );var cubeB = new THREE.Mesh( geometry, material );cubeB.position.set( -100, -100, 0 );var group = new THREE.Group();group.add( cubeA );group.add( cubeB );scene.add( group );

交互

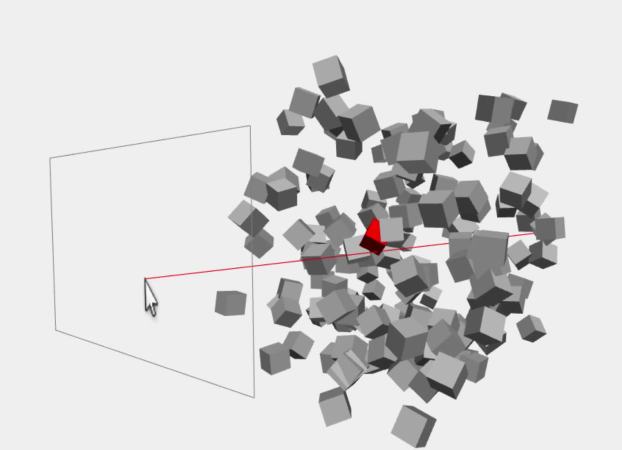

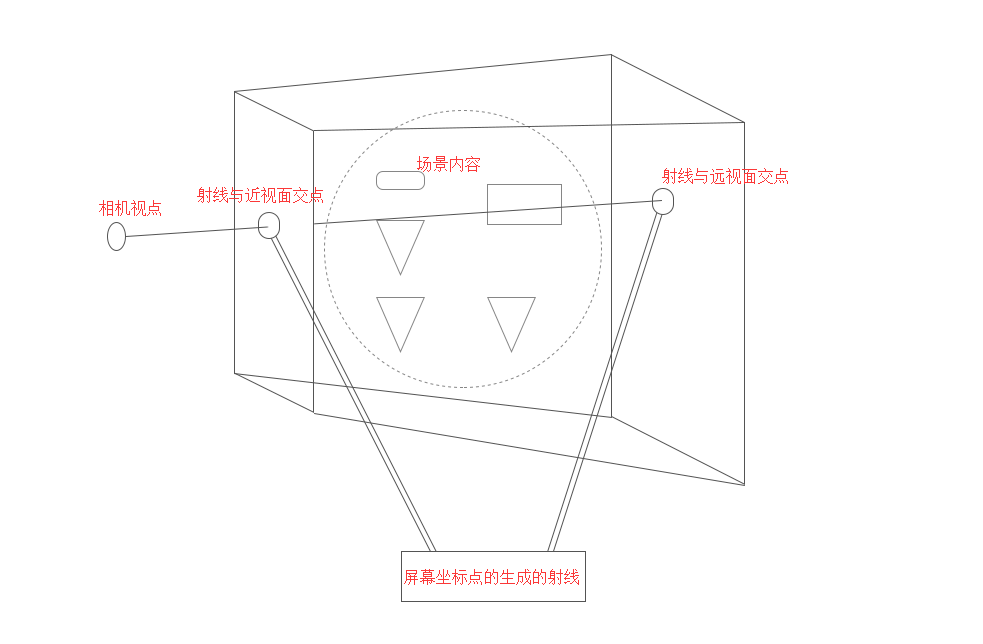

Raycaster

Raycaster

**我们一般都会设置三维场景的显示区域,如果,指明当前显示的2d坐标给THREE.Raycaster的话,它将生成一条从显示的起点到终点的一条射线。也就是说,我们再屏幕上点击了一个点,在three.js里面获取的则是一条直线。参考

//声明射线和mouse变量var raycaster = new THREE.Raycaster();var mouse = new THREE.Vector2();//通过鼠标点击的位置计算出射线所需要的点的位置,以屏幕中心为原点,值的范围为-1到1.mouse.x = (event.clientX / window.innerWidth) * 2 - 1;mouse.y = -(event.clientY / window.innerHeight) * 2 + 1;//根据在屏幕的二维位置以及相机的矩阵更新射线的位置raycaster.setFromCamera(mouse, camera);// 获取射线直线和所有模型相交的数组集合var intersects = raycaster.intersectObjects(scene.children, true); //增加第二个参数

总结

参考网站:

https://github.com/mrdoob/three.js

https://www.ituring.com.cn/book/miniarticle/58552

https://davidscottlyons.com/projects/threejs-intro/

http://www.hewebgl.com/

https://blog.csdn.net/qq_30100043/article/details/81483918