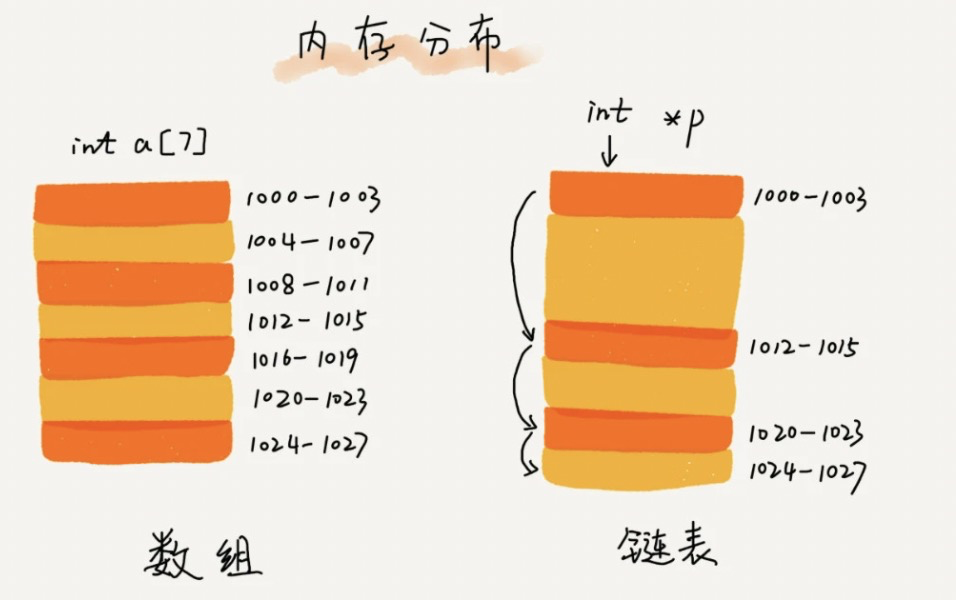

内存分布

与数组对比

- 数组需要一块连续的内存空间来存储,对内存的要求比较高

- 如果我们申请一个 100MB 大小的数组,当内存中没有连续的、足够大的存储空间时,即便内存的剩余总可用空间大于 100MB,仍然会申请失败

链表并不需要一块连续的内存空间,它通过“指针”将一组零散的内存块串联起来使用

单链表

功能

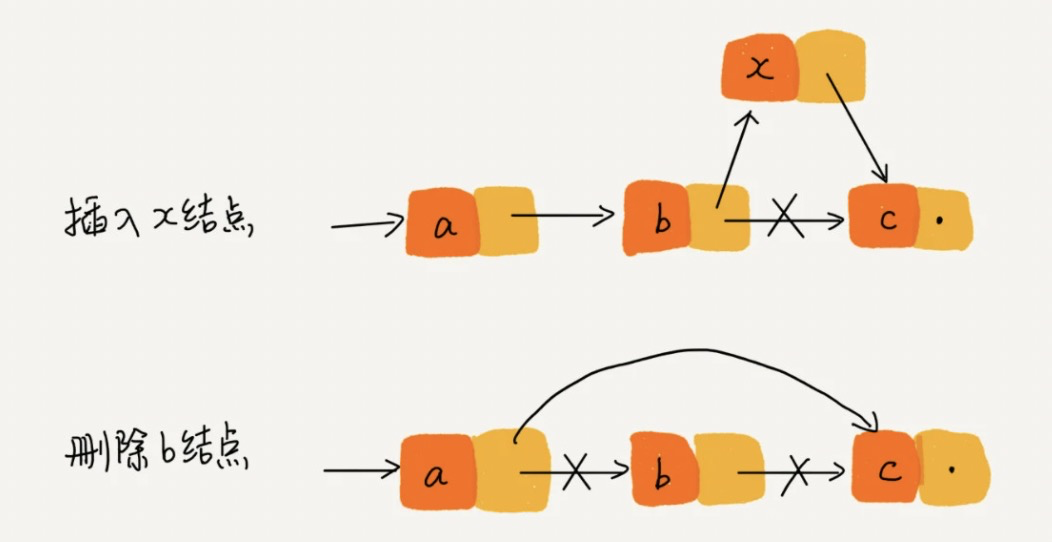

单链表中的每一个节点都必须具备两个功能:

- 一个功能是存储数据,

- 另外一个功能是记录下一个节点的地址。

如图所示,我们把这个记录下个结点地址的指针叫作后继指针 next。

头结点 | 尾节点 | 空地址 null

- 我们习惯性地把第一个结点叫作头结点

- 头结点用来记录链表的基地址

把最后一个结点叫作尾结点

进行数组的插入、删除操作时,为了保持内存数据的连续性,需要做大量的数据搬移,所以时间复杂度是 O(n)。

在链表中插入或者删除一个数据,我们并不需要为了保持内存的连续性而搬移结点,因为链表的存储空间本身就不是连续的。所以,在链表中插入和删除一个数据是非常快速的, 时间复杂度为O(1)

弊端

链表随机访问,需要 O(n) 的时间复杂度

循环链表的尾结点指针是指向链表的头结点

优点

从链尾到链头比较方便。当要处理的数据具有环型结构特点时,就特别适合采用循环链表。比如著名的约瑟夫问题(丢手绢)

双向链表

每个结点不止有一个后继指针 next 指向后面的结点,还有一个前驱指针 prev 指向前面的结点

优点

- 但可以支持双向遍历,这样也带来了双向链表操作的灵活性

从结构上来看,双向链表可以支持 O(1) 时间复杂度的情况下找到前驱结点

双向链表需要额外的两个空间来存储后继结点和前驱结点的地址。所以,如果存储同样多的数据,双向链表要比单链表占用更多的内存空间。虽然两个指针比较浪费存储空间

链表 VS 数组性能大比拼

LRU最近最少使用策略

链表实现

如何基于链表实现 LRU 缓存淘汰算法?

思路: 我们维护一个有序单链表,越靠近链表尾部的结点是越早之前访问的。当有一个新的数据被访问时,我们从链表头开始顺序遍历链表。

实现:

- 如果此数据之前已经被缓存在链表中了,我们遍历得到这个数据对应的结点,并将其从原来的位置删除,然后再插入到链表的头部

- 如果此数据没有在缓存链表中,又可以分为两种情况:

- 如果此时缓存未满,则将此结点直接插入到链表的头部;

- 如果此时缓存已满,则链表尾结点删除,将新的数据结点插入链表的头部