1 下载

2. 安装

2.1 解压

tar -zvxf hbase-2.2.4-bin.tar.gz

2.2 修改环境变量

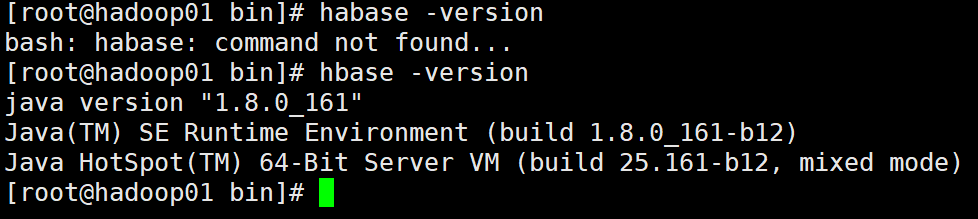

#hbaseexport HBASE_HOME=/usr/local/hbase/hbase-2.2.4export PATH=$PATH:$HBASE_HOME/binsource /etc/profilehbase version

2.3 修改hbase-env.sh

注意 :不要直接粘贴 ,而是改动里面的参数

#jdk路径

export JAVA_HOME=/hadoop/jdk1.8.0_161

#Hbase的配置目录

export HBASE_CLASSPATH=/usr/local/hbase/hbase-2.2.4/conf

#是否用自带的zookeeper

export HBASE_MANAGES_ZK=true

2.4 修改hbase-site.xml

注意:将Hadoop配置文件软连接到HBase的conf目录下

* core-site.xml

$ ln -s /opt/module/hadoop-2.5.0-cdh5.3.6/etc/hadoop/core-site.xml /opt/module/hbase-0.98.6-cdh5.3.6/conf/core-site.xml

* hdfs-site.xml

$ ln -s /opt/module/hadoop-2.5.0-cdh5.3.6/etc/hadoop/hdfs-site.xml /opt/module/hbase-0.98.6-cdh5.3.6/conf/hdfs-site.xml

(尖叫提示:不要忘记其他几台机器也要做此操作)

<!--hbase共享目录,持久化hbase数据-->

<!--配置为core-site.xml 中的fs.defaultFS + /hbase -->

<property>

<name>hbase.rootdir</name>

<value>hdfs://hadoop01:9000/hbase</value>

</property>

<!--分布式运行模式,false(默认)为单机模式-->

<property>

<name>hbase.cluster.distributed</name>

<value>true</value>

</property>

<!--Zookeeper集群的地址列表,伪分布式用默认localhost-->

<property>

<name>hbase.zookeeper.quorum</name>

<value>localhost</value>

</property>

2.5 分布式操作

scp -r /apps/hbase/ hdp02:/apps/

scp -r /apps/hbase/ hdp03:/apps/

将配置好的HBase拷贝到每一个节点并同步时间

配置conf/regionservers

1. slave01

2. slave02

3. slave03

2.6 启动并运行Hbase

./start-hbase.sh

启动所有的hbase 分别启动zk ./zkServer.sh start 启动hbase集群 start-dfs.sh 启动hbase,在主节点上运行: start-hbase.sh 6.通过浏览器访问hbase管理页面 hdp01:60010 7.为保证集群的可靠性,要启动多个HMaster hbase-daemon.sh start master