5.1 神经元模型

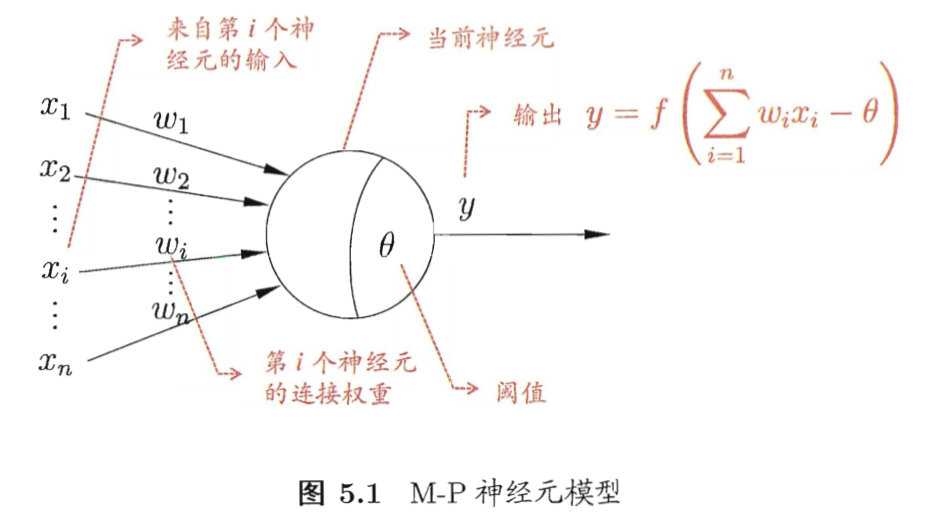

机器学习中谈论神经网络指“神经网络学习”。神经网络基本成分是神经元模型。

- 理想激活函数是阶跃函数,0 表示抑制神经元而 1 表示激活神经元

- 阶跃函数具有不连续、不光滑等不好的性质,常用的是Sigmoid函数,可微连续

- 把许多个这样的神经元按一定的层次结构连接起来,就得到了神经网络.

5.2 感知机与多层网络

感知机

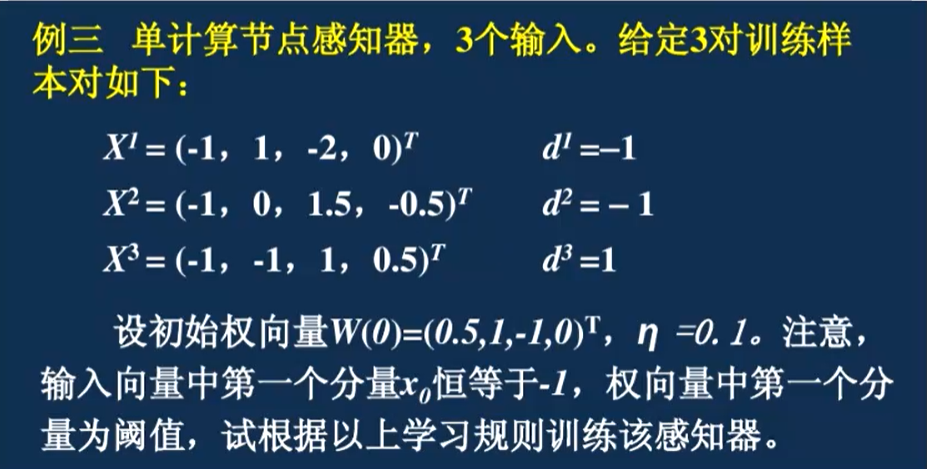

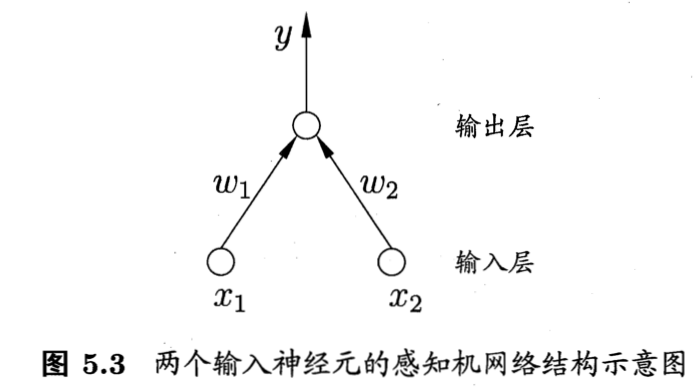

感知机( Perceptron)由两层神经元组成,如图5.3所示,输入层接收外界输入信号后传递给输出层,输出层是M-P神经元,亦称“阈值逻辑单元”( threshold logic unit)

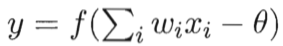

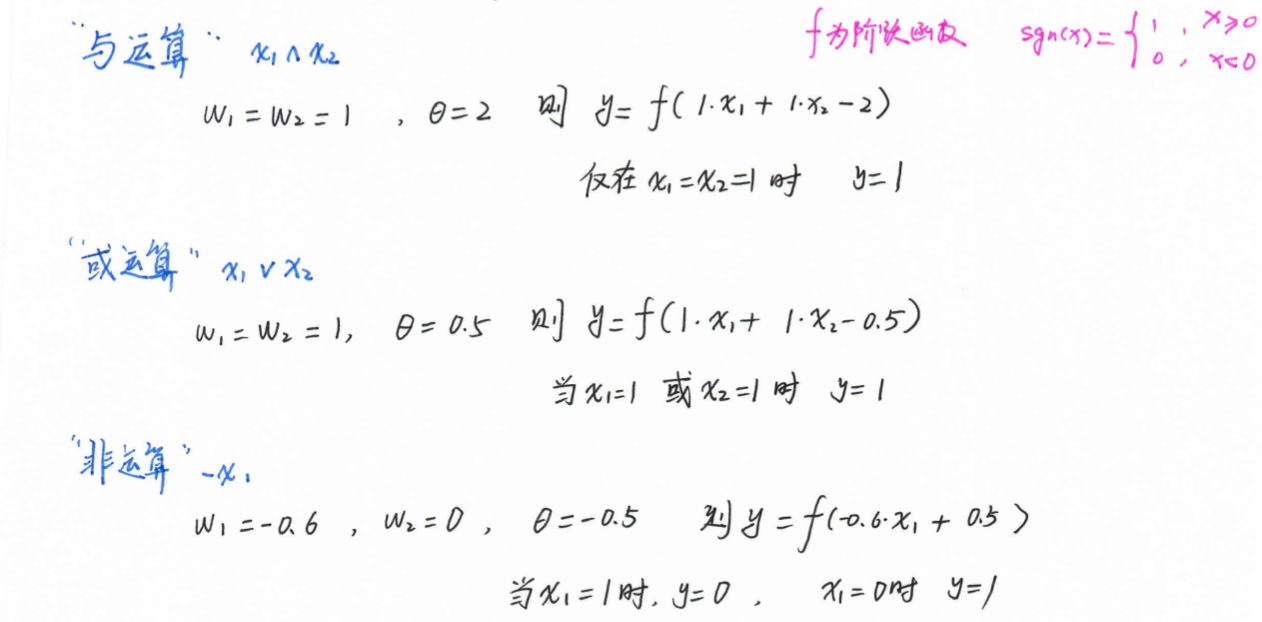

感知机可实现与、或、非运算,

更一般的,给定数据集,权重 ,阈值 θ,可通过学习得到。θ 可看作,输入永远是-1

,阈值 θ,可通过学习得到。θ 可看作,输入永远是-1

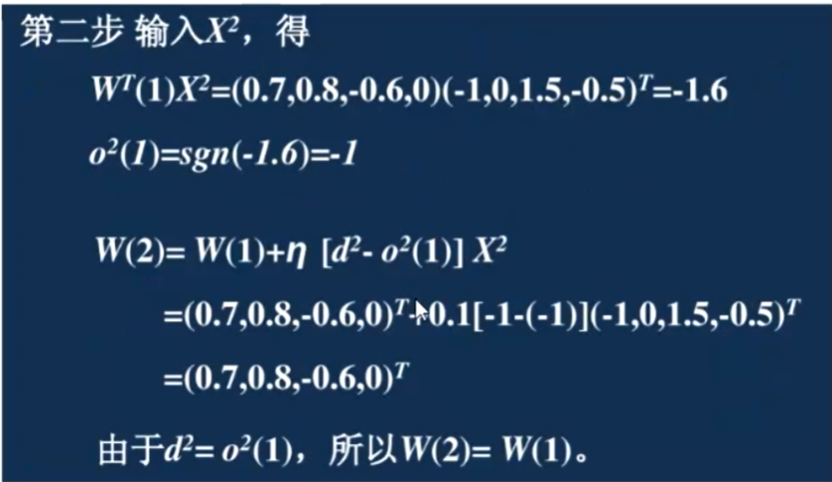

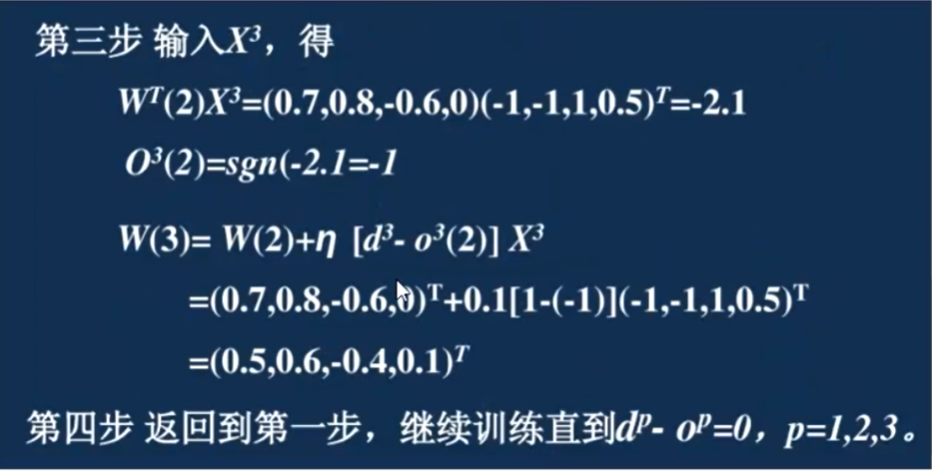

对于训练样例 若当前感知机输出为

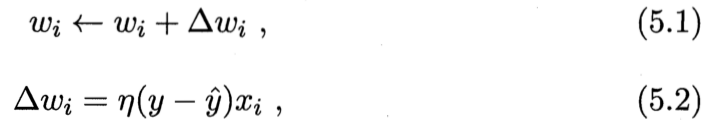

若当前感知机输出为 ,感知机权重调整

,感知机权重调整 学习率

学习率

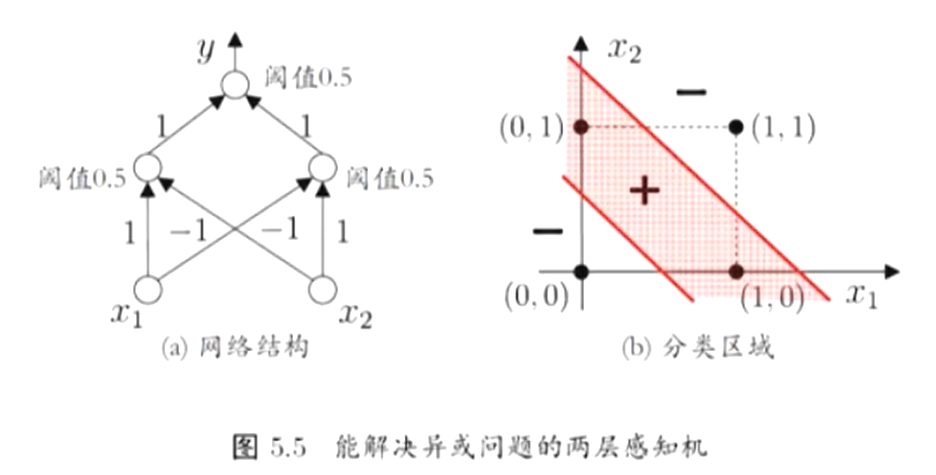

单层感知机只能“与”“或”“非”,非线性“异或”解决不了。

两层感知机可解决“异或”,引出多层前馈神经网络

多层感知机

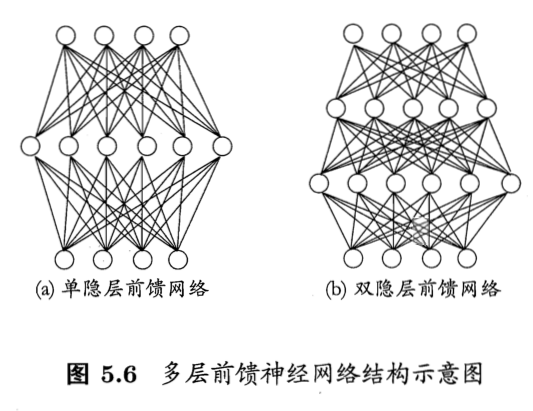

- 输出层与输入层之间的一层神经元,被称之为隐层或隐含层,隐含层和输出层神经元都是具有激活函数的功能神经元

多层前馈神经网络

定义:每层神经元与下一层神经元全互联,神经元之间不存在同层连接也不存在跨层连接。 前馈:输入层接受外界输入,隐含层与输出层神经元对信号进行加工,最终结果由输出层神经元输出。 学习:根据训练数据来调整神经元之间的“连接权”以及每个功能神经元的“阈值”。 多层网络:包含隐层的网络。

5.3 误差逆传播算法

- 误差逆传播(Error Back Propagation,简称BP)算法就是其中最杰出的代表。

- 通常说“BP网络”一般指用BP算法训练多层前馈神经网络。

- 给定训练集

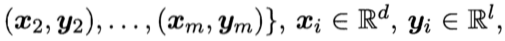

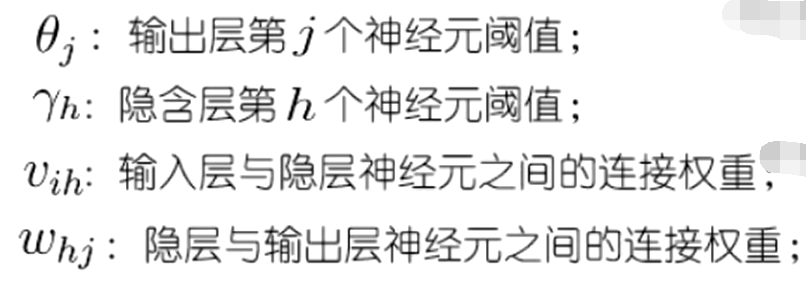

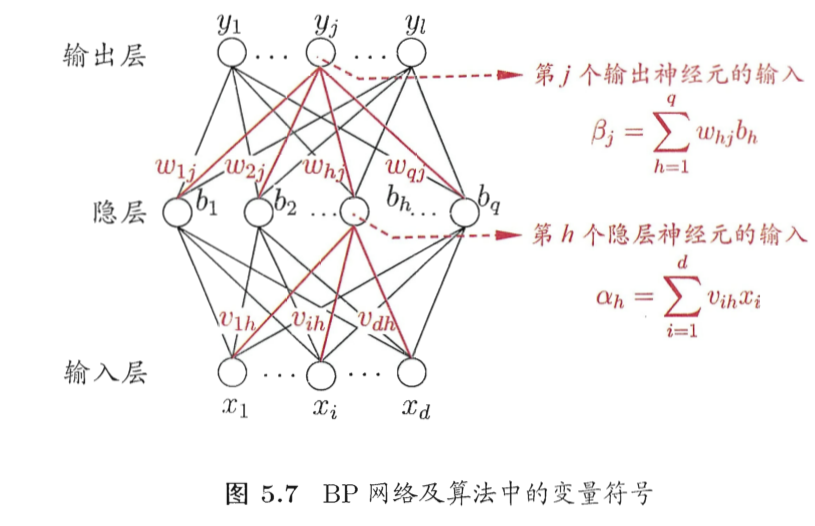

给定d个输入神经元,l个输出神经元,q个隐层神经元的多层前向前馈网络结构。(q为超参数)

给定d个输入神经元,l个输出神经元,q个隐层神经元的多层前向前馈网络结构。(q为超参数)

对于样例 假设网络的实际输出为

假设网络的实际输出为

(均方误差)

(均方误差)

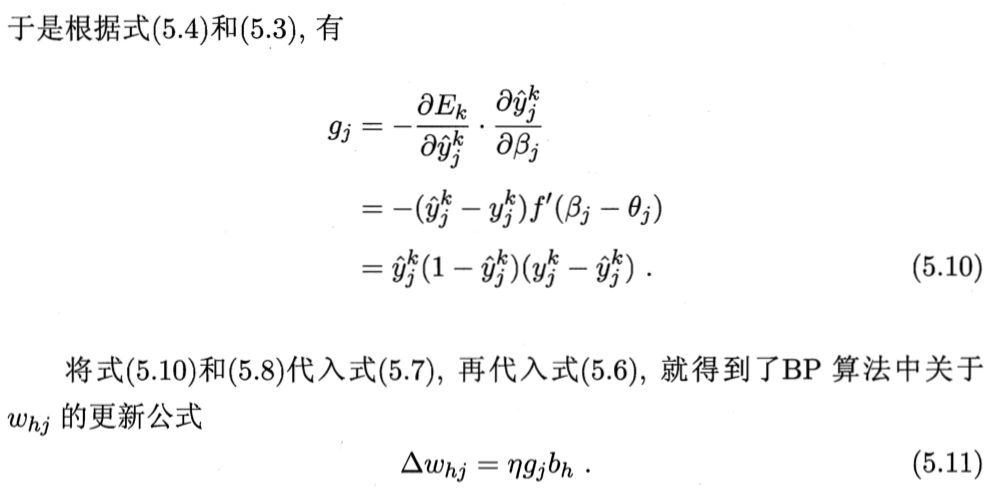

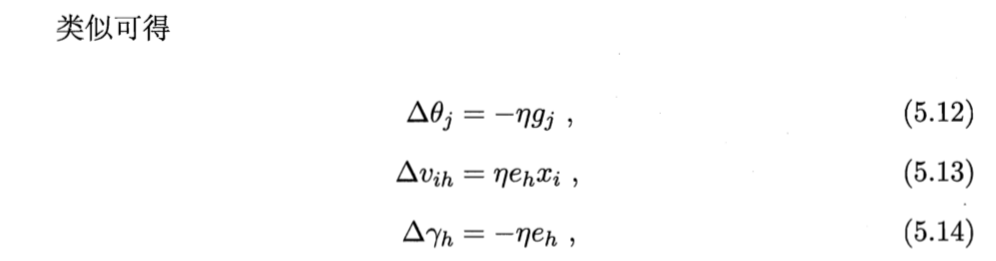

参数优化

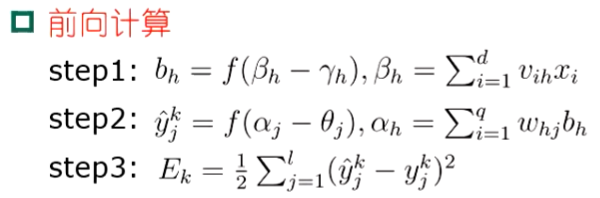

- BP是一个迭代学习算法,在迭代的每一轮中采用广义的感知机学习规则对参数进行更新估计,任意的参数

的更新估计式为

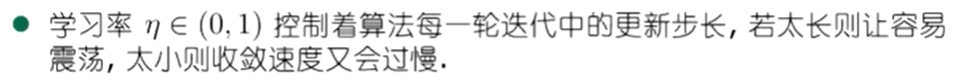

- BP算法基于梯度下降策略,以目标的负梯度方向对参数进行调整。对误差

,给定学习率 η

5.4 全局最小与局部最小

5.5 其他常见神经网络