3.1 基本形式

- 给定

个属性描述的示例

,其中

是

在第

个属性上的取值。线性模型(linear model)通过属性的线性组合来进行预测的函数

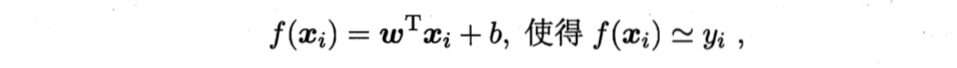

- 函数形式:

- 向量形式:

确定后,模型确定

线性模型有很好的的解释性,更多非线性模型可在线性模型基础上引入层级结构或高维映射可得。

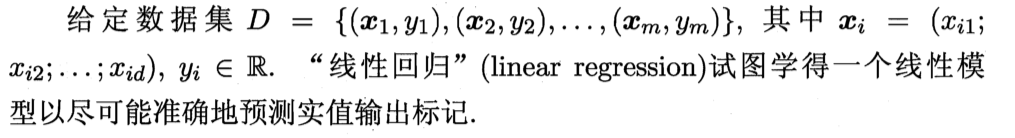

3.2 线性回归

1.一元线性回归

只有一个属性,即d = 1

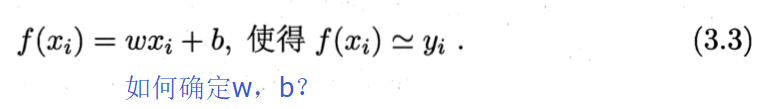

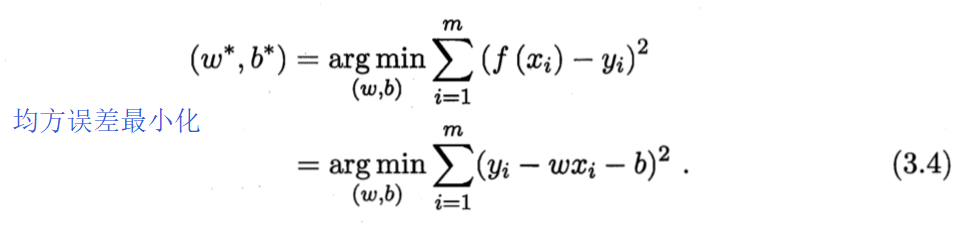

- 目标函数

- 目标函数求解

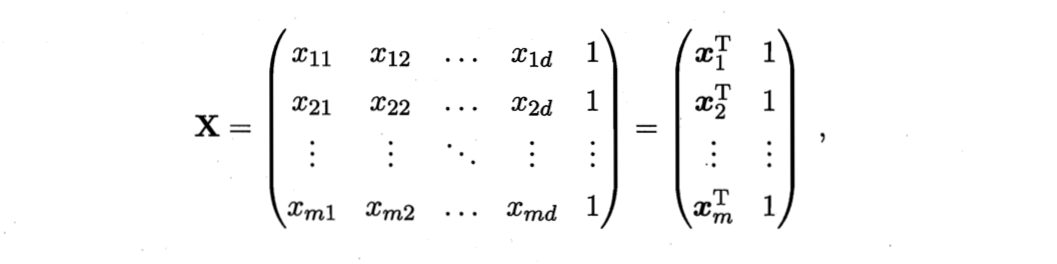

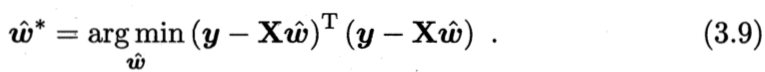

再把标记也写成向量形式,则类似式(3.4)有

:

:

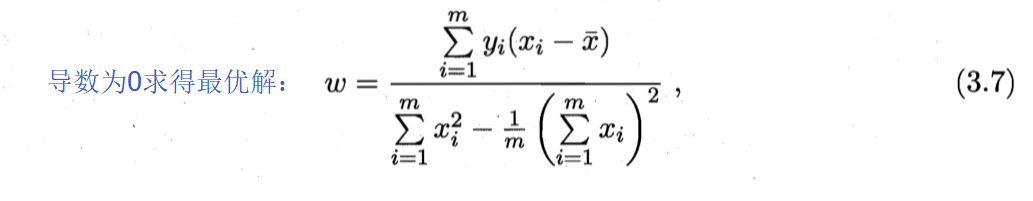

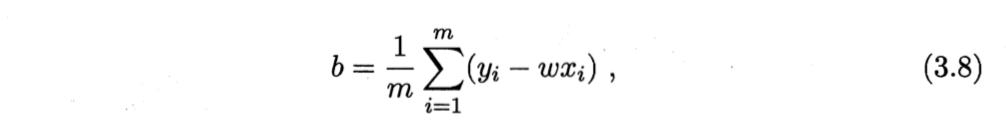

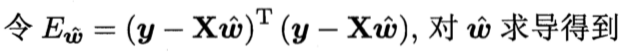

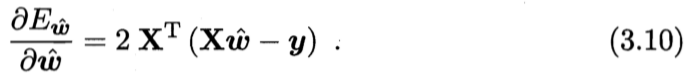

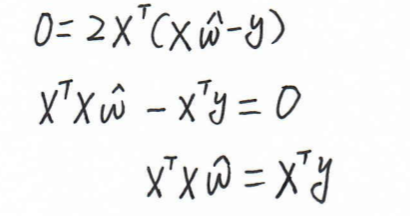

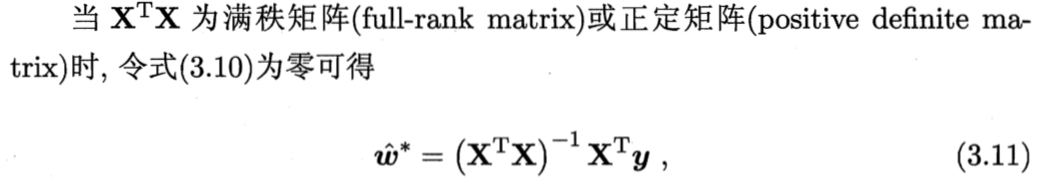

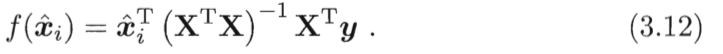

令上式为零可求最优解:

最终学得得多元线性回归模型为:

如果 不满秩,解出多个

不满秩,解出多个,将有算法的归纳偏好决定。常见是引入正则化项(regularization)。

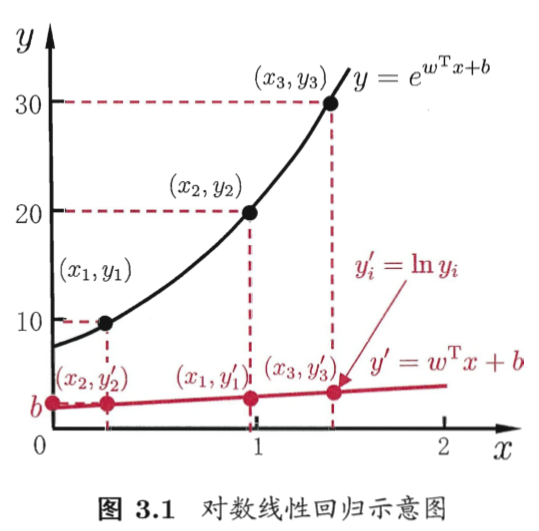

3.对数线性回归

4.广义线性模型

3.3 对数几率回归

若预测值大于零判为正例,小于零判为反例。

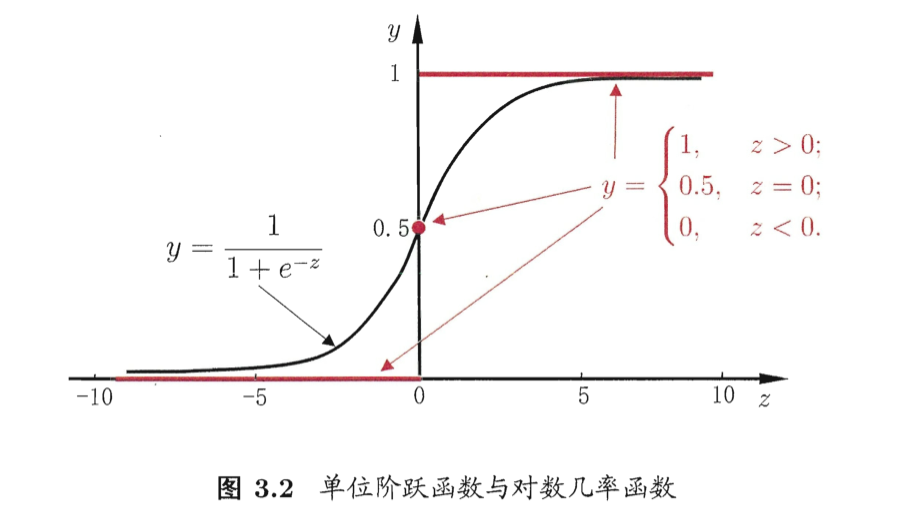

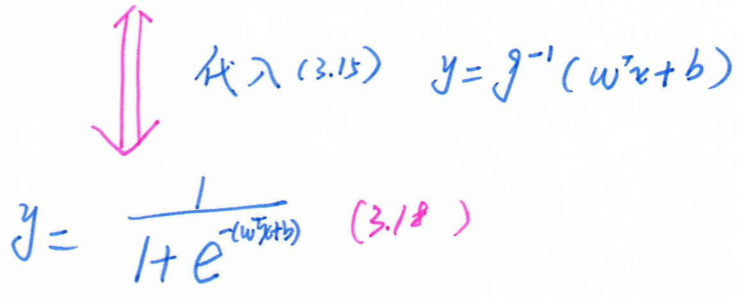

单位阶跃函数不连续,替换为单调可微的对数几率函数:

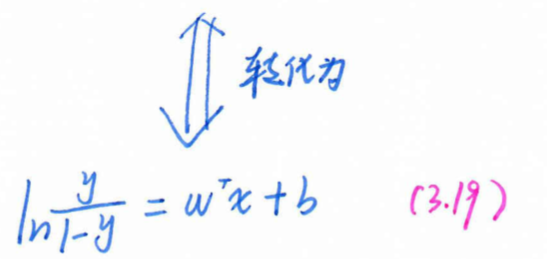

解读:y视为样本正例可能性,则1-y是其反例可能性

“几率”反映x作为正例的相对可能性: (3.20)

“对数几率”: (3.21)

(3.18)用线性回归模型预测结果去笔记真实标记的对数几率,称为“对数几率回归”

3.4 线性判别分析

LDA思想:投影到一条直线上,同类样例尽可能近,异类样例尽可能远。

3.5 多分类学习

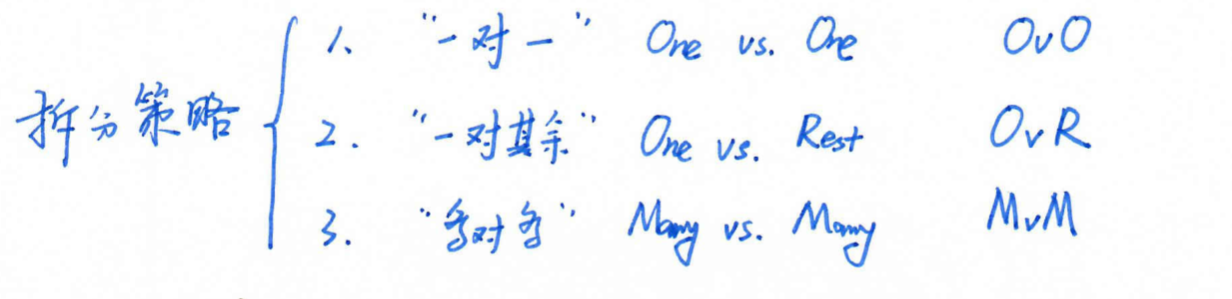

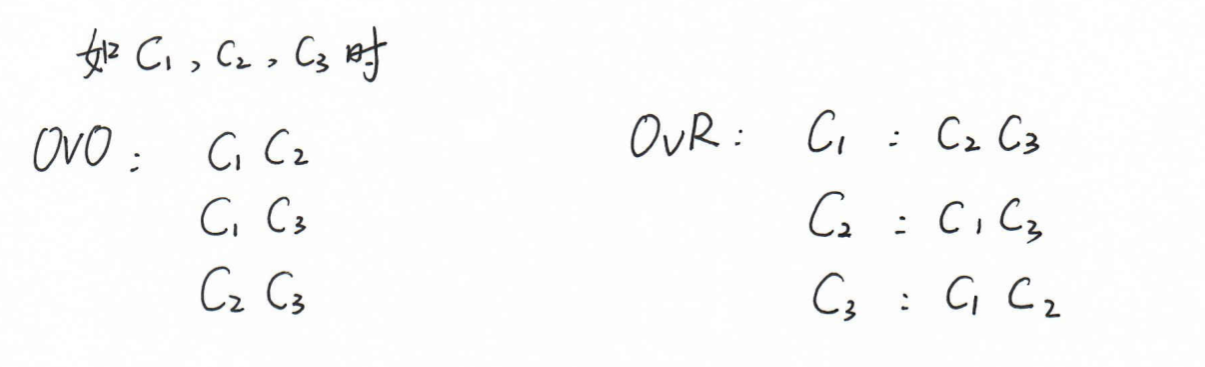

考虑N个类别C,C..,C,多分类学习的基本思路是“拆解法”

OvO:N个类别两两配对:

OvR:每次将一个类作为正例,其他部分为反例训练N个分类器

- OvR为N个分类器;OvO为

个

- OvO存储开销,测试时间开销比OvR大

- OvO每次只用两个,OvR用所有,所以OvO训练时间比OvR小

- 性能两个差不多

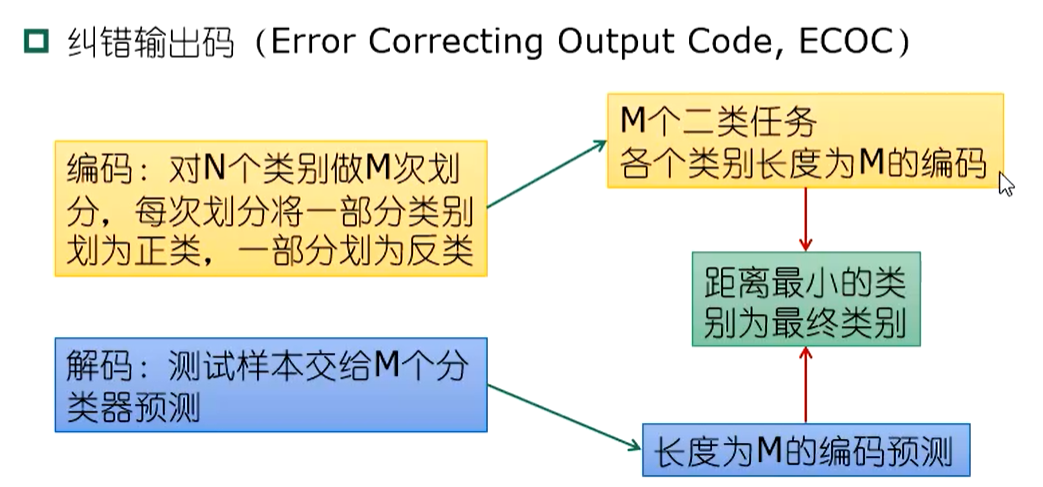

MvM:每次将若干个类作为正类,若干个其他类作为反类。正反构造不能随意。

常用的MvM技术:“纠错输出码”(Error Correcting Output Codes,ECOC)

编码矩阵有多种形式,常见二元码(正,反类),三元码(正,反,停用类)

ECOC编码对分类器错误有一定容忍和修正能力,编码越长、纠错能力越强

对冋等长度的编码,理论上来说,任意两个类別间的编码距离越远,则纠错能力越强

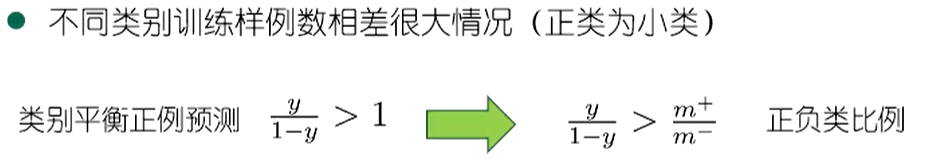

3.6 类别不平衡问题

类别不平衡指分类任务中不同类别训练样例数目相差较大的情况。如998个反例,2个正例,如果全判反,99.8%精度,无意义。

三类解决方法:(再缩放):

- 反例“欠采样”

- 正例“过采样”——SMOTE算法

- “阈值移动”