定义

全连接神经网络(多层感知器)级联多个变换来实现输入到输出的映射。

激活函数

用于对上一层的所有输入求加权和,然后生成一个输出值(通常为非线性值),并将其传递给下一层。如果网络中缺少了激活函数,全连接神经网络将变成一个线性分类器

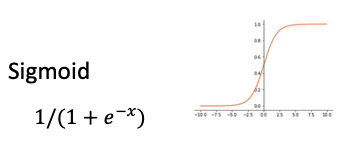

Sigmoid

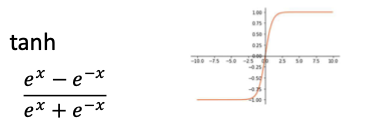

tanh

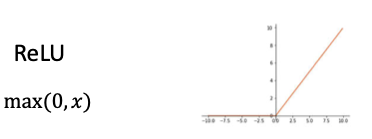

ReLU

Leaky ReLU

总结

尽量选择ReLU函数或者Leakly ReLU函数,相对于Sigmoid/tanh, ReLU函数或者Leakly ReLU函数会让梯度流更加顺畅,训练过程收敛得更快。

损失函数

Softmax

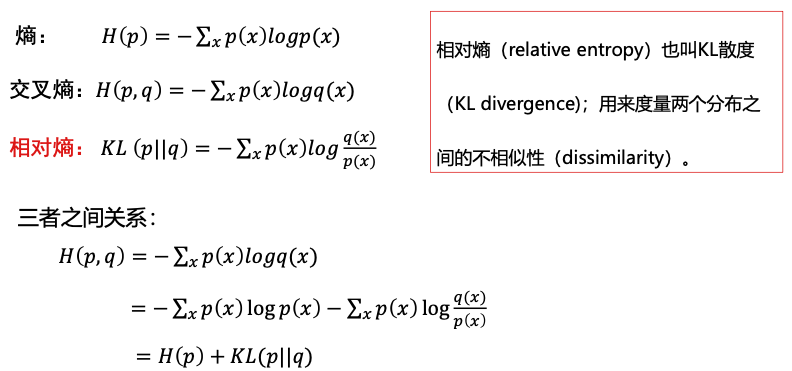

交叉熵

梯度下降

问题

梯度消失

梯度消失是神经网络训练中非常致命的一个问题,其本质是由于链式法则 的乘法特性导致的。

梯度爆炸

解决

动量法

利用历史累加梯度信息更新梯度

由于动量的存在,算法可以冲 出局部最小点以及鞍点,找到更优的解。

自适应梯度法

自适应梯度法通过减小震荡方向步长,增大平坦方向步长来减小震荡,加速 通往谷底方向;

AdaGrad

RMSProp

Adam

过拟合与欠拟合

过拟合

指学习时选择的模型所包含的参数过多,以至于出现这一模 型对已知数据预测的很好,但对未知数据预测得很差的现象。这种情况下 模型可能只是记住了训练集数据,而不是学习到了数据特征。

欠拟合

模型描述能力太弱,以至于不能很好地学习到数据中的规律。 产生欠拟合的原因通常是模型过于简单。

应对过拟合

Dropout

让隐层的神经元以一定的概率不被激活

实现方式:训练过程中,对某一层使用Dropout,就是随机将该层的一些输出舍弃(输出值 设置为0),这些被舍弃的神经元就好像被网络删除了一样。

随机失活比率( Dropout ratio):是被设为 0 的特征所占的比例,通常在 0.2 - 0.5 范围内。

随机失活为什么能够防止过拟合呢?

解释1:随机失活使得每次更新梯度时参与计算的网络参数减少了,降低了模型容量, 所以能防止过拟合。

解释2: 随机失活鼓励权重分散,从这 个角度来看随机失活也能起到 正则化的作用,进而防止过拟合。

超参数

网络结构:隐层神经元个数,网络层数,非线性单元选择等

优化相关:学习率、dropout比率、正则项强度等

优化方法

网格搜索法

1 每个超参数分别取几个值,组合这些超参数值,形成多组超参数; 2 在验证集上评估每组超参数的模型性能;

3 选择性能最优的模型所采用的那组值作为最终的超参数的值。

随机搜索法

1 参数空间内随机取点,每个点对应一组超参数;

2 在验证集上评估每组超参数的模型性能;

3 选择性能最优的模型所采用的那组值作为最终的超参数的值。

<br />