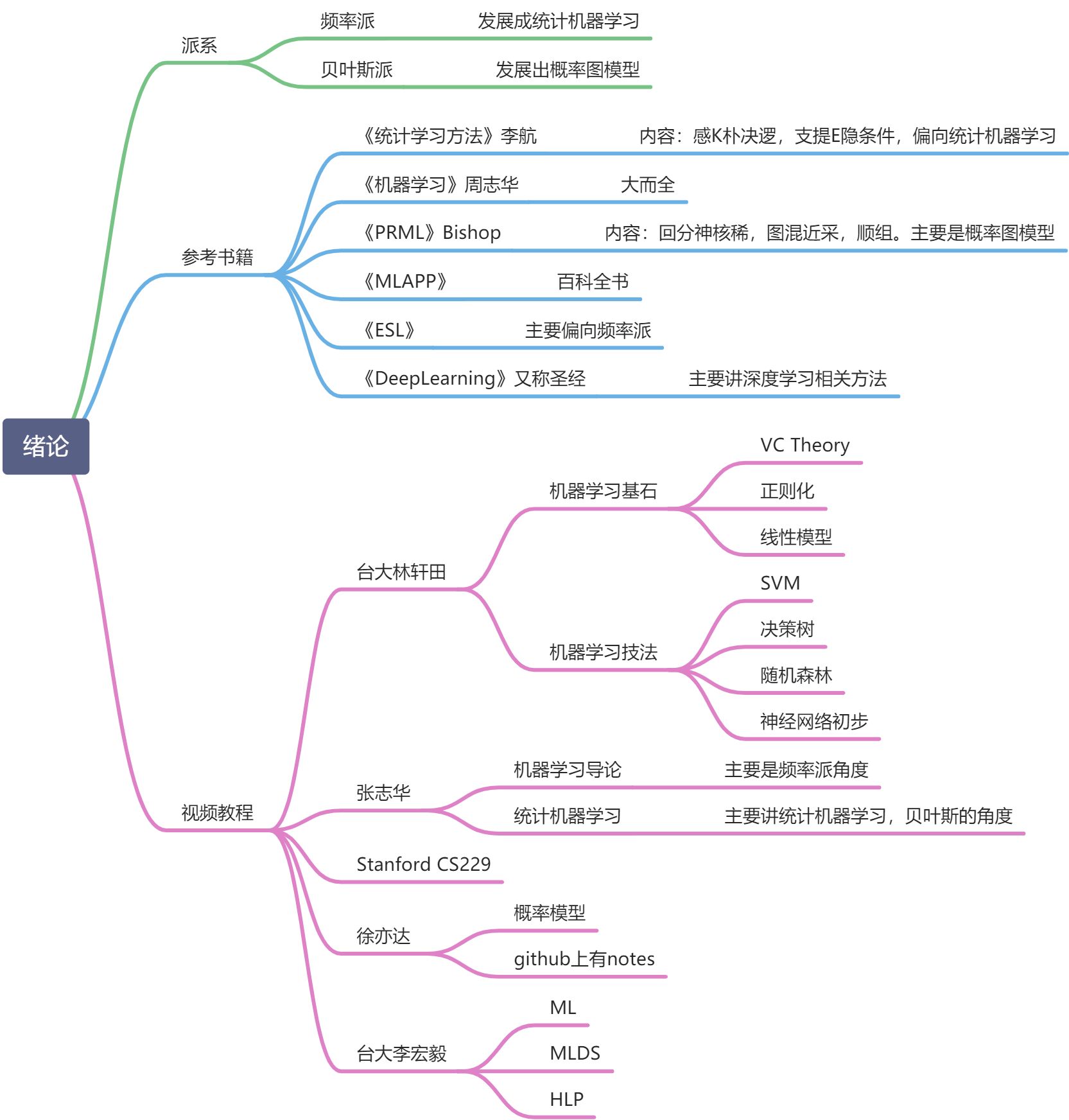

来自机器学习-白板推导系列(一)-开篇的笔记

资料介绍

频率派 VS 贝叶斯派

频率派

主要思想:

- 尝试对事件进行建模,认为事件本身就具有客观的不确定性;

- 认为存在唯一真实常数参数,观察数据都是在这个参数上产生的,由于不知参数为何便引入了最大似然估计和置信区间。

频率派引申出统计机器学习,最终将其演变为一个优化问题。

假设数据为,

为参数,其中

,独立同分布(i.i.d)

频率派认为是一个未知的常量,

是随机变量,估计

经常采用极大似然估计(Maximum Likelihood Estimate,MLE)来做,

,令

常用的做法加个log是将原本的连乘变为加法,即

贝叶斯派

- 不试图解释事件本身的随机性,而是从观察事件的观察者出发,认为不确定性来源于观察者知识的不完备

- 对于知情者而言,便是确定性事件;

- 对于不知情者而言,便是随机事件;

- 贝叶斯派认为参数本身存在一个概率分布,并没有一个唯一的真实参数,参数空间每个值都有可能是真实模型使用的参数,只是概率不同,因此便引入了先验分布和后验分布。

贝叶斯派认为不是常量,本身也是随机变量,服从某种概率分布,即

,这个一般称之为先验概率。

贝叶斯定理使用似然估计将先验概率和后验概率结合在一起。后验概率,其中

是似然估计,

是先验概率,

是积分,即

最大后验估计(Maximum A Posteriori estimation,MAP):求参数,使得后验概率

最大,而

是一个积分为与

无关的定值,故也就是使

最大,其中

是独立同分布的(i.i.d)。用数学语言描述就是

真正的贝叶斯估计所求为,一般分母上的积分很难求,慢慢延伸出了概率图模型,而贝叶斯方法其实就是在求这个积分。

假设求得了贝叶斯估计,可以用来做贝叶斯预测,即已知样本数据,面对未知数据

进行预测,即

,很明显

是后验概率,其实

也就是对后验概率分布的期望值。