1.题目:Threat of Adversarial Attacks on Deep Learning in Computer Vision: A Survey(计算机视觉中深度学习的攻击威胁研究综述)

深度神经网络问题:易收到攻击,表现为输入的细微扰动,从而导致模型预测不正确的输出

2.工作

回顾设计对抗性攻击的作品,分析这种攻击的存在,并提出防御措施;

3.名词

(1)CNN、深度剩余网络、universal adversarial perturbations(普遍对抗扰动);

(2)Adversarial example/image(对抗实例/图像):干净图像的修改版本,其被故意扰乱以混淆深度神经网络等机器学习技术;

Adversarial perturbation(对抗性干扰):添加到干净图像上的噪声,使其成为一个对抗性的例子;

Adversarial training(对抗训练):除了使用干净图像外,还使用对抗图像来训练机器学习模型;

Adversarial(对抗/手):制造对抗实例的代理人,例子本身也就是对手;

Black-Box attacks(黑盒攻击):为目标模型提供了敌对的例子(在测试期间),实例在模型未知的情况下生成的;若使用了关于目标模型的任何信息则被称为“半黑盒”攻击;

Detector(检测器):仅仅检测图像是否是对抗示例的机制;

Fooling ratio/rate(混淆比率):表示在图像受到干扰后,训练模型改变其预测标签的图像的百分比;

One-shot/one-step methods(一次性/单步方法):通过执行单步计算产生对抗性干扰;

Quasi-imperceptible(准不可察觉):对于人来说,准不可察觉的干扰对图像的损害非常小;

Rectifier(修正器):修改一个对抗的示例,将目标模型的预测恢复到它在同一个例子的干净版本上的预测;

Targeted attacks(定向攻击):有针对性的攻击欺骗模型,使其错误地为对抗图像预测特定标签;而非目标攻击中,只要不是正确的标签,对抗图像的预测标签是不相关的;

Threat model(威胁模型):指通过一种方法所考虑的潜在攻击类型,例如黑盒攻击

Transferability(可移植性):指一个对抗的示例即使对于除了产生它的模型之外的模型也能保持有效的能力

Universal perturbation(普遍干扰):能以高概率在任何图像上混淆给定的模型,干扰的性质是“图像不可知”,而不具有良好的可传递性

White-box attacks(白盒攻击):白盒攻击认定目标模型具有完整性,包括其参数值,体系结构,训练方法,在某些情况下还包括其训练数据;和黑盒攻击相反,即攻击者很了解模型

4.应用

计算机视觉在深度学习上的研究推动了医学以及移动应用的发展;自动驾驶汽车,监视,恶意软件检测,无人机和机器人,语音命令识别

5.时间线

(1)2012年Krizhevsky等人在2012年的一项极具挑战性的大规模视觉识别任务上展示了基于卷积神经网络(CNN)的模型性能不错;

(2)Szegedy et al.发现问题,现有深度网络易受到敌对攻击,表现为对人类视觉系统几乎察觉不到的图像的小干扰;深度学习特征定义了感知距离与欧几里得距离非常接近的空间;他们发现深度神经网络对于对抗示例的鲁棒性可以通过对抗训练来提高

(3)Goodfellow et al.开发了一种可以通过解决<3>问题来有效地计算给定图像的对抗干扰的方法;

“线性假设”:Goodfellow等假设现代深度神经网络的设计鼓励线性行为以获取计算收益,也使它们容易受到廉价的分析干扰的影响;

(4)Kurakin等人提出一种快速梯度符号法的“一步目标类”变体形式,其中代替使用<3>中图像的真实标签l;

对干净图像使用了网络预测的最不可能类别的标签l,然后从原始图像中减去计算出的干扰项并使其成为一个对立的例子;对于具有交叉熵损失的神经网络,这样做最大化了网络预测l作为对抗例子的标签的概率;证明得出,对抗训练提高了深层神经网络对由FGSM及其变体产生的攻击的鲁棒性。

(5)Miyato等人提出一个相关的方法来计算干扰项;如<4>

(6)Madry等人指出BIM相当于投影梯度下降的L∞版本,是一种标准的凸优化方法;Kurakin等人还将BIM扩展到迭代最小可能类方法(ILCM),此情况下,图像标签被替换为由分类器预测的最不可能的类别的目标标签;由ILCM方法生成的对抗示例会严重影响现代深度体系结构的分类精度;

(7)Papernot等人通过限制L0范数的干扰来制造对抗攻击,这样目标是只修改图像中的几个像素,而不是扰乱整个图像来欺骗分类器

(8)Su et al.测试仅改变一个像素来欺骗网络模型,网络在错误标签上的平均置信度较高;

(9)C&W的一套三种对抗式攻击

(10)Chen等人提出基于零阶优化(ZOO)的攻击,该攻击直接估计目标模型的梯度以生产对抗示例;

(11)Moosavi-Dezfooli等人提出以迭代方式计算给定图像的最小范数对抗干扰;在除了特定图像的对抗性扰动上,还证明了“一般性扰动”的存在,可以欺骗任何图像上的网络分类器。

(12)Athalye 等人证明了甚至可以三维打印真实世界的物体,这些物体可以欺骗深层神经网络分类器

6.概述

第二节:用计算机视觉术语描述与对抗攻击相关的术语;

第三节:回顾用于图像分类和其他任务的对抗攻击;3.1中回顾攻击深层神经网络的方法,深层神经网络在计算机视觉中的常见任务就是分类/识别;3.2中部分讨论了主要设计并用于深入学习的方法

第四节:介绍在现实世界中处理对抗攻击的方法

第五节:分析对抗攻击的存在为主的著作

第六节:讨论防御敌对攻击的方法

第七节:基于审查的文献提供一个更广泛的研究方向的前景

第八节:结论

7.内容

7.1 分类攻击

(1)Box-constrained L-BFGS

Szegedy提出解决问题: …………<1>

…………<1>

“l”表示图像的标签,C( )是深度神经网络分类器,‘c’强调图像是干净的,干扰项ρ;

其中<1>的问题很困难,有一个解决办法就是使用box-contrained L-BFGS …………<2>

…………<2>

L(……)计算分类器的损失

小结:L-BFGS算法是解无约束非线性规划问题最常用的方法,具有收敛速度快、内存开销少等优点

(2)Fast Gradient Sign Method (FGSM)

快速梯度符号法 ………………………………<3>

………………………………<3>

其中∇J(. ,. ,. )计算模型参数θ 关于 Ic的当前值附近的成本函数的梯度,sign()函数能够限制扰动的范数

FGSM干扰图像以增加分类器在结果图像上的损失,符号函数确保损失的大小最大化,

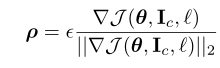

…………………………………<4>

…………………………………<4>

上式中计算的梯度用它的L2范数归一化,狭义上称为快速梯度L2法,另外使用L∞范数进行归一化的替代方法称为快速梯度L∞法,广义上称为“单步/一击”法

(3)Basic & Least-Likely-Class Iterative Methods(基本&最不可能类 迭代法)

单步法通过在增加分类器损失的方向上的单步梯度上升来扰乱图像

基本迭代法(BIM):迭代地采取多个小步骤,同时在每个步骤之后调整方向;迭代计算的内容如<5>; …………<5>

…………<5> 表示迭代时的干扰图像,Clip( )在参数

表示迭代时的干扰图像,Clip( )在参数 和α处截取图像像素值从而确定步长;

和α处截取图像像素值从而确定步长;

迭代次数由 决定;

决定;

(4) Jacobian-based Saliency Map Attack (JSMA)(基于雅可比的显著图攻击)

限制L0范数的干扰来制造的对抗攻击;

只修改图像中的几个像素,该算法一次一个地修改原始的干净图像的像素,并监控变化对最终分类的影响;通过使用网络层输出的梯度计算显著图来执行监控,显著图中较大的值表示欺骗网络预测Ltarget作为修改图像标签的可能性较高而不是原始标签L;

该算法执行有针对性的欺骗,一计算出map,算法就选择最有效的像素来欺骗网络并改变它,重复这个过程直到对抗图像中允许的最大像素被改变或者欺骗成功

(5)单像素攻击

利用差分进化算法计算出对抗示例;对于干净的图像,创建了一组400个向量,每个向量包含任意候选像素的xy坐标和RGB值;然后随机修改向量的元素来创建子代,这样子代在下一次迭代中与其父代竞争合适度,网络的概率预测标签被作为合适度标准,最后存活下来的子代被用来改变图像中的像素。

差分进化生成的对抗示例,无需访问任何关于网络参数值或者梯度的信息,需要的唯一输入是目标模型预测的概率标签

(6)Carlini and Wagner Attacks (C&W攻击)

C&W提出的一套三种对抗式攻击通过限制L0,L2,L∞范数使干扰变得几乎不可察觉;同时针对目标网络的defensive distillation几乎不能抵抗这些攻击。

(7)DeepFool(深度欺骗)

该算法使用干净的图像初始化,图像假定位于分类器决策边界所限制的区域中,该区域决定图像的类别标签;通过一个小矢量对图像进行干扰。

(8)Universal Adversarial Perturbations(普遍对抗性干扰)

8.else

(1)深度剩余网络——>图像识别任务

(2)交叉熵作为损失函数在神经网络中的作用

交叉熵用来判断实际输出(概率)与期望输出(概率)的接近程度,值越小,两个概率分布越接近

(3)Lp范数: ||x||为x向量各个元素绝对值p次方和的1/p次方;L∞范数: ||x||为x向量各个元素绝对值最大那个元素的绝对值