1.introduction

- 现有的网络,不同卷积层级上都是语义强壮的,包括高分辨率的层级。

- 每一层语义的特征提取是没必要的,推测时间会增加很多。

- SSD是首批应用特征金字塔模型的,但是为了避免低级的特性,ssd放弃了重用已经算过的层,而是从高层开始构建金字塔。错失了宠用特征层次结构的高分辨率的机会。

-

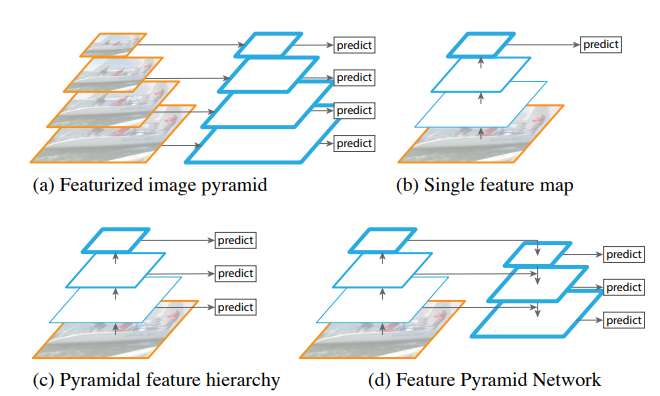

1.每层都计算,很慢 2.只用最高层语义信息,很块,但不适合小目标 3.重用上层语义,轻视低层语义SSD

4.FPN 蓝色测粗细表示语义的强弱 本作优点:达到state of the art,可以end to end,

2.Related Work

Hand-engineered features and early neural networks.

Deep ConvNet object detectors.

OverFeat:早期神经网络+滑窗

R-CNN:采用region-proposal,区域建议

SPP-Net:SPPnet证明了这种基于区域的检测器可以更有效地应用于单图像尺度上提取的特征图。

FastFaster:建议使用单一比例计算出来的特性,可以得到很好的权衡。

但是多尺度效果还是好一些,特别是小物体识别。Methods using multiple layers.

在预测前采用多层级联,等价于转换以后的特征之和。

SSD预测多个层次而不采用级联。

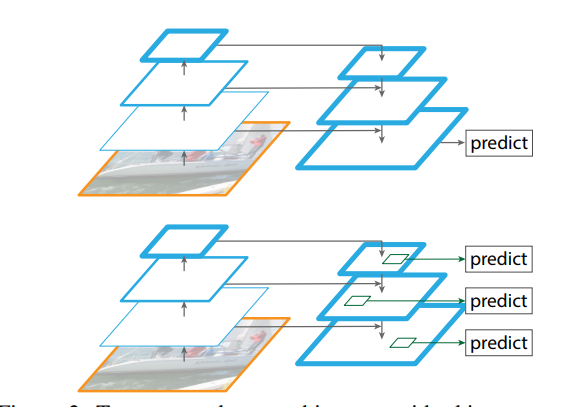

上:自顶向下跳过连接,在最好的层级上预测,FPN在所有的层级上预测。

FPN

Bottom-up pathway

自底向上的卷积,选择Resnet的每一块的最后的输出块的特征激活,记作c2,c3,c4,c5,么有选择C1是因为占有太大的内存。

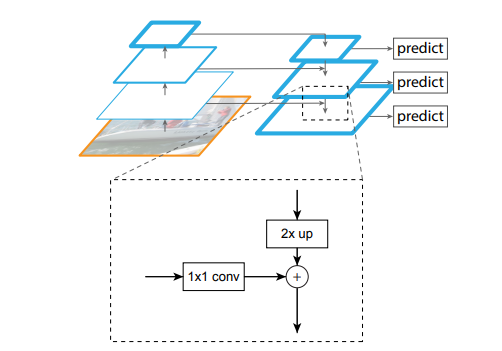

Top-down pathway and lateral connections

自上而下的路径通道在空间上很粗糙但是在语义上更强的从更高的金字塔层上获得更高的分辨率的特征图,自下而上的路径有较低的语义但是他可以更精准的定位,因为呗细分的次数很少。

简单起见,自顶向下采用最近邻上采样,如下图:

然后与经过11卷积的左边融合,来减少通道数。这个过程被不断迭代,知道得到最高的分辨率,为了开始迭代,只要在C5附加一个11的卷积层,生成最粗操多分辨率图。在每个合并的映射上采用33的卷积,生成最终映射,以减少过采样的混叠效应。

*不太懂:由于每个曾词都是用相同的分类器,和传统的金字塔一样,所以要固定的特征维数,本文设置d=256,所有卷积层都有256各通道的输出,在这些额外的层中没有非线性,影响很小。

Applications

RPN是一种滑窗的目标检测器,FPN在每个级别上设置单一规模的锚点,3*5得到了15种锚。

根据IOU来得到正负label。大于0.7得到正,小与0.3为负样本,

在Fast R-CNN中是基于区域的检测器,其中感兴趣的区域用ROI来提取特征。由于是但尺度的,所以要将不同尺度的ROI分配到各个层级。

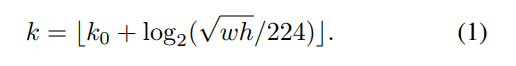

通过高宽用这个公式区分层级。k0取4,wh越小,得到的级别越低。

FPN应用于RPN

Faster RCNN中的RPN是通过最后一层的特征来做的。最后一层的特征经过3x3卷积,得到256个channel的卷积层,再分别经过两个1x1卷积得到类别得分和边框回归结果。这里将特征层之后的RPN子网络称之为网络头部(network head)。对于特征层上的每一个点,作者用anchor的方式预设了9个框。这些框本身包含不同的尺度和不同的长款比例。

FPN针对RPN的改进是将网络头部应用到每一个P层。由于每个P层相对于原始图片具有不同的尺度信息,因此作者将原始RPN中的尺度信息分离,让每个P层只处理单一的尺度信息。具体的,对{32^2、64^2、128^2、256^2、512^2}这五种尺度的anchor,分别对应到{P2、P3、P4、P5、P6}这五个特征层上。每个特征层都处理1:1、1:2、2:1三种长宽比例的候选框。P6是专门为了RPN网络而设计的,用来处理512大小的候选框。它由P5经过下采样得到。

另外,上述5个网络头部的参数是共享的。作者通过实验发现,网络头部参数共享和不共享两种设置得到的结果几乎没有差别。这说明不同层级之间的特征有相似的语义层次。这和特征金字塔网络的原理一致。

FPN应用于Fast RCNN

作者将FPN的各个特征层类比为图像金字塔的各个level的特征,从而将不同尺度的RoI映射到对应的特征层上。以224大小的图片输入为例,宽高为w和h的RoI将被映射到的特征级别为k,它的计算公式如下:

在ResNet中,k0的值为4,对应了长宽为224的框所在的层次。如果框的长宽相对于224分别除以2,那么k的值将减1,以此类推。

在Faster RCNN中,ResNet的conv4层被用来提取RoI,经过RoI Pooling后映射到14x14的大小。经过RoI Pooling后的特征再进入原来的conv5层,进而得到最终的分类和边框回归结果。在FPN中,conv5层已经被用来作为特征提取器得到P5层;因此,这里单独设计两个1024维的全连接层作为检测网络的网络头部。新的网络头部是随机初始化的,它相比于原来的conv5层更加轻量级。

Experiments on Object Detection

一些要点

- 1*1卷积作用:使bottom-up对应层降维至256;缓冲作用,防止梯度直接影响bottom-up主干网络,更稳定;组合特征。

- 上采样:这里的实现使用的是最简单的上采样,没有使用线性插值,没有使用反卷积,而是直接复制。

- 横向链接:就是像素值相加,把p5和c4转到一样的池逊然后想加

- 整体思想:把高层的特征传下来,补充低层的语义,这样就可以获得高分辨率、强语义的特征,有利于小目标的检测。

- 横向链接的作用:如果不进行特征的融合(也就是说去掉所有的1x1侧连接),虽然理论上分辨率没变,语义也增强了,但是AR下降了10%左右!作者认为这些特征上下采样太多次了,导致它们不适于定位。Bottom-up的特征包含了更精确的位置信息。

- 如下图

FPN本身不是检测算法,只是一个特征提取器。它需要和其他检测算法结合才能使用。

生词积累

| 单词 | 翻译 | 单词 | 翻译 |

|---|---|---|---|

| pyramids | 金字塔 | component | 组成、成分 |

| intensive | 密集的 | inherent | 内在的,固有的 |

| hierarchy | 层次性 | marginal |

adj.微不足道的,边缘的 |

| lateral | adj.侧面的横向的 |

semantic | adj.语义的,语言的 |

| surpassing | vt.胜出超过 | intuitively | adv.直观的,直觉的 |

| robust | adj.强健的,强鲁棒性的 | neverrheless | adv.然而,不过 |

| inconsitency | n.不一致的 | spatial | adj.空间的 |

| ablation | n.消融实验 | facilitate | vt.促使,便利 |

| densely | adv.密集的 | exploiting | vt.开发,发挥 |

| leverage | n.影响力 | coaser | adj.粗糙的 |

| enhence | adj/v 提高增强 |

科研句子积累

- without bells and whistles 不整虚的