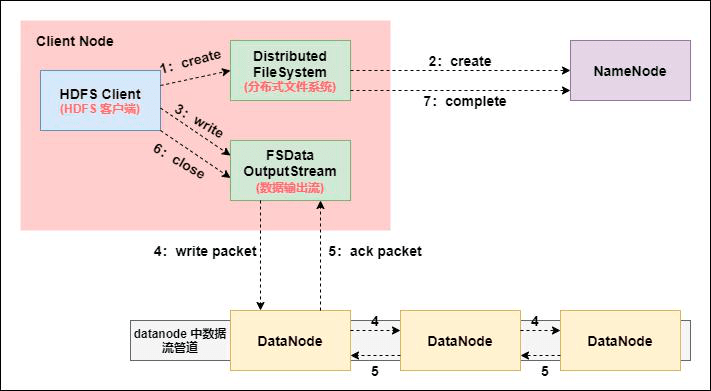

1、HDFS写数据流程

- Client 发起文件上传请求,通过 RPC 与 NameNode 建立通讯, NameNode 检查目标文件是否已存在,父目录是否存在,返回是否可以上传;

- Client 请求第一个 block 该传输到哪些 DataNode 服务器上;

- NameNode 根据配置文件中指定的备份数量及机架感知原理进行文件分配, 返回可用的 DataNode 的地址如:A, B, C;

- Client 请求 3 台 DataNode 中的一台 A 上传数据(本质上是一个 RPC 调用,建立 pipeline ),A 收到请求会继续调用 B,然后 B 调用 C, 将整个 pipeline 建立完成, 后逐级返回 client;

- Client 开始往 A 上传第一个 block(先从磁盘读取数据放到一个本地内存 缓存),以 packet 为单位(默认 64K),A 收到一个 packet 就会传给 B, B 传给 C。A 每传一个 packet 会放入一个应答队列等待应答;

- 数据被分割成一个个 packet 数据包在 pipeline 上依次传输,在 pipeline 反方向上, 逐个发送 ack(命令正确应答),最终由 pipeline 中第一个 DataNode 节点 A 将 pipelineack 发送给 Client;

- 当一个 block 传输完成之后,Client 再次请求 NameNode 上传第二个 block,重复步骤 2;

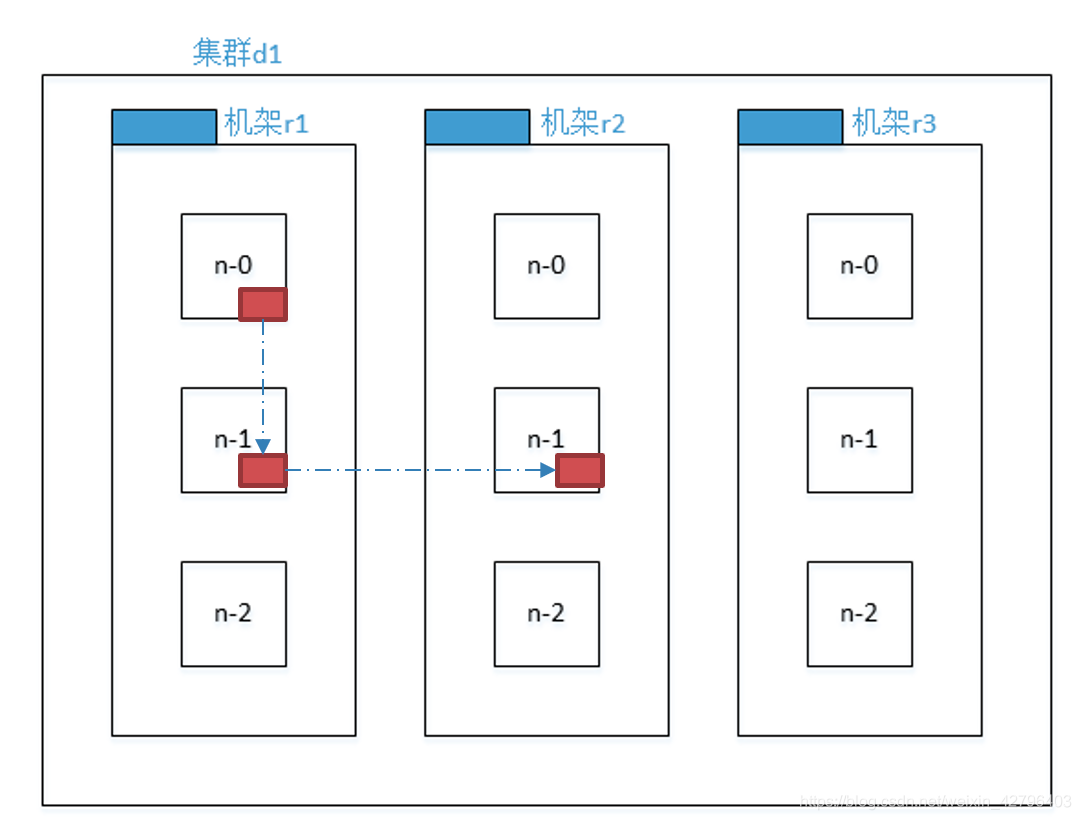

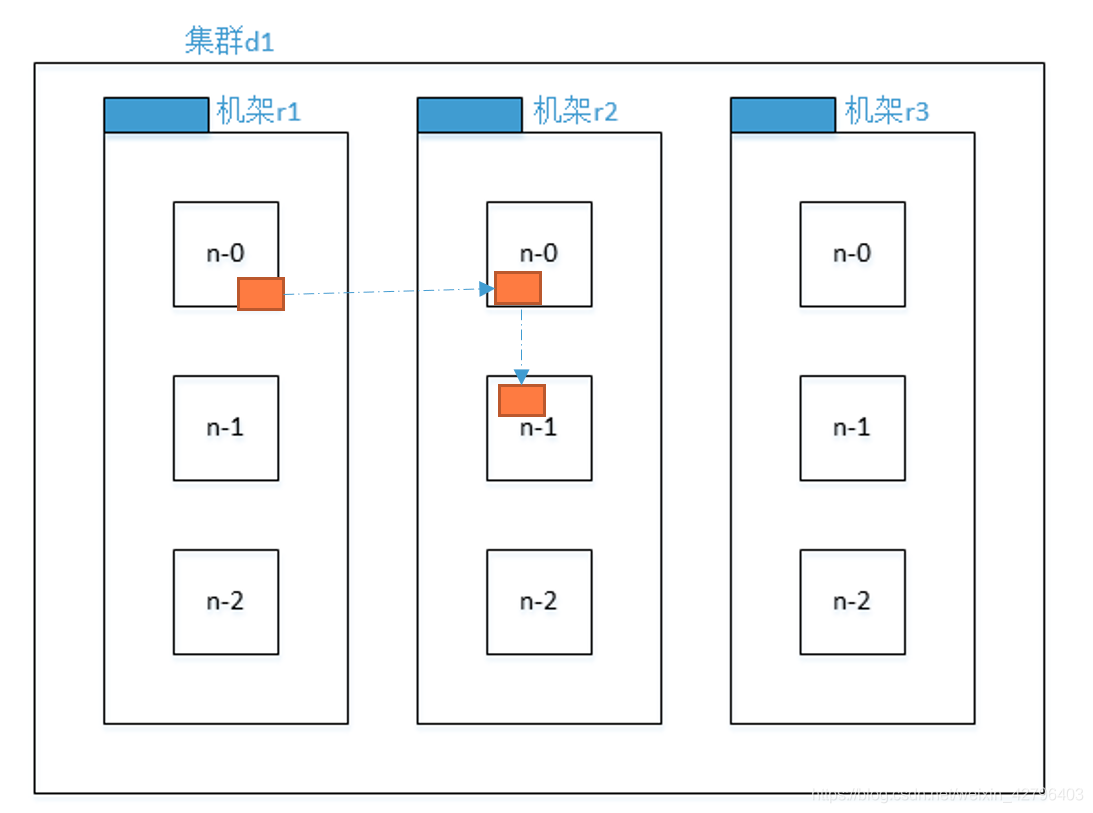

考点一:机架感应策略

- HDFS根据请求返回DataNode的节点的策略?— 机架感知

- 如果当前Client所在机器有DataNode节点,那就返回当前机器DN1,否则从集群中随机一台。

- 根据第一台机器的位置,然后再其他机架上随机一台,在第二台机器所在机架上再随机一台。

- 以上策略的缘由:为了提高数据的可靠性,同时一定程度也保证数据传输的效率!

Hadoop2.x的副本节点选择机制

Hadoop3.x的副本节点选择机制

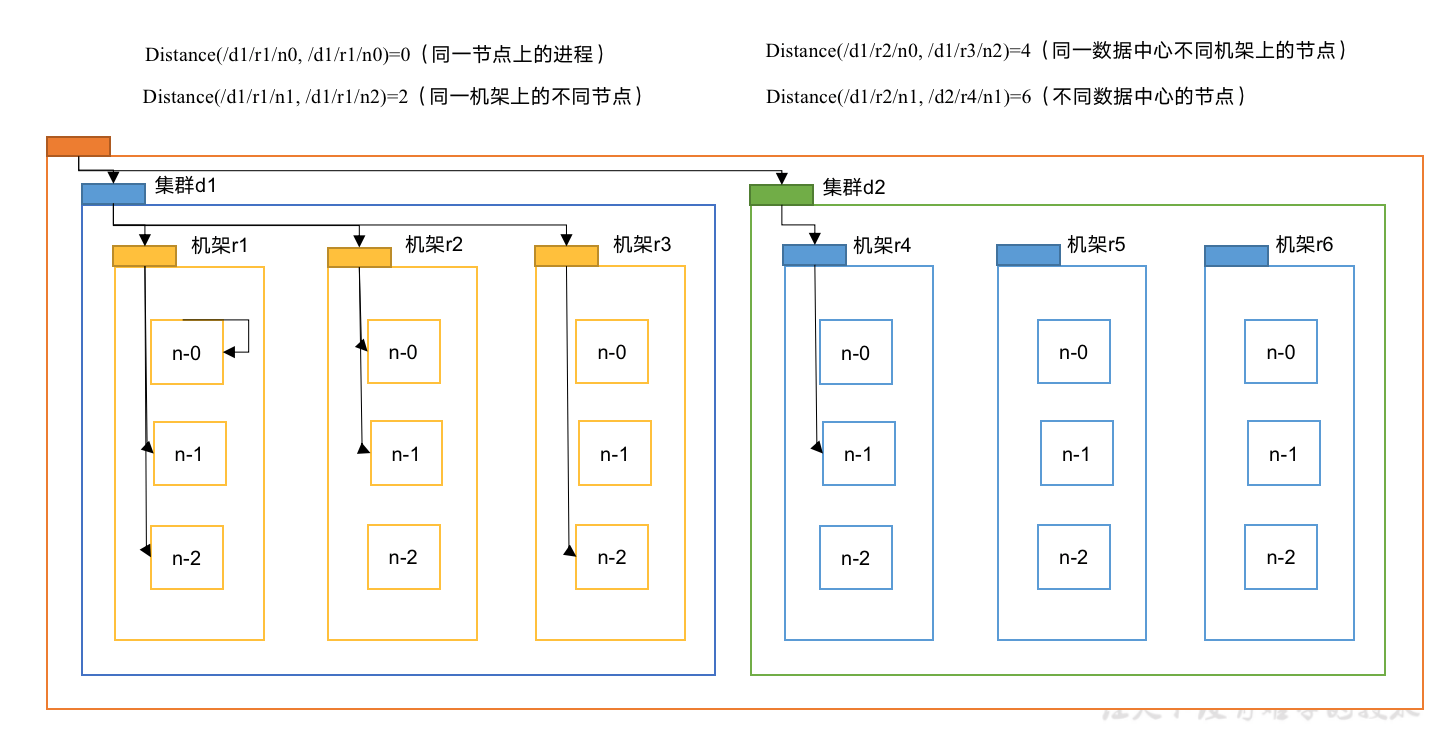

考点二:网络拓扑

- 客户端建立传输通道的时候如何确定和哪一台DataNode先建立连接?— 网络拓扑

- 找离client最近的一台机器先建立通道

考点三:IO效率最大化

- Client为什么是以串行的方式建立通道?

- 通过串行的方式在三个DataNode中数据流管道来write packet

- 本质上就是为了降低client的IO开销

考点四:Ack策略

- 数据传输的时候如何保证数据成功?

- 采用了ack回执的策略保证了数据完整成功上传

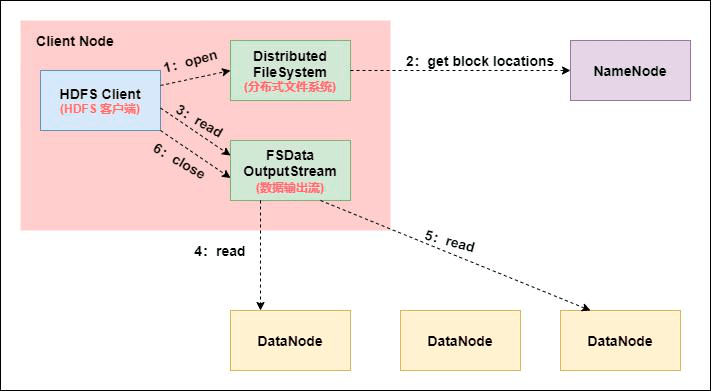

2、HDFS读数据流程

- Client 向 NameNode 发起 RPC 请求,来确定请求文件 block 所在的位置;

- NameNode 会视情况返回文件的部分或者全部 block列表,对于每个 block, NameNode 都会返回含有该 block 副本的 DataNode 地址; 这些返回的 DN 地址,会按照集群拓扑结构得出 DataNode 与客户端的距离,然后进 行排序,排序两个规则:网络拓扑结构中距离 Client 近的排靠前;心跳 机制中超时汇报的 DN 状态为 STALE,这样的排靠后;

- Client 选取排序靠前的 DataNode 来读取 block,如果客户端本身就是 DataNode,那么将从本地直接获取数据(短路读取特性);

- 底层上本质是建立 Socket Stream(FSDataInputStream),重复的调用 父类 DataInputStream 的 read 方法,直到这个块上的数据读取完毕;

- 当读完列表的 block 后,若文件读取还没有结束,客户端会继续向 NameNode 获取下一批的 block 列表;

- 读取完一个 block 都会进行 checksum 验证,如果读取 DataNode 时出 现错误,客户端会通知 NameNode,然后再从下一个拥有该 block 副本的 DataNode 继续读。

- read 方法是并行的读取 block 信息,不是一块一块的读取;NameNode 只 是返回 Client 请求包含块的 DataNode 地址,并不是返回请求块的数据;

- 最终读取来所有的 block 会合并成一个完整的最终文件。

3、NameNode和SecondaryNameNode的工作机制

- 元数据信息要保存在哪?

- 保存到磁盘

- 不足:读写速度慢 效率低!

- 保存内存

- 不足:数据不安全

- 最终的解决方案: 磁盘 + 内存

- 保存到磁盘

- 内存中的元数据和磁盘中的元数据如何进行同步。(元数据的维护策略)

- 当我们对元数据进行操作的时候,首先在内存进行合并,其次还要把相关操作记录追加到edits编辑日志文件中,在满足一定条件下,将edits文件中的记录合并到元数据信息文件中 fsimage

- 谁负责对NN的元数据信息进行合并?

- 2NN主要负责对NN的元数据精心合并,当满足一定条件的下,2NN会检测本地时间,每隔一个小时会主动对NN的edits文件和fsimage文件进行一次合并。合并的时候,首先会通知NN,这时候NN就会停止对正在使用edits文件的追加,同时会新建一个新的edits编辑日志文件,保证NN的正常工作。接下来 2NN会把NN本地的fsimage文件和edits编辑日志拉取2NN的本地,在内存中对二者进行合并,最后产生最新fsimage文件。把最新的fsimage文件再发送给NN的本地。注意还有一个情况,当NN的edits文件中的操作次数累计达到100万次,即便还没到1小时,2NN(每隔60秒会检测一次NN方的edits文件的操作次数)也会进行合并。2NN 也会自己把最新的fsimage文件备份一份。