线性回归

对于样本数据集,我们推测他们的输入跟输出之前有着某种关系,及 y= kx(关系即函数),这叫做线性回归。

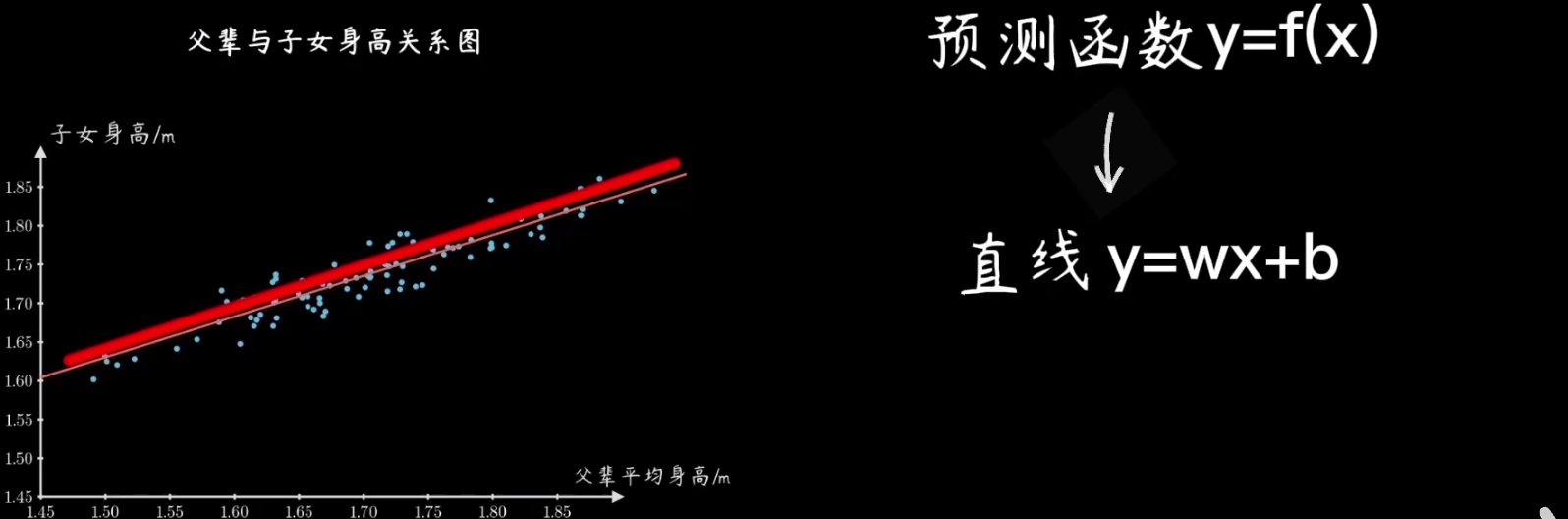

例如下图,我们推测父辈身高与子女身高之间有着某种函数关系,推出出 子女身高y 与父辈升高x的函数 y=wx+b,那个过程叫线性回归,这个函数叫预测函数。

代价函数

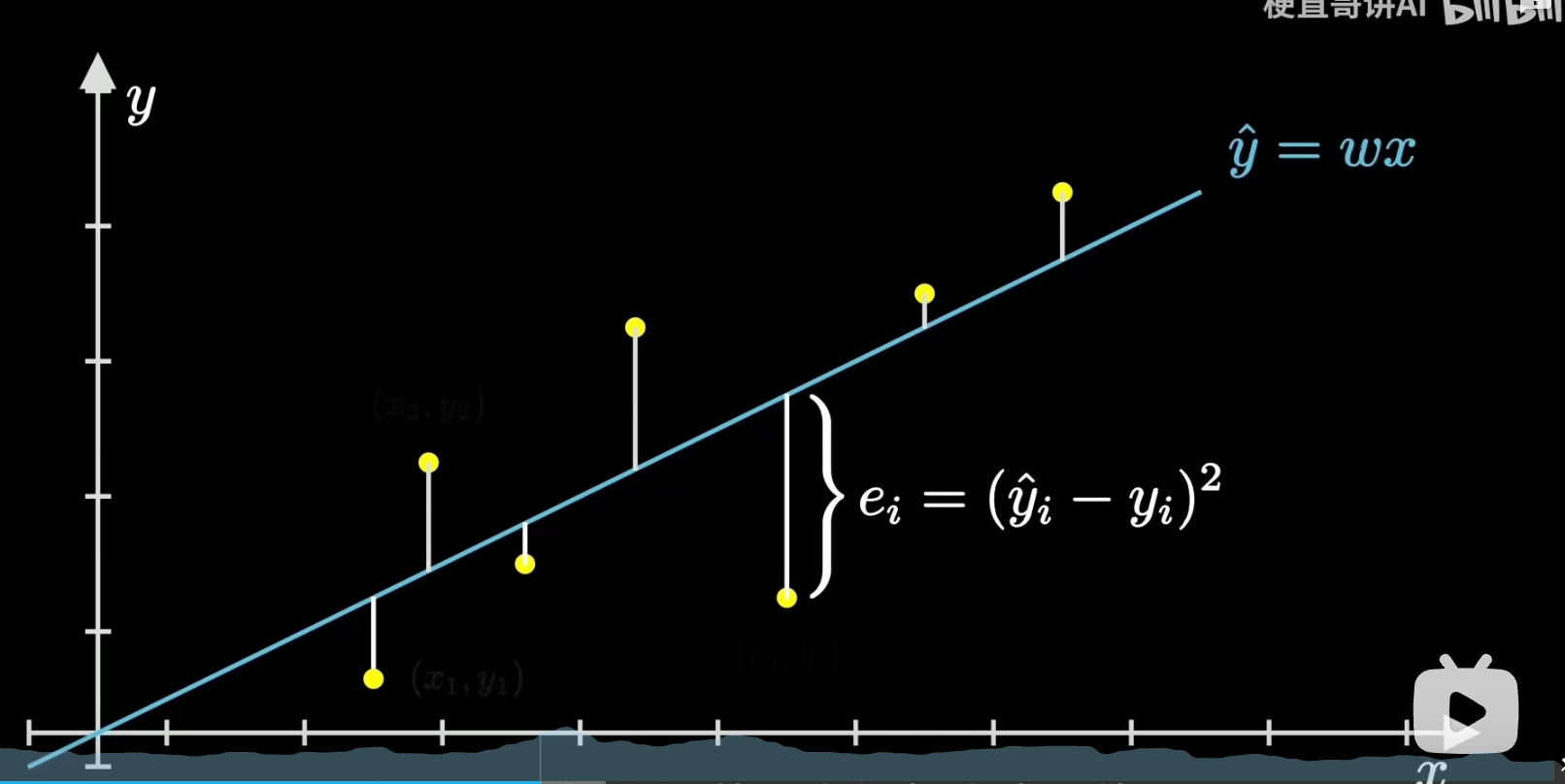

既然是预测函数,那么预测函数跟实际值就会存在差距,误测ei等于实际值-预测值。

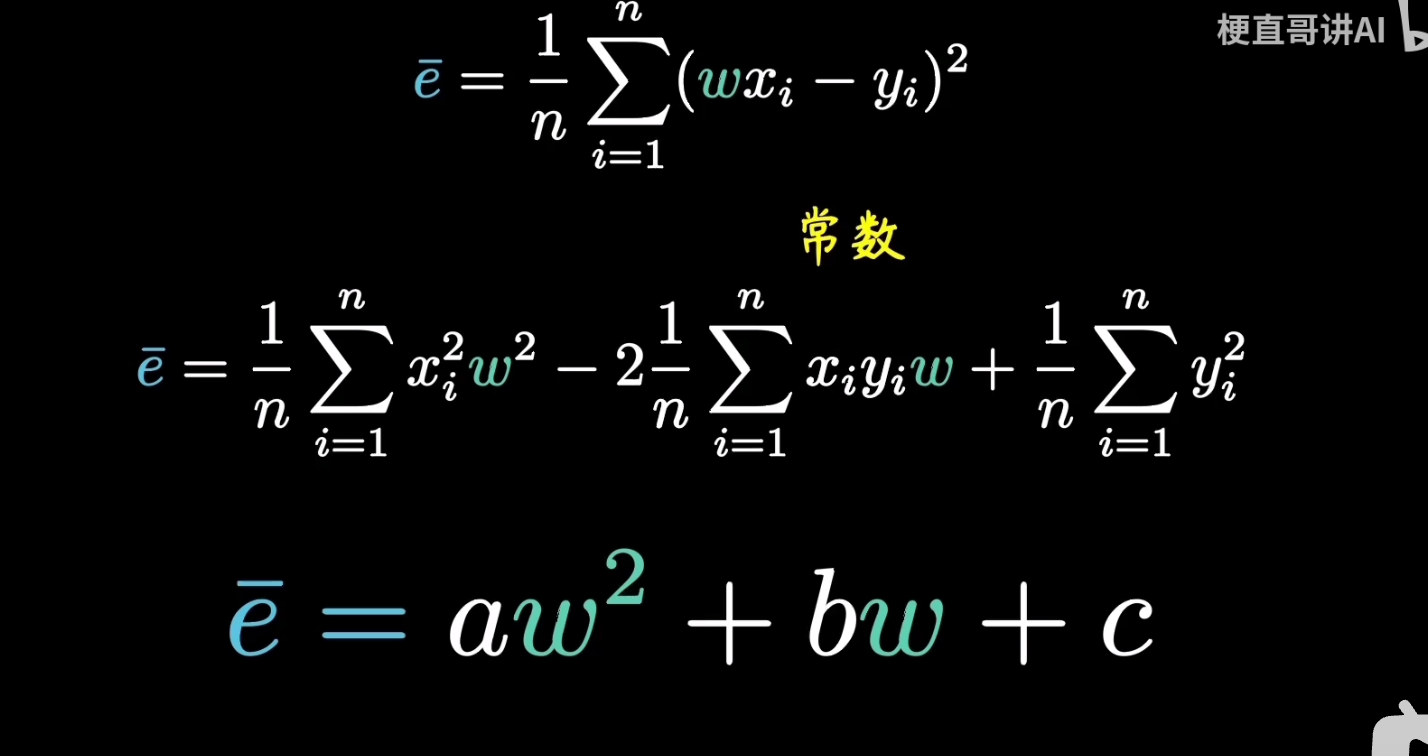

为了放大主要差异和防止正负值相加抵消,我们将等式的两边平方化,然后加起来求平均值。

通过化简我们得到一个关于w的抛物线,当抛物线取得最小值时,就可以得到最小平均误差。

最小平均误差的函数我们称为代价函数。