- 2.1、部署

- 2.2、简单使用

- 2.3、读写流程

- 2.6、与Hive的集成

- 2.7、与Sqoop的集成

- 2.8、与Phoenix集成

- hbase中创建表

create ‘teacher’,’info’,’contact’

#插入数据

put ‘teacher’,’1001’,’info:name’,’Jack’

put ‘teacher’,’1001’,’info:age’,’28’

put ‘teacher’,’1001’,’info:gender’,’male’

put ‘teacher’,’1001’,’contact:address’,’shanghai’

put ‘teacher’,’1001’,’contact:phone’,’13458646987’

put ‘teacher’,’1002’,’info:name’,’Jim’

put ‘teacher’,’1002’,’info:age’,’30’

put ‘teacher’,’1002’,’info:gender’,’male’

put ‘teacher’,’1002’,’contact:address’,’tianjian’

put ‘teacher’,’1002’,’contact:phone’,’13512436987’

#在Phoenix创建映射表

create view “teacher”(

“ROW” varchar primary key,

“contact”.”address” varchar,

“contact”.”phone” varchar,

“info”.”age” varchar,

“info”.”gender” varchar,

“info”.”name” varchar

); - 2.9、数据的备份与恢复

- 2.10、节点的管理

2.1、部署

前提:启动集群Zookeeper,Hadoop中HDFS和Yarn

HBase的解压

[root@bigdata111 software]# tar -zxvf hbase-2.1.9-bin.tar.gz -C /opt/module/

HBase的配置文件

hbase-env.sh修改内容:

export JAVA_HOME=/opt/module/jdk1.8.0_144

export HBASE_MANAGES_ZK=false

注:HBASE_MANAGES_ZK默认为true,也就是使用自身ZK

hbase-site.xml修改内容:

| key | value | 解释 |

|---|---|---|

| hbase.rootdir | hdfs://bigdata111:9000/hbase | hbase在hdfs中的数据地址 |

| hbase.cluster.distributed | true | 是否为分布式集群 |

| hbase.master.port | 16000 | 主节点端口 |

| hbase.zookeeper.quorum | bigdata111:2181….. | 注册节点ZK的集群地址 |

| hbase.zookeeper.property.dataDir | $ZK_HOME/zkdata | zk快照存储位置 |

regionservers:

bigdata111

bigdata112

bigdata113

错误注意:

(1) 针对Apache HBase2.1.9的版本(HBase1.3.1无此问题)

报错信息:Caused by: java.lang.ClassNotFoundException: org.apache.htrace.SamplerBuilder

解决方案:

cp $HBASE_HOME/lib/client-facing-thirdparty/htrace-core-3.1.0-incubating.jar $HBASE_HOME/lib/

拷贝htrace-core-3.1.0-incubating.jar包到当前$HBase_HOME/lib的目录下

(2) HBase1.3.1版本问题

如果使用的是JDK8以上版本,则应在hbase-evn.sh中移除“HBASE_MASTER_OPTS”和“HBASE_REGIONSERVER_OPTS”配置。hbase-env.sh 的45行左右

英文提示:如果使用JDK1.8版本,注释下列两项

Scp到其他节点

[root@bigdata111 module]# scp -r hbase-2.1.9/ bigdata112:pwd

[root@bigdata111 module]# scp -r hbase-2.1.9/ bigdata112:pwd

HBase服务的启动

方式一:单节点启动

$ bin/hbase-daemon.sh start master

$ bin/hbase-daemon.sh start regionserver

方式二:群起

$ bin/start-hbase.sh

$ bin/stop-hbase.sh

查看HBase页面

2.2、简单使用

2.2.1基本操作

l 打开hbase客户端

bin/hbase shell

l 查看hbase帮助命令

hbase(main)> help

l 展示共多少表

hbase(main)> list

l 查看表情况

hbase(main)> desc ‘student’

2.2.2表的操作

1) 创建表

hbase(main)> create ‘student’,’info’

2) 插入数据到表

hbase(main) > put ‘student’,’1001’,’info:name’,’Thomas’

hbase(main) > put ‘student’,’1001’,’info:sex’,’male’

hbase(main) > put ‘student’,’1001’,’info:age’,’18’

hbase(main) > put ‘student’,’1002’,’info:name’,’Janna’

hbase(main) > put ‘student’,’1002’,’info:sex’,’female’

hbase(main) > put ‘student’,’1002’,’info:age’,’20’

3) 扫描查看表数据

#扫描该表所有数据,在公司不要用.数据量太卡会卡死

hbase(main) > scan ‘student’

#扫描该表从哪一行到哪一行

hbase(main) > scan ‘student’,{STARTROW => ‘1001’, STOPROW => ‘1001’}

#扫描从哪行开始

hbase(main) > scan ‘student’,{STARTROW => ‘1001’}

4) 更新指定字段的数据

hbase(main) > put ‘student’,’1001’,’info:name’,’Nick’

hbase(main) > put ‘student’,’1001’,’info:age’,’100’

5) 查看“指定行”或“指定列族:列”的数据

hbase(main) > get ‘student’,’1001’

hbase(main) > get ‘student’,’1001’,’info:name’

6) 删除数据

删除某rowkey的全部数据:

hbase(main) > deleteall ‘student’,’1001’

删除某rowkey的某一列数据:

hbase(main) > delete ‘student’,’1002’,’info:sex’

7)清空表数据

hbase(main) > truncate ‘student’

提示:清空表的操作顺序为先disable,然后再truncating。

8) 删除表

首先需要先让该表为disable状态:

hbase(main) > disable ‘student’

然后才能drop这个表:

hbase(main) > drop ‘student’

提示:如果直接drop表,会报错:Drop the named table. Table must first be disabled

ERROR: Table student is enabled. Disable it first.

9) 统计表数据行数

hbase(main) > count ‘student’

10) 变更表信息

将info列族中的数据存放3个版本:

hbase(main) > alter ‘student’,{NAME=>’info’,VERSIONS=>3}

10) 查询该列中的10个版本

hbase(main):039:0> get ‘student’,’1001’,{COLUMN=>’info:name’,VERSIONS=>10}

2.2.3 其他操作

1) satus 例如:显示服务器状态

hbase> status ‘bigdata111’

2) exist 检查表是否存在,适用于表量特别多的情况

hbase> exists ‘student’

3) is_enabled/is_disabled 检查表是否启用或禁用

hbase> is_enabled ‘student’

hbase> is_disabled ‘student’

4) alter 该命令可以改变表和列族的模式,例如:

为当前表增加列族:

hbase> alter ‘student’, NAME => ‘info2’, VERSIONS => 2

为当前表删除列族:

hbase> alter ‘student’, ‘delete’ => ‘info2’

5) delete

删除一行中一个单元格的值[如果有多版本,则删除最近一个值],例如:

hbase> delete ‘student’, ‘1001’,’info:name’

6) create

创建多个列族:

hbase> create ‘t1’, {NAME => ‘f1’}, {NAME => ‘f2’}, {NAME => ‘f3’}

2.3、读写流程

2.3.1、HBase读数据流程

1) HRegionServer保存着.META.的这样一张表以及表数据,要访问表数据,首先Client先去访问zookeeper,从zookeeper里面获取-ROOT-表所在位置,进而找到.META.表所在的位置信息,即找到这个.META.表在哪个HRegionServer上保存着。

2) 接着Client通过刚才获取到的HRegionServer的IP来访问.META.表所在的HRegionServer,从而读取到.META.,进而获取到.META.表中存放的元数据。

3) Client通过元数据中存储的信息,访问对应的HRegionServer,然后扫描所在HRegionServer的Memstore和Storefile来查询数据。

4) 最后HRegionServer把查询到的数据响应给Client。

2.3.2、HBase写数据流程

1) Client也是先访问zookeeper,找到-ROOT-表,进而找到.META.表,并获取.META.表信息。

2) 确定当前将要写入的数据所对应的RegionServer服务器和Region。

3) Client向该RegionServer服务器发起写入数据请求,然后RegionServer收到请求并响应。

4) Client先把数据写入到HLog,以防止数据丢失。

5) 然后将数据写入到Memstore。

6) 如果Hlog和Memstore均写入成功,则这条数据写入成功。在此过程中,如果Memstore达到阈值,会把Memstore中的数据flush到StoreFile中。

7) 当Storefile越来越多,会触发Compact合并操作,把过多的Storefile合并成一个大的Storefile。当Storefile越来越大,Region也会越来越大,达到阈值后,会触发Split操作,将Region一分为二。

尖叫提示:因为内存空间是有限的,所以说溢写过程必定伴随着大量的小文件产生。

2.6、与Hive的集成

2.6.1、HBase与Hive集成使用

在hive-site.xml中修改zookeeper的属性,如下:

1) 案例一

目标:建立Hive表,关联HBase表,插入数据到Hive表的同时能够影响HBase表。

分步实现:

(1) 在Hive中创建表同时关联HBase

| CREATE TABLE hive_hbase_emp_table( empno int, ename string, job string, mgr int, hiredate string, sal double, comm double, deptno int) STORED BY ‘org.apache.hadoop.hive.hbase.HBaseStorageHandler’ WITH SERDEPROPERTIES (“hbase.columns.mapping” = “:key,info:ename,info:job,info:mgr,info:hiredate,info:sal,info:comm,info:deptno”) TBLPROPERTIES (“hbase.table.name” = “hbase_emp_table”); |

|---|

尖叫提示:完成之后,可以分别进入Hive和HBase查看,都生成了对应的表

(2) 在Hive中创建临时中间表,用于load文件中的数据

尖叫提示:不能将数据直接load进Hive所关联HBase的那张表中

| CREATE TABLE emp( empno int, ename string, job string, mgr int, hiredate string, sal double, comm double, deptno int) row format delimited fields terminated by ‘\t’; |

|---|

(3) 向Hive中间表中load数据

| hive> load data local inpath ‘/home/admin/softwares/data/emp.txt’ into table emp; |

|---|

(4) 通过insert命令将中间表中的数据导入到Hive关联HBase的那张表中

| hive> insert into table hive_hbase_emp_table select * from emp; |

|---|

(5) 查看Hive以及关联的HBase表中是否已经成功的同步插入了数据

Hive:

| hive> select * from hive_hbase_emp_table; |

|---|

HBase:

| hbase> scan ‘hbase_emp_table’ |

|---|

2) 案例二

目标:在HBase中已经存储了某一张表hbase_emp_table,然后在Hive中创建一个外部表来关联HBase中的hbase_emp_table这张表,使之可以借助Hive来分析HBase这张表中的数据。

注:该案例2紧跟案例1的脚步,所以完成此案例前,请先完成案例1。

分步实现:

(1) 在Hive中创建外部表

| CREATE EXTERNAL TABLE relevance_hbase_emp( empno int, ename string, job string, mgr int, hiredate string, sal double, comm double, deptno int) STORED BY ‘org.apache.hadoop.hive.hbase.HBaseStorageHandler’ WITH SERDEPROPERTIES (“hbase.columns.mapping” = “:key,info:ename,info:job,info:mgr,info:hiredate,info:sal,info:comm,info:deptno”) TBLPROPERTIES (“hbase.table.name” = “hbase_emp_table”); |

|---|

(2) 关联后就可以使用Hive函数进行一些分析操作了

| hive (default)> select * from relevance_hbase_emp; |

|---|

2.7、与Sqoop的集成

之前我们已经学习过如何使用Sqoop在Hadoop集群和关系型数据库中进行数据的导入导出工作,接下来我们学习一下利用Sqoop在HBase和RDBMS中进行数据的转储。

注:该案例使用版本可以用hadoop2.8.5, HBase1.3.1,sqoop1.4.6执行.使用HBase2.1.9会报错

报错信息:

org.apache.hadoop.hbase.client.HBaseAdmin.

因为版本不匹配导致

1) 案例

目标:将RDBMS中的数据抽取到HBase中

分步实现:

(1) 配置sqoop-env.sh,添加如下内容:

| export HBASE_HOME=/opt/module/hbase-1.3.1 |

|---|

(2) 在Mysql中新建一个数据库db_library,一张表book

| CREATE DATABASE db_library; CREATE TABLE db_library.book( id int(4) PRIMARY KEY NOT NULL AUTO_INCREMENT, name VARCHAR(255) NOT NULL, price VARCHAR(255) NOT NULL); |

|---|

(3) 向表中插入一些数据

| INSERT INTO db_library.book (name, price) VALUES(‘Lie Sporting’, ‘30’); INSERT INTO db_library.book (name, price) VALUES(‘Pride & Prejudice’, ‘70’); INSERT INTO db_library.book (name, price) VALUES(‘Fall of Giants’, ‘50’); |

|---|

(4) 执行Sqoop导入数据的操作

| $ bin/sqoop import \ —connect jdbc:mysql://bigdata111:3306/db_library \ —username root \ —password 000000 \ —table book \ —columns “id,name,price” \ —column-family “info” \ —hbase-create-table \ —hbase-row-key “id” \ —hbase-table “student” \ —num-mappers 1 \ —split-by id |

|---|

尖叫提示:sqoop1.4.6只支持HBase1.0.1之前的版本的自动创建HBase表的功能

解决方案:手动创建HBase表

| hbase> create ‘student’,’info’ |

|---|

(5) 在HBase中scan这张表得到如下内容

| hbase> scan ‘student’ |

|---|

2.8、与Phoenix集成

1 Phoenix介绍

可以把Phoenix理解为Hbase的查询引擎,phoenix,由saleforce.com开源的一个项目,后又捐给了Apache。它相当于一个Java中间件,帮助开发者,像使用jdbc访问关系型数据库一些,访问NoSql数据库HBase。

phoenix,操作的表及数据,存储在hbase上。phoenix只是需要和Hbase进行表关联起来。然后再用工具进行一些读或写操作。

其实,可以把Phoenix只看成一种代替HBase的语法的一个工具。虽然可以用java可以用jdbc来连接phoenix,然后操作HBase,但是在生产环境中,不可以用在OLTP中。在线事务处理的环境中,需要低延迟,而Phoenix在查询HBase时,虽然做了一些优化,但延迟还是不小。所以依然是用在OLAT中,再将结果返回存储下来。

2 安装配置

解压改名

# tar -zxvf apache-phoenix-5.0.0-HBase-2.0-bin.tar.gz -C /opt/module/

# mv apache-phoenix-5.0.0-HBase-2.0-bin/ phoenix-5.0.0

环境变量vi /etc/profile

#在最后两行加上如下phoenix配置

export PHOENIX_HOME=/opt/module/phoenix-5.0.0

export PATH=$PATH:$PHOENIX_HOME/bin

#使环境变量配置生效

source /etc/profile

拷贝hbase-site.xml(注)三台都要

cp hbase-site.xml /opt/module/phoenix-5.0.0/bin/

将主节点的phoenix包传到从节点

$ scp -r phoenix-5.0.0 root@bigdata113:/opt/module

$ scp -r phoenix-5.0.0 root@bigdata112:/opt/module

拷贝Jar

将如下两个jar包,目录在/opt/module/phoenix-4.14.1下,拷贝到hbase的lib目录,目录在/opt/module/hbase-1.3.1/lib/(注)三台都要

phoenix-5.0.0-HBase-2.0-server.jar

phoenix-core-5.0.0-HBase-2.0.ja

启动Phoenix,启动之前先重启Hbase

sqlline.py bigdata111:2181

基本命令

#展示表

> !table

#创建表

create table test(id integer not null primary key,name varchar);

create table “Andy”(

id integer not null primary key,

name varchar);

#删除表

drop table test;

#插入数据

upsert into test values(1,’Andy’);

upsert into test (id,name) values(2,’toms’);

#查询数据

phoenix > select from test;

hbase > scan ‘test’

#退出phoenix

> !q

#删除数据

delete from test where id=2;

#sum函数的使用

select sum(id) from “Andy”;

#增加一列

alter table “Andy” add address varchar;

*#删除一列

alter table “Andy” drop column address;

其他语法详见:http://phoenix.apache.org/language/index.html

表映射

hbase中创建表

create ‘teacher’,’info’,’contact’

#插入数据

put ‘teacher’,’1001’,’info:name’,’Jack’

put ‘teacher’,’1001’,’info:age’,’28’

put ‘teacher’,’1001’,’info:gender’,’male’

put ‘teacher’,’1001’,’contact:address’,’shanghai’

put ‘teacher’,’1001’,’contact:phone’,’13458646987’

put ‘teacher’,’1002’,’info:name’,’Jim’

put ‘teacher’,’1002’,’info:age’,’30’

put ‘teacher’,’1002’,’info:gender’,’male’

put ‘teacher’,’1002’,’contact:address’,’tianjian’

put ‘teacher’,’1002’,’contact:phone’,’13512436987’

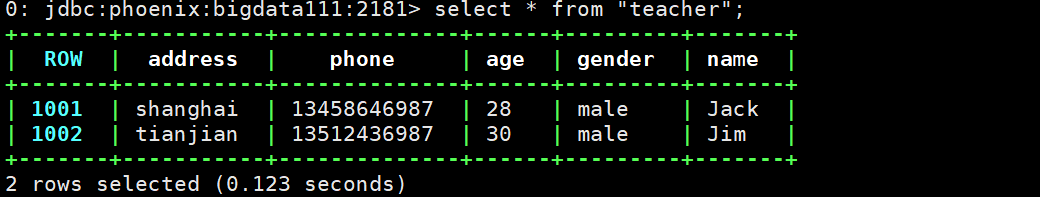

#在Phoenix创建映射表

create view “teacher”(

“ROW” varchar primary key,

“contact”.”address” varchar,

“contact”.”phone” varchar,

“info”.”age” varchar,

“info”.”gender” varchar,

“info”.”name” varchar

);

#注意:如果在出现在Phoenix上查询不到表中数据的情况的话

#可能是因为Phoenix版本的原因造成的编码问题,出现该情况的话,直接在创建映射表的时候在后面添加:column_encoded_bytes=0;

#在Phoenix查找数据[必须加""]

select * from "teacher";

2.9、数据的备份与恢复

2.9.1、备份

停止HBase服务后,使用distcp命令运行MapReduce任务进行备份,将数据备份到另一个地方,可以是同一个集群,也可以是专用的备份集群。

即,把数据转移到当前集群的其他目录下(也可以不在同一个集群中):

| $ bin/hadoop distcp \ hdfs://bigdata111:9000/hbase \ hdfs://bigdata111:9000/HbaseBackup/backup20171009 |

|---|

2.9.2、恢复

非常简单,与备份方法一样,将数据整个移动回来即可。

| $ bin/hadoop distcp \ hdfs://bigdata111:9000/HbaseBackup/backup20170930 \ hdfs://bigdata111:9000/hbase |

|---|

2.10、节点的管理

2.10.1、服役(commissioning)

当启动regionserver时,regionserver会向HMaster注册并开始接收本地数据,开始的时候,新加入的节点不会有任何数据,平衡器开启的情况下,将会有新的region移动到开启的RegionServer上。如果启动和停止进程是使用ssh和HBase脚本,那么会将新添加的节点的主机名加入到conf/regionservers文件中。

2.10.2、退役(decommissioning)

顾名思义,就是从当前HBase集群中删除某个RegionServer,这个过程分为如下几个过程:

1) 停止负载平衡器

| hbase> balance_switch false |

|---|

2) 在退役节点上停止RegionServer

| hbase> hbase-daemon.sh stop regionserver |

|---|

3) RegionServer一旦停止,会关闭维护的所有region

4) Zookeeper上的该RegionServer节点消失

5) Master节点检测到该RegionServer下线,开启平衡器

6) 下线的RegionServer的region服务得到重新分配

该关闭方法比较传统,需要花费一定的时间,而且会造成部分region短暂的不可用。

另一种方案:

1) RegionServer先卸载所管理的region

| $ bin/graceful_stop.sh |

|---|

2) 自动平衡数据

3) 和之前的2~6步是一样的