- 一、HBaes介绍

- 二、HBase部署与使用

- hbase中创建表

create ‘teacher’,’info’,’contact’

#插入数据

put ‘teacher’,’1001’,’info:name’,’Jack’

put ‘teacher’,’1001’,’info:age’,’28’

put ‘teacher’,’1001’,’info:gender’,’male’

put ‘teacher’,’1001’,’contact:address’,’shanghai’

put ‘teacher’,’1001’,’contact:phone’,’13458646987’

put ‘teacher’,’1002’,’info:name’,’Jim’

put ‘teacher’,’1002’,’info:age’,’30’

put ‘teacher’,’1002’,’info:gender’,’male’

put ‘teacher’,’1002’,’contact:address’,’tianjian’

put ‘teacher’,’1002’,’contact:phone’,’13512436987’

#在Phoenix创建映射表

create view “teacher”(

“ROW” varchar primary key,

“contact”.”address” varchar,

“contact”.”phone” varchar,

“info”.”age” varchar,

“info”.”gender” varchar,

“info”.”name” varchar

); - 2.9、数据的备份与恢复

- 2.10、节点的管理

- 三、HBase的优化

- 四、过滤器

- 专用过滤器

- 五、HBase项目

一、HBaes介绍

1.1、HBase概述

HBase是谷歌公司BigTable的开源实现。BigTable是一个分布式存储系统,利用谷歌提出的MapReduce分布式并行计算模型来处理海量数据,使用谷歌分布式文件系统GFS作为底层数据存储,并采用Chubby提供协同服务管理,可以扩展到PB级别的数据和上千台机器,具备广泛应用型、可扩展性、搞性能和高可用性等特点。

BigTable具备以下特点:

- l 支持大规模海量数据;

- l 分布式并发数据处理效率极高;

- l 易于扩展且支持动态伸缩;

- l 适用于廉价设备;

- l 适合于读操作不适合写操作。

1.2、和传统关系型数据库的区别

· 数据类型。

关系数据库采用关系模型,具有丰富的数据类型和存储方式。HBase则采用了更加简单的数据模型,它把数据存储为未经解释的字符串,用户可以把不同格式的数据化数据和非结构化数据都序列化成字符串保存到HBase中,用户需要自己编写程序把字符串解析成不同的数据类型。

· 数据操作。

关系数据库中包含了丰富的操作,如:增、删、改、查等,其中会涉及复杂的多表连接,通常是借助于多个表之间的主外键关联来实现的。HBase操作则不存在复杂的表与表之间的关系,只有简单的插入、查询、删除和清空等。因为HBase在设计上就避免了复杂的表与表之间的关系,通常只采用单表的主键查询,所以它无法实现向关系数据库中那样的表与表之间的连接操作。

· 存储模式。

关系数据库是基于行模式存储的,元组或行会被连续地存储在磁盘页中。HBase是基于列存储的,每个列族都由几个文件保存,不同列族的文件是分离的。其优点是可以降低I/O开销,支持大量并发用户查询。因为仅需要处理可以回答这些查询的列,而不需要处理与查询无关的大量数据行;同一个列族中的数据会被一起进行压缩,由于同一列族内的数据相似度较高,因此可以获得较高的数据压缩比。

· 数据索引。

关系数据库通常可以针对不同列构建复杂的多个索引,以提高数据访问性能。HBase只有一个索引–>行键(RowKey),HBase中的所有访问方法,或者通过行键访问,或者通过行键扫描,从而使得整个系统不会慢下来。由于HBase位于Hadoop框架之上,因此可以使用Hadoop MapReduce来快速、高效地生成索引表。

· 数据维护

在关系数据库中,更新操作会用最新的当前值去替换记录中原来的旧值,旧值被覆盖后就不会存在。而HBase中执行更新操作时,并不会删除数据旧的版本,而是生成一个新的版本,旧的版本任然保留。

· 可伸缩性。

关系数据库很难实现横向扩展,纵向扩展的空间也比较有限。相反,HBase和BigTable这些分布式数据库就是为了实现灵活的水平扩展而开发的,因此能够轻易地通过在集群中增加或者减少硬件数量来实现性能的伸缩。

· 其他

相对于关系型数据库来说,HBase也有自身的局限性,如HBase不支持事务,因此无法实现跨行的原子性。

1.3 HBase应用场景

l 交通方面:船舶GPS信息,全长江的船舶GPS信息,每天有1千万左右的数据存储。

l 金融方面:消费信息,贷款信息,信用卡还款信息等

l 电商:淘宝的交易信息等,物流信息,浏览信息等

l 移动:通话信息等,都是基于HBase的存储。

1.4 HBase的特点:

1. 容量大:传统关系型数据库,单表不会超过五百万,超过要做分表分库,不会超过30列HBase单表可以有百亿行、百万列,数据矩阵横向和纵向两个维度所支持的数据量级都非常具有弹性

2. **面向列:面向列的存储和权限控制,并支持独立检索,可以动态增加列,即,可单独对列进行各方面的操作列式存储,其数据在表中是按照某列存储的,这样在查询只需要少数几个字段的时候,能大大减少读取的数量

3. **多版本:Hbase的每一个列的数据存储有多个Version,比如住址列,可能有多个变更,所以该列可以有多个version

4. **稀疏性:为空的列并不占用存储空间,表可以设计的非常稀疏。

不必像关系型数据库那样需要预先知道所有列名然后再进行null填充

5. **拓展性:底层依赖HDFS,当磁盘空间不足的时候,只需要动态增加datanode节点服务(机器)就可以

6. **高可靠性:WAL机制,保证数据写入的时候不会因为集群异常而导致写入数据丢失Replication机制,保证了在集群出现严重的问题时候,数据不会发生丢失或者损坏Hbase底层使用HDFS,本身也有备份。

7.**高性能:底层的LSM数据结构和RowKey有序排列等架构上的独特设计,使得Hbase写入性能非常高。Region切分、主键索引、缓存机制使得Hbase在海量数据下具备一定的随机读取性能,该性能针对Rowkey的查询能够到达毫秒级别

LSM树,树形结构,最末端的子节点是以内存的方式进行存储的,内存中的小树会flush到磁盘中(当子节点达到一定阈值以后,会放到磁盘中,且存入的过程会进行实时merge成一个主节点,然后磁盘中的树定期会做merge操作,合并成一棵大树,以优化读性能。)LSM树的介绍:https://www.cnblogs.com/yanghuahui/p/3483754.html

1.5 HBase的角色

1.5.1、HMaster

功能:

1) 监控RegionServer

2) 处理RegionServer故障转移

3) 处理元数据的变更

4) 处理region的分配或移除

5) 在空闲时间进行数据的负载均衡

6) 通过Zookeeper发布自己的位置给客户端

1.5.2、RegionServer

功能:

1) 负责存储HBase的实际数据

2) 处理分配给它的Region

3) 刷新缓存到HDFS

4) 维护HLog

5) 执行压缩

6) 负责处理Region分片

组件:

1) Write-Ahead logs

HBase的修改记录,当对HBase读写数据的时候,数据不是直接写进磁盘,它会在内存中保留一段时间(时间以及数据量阈值

可以设定)。但把数据保存在内存中可能有更高的概率引起数据丢失,为了解决这个问题,数据会先写在一个叫做Write-Ahead logfile的文件中,然后再写入内存中。所以在系统出现故障的时候,数据可以通过这个日志文件重建。

2) HFile

这是在磁盘上保存原始数据的实际的物理文件,是实际的存储文件。

3) Store

HFile存储在Store中,一个Store对应HBase表中的一个列族。

4) MemStore

顾名思义,就是内存存储,位于内存中,用来保存当前的数据操作,所以当数据保存在WAL中之后,RegsionServer会在内存中存储键值对。

5) Region

Hbase表的分片,HBase表会根据RowKey值被切分成不同的region存储在RegionServer中,在一个RegionServer中可以有多个不同的region。

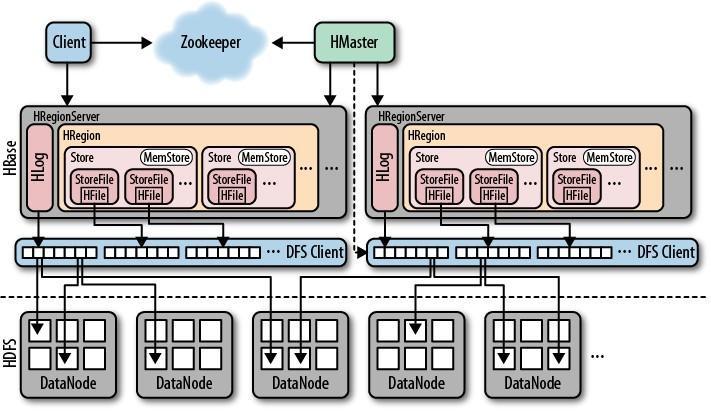

1.6 HBase的架构

HBase内置有Zookeeper,但一般我们会有其他的Zookeeper集群来监管master和regionserver,Zookeeper通过选举,保证任何时候,集群中只有一个活跃的HMaster,HMaster与HRegionServer 启动时会向ZooKeeper注册,存储所有HRegion的寻址入口,实时监控HRegionserver的上线和下线信息。并实时通知给HMaster,存储HBase的schema和table元数据,默认情况下,HBase 管理ZooKeeper 实例,Zookeeper的引入使得HMaster不再是单点故障。一般情况下会启动两个HMaster,非Active的HMaster会定期的和Active HMaster通信以获取其最新状态,从而保证它是实时更新的,因而如果启动了多个HMaster反而增加了Active HMaster的负担。

一个RegionServer可以包含多个HRegion,每个RegionServer维护一个HLog,和多个HFiles以及其对应的MemStore。RegionServer运行于DataNode上,数量可以与DatNode数量一致,请参考如下架构图:

1.7数据模型

| Rowkey | timestamp | info | |||

|---|---|---|---|---|---|

| name | sex | age | |||

| 1001 | version1 | Thomas | male | 18 | |

| version2 | |||||

| 1002 | 多个时间戳 | Janna | female | 20 |

确定一个单元格的位置(cell),需要如下四个

rowkey + Colume Family + Colume + timestamp(版本version),数据有版本的概念,即一个单元格可能有多个值,但是只有最新得一个对外显示。

l HBase中有两张特殊的Table,-ROOT-和.META.

l .META.:记录了用户表的Region信息,.META.可以有多个region

l -ROOT-:记录了.META.表的Region信息,-ROOT-只有一个region

l Zookeeper中记录了-ROOT-表的location

l Client访问用户数据之前需要首先访问zookeeper,然后访问-ROOT-表,接着访问.META.表,最后才能找到用户数据的位置去访问,中间需要多次网络操作,不过client端会做cache缓存,注意:在0.96版本后,Hbase移除了-ROOT-表

二、HBase部署与使用

2.1、部署

前提:启动集群Zookeeper,Hadoop中HDFS和Yarn

HBase的解压

[root@bigdata111 software]# tar -zxvf hbase-2.1.9-bin.tar.gz -C /opt/module/

HBase的配置文件

hbase-env.sh修改内容:

export JAVA_HOME=/opt/module/jdk1.8.0_144

export HBASE_MANAGES_ZK=false

注:HBASE_MANAGES_ZK默认为true,也就是使用自身ZK

hbase-site.xml修改内容:

| key | value | 解释 |

|---|---|---|

| hbase.rootdir | hdfs://bigdata111:9000/hbase | hbase在hdfs中的数据地址 |

| hbase.cluster.distributed | true | 是否为分布式集群 |

| hbase.master.port | 16000 | 主节点端口 |

| hbase.zookeeper.quorum | bigdata111:2181….. | 注册节点ZK的集群地址 |

| hbase.zookeeper.property.dataDir | $ZK_HOME/zkdata | zk快照存储位置 |

regionservers:

bigdata111

bigdata112

bigdata113

错误注意:

(1) 针对Apache HBase2.1.9的版本(HBase1.3.1无此问题)

报错信息:Caused by: java.lang.ClassNotFoundException: org.apache.htrace.SamplerBuilder

解决方案:

cp $HBASE_HOME/lib/client-facing-thirdparty/htrace-core-3.1.0-incubating.jar $HBASE_HOME/lib/

拷贝htrace-core-3.1.0-incubating.jar包到当前$HBase_HOME/lib的目录下

(2) HBase1.3.1版本问题

如果使用的是JDK8以上版本,则应在hbase-evn.sh中移除“HBASE_MASTER_OPTS”和“HBASE_REGIONSERVER_OPTS”配置。hbase-env.sh 的45行左右

英文提示:如果使用JDK1.8版本,注释下列两项

Scp到其他节点

[root@bigdata111 module]# scp -r hbase-2.1.9/ bigdata112:pwd

[root@bigdata111 module]# scp -r hbase-2.1.9/ bigdata112:pwd

HBase服务的启动

方式一:单节点启动

$ bin/hbase-daemon.sh start master

$ bin/hbase-daemon.sh start regionserver

方式二:群起

$ bin/start-hbase.sh

$ bin/stop-hbase.sh

查看HBase页面

2.2、简单使用

2.2.1基本操作

l 打开hbase客户端

bin/hbase shell

l 查看hbase帮助命令

hbase(main)> help

l 展示共多少表

hbase(main)> list

l 查看表情况

hbase(main)> desc ‘student’

2.2.2表的操作

1) 创建表

hbase(main)> create ‘student’,’info’

2) 插入数据到表

hbase(main) > put ‘student’,’1001’,’info:name’,’Thomas’

hbase(main) > put ‘student’,’1001’,’info:sex’,’male’

hbase(main) > put ‘student’,’1001’,’info:age’,’18’

hbase(main) > put ‘student’,’1002’,’info:name’,’Janna’

hbase(main) > put ‘student’,’1002’,’info:sex’,’female’

hbase(main) > put ‘student’,’1002’,’info:age’,’20’

3) 扫描查看表数据

#扫描该表所有数据,在公司不要用.数据量太卡会卡死

hbase(main) > scan ‘student’

#扫描该表从哪一行到哪一行

hbase(main) > scan ‘student’,{STARTROW => ‘1001’, STOPROW => ‘1001’}

#扫描从哪行开始

hbase(main) > scan ‘student’,{STARTROW => ‘1001’}

4) 更新指定字段的数据

hbase(main) > put ‘student’,’1001’,’info:name’,’Nick’

hbase(main) > put ‘student’,’1001’,’info:age’,’100’

5) 查看“指定行”或“指定列族:列”的数据

hbase(main) > get ‘student’,’1001’

hbase(main) > get ‘student’,’1001’,’info:name’

6) 删除数据

删除某rowkey的全部数据:

hbase(main) > deleteall ‘student’,’1001’

删除某rowkey的某一列数据:

hbase(main) > delete ‘student’,’1002’,’info:sex’

7)清空表数据

hbase(main) > truncate ‘student’

提示:清空表的操作顺序为先disable,然后再truncating。

8) 删除表

首先需要先让该表为disable状态:

hbase(main) > disable ‘student’

然后才能drop这个表:

hbase(main) > drop ‘student’

提示:如果直接drop表,会报错:Drop the named table. Table must first be disabled

ERROR: Table student is enabled. Disable it first.

9) 统计表数据行数

hbase(main) > count ‘student’

10) 变更表信息

将info列族中的数据存放3个版本:

hbase(main) > alter ‘student’,{NAME=>’info’,VERSIONS=>3}

10) 查询该列中的10个版本

hbase(main):039:0> get ‘student’,’1001’,{COLUMN=>’info:name’,VERSIONS=>10}

2.2.3 其他操作

1) satus 例如:显示服务器状态

hbase> status ‘bigdata111’

2) exist 检查表是否存在,适用于表量特别多的情况

hbase> exists ‘student’

3) is_enabled/is_disabled 检查表是否启用或禁用

hbase> is_enabled ‘student’

hbase> is_disabled ‘student’

4) alter 该命令可以改变表和列族的模式,例如:

为当前表增加列族:

hbase> alter ‘student’, NAME => ‘info2’, VERSIONS => 2

为当前表删除列族:

hbase> alter ‘student’, ‘delete’ => ‘info2’

5) delete

删除一行中一个单元格的值[如果有多版本,则删除最近一个值],例如:

hbase> delete ‘student’, ‘1001’,’info:name’

6) create

创建多个列族:

hbase> create ‘t1’, {NAME => ‘f1’}, {NAME => ‘f2’}, {NAME => ‘f3’}

2.3、读写流程

2.3.1、HBase读数据流程

1) HRegionServer保存着.META.的这样一张表以及表数据,要访问表数据,首先Client先去访问zookeeper,从zookeeper里面获取-ROOT-表所在位置,进而找到.META.表所在的位置信息,即找到这个.META.表在哪个HRegionServer上保存着。

2) 接着Client通过刚才获取到的HRegionServer的IP来访问.META.表所在的HRegionServer,从而读取到.META.,进而获取到.META.表中存放的元数据。

3) Client通过元数据中存储的信息,访问对应的HRegionServer,然后扫描所在HRegionServer的Memstore和Storefile来查询数据。

4) 最后HRegionServer把查询到的数据响应给Client。

2.3.2、HBase写数据流程

1) Client也是先访问zookeeper,找到-ROOT-表,进而找到.META.表,并获取.META.表信息。

2) 确定当前将要写入的数据所对应的RegionServer服务器和Region。

3) Client向该RegionServer服务器发起写入数据请求,然后RegionServer收到请求并响应。

4) Client先把数据写入到HLog,以防止数据丢失。

5) 然后将数据写入到Memstore。

6) 如果Hlog和Memstore均写入成功,则这条数据写入成功。在此过程中,如果Memstore达到阈值,会把Memstore中的数据flush到StoreFile中。

7) 当Storefile越来越多,会触发Compact合并操作,把过多的Storefile合并成一个大的Storefile。当Storefile越来越大,Region也会越来越大,达到阈值后,会触发Split操作,将Region一分为二。

尖叫提示:因为内存空间是有限的,所以说溢写过程必定伴随着大量的小文件产生。

2.6、与Hive的集成

2.6.1、HBase与Hive集成使用

在hive-site.xml中修改zookeeper的属性,如下:

1) 案例一

目标:建立Hive表,关联HBase表,插入数据到Hive表的同时能够影响HBase表。

分步实现:

(1) 在Hive中创建表同时关联HBase

| CREATE TABLE hive_hbase_emp_table( empno int, ename string, job string, mgr int, hiredate string, sal double, comm double, deptno int) STORED BY ‘org.apache.hadoop.hive.hbase.HBaseStorageHandler’ WITH SERDEPROPERTIES (“hbase.columns.mapping” = “:key,info:ename,info:job,info:mgr,info:hiredate,info:sal,info:comm,info:deptno”) TBLPROPERTIES (“hbase.table.name” = “hbase_emp_table”); |

|---|

尖叫提示:完成之后,可以分别进入Hive和HBase查看,都生成了对应的表

(2) 在Hive中创建临时中间表,用于load文件中的数据

尖叫提示:不能将数据直接load进Hive所关联HBase的那张表中

| CREATE TABLE emp( empno int, ename string, job string, mgr int, hiredate string, sal double, comm double, deptno int) row format delimited fields terminated by ‘\t’; |

|---|

(3) 向Hive中间表中load数据

| hive> load data local inpath ‘/home/admin/softwares/data/emp.txt’ into table emp; |

|---|

(4) 通过insert命令将中间表中的数据导入到Hive关联HBase的那张表中

| hive> insert into table hive_hbase_emp_table select * from emp; |

|---|

(5) 查看Hive以及关联的HBase表中是否已经成功的同步插入了数据

Hive:

| hive> select * from hive_hbase_emp_table; |

|---|

HBase:

| hbase> scan ‘hbase_emp_table’ |

|---|

2) 案例二

目标:在HBase中已经存储了某一张表hbase_emp_table,然后在Hive中创建一个外部表来关联HBase中的hbase_emp_table这张表,使之可以借助Hive来分析HBase这张表中的数据。

注:该案例2紧跟案例1的脚步,所以完成此案例前,请先完成案例1。

分步实现:

(1) 在Hive中创建外部表

| CREATE EXTERNAL TABLE relevance_hbase_emp( empno int, ename string, job string, mgr int, hiredate string, sal double, comm double, deptno int) STORED BY ‘org.apache.hadoop.hive.hbase.HBaseStorageHandler’ WITH SERDEPROPERTIES (“hbase.columns.mapping” = “:key,info:ename,info:job,info:mgr,info:hiredate,info:sal,info:comm,info:deptno”) TBLPROPERTIES (“hbase.table.name” = “hbase_emp_table”); |

|---|

(2) 关联后就可以使用Hive函数进行一些分析操作了

| hive (default)> select * from relevance_hbase_emp; |

|---|

2.7、与Sqoop的集成

之前我们已经学习过如何使用Sqoop在Hadoop集群和关系型数据库中进行数据的导入导出工作,接下来我们学习一下利用Sqoop在HBase和RDBMS中进行数据的转储。

注:该案例使用版本可以用hadoop2.8.5, HBase1.3.1,sqoop1.4.6执行.使用HBase2.1.9会报错

报错信息:

org.apache.hadoop.hbase.client.HBaseAdmin.

因为版本不匹配导致

1) 案例

目标:将RDBMS中的数据抽取到HBase中

分步实现:

(1) 配置sqoop-env.sh,添加如下内容:

| export HBASE_HOME=/opt/module/hbase-1.3.1 |

|---|

(2) 在Mysql中新建一个数据库db_library,一张表book

| CREATE DATABASE db_library; CREATE TABLE db_library.book( id int(4) PRIMARY KEY NOT NULL AUTO_INCREMENT, name VARCHAR(255) NOT NULL, price VARCHAR(255) NOT NULL); |

|---|

(3) 向表中插入一些数据

| INSERT INTO db_library.book (name, price) VALUES(‘Lie Sporting’, ‘30’); INSERT INTO db_library.book (name, price) VALUES(‘Pride & Prejudice’, ‘70’); INSERT INTO db_library.book (name, price) VALUES(‘Fall of Giants’, ‘50’); |

|---|

(4) 执行Sqoop导入数据的操作

| $ bin/sqoop import \ —connect jdbc:mysql://bigdata111:3306/db_library \ —username root \ —password 000000 \ —table book \ —columns “id,name,price” \ —column-family “info” \ —hbase-create-table \ —hbase-row-key “id” \ —hbase-table “student” \ —num-mappers 1 \ —split-by id |

|---|

尖叫提示:sqoop1.4.6只支持HBase1.0.1之前的版本的自动创建HBase表的功能

解决方案:手动创建HBase表

| hbase> create ‘student’,’info’ |

|---|

(5) 在HBase中scan这张表得到如下内容

| hbase> scan ‘student’ |

|---|

2.8、与Phoenix集成

1 Phoenix介绍

可以把Phoenix理解为Hbase的查询引擎,phoenix,由saleforce.com开源的一个项目,后又捐给了Apache。它相当于一个Java中间件,帮助开发者,像使用jdbc访问关系型数据库一些,访问NoSql数据库HBase。

phoenix,操作的表及数据,存储在hbase上。phoenix只是需要和Hbase进行表关联起来。然后再用工具进行一些读或写操作。

其实,可以把Phoenix只看成一种代替HBase的语法的一个工具。虽然可以用java可以用jdbc来连接phoenix,然后操作HBase,但是在生产环境中,不可以用在OLTP中。在线事务处理的环境中,需要低延迟,而Phoenix在查询HBase时,虽然做了一些优化,但延迟还是不小。所以依然是用在OLAT中,再将结果返回存储下来。

2 安装配置

解压改名

# tar -zxvf apache-phoenix-5.0.0-HBase-2.0-bin.tar.gz -C /opt/module/

# mv apache-phoenix-5.0.0-HBase-2.0-bin/ phoenix-5.0.0

环境变量vi /etc/profile

#在最后两行加上如下phoenix配置

export PHOENIX_HOME=/opt/module/phoenix-5.0.0

export PATH=$PATH:$PHOENIX_HOME/bin

#使环境变量配置生效

source /etc/profile

拷贝hbase-site.xml(注)三台都要

cp hbase-site.xml /opt/module/phoenix-5.0.0/bin/

将主节点的phoenix包传到从节点

$ scp -r phoenix-5.0.0 root@bigdata113:/opt/module

$ scp -r phoenix-5.0.0 root@bigdata112:/opt/module

拷贝Jar

将如下两个jar包,目录在/opt/module/phoenix-4.14.1下,拷贝到hbase的lib目录,目录在/opt/module/hbase-1.3.1/lib/(注)三台都要

phoenix-5.0.0-HBase-2.0-server.jar

phoenix-core-5.0.0-HBase-2.0.ja

启动Phoenix,启动之前先重启Hbase

sqlline.py bigdata111:2181

基本命令

#展示表

> !table

#创建表

create table test(id integer not null primary key,name varchar);

create table “Andy”(

id integer not null primary key,

name varchar);

#删除表

drop table test;

#插入数据

upsert into test values(1,’Andy’);

upsert into test (id,name) values(2,’toms’);

#查询数据

phoenix > select from test;

hbase > scan ‘test’

#退出phoenix

> !q

#删除数据

delete from test where id=2;

#sum函数的使用

select sum(id) from “Andy”;

#增加一列

alter table “Andy” add address varchar;

*#删除一列

alter table “Andy” drop column address;

其他语法详见:http://phoenix.apache.org/language/index.html

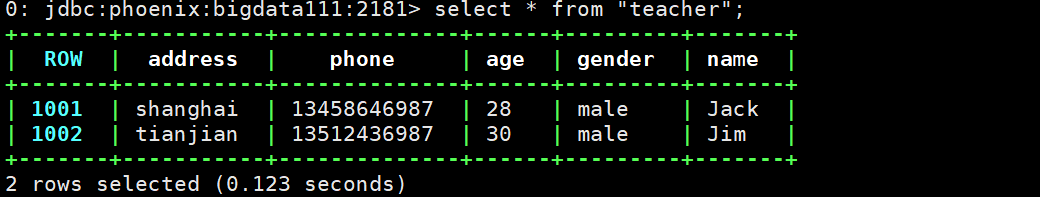

表映射

hbase中创建表

create ‘teacher’,’info’,’contact’

#插入数据

put ‘teacher’,’1001’,’info:name’,’Jack’

put ‘teacher’,’1001’,’info:age’,’28’

put ‘teacher’,’1001’,’info:gender’,’male’

put ‘teacher’,’1001’,’contact:address’,’shanghai’

put ‘teacher’,’1001’,’contact:phone’,’13458646987’

put ‘teacher’,’1002’,’info:name’,’Jim’

put ‘teacher’,’1002’,’info:age’,’30’

put ‘teacher’,’1002’,’info:gender’,’male’

put ‘teacher’,’1002’,’contact:address’,’tianjian’

put ‘teacher’,’1002’,’contact:phone’,’13512436987’

#在Phoenix创建映射表

create view “teacher”(

“ROW” varchar primary key,

“contact”.”address” varchar,

“contact”.”phone” varchar,

“info”.”age” varchar,

“info”.”gender” varchar,

“info”.”name” varchar

);

#注意:如果在出现在Phoenix上查询不到表中数据的情况的话

#可能是因为Phoenix版本的原因造成的编码问题,出现该情况的话,直接在创建映射表的时候在后面添加:column_encoded_bytes=0;

#在Phoenix查找数据[必须加""]

select * from "teacher";

2.9、数据的备份与恢复

2.9.1、备份

停止HBase服务后,使用distcp命令运行MapReduce任务进行备份,将数据备份到另一个地方,可以是同一个集群,也可以是专用的备份集群。

即,把数据转移到当前集群的其他目录下(也可以不在同一个集群中):

| $ bin/hadoop distcp \ hdfs://bigdata111:9000/hbase \ hdfs://bigdata111:9000/HbaseBackup/backup20171009 |

|---|

2.9.2、恢复

非常简单,与备份方法一样,将数据整个移动回来即可。

| $ bin/hadoop distcp \ hdfs://bigdata111:9000/HbaseBackup/backup20170930 \ hdfs://bigdata111:9000/hbase |

|---|

2.10、节点的管理

2.10.1、服役(commissioning)

当启动regionserver时,regionserver会向HMaster注册并开始接收本地数据,开始的时候,新加入的节点不会有任何数据,平衡器开启的情况下,将会有新的region移动到开启的RegionServer上。如果启动和停止进程是使用ssh和HBase脚本,那么会将新添加的节点的主机名加入到conf/regionservers文件中。

2.10.2、退役(decommissioning)

顾名思义,就是从当前HBase集群中删除某个RegionServer,这个过程分为如下几个过程:

1) 停止负载平衡器

| hbase> balance_switch false |

|---|

2) 在退役节点上停止RegionServer

| hbase> hbase-daemon.sh stop regionserver |

|---|

3) RegionServer一旦停止,会关闭维护的所有region

4) Zookeeper上的该RegionServer节点消失

5) Master节点检测到该RegionServer下线,开启平衡器

6) 下线的RegionServer的region服务得到重新分配

该关闭方法比较传统,需要花费一定的时间,而且会造成部分region短暂的不可用。

另一种方案:

1) RegionServer先卸载所管理的region

| $ bin/graceful_stop.sh |

|---|

三、HBase的优化

3.1、高可用

在HBase中Hmaster负责监控RegionServer的生命周期,均衡RegionServer的负载,如果Hmaster挂掉了,那么整个HBase集群将陷入不健康的状态,并且此时的工作状态并不会维持太久。所以HBase支持对Hmaster的高可用配置。

1) 关闭HBase集群(如果没有开启则跳过此步)

| $ bin/stop-hbase.sh |

|---|

2) 在conf目录下创建backup-masters文件

| $ touch conf/backup-masters |

|---|

3) 在backup-masters文件中配置高可用HMaster节点

| $ echo bigdata112 > conf/backup-masters |

|---|

4) 将整个conf目录scp到其他节点

$ [root@bigdata111 conf]# scp backup-masters bigdata112:pwd$ [root@bigdata111 conf]# scp backup-masters bigdata113: pwd |

|---|

5) 重新启动HBase后打开页面测试查看

| 0.98版本之前:http://bigdata111:60010 0.98版本之后:http://bigdata111:16010 |

|---|

3.2、Hadoop的通用性优化

1) NameNode元数据备份使用SSD

2) 定时备份NameNode上的元数据

每小时或者每天备份,如果数据极其重要,可以5~10分钟备份一次。备份可以通过定时任务复制元数据目录即可。

3) 为NameNode指定多个元数据目录

使用dfs.name.dir或者dfs.namenode.name.dir指定。这样可以提供元数据的冗余和健壮性,以免发生故障。

4) NameNode的dir自恢复

设置dfs.namenode.name.dir.restore为true,允许尝试恢复之前失败的dfs.namenode.name.dir目录,在创建checkpoint时做此尝试,如果设置了多个磁盘,建议允许。

5) HDFS保证RPC调用会有较多的线程数

hdfs-site.xml

| 属性:dfs.namenode.handler.count 解释:该属性是NameNode服务默认线程数,的默认值是10,根据机器的可用内存可以调整为50~100 属性:dfs.datanode.handler.count 解释:该属性默认值为10,是DataNode的处理线程数,如果HDFS客户端程序读写请求比较多,可以调高到15~20,设置的值越大,内存消耗越多,不要调整的过高,一般业务中,5~10即可。 |

|---|

6) HDFS副本数的调整

hdfs-site.xml

| 属性:dfs.replication 解释:如果数据量巨大,且不是非常之重要,可以调整为2~3,如果数据非常之重要,可以调整为3~5。 |

|---|

7) HDFS文件块大小的调整

hdfs-site.xml

| 属性:dfs.blocksize 解释:块大小定义,该属性应该根据存储的大量的单个文件大小来设置,如果大量的单个文件都小于100M,建议设置成64M块大小,对于大于100M或者达到GB的这种情况,建议设置成256M,一般设置范围波动在64M~256M之间。 |

|---|

8) MapReduce Job任务服务线程数调整

mapred-site.xml

| 属性:mapreduce.jobtracker.handler.count 解释:该属性是Job任务线程数,默认值是10,根据机器的可用内存可以调整为50~100 |

|---|

9) Http服务器工作线程数

mapred-site.xml

| 属性:mapreduce.tasktracker.http.threads 解释:定义HTTP服务器工作线程数,默认值为40,对于大集群可以调整到80~100 |

|---|

10) 文件排序合并优化

mapred-site.xml

| 属性:mapreduce.task.io.sort.factor 解释:文件排序时同时合并的数据流的数量,这也定义了同时打开文件的个数,默认值为10,如果调高该参数,可以明显减少磁盘IO,即减少文件读取的次数。 |

|---|

11) 设置任务并发

mapred-site.xml

| 属性:mapreduce.map.speculative 解释:该属性可以设置任务是否可以并发执行,如果任务多而小,该属性设置为true可以明显加快任务执行效率,但是对于延迟非常高的任务,建议改为false,这就类似于迅雷下载。 |

|---|

12) MR输出数据的压缩

mapred-site.xml

| 属性:mapreduce.map.output.compress、mapreduce.output.fileoutputformat.compress 解释:对于大集群而言,建议设置Map-Reduce的输出为压缩的数据,而对于小集群,则不需要。 |

|---|

13) 优化Mapper和Reducer的个数

mapred-site.xml

| 属性: mapreduce.tasktracker.map.tasks.maximum mapreduce.tasktracker.reduce.tasks.maximum 解释:以上两个属性分别为一个单独的Job任务可以同时运行的Map和Reduce的数量。 设置上面两个参数时,需要考虑CPU核数、磁盘和内存容量。假设一个8核的CPU,业务内容非常消耗CPU,那么可以设置map数量为4,如果该业务不是特别消耗CPU类型的,那么可以设置map数量为40,reduce数量为20。这些参数的值修改完成之后,一定要观察是否有较长等待的任务,如果有的话,可以减少数量以加快任务执行,如果设置一个很大的值,会引起大量的上下文切换,以及内存与磁盘之间的数据交换,这里没有标准的配置数值,需要根据业务和硬件配置以及经验来做出选择。 在同一时刻,不要同时运行太多的MapReduce,这样会消耗过多的内存,任务会执行的非常缓慢,我们需要根据CPU核数,内存容量设置一个MR任务并发的最大值,使固定数据量的任务完全加载到内存中,避免频繁的内存和磁盘数据交换,从而降低磁盘IO,提高性能。 |

|---|

大概估算公式:

map = 2 + ⅔cpu_core

reduce = 2 + ⅓cpu_core

3.3、Linux优化

1) 开启文件系统的预读缓存可以提高读取速度

| $ sudo blockdev —setra 32768 /dev/sda |

|---|

尖叫提示:ra是readahead的缩写

2) 关闭进程睡眠池

即不允许后台进程进入睡眠状态,如果进程空闲,则直接kill掉释放资源

| $ sudo sysctl -w vm.swappiness=0 |

|---|

3) 调整ulimit上限,默认值为比较小的数字

| $ ulimit -n 查看允许最大进程数 $ ulimit -u 查看允许打开最大文件数 |

|---|

优化修改:

| $ sudo vi /etc/security/limits.conf 修改打开文件数限制 末尾添加: soft nofile 1024000 hard nofile 1024000 Hive - nofile 1024000 hive - nproc 1024000 $ sudo vi /etc/security/limits.d/90-nproc.conf 修改用户打开进程数限制 修改为: # soft nproc 4096 #root soft nproc unlimited soft nproc 40960 root soft nproc unlimited |

|---|

4) 开启集群的时间同步NTP

集群中某台机器同步网络时间服务器的时间,集群中其他机器则同步这台机器的时间。

5) 更新系统补丁

更新补丁前,请先测试新版本补丁对集群节点的兼容性。

3.4、Zookeeper优化

1) 优化Zookeeper会话超时时间

hbase-site.xml

| 参数:zookeeper.session.timeout 解释:In hbase-site.xml, set zookeeper.session.timeout to 30 seconds or less to bound failure detection (20-30 seconds is a good start).该值会直接关系到master发现服务器宕机的最大周期,默认值为30秒(不同的HBase版本,该默认值不一样),如果该值过小,会在HBase在写入大量数据发生而GC时,导致RegionServer短暂的不可用,从而没有向ZK发送心跳包,最终导致认为从节点shutdown。一般20台左右的集群需要配置5台zookeeper。 |

|---|

3.5、HBase优化

3.5.1、预分区

每一个region维护着startRow与endRowKey,如果加入的数据符合某个region维护的rowKey范围,则该数据交给这个region维护。那么依照这个原则,我们可以将数据索要投放的分区提前大致的规划好,以提高HBase性能。

1) 手动设定预分区

| hbase> create ‘staff’,’info’,’partition1’,SPLITS => [‘1000’,’2000’,’3000’,’4000’] |

|---|

2) 生成16进制序列预分区

| create ‘staff2’,’info’,’partition2’,{NUMREGIONS => 15, SPLITALGO => ‘HexStringSplit’} |

|---|

3) 按照文件中设置的规则预分区

创建splits.txt文件内容如下:

| aaaa bbbb cccc dddd |

|---|

然后执行:

| create ‘staff3’,’partition3’,SPLITS_FILE => ‘splits.txt’ |

|---|

4) 使用JavaAPI创建预分区

| //自定义算法,产生一系列Hash散列值存储在二维数组中 byte[][] splitKeys = 某个散列值函数 //创建HBaseAdmin实例 HBaseAdmin hAdmin = new HBaseAdmin(HBaseConfiguration.create()); //创建HTableDescriptor实例 HTableDescriptor tableDesc = new HTableDescriptor(tableName); //通过HTableDescriptor实例和散列值二维数组创建带有预分区的HBase表 hAdmin.createTable(tableDesc, splitKeys); |

|---|

3.5.2、RowKey设计

一条数据的唯一标识就是rowkey,那么这条数据存储于哪个分区,取决于rowkey处于哪个一个预分区的区间内,设计rowkey的主要目的 ,就是让数据均匀的分布于所有的region中,在一定程度上防止数据倾斜。接下来我们就谈一谈rowkey常用的设计方案。

1) 生成随机数、hash、散列值

| 比如: 原本rowKey为1001的,SHA1后变成:dd01903921ea24941c26a48f2cec24e0bb0e8cc7 原本rowKey为3001的,SHA1后变成:49042c54de64a1e9bf0b33e00245660ef92dc7bd 原本rowKey为5001的,SHA1后变成:7b61dec07e02c188790670af43e717f0f46e8913 在做此操作之前,一般我们会选择从数据集中抽取样本,来决定什么样的rowKey来Hash后作为每个分区的临界值。 |

|---|

2) 字符串反转

| 20170524000001转成10000042507102 20170524000002转成20000042507102 |

|---|

这样也可以在一定程度上散列逐步put进来的数据。

3) 字符串拼接

| 20170524000001_a12e 20170524000001_93i7 |

|---|

3.5.3、内存优化

HBase操作过程中需要大量的内存开销,毕竟Table是可以缓存在内存中的,一般会分配整个可用内存的70%给HBase的Java堆。但是不建议分配非常大的堆内存,因为GC过程持续太久会导致RegionServer处于长期不可用状态,一般16~48G内存就可以了,如果因为框架占用内存过高导致系统内存不足,框架一样会被系统服务拖死。

3.5.4、基础优化

1) 允许在HDFS的文件中追加内容

不是不允许追加内容么?没错,请看背景故事:

http://blog.cloudera.com/blog/2009/07/file-appends-in-hdfs/

hdfs-site.xml、hbase-site.xml

| 属性:dfs.support.append 解释:开启HDFS追加同步,可以优秀的配合HBase的数据同步和持久化。默认值为true。 |

|---|

2) 优化DataNode允许的最大文件打开数

hdfs-site.xml

| 属性:dfs.datanode.max.transfer.threads 解释:HBase一般都会同一时间操作大量的文件,根据集群的数量和规模以及数据动作,设置为4096或者更高。默认值:4096 |

|---|

3) 优化延迟高的数据操作的等待时间

hdfs-site.xml

| 属性:dfs.image.transfer.timeout 解释:如果对于某一次数据操作来讲,延迟非常高,socket需要等待更长的时间,建议把该值设置为更大的值(默认60000毫秒),以确保socket不会被timeout掉。 |

|---|

4) 优化数据的写入效率

mapred-site.xml

| 属性: mapreduce.map.output.compress mapreduce.map.output.compress.codec 解释:开启这两个数据可以大大提高文件的写入效率,减少写入时间。第一个属性值修改为true,第二个属性值修改为:org.apache.hadoop.io.compress.GzipCodec或者其他压缩方式。 |

|---|

5) 优化DataNode存储

| 属性:dfs.datanode.failed.volumes.tolerated 解释: 默认为0,意思是当DataNode中有一个磁盘出现故障,则会认为该DataNode shutdown了。如果修改为1,则一个磁盘出现故障时,数据会被复制到其他正常的DataNode上,当前的DataNode继续工作。 |

|---|

6) 设置RPC监听数量

hbase-site.xml

| 属性:hbase.regionserver.handler.count 解释:默认值为30,用于指定RPC监听的数量,可以根据客户端的请求数进行调整,读写请求较多时,增加此值。 |

|---|

7) 优化HStore文件大小

hbase-site.xml

| 属性:hbase.hregion.max.filesize 解释:默认值10737418240(10GB),如果需要运行HBase的MR任务,可以减小此值,因为一个region对应一个map任务,如果单个region过大,会导致map任务执行时间过长。该值的意思就是,如果HFile的大小达到这个数值,则这个region会被切分为两个Hfile。 |

|---|

8) 优化hbase客户端缓存

hbase-site.xml

| 属性:hbase.client.write.buffer 解释:用于指定HBase客户端缓存,增大该值可以减少RPC调用次数,但是会消耗更多内存,反之则反之。一般我们需要设定一定的缓存大小,以达到减少RPC次数的目的。 |

|---|

9) 指定scan.next扫描HBase所获取的行数

hbase-site.xml

| 属性:hbase.client.scanner.caching 解释:用于指定scan.next方法获取的默认行数,值越大,消耗内存越大。 |

|---|

10) flush、compact、split机制

当MemStore达到阈值,将Memstore中的数据Flush进Storefile;compact机制则是把flush出来的小文件合并成大的Storefile文件。split则是当Region达到阈值,会把过大的Region一分为二。

涉及属性:

即:128M就是Memstore的默认阈值

| hbase.hregion.memstore.flush.size:134217728 |

|---|

即:这个参数的作用是当单个HRegion内所有的Memstore大小总和超过指定值时,flush该HRegion的所有memstore。RegionServer的flush是通过将请求添加一个队列,模拟生产消费模型来异步处理的。那这里就有一个问题,当队列来不及消费,产生大量积压请求时,可能会导致内存陡增,最坏的情况是触发OOM。

| hbase.regionserver.global.memstore.upperLimit:0.4 hbase.regionserver.global.memstore.lowerLimit:0.38 |

|---|

即:当MemStore使用内存总量达到hbase.regionserver.global.memstore.upperLimit指定值时,将会有多个MemStores flush到文件中,MemStore flush 顺序是按照大小降序执行的,直到刷新到MemStore使用内存略小于lowerLimit

四、过滤器

基础API中的查询操作在面对大量数据的时候是非常苍白的,这里Hbase提供了高级的查询方法:Filter。Filter可以根据簇、列、版本等更多的条件来对数据进行过滤,基于Hbase本身提供的三维有序(主键有序、列有序、版本有序),这些Filter可以高效的完成查询过滤的任务。带有Filter条件的RPC查询请求会把Filter分发到各个RegionServer,是一个服务器端(Server-side)的过滤器,这样也可以降低网络传输的压力。

要完成一个过滤的操作,至少需要两个参数。一个是抽象的操作符,Hbase提供了枚举类型的变量来表示这些抽象的操作符:LESS/LESS_OR_EQUAL/EQUAL/NOT_EUQAL等;另外一个就是具体的比较器(Comparator),代表具体的比较逻辑,如果可以提高字节级的比较、字符串级的比较等。有了这两个参数,我们就可以清晰的定义筛选的条件,过滤数据。

1、行键过滤器 RowFilter

import org.apache.hadoop.conf.Configuration;

import org.apache.hadoop.hbase.Cell;

import org.apache.hadoop.hbase.HBaseConfiguration;

import org.apache.hadoop.hbase.TableName;

import org.apache.hadoop.hbase.client.*;

import org.apache.hadoop.hbase.filter.BinaryComparator;

import org.apache.hadoop.hbase.filter.CompareFilter;

import org.apache.hadoop.hbase.filter.Filter;

import org.apache.hadoop.hbase.filter.RowFilter;

import java.util.List;

public class HbaseFilterTest {

private static final String ZK_CONNECT_KEY = “hbase.zookeeper.quorum”;

private static final String ZK_CONNECT_VALUE = “bigdata111:2181”;

private static Connection conn = null;

private static Admin admin = null;

public static void main(String[] args) throws Exception {

Configuration conf = HBaseConfiguration.create();

conf.set(ZK_CONNECT_KEY, ZK_CONNECT_VALUE);

conn = ConnectionFactory.createConnection(conf);

admin = conn.getAdmin();

Table table = conn.getTable(TableName.valueOf(“teacher”));

Scan scan = new Scan();

Filter rowFilter = new RowFilter(CompareOperator.EQUAL, new BinaryComparator(“1001”.getBytes()));

scan.setFilter(rowFilter);

ResultScanner resultScanner = table.getScanner(scan);

for (Result result : resultScanner) {

List

for (Cell cell : cells) {

System.out.println(cell);

}

}

}

}

2、列簇过滤器 FamilyFilter

import org.apache.hadoop.conf.Configuration;

import org.apache.hadoop.hbase.Cell;

import org.apache.hadoop.hbase.HBaseConfiguration;

import org.apache.hadoop.hbase.TableName;

import org.apache.hadoop.hbase.client.;

import org.apache.hadoop.hbase.filter.;

import java.util.List;

public class HbaseFilterTest {

private static final String ZK_CONNECT_KEY = “hbase.zookeeper.quorum”;

private static final String ZK_CONNECT_VALUE = “bigdata111:2181”;

private static Connection conn = null;

private static Admin admin = null;

public static void main(String[] args) throws Exception {

Configuration conf = HBaseConfiguration.create();

conf.set(ZK_CONNECT_KEY, ZK_CONNECT_VALUE);

conn = ConnectionFactory.createConnection(conf);

admin = conn.getAdmin();

Table table = conn.getTable(TableName.valueOf(“teacher”));

Scan scan = new Scan();

Filter familyFilter = new FamilyFilter(CompareOperator.EQUAL, new BinaryComparator(“contact”.getBytes()));

scan.setFilter(familyFilter);

ResultScanner resultScanner = table.getScanner(scan);

for(Result result : resultScanner) {

List

for(Cell cell : cells) {

System.out.println(cell);

}

}

}

}

3、列过滤器 QualifierFilter

Filter qualifierFilter = new QualifierFilter(CompareOperator.EQUAL, new BinaryComparator("name".getBytes()));<br /> scan.setFilter(qualifierFilter);<br /> ResultScanner resultScanner = table.getScanner(scan);<br /> for(Result result : resultScanner) {<br /> List<Cell> cells = result.listCells();<br /> for(Cell cell : cells) {<br /> System.out.println(cell);<br /> }<br /> }

4、值过滤器 ValueFilter

Filter valueFilter = new ValueFilter(CompareOperator.EQUAL, new SubstringComparator("male"));<br /> scan.setFilter(valueFilter);<br /> ResultScanner resultScanner = table.getScanner(scan);<br /> for(Result result : resultScanner) {<br /> List<Cell> cells = result.listCells();<br /> for(Cell cell : cells) {<br /> System.out.println(cell);<br /> }<br /> }

5、时间戳过滤器 TimestampsFilter

Scan scan = new Scan();<br /> <br /> List<Long> list = new ArrayList<>();<br /> list.add(1599660833273L);<br /> TimestampsFilter timestampsFilter = new TimestampsFilter(list);<br /> scan.setFilter(timestampsFilter);<br /> ResultScanner resultScanner = table.getScanner(scan);<br /> for(Result result : resultScanner) {<br /> List<Cell> cells = result.listCells();<br /> for(Cell cell : cells) {<br /> System.out.println(cell.getRowArray() + "\t"<br /> + Bytes.toString(cell.getFamilyArray()) + "\t"<br /> + Bytes.toString(cell.getQualifierArray()) + "\t"<br /> + Bytes.toString(cell.getValueArray()) + "\t"<br /> + cell.getTimestamp());<br /> }<br /> }

专用过滤器

1、单列值过滤器 SingleColumnValueFilter

Scan scan = new Scan();<br /> <br /> SingleColumnValueFilter singleColumnValueFilter = new SingleColumnValueFilter(<br /> "info".getBytes(),<br /> "name".getBytes(),<br /> CompareOperator.EQUAL,<br /> new SubstringComparator("Jack"));<br /> singleColumnValueFilter.setFilterIfMissing(true);<br /> <br /> scan.setFilter(singleColumnValueFilter);<br /> ResultScanner resultScanner = table.getScanner(scan);<br /> for(Result result : resultScanner) {<br /> List<Cell> cells = result.listCells();<br /> for(Cell cell : cells) {<br /> System.out.println(cell.getRowArray() + "\t"<br /> + Bytes.toString(cell.getFamilyArray()) + "\t"<br /> + Bytes.toString(cell.getQualifierArray()) + "\t"<br /> + Bytes.toString(cell.getValueArray()) + "\t"<br /> + cell.getTimestamp());<br /> }<br /> }

2、单列值排除器 SingleColumnValueExcludeFilter

Scan scan = new Scan();<br /> <br /> SingleColumnValueExcludeFilter singleColumnValueExcludeFilter = new SingleColumnValueExcludeFilter(<br /> "info".getBytes(),<br /> "name".getBytes(),<br /> CompareOperator.EQUAL,<br /> new SubstringComparator("Jack"));<br /> singleColumnValueExcludeFilter.setFilterIfMissing(true);<br /> <br /> scan.setFilter(singleColumnValueExcludeFilter);<br /> ResultScanner resultScanner = table.getScanner(scan);<br /> for(Result result : resultScanner) {<br /> List<Cell> cells = result.listCells();<br /> for(Cell cell : cells) {<br /> System.out.println(cell.getRowArray() + "\t"<br /> + Bytes.toString(cell.getFamilyArray()) + "\t"<br /> + Bytes.toString(cell.getQualifierArray()) + "\t"<br /> + Bytes.toString(cell.getValueArray()) + "\t"<br /> + cell.getTimestamp());<br /> }<br /> }

3、前缀过滤器 PrefixFilter——针对行键

Scan scan = new Scan();<br /> <br /> PrefixFilter prefixFilter = new PrefixFilter("10".getBytes());<br /> <br /> scan.setFilter(prefixFilter);<br /> ResultScanner resultScanner = table.getScanner(scan);<br /> for(Result result : resultScanner) {<br /> List<Cell> cells = result.listCells();<br /> for(Cell cell : cells) {<br /> //打印略<br /> }<br /> }

4、列前缀过滤器 ColumnPrefixFilter

Scan scan = new Scan();<br /> <br /> ColumnPrefixFilter columnPrefixFilter = new ColumnPrefixFilter("name".getBytes());<br /> <br /> scan.setFilter(columnPrefixFilter);<br /> ResultScanner resultScanner = table.getScanner(scan);<br /> for(Result result : resultScanner) {<br /> List<Cell> cells = result.listCells();<br /> for(Cell cell : cells) {<br /> //打印略<br /> }<br /> }

5、分页过滤器 PageFilter

Scan scan = new Scan();<br /> <br /> PageFilter columnPrefixFilter = new PageFilter(1);<br /> <br /> scan.setFilter(columnPrefixFilter);<br /> ResultScanner resultScanner = table.getScanner(scan);<br /> for(Result result : resultScanner) {<br /> List<Cell> cells = result.listCells();<br /> for(Cell cell : cells) {<br /> //打印略<br /> }<br /> }<br />

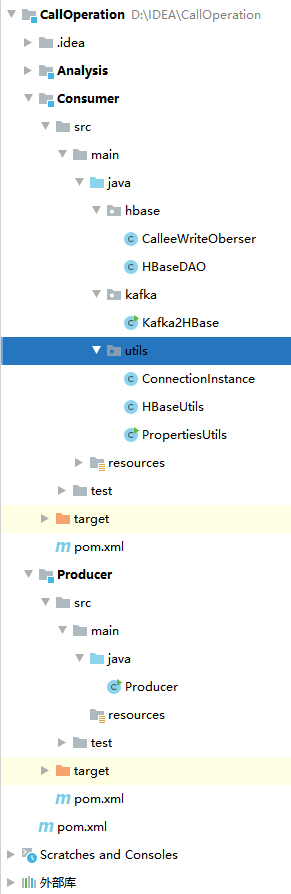

五、HBase项目

项目架构

自定义Java模拟数据 + Flume + Kafka + HBase + MySQL