问题

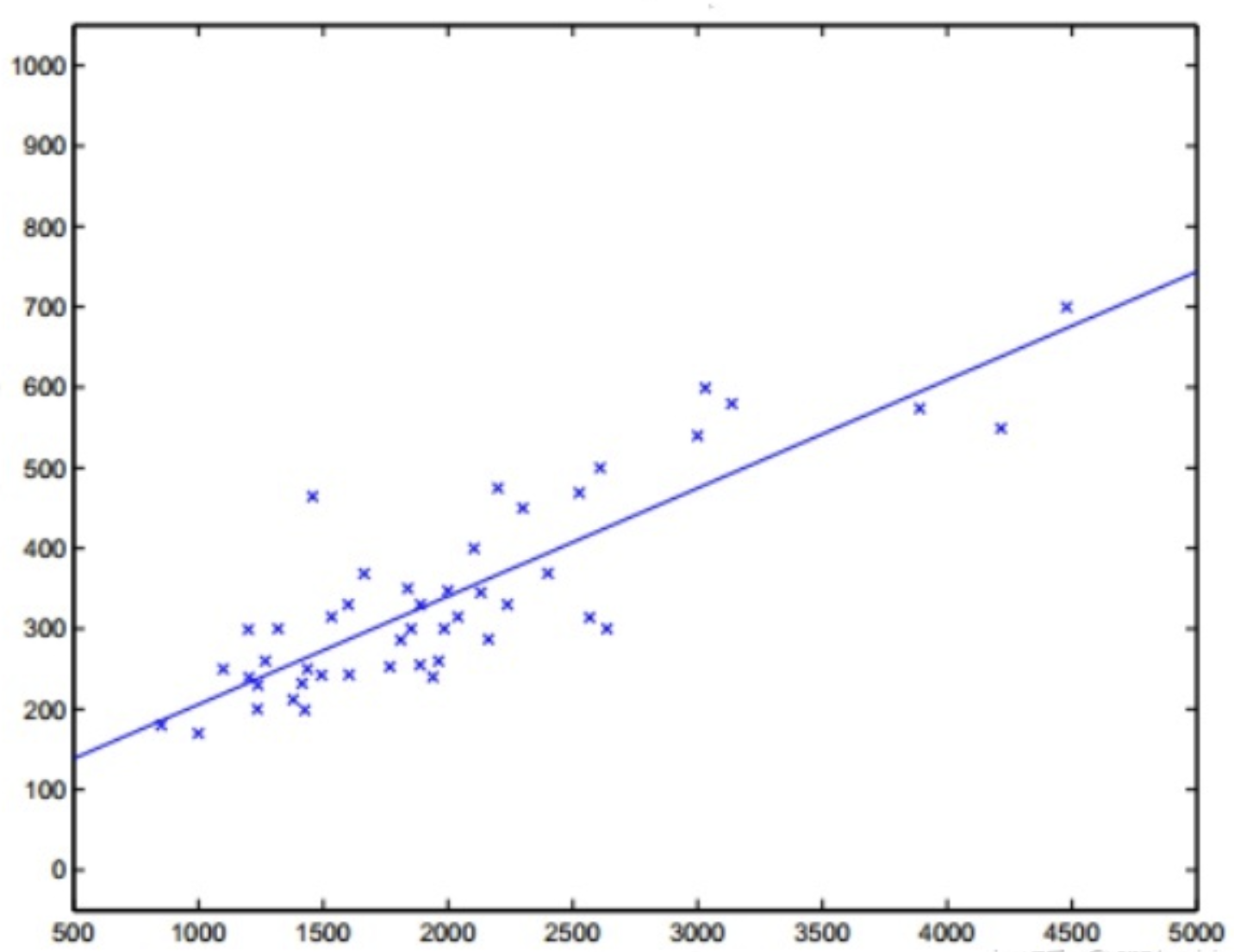

很多时候数据集在坐标系上的落点都在一条直线附近,即输入变量和输出变量之间近似满足线性关系。如果能找到这条直线,就能很好的拟合已知的输入输出数据集,并对于一个未来的输入数据预测可能的输出数据。

怎么找这样一条直线呢?

符号假设

假设,其中

,是p维的数据输入,

,是一维实数的输出。令

为数据输入输出矩阵,

为权值矩阵,则

最小二乘法估计

使用均方误差作为损失函数,使用均方误差最小化目标函数的方法称为最小二乘法。

使用均方误差的原因:有十分好的几何意义,对应了常用的欧式距离。在线性回归中,就是找到一个直线,使得所有样本到直线的欧式距离最小。

损失函数定义如下:

损失函数求解

<br />令

两边求导得到

令得到

作为半正定矩阵,如果有逆,那么没有问题;如果没有逆,那么就不可以像这样直接求解,可以使用梯度下降法。即每次迭代,令

对梯度下降或者随机梯度下降不熟悉的,可以看这个:梯度下降算法

线性回归应用场景

- 自变量和因变量之间是线性关系时

- 适应于低维数据,而且每一维之间没有共线性(共线性是指变量之间由于存在精确相关关系或高度相关关系使模型准确率失真)

优缺点分析

优点

- 直接。

- 快速。

- 可解释性好。

缺点

- 需要严格的假设。

- 需处理异常值,对异常值很敏感,对输入数据差异也很敏感。

- 线性回归存在共线性,自相关,异方差等问题。