核心思想:错误驱动

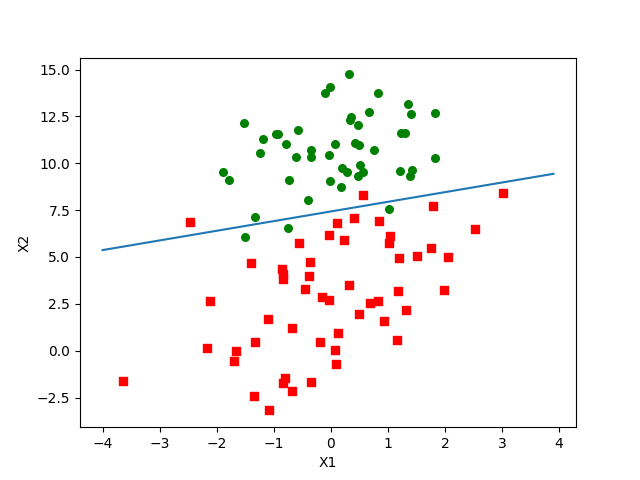

有一些数据,这些数据样本分别属于两个不同的类别。现在用一个超平面将两类样本分开,位于超平面上方的样本打上标签+1(图中绿色的点),下方的打上标签-1(图中红色的点)。那么每个数据样本

都有一个标签

,表明其所属的类别。

记该超平面方程为(在每个数据样本开头添一位数据1,这样超平面方程仍然是

的形式,事实上上一节逻辑回归的超平面方程也可以这么写),那么被分类正确的点有

,被分类错误的点有

。

现在定义数据集的一个子集:

代表被错误分类的数据样本集合。

定义函数:

代表整个数据集被错误分类的“程度”。

由于对每个错误分类的数据样本有

,所以我们的目标是要找到

使得

最大,即使得

最小,即找到:

梯度下降求目标参数

对分别求偏导,有:

梯度下降法多次迭代即可求得目标参数。

数据集及最终训练结果

数据集同上一节逻辑回归

设置梯度下降参数α=0.001,训练次数500000次,最终得到:

w = [304.008,21.07732141,-40.92316773]]

结果如下图: