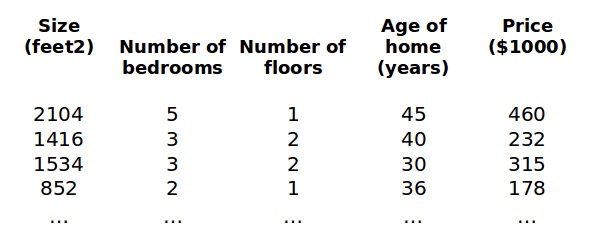

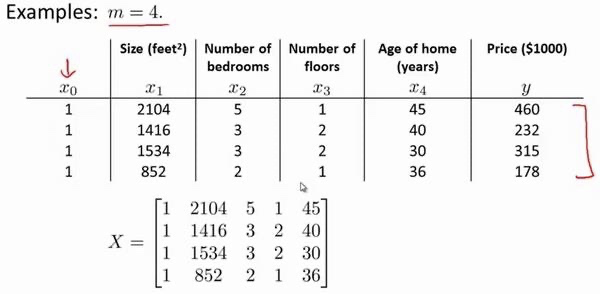

目前为止,我们探讨了单变量/特征的回归模型,现在我们对房价模型增加更多的特征,例如房间数楼层等,构成一个含有多个变量的模型,模型中的特征为

增添更多特征后,我们需要知道一些新的解释:

代表了特证的数量(每行的特征数),如

size、Number of bedrooms、Number of floors、Age of home(years)等。代表了样例个数(图中行数)。

代表第

个训练实例(样例),特征矩阵的第

行,是一个向量(vector),如上图

。

支持多变量假设 表示为

,这个公式有

个参数和n个变量,为了使得公式能够简化一些,引入

,即转化为

,此模型的参数是一个

维的向量,任何一个训练实例也都是

维的向量,特征矩阵

的维度是

。公式

,特征矩阵

和

如下:

所以 的值为:

多变量梯度下降

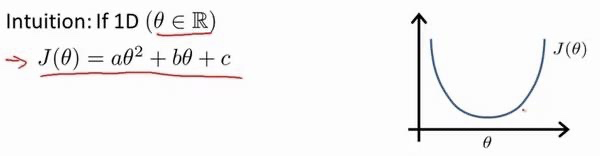

与单变量线性回归类似,在多变量线性回归中,我们也构建代价函数,这个代价函数是所有建模误差的平方和,即 ,

,我们的目标和单变量线性回归问题中一样,是要找出使得代价函数最小的一系列参数。多变量线性回归的批量梯度下降算法为:

将代价函数带入并求导后,结果如下:

当特征数量 时,仅需要对

和

进行迭代(

),但是如果特征数量

,则

,对

均进行迭代。以上为多元线性回归模型。

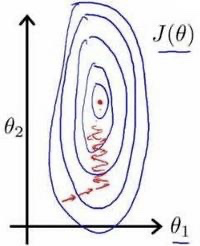

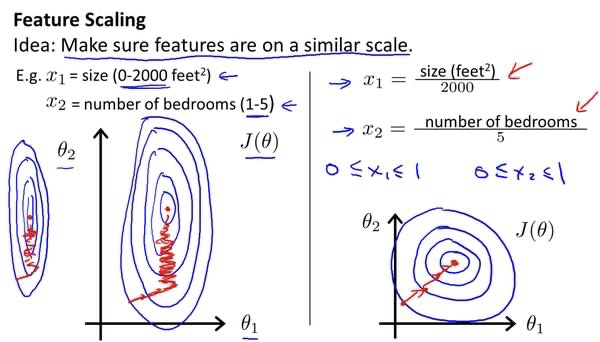

当我们面对多维特征问题时,我们要保证这些特征都具有相近的尺度(即数量级相近),这将帮助梯度下降算法更快地收敛。以房价问题为例,假设我们使用两个特征,房屋的尺寸和房间的数量,尺寸的值为 平方英尺,而房间数量的值则是

,以两个参数分别为横纵坐标,绘制代价函数的等高线图,能看出图像会显得很扁,梯度下降算法需要非常多次的迭代才能收敛。

解决的方法是尝试将所有特征的尺度都尽量缩放到 到

之间。

平均归一化(Mean normalization)

平均归一化:Replace with

to make features have approximately zero mean(Do not apply to

),最简单的方法是令

,其中

是平均值,

是标准差。比如对于房屋尺寸

的范围在

到

之间,平均值为

,现在将尺寸特征转化,即是用公式:

,如房屋数量

到

,则

。

梯度下降法实践-学习率

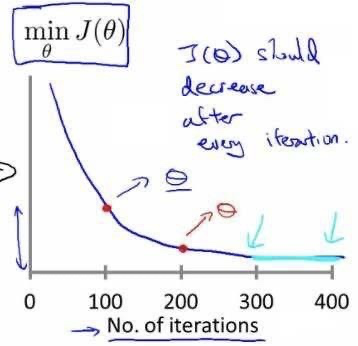

梯度下降算法收敛所需要的迭代次数根据模型的不同而不同,我们不能提前预知,我们可以绘制迭代次数和代价函数的图来观测算法在何时趋于收敛。

也有一些自动测试是否收敛的方法,例如将代价函数的变化值与某个阀值(例如 )进行比较,但通常看上面这样的图表更好。梯度下降算法的每次迭代受到学习率的影响,如果学习率

过小,则达到收敛所需的迭代次数会非常高;如果学习率

过大,每次迭代可能不会减小代价函数,可能会越过局部最小值导致无法收敛。通常可以考虑尝试些学习率:

特征和多项式回归

Housing prices prediction:,其中

为临街宽度,

为纵向深度。

已知临街宽度和纵向深度,我们也可以得出面积 ,因此我们可以得出另一个

的式子:

,其中

。我们会发现构建一个线性回归的形式可能有多种。

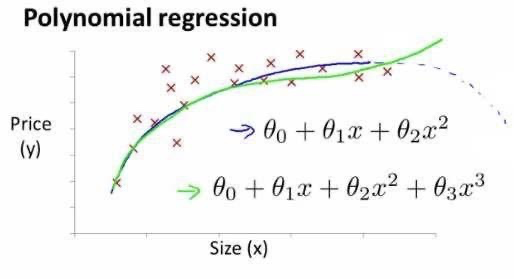

对于我们构建的回归模型来说,有时候线性模型不一定适合于所有数据,那么这个时候我们可以变换线性回归的形式,将其改变为二次模型或者三次模型,比如说对于一个二次模型:,或者三次模型:

我们通常需要先观察数据的变化,然后再决定准备尝试怎样的模型。对于上图,按照常理来说随着面积尺寸的增大,价格是不会降低的,所以二次模型就不符合我们所要构建的回归模型,但是如果是三次模型,则不会像二次模型那样离谱。我们可以加入一个 ,从而将模型转为线性回归模型,其中图中的

。我们还可以这样构建模型:

注:如果我们采用多项式回归模型,在运行梯度下降算法前,特征缩放非常有必要,即上面说到的平均归一化。

正归方程(标准方程法)

前面我们一直在介绍梯度下降法,但是对于某些线性回归问题,正规方程的方法是更好的解决方案,如:

正规方程是通过求解下面的方程来找出使得代价函数最小的参数的:,假设我们的训练集特征矩阵为

(包含了

),并且我们的训练结果为向量

,则利用正规方程解出向量

。

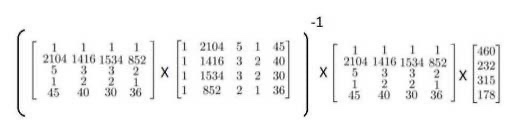

以下表数据为例:

运用正规方程求解参数 :

注:对于那些不可逆的矩阵(通常是因为特征之间不独立,如同时包含英尺为单位的尺寸和米为单位的尺寸两个特征,也有可能是特征数量大于训练集的数量,导致多个特征值之间线性相关),正规方程方法是不能用的。

梯度下降与正规方程的比较:

| 梯度下降 | 正规方程 |

|---|---|

| 需要选择学习率 | 不需要 |

| 需要对此迭代运算 | 一次运算得出 |

| 当特征数量 大时也能较好适用 | 需要计算 如果特征数量 大则运算代价大,因为矩阵逆的计算时间复杂度为 ,通常来说当 时还是可以接受的 |

| 适用于各种类型的模型 | 只适用于线性模型,不适合逻辑回归模型等其他模型 |

总结一下,只要特征变量的数目并不大,正规方程是一个很好的计算参数 的替代方法。 具体地说,只要特征变量数量小于一万,我通常使用正规方程的方法而不使用梯度下降法。

随着后面要讲的学习算法越来越复杂,例如,当我们讲到分类算法中逻辑回归算法,我们会看到,实际上对于那些算法,并不能使用正规方程的方法(标准方程法)。对于那些更复杂的学习算法,我们将不得不仍然使用梯度下降法。因此,梯度下降法是一个非常有用的算法,可以用在有大量特征变量的线性回归问题,因为正规方程(标准方程法)不适合或者不能用在它们上。但对于这个特定的线性回归模型,标准方程法是一个比梯度下降法更快的替代算法。所以根据具体的问题以及你的特征变量的数量,这两种算法都是值得学习的。

What if

non-invertible is ?

Redundant features(linearly dependent**)**

E.g.

,

,

属于同一类特征,线性相关了,所以不可逆

- Too many features (E.g.

)

- Too many features (E.g.

Delete some features, or use regularization(正则化的方法)。

E.g.

,你要找到适合的参数

,要拟合

个特征,但

个样本有些少,解决的办法通常是删除一些特征,或者使用一种叫做正则化的方法。

的推导

的推导

,其中

,将向量表达式转化为矩阵表达式,则有

,其中

为

行

列的矩阵(

为样本个数,

为特征个数),

为

行

列的矩阵,对

进行如下变换:

接下来对 求偏导,需要用到几个矩阵的求导法则:

,所以有:

令 ,则有