Word2vec 是 Word Embedding 方式之一,属于 NLP 领域。他是将词转化为「可计算」「结构化」的向量的过程。本文将讲解 Word2vec 的原理和优缺点。

这种方式在 2018 年之前比较主流,但是随着 BERT、GPT2.0 的出现,这种方式已经不算效果最好的方法了。

一、什么是Word2vec

1.1 什么是 Word Embedding ?

在说明 Word2vec 之前,需要先解释一下 Word Embedding。 它就是将「不可计算」「非结构化」的词转化为「可计算」「结构化」的向量。这一步解决的是”将现实问题转化为数学问题“,是人工智能非常关键的一步。

1.2 Word2vec的概念

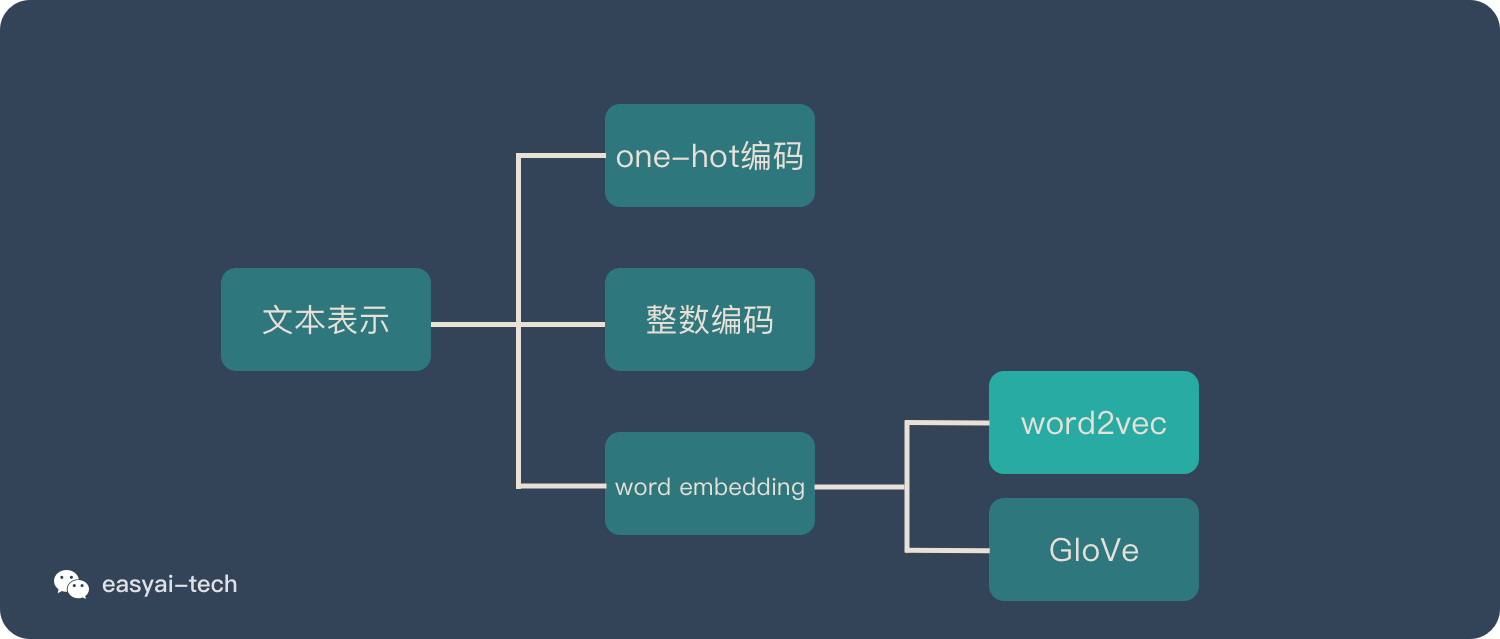

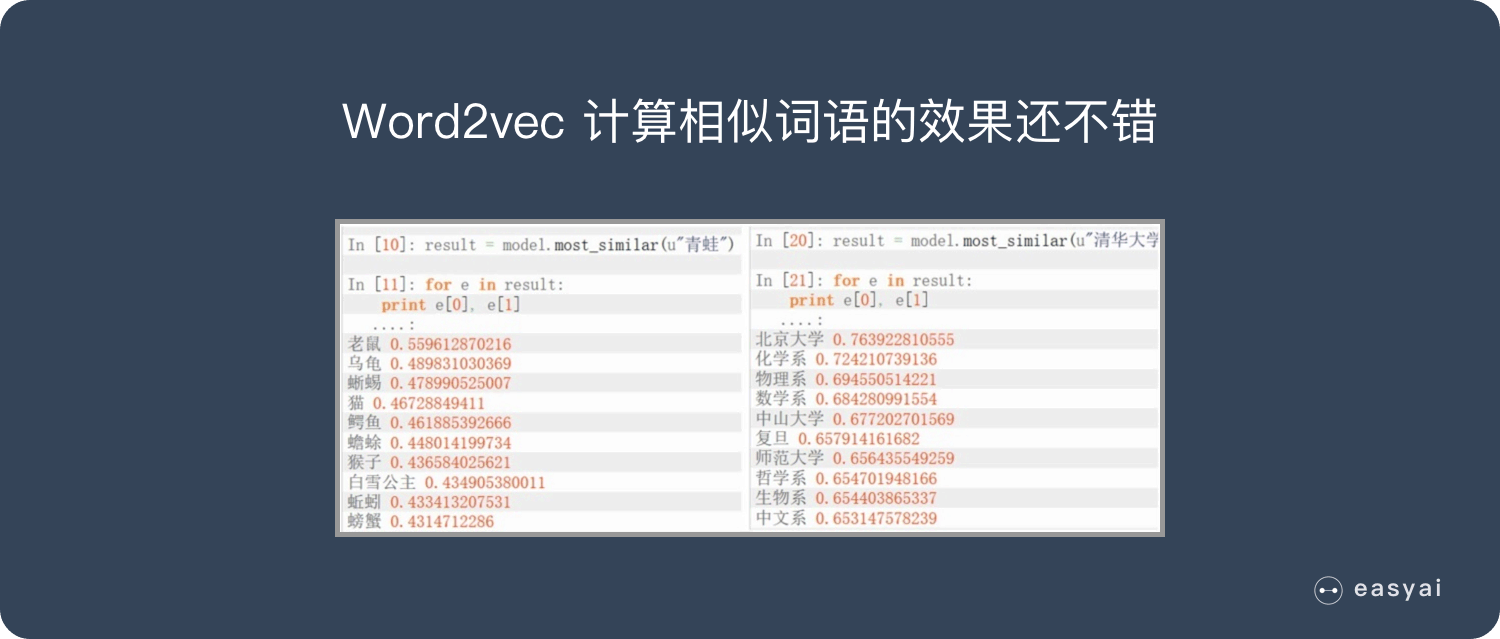

Word2vec 是 Word Embedding 的方法之一。他是 2013 年由谷歌的 Mikolov 提出了一套新的词嵌入方法。Word2vec 在整个 NLP 里的位置可以用下图表示:

2. Word2vec的2中训练方式

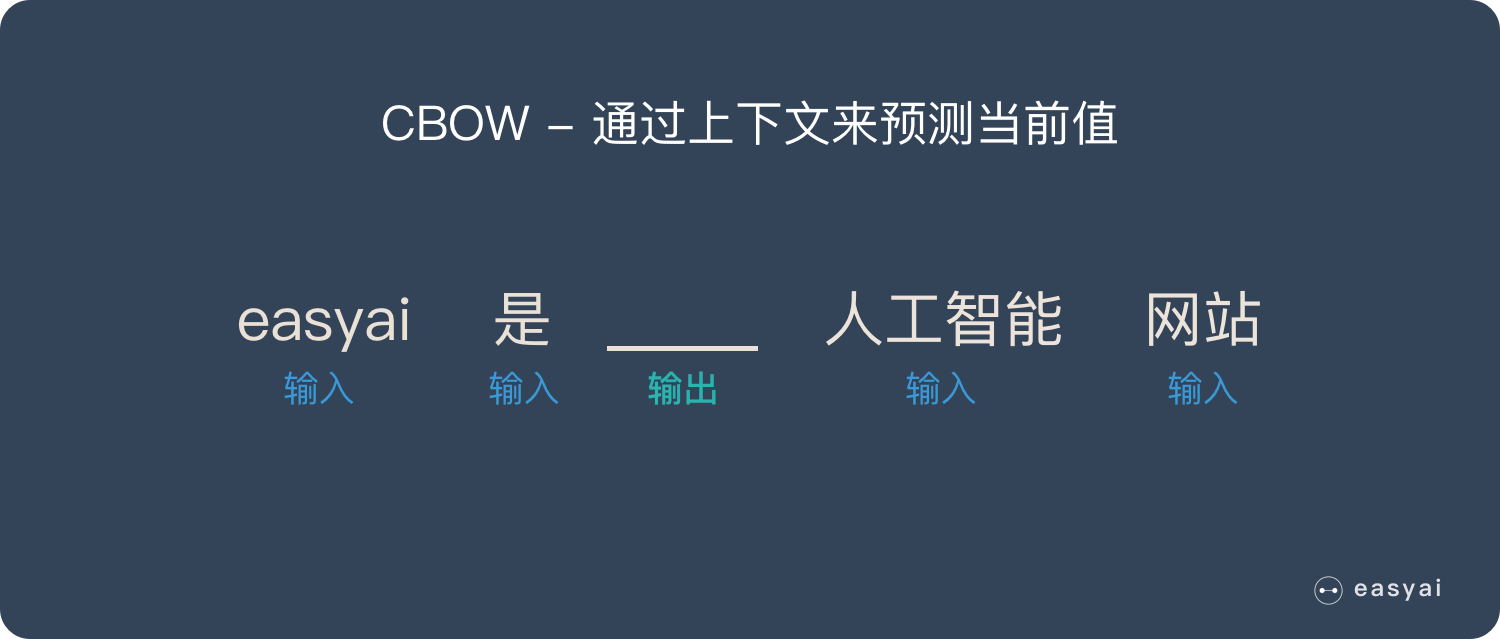

CBOW(Continuous Bag-of-Words Model)和Skip-gram (Continuous Skip-gram Model),是Word2vec 的两种训练模式。下面简单做一下解释:2.1 连续词袋模型CBOW

通过上下文来预测当前值。相当于一句话中扣掉一个词,让你猜这个词是什么。

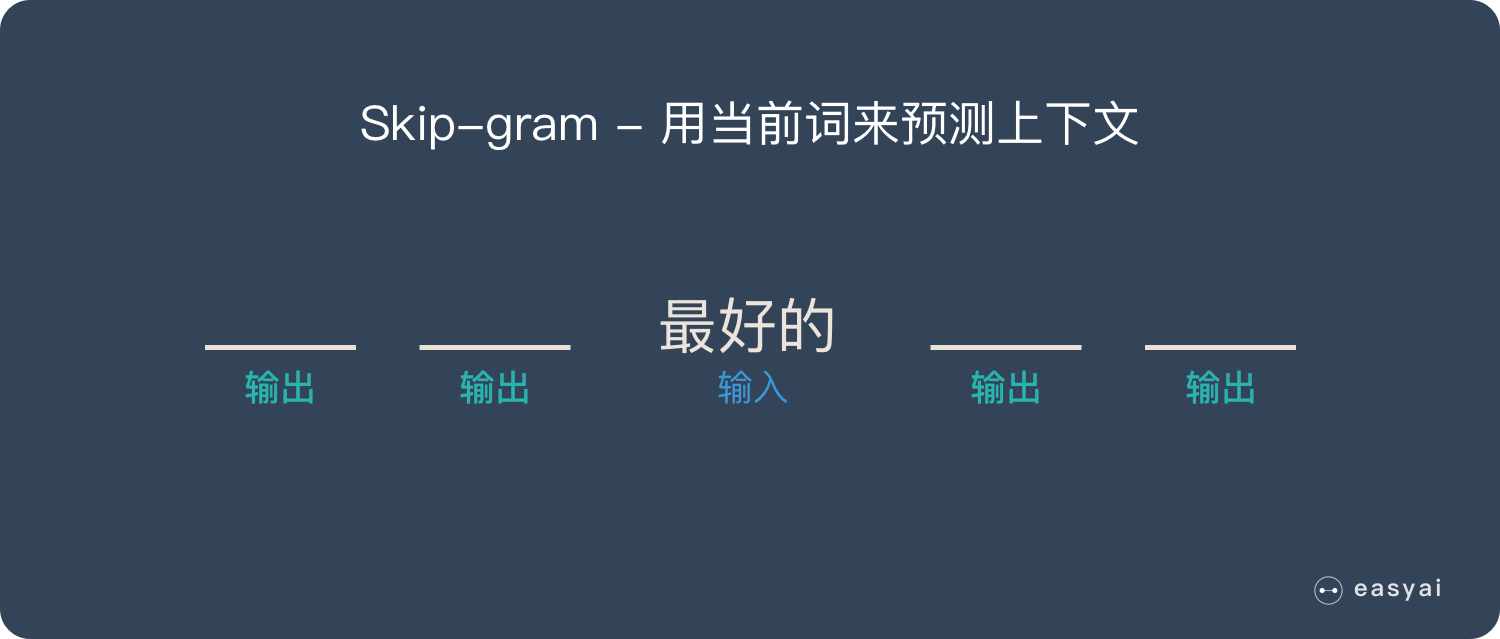

2.2 Skip-Gram模型

用当前词来预测上下文。相当于给你一个词,让你猜前面和后面可能出现什么词。

2.3 优化方法

为了提高速度,Word2vec 经常采用 2 种加速方式:- Negative Sample(负采样)

- Hierarchical Softmax

3. Word2vec的优缺点

需要说明的是:Word2vec 是上一代的产物(18 年之前), 18 年之后想要得到最好的效果,已经不使用 Word Embedding 的方法了,所以也不会用到 Word2vec。3.1 优点

- 由于 Word2vec 会考虑上下文,跟之前的 Embedding 方法相比,效果要更好(但不如 18 年之后的方法)

- 比之前的 Embedding方 法维度更少,所以速度更快

- 通用性很强,可以用在各种 NLP 任务中

3.2 缺点

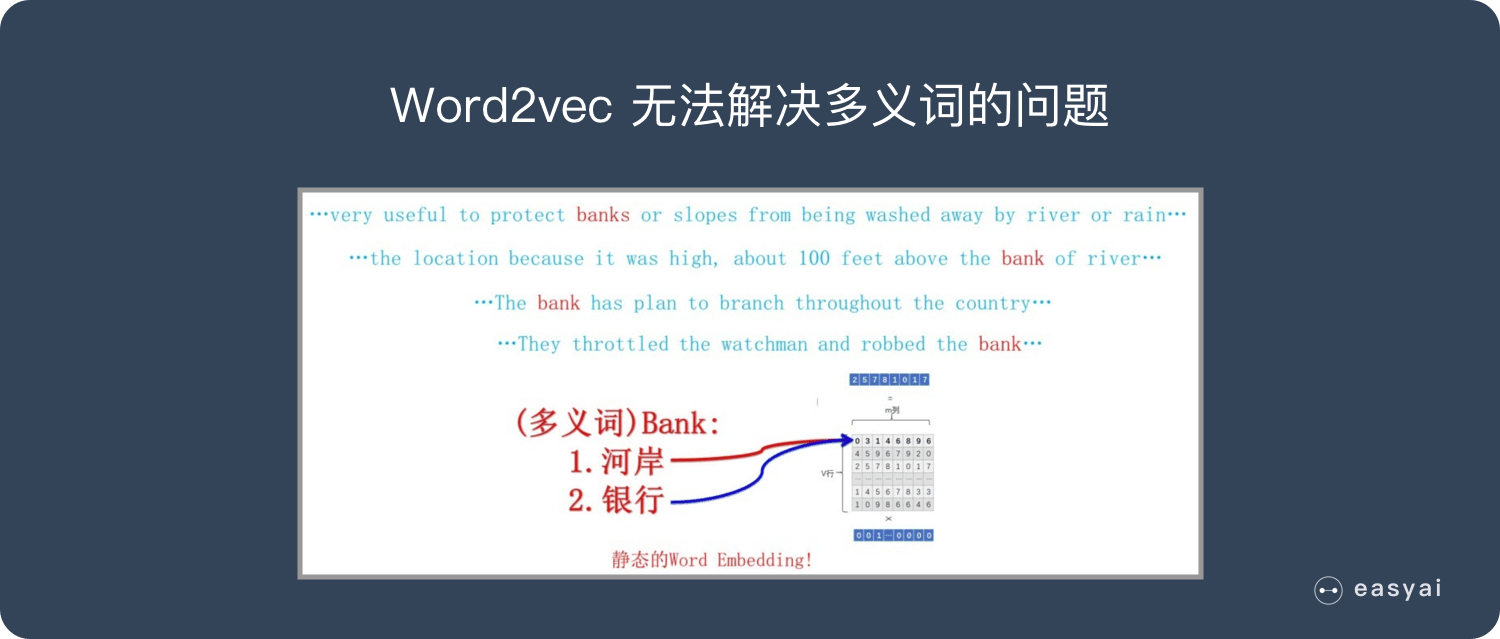

- 由于词和向量是一对一的关系,所以多义词的问题无法解决。

- Word2vec 是一种静态的方式,虽然通用性强,但是无法针对特定任务做动态优化