1.三台虚拟机配置

(1)修改静态ip

vim /etc/sysconfig/network-scripts/ifcfg-ens33

DEVICE=ens33TYPE=EthernetONBOOT=yesBOOTPROTO=staticNAME="ens33"IPADDR=192.168.1.101PREFIX=24GATEWAY=192.168.1.2DNS1=114.114.114.114

1.重启网络服务Systemctl restart network2.查看网络地址ip addr

ONBOOT =yes :开机激活网卡

BOOTPROTO =static : 静态IP,dhcp为动态

IPADDR = : ip地址

PREFIX = 24 :子网掩码位置长度

GATEWAY =192.168.1.2 : 网关,默认1.1(同一网关的不同网络地址才能相互通信。)

DNS =114.114.114.114 : DNS服务器,还可以有8.8.8.8

(2)安装必备插件

系统安装时选用最小安装。

yum install -y epel-releaseyum install -y psmisc nc net-tools rsync vim lrzsz ntp libzstd openssl-static tree iotop git

(3)修改主机名

hostnamectl --static set-hostname hadoop102//或者vim /etc/hostnamereboot

(4)添加主机名称映射

sudo vim /etc/hosts192.168.1.100 hadoop100192.168.1.101 hadoop101192.168.1.102 hadoop102192.168.1.103 hadoop103192.168.1.104 hadoop104192.168.1.105 hadoop105192.168.1.106 hadoop106192.168.1.107 hadoop107192.168.1.108 hadoop108

win10:(a)进入C:\Windows\System32\drivers\etc路径(b)打开hosts文件并添加上面的内容

(5)关闭防火墙

systemctl stop firewalldsystemctl disable firewalld

(6)创建用户

useradd atguigupasswd atguigu

(7)配置用户具有root权限

即能使用sudo执行根目录下的脚本

vim /etc/sudoers//修改/etc/sudoers文件,找到下面一行(91行),在root下面添加一行:## Allow root to run any commands anywhere%wheel ALL=(ALL) ALLatguigu ALL=(ALL) NOPASSWD:ALL

(8)opt

该目录专放第三方软件

1.在/opt目录下创建module、software文件夹mkdir modulemkdir software2.修改module、software文件夹的所有者cd /optchown atguigu:atguigu /opt/module /opt/softwarereboot

(9)安装JDK

1.将JDK,HADOOP的tar包导入到/opt/software2.解压到/opt/module/tar -zxvf jdk-8u212-linux-x64.tar.gz -C /opt/module/3.配置环境变量sudo vim /etc/profile.d/my_env.sh4.添加内容#JAVA_HOMEexport JAVA_HOME=/opt/module/jdk1.8.0_212export PATH=$PATH:$JAVA_HOME/bin5.更新配置source my_env.sh6.检查java -versionreboot

(10)安装HADOOP

1.解压到/opt/module/tar -zxvf hadoop-3.1.3.tar.gz -C /opt/module/2.配置环境变量sudo vim /etc/profile.d/my_env.sh3.添加内容##HADOOP_HOMEexport HADOOP_HOME=/opt/module/hadoop-3.1.3export PATH=$PATH:$HADOOP_HOME/binexport PATH=$PATH:$HADOOP_HOME/sbin4.更新配置source my_env.sh5.检查hadoop versionreboot

(1)bin目录:存放对Hadoop相关服务(HDFS,YARN)进行操作的脚本

(2)etc目录:Hadoop的配置文件目录,存放Hadoop的配置文件

(3)lib目录:存放Hadoop的本地库(对数据进行压缩解压缩功能)

(4)sbin目录:存放启动或停止Hadoop相关服务的脚本

(5)share目录:存放Hadoop的依赖jar包、文档、和官方案例

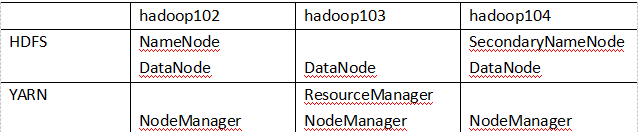

2.完全分布式运行模式

(1)虚拟机准备

克隆;

主要修改IP地址;

重启网络服务;

修改主机名hostname;

(2)集群分发脚本xsync

scp -r

rsync -av

1.在opt/moduel/hadoop/bin中写

vim xsync

2.添加代码

#!/bin/bash

#1. 判断参数个数

if [ $# -lt 1 ]

then

echo Not Enough Arguement!

exit;

fi

#2. 遍历集群所有机器

for host in hadoop102 hadoop103 hadoop104

do

echo ==================== $host ====================

#3. 遍历所有目录,挨个发送

for file in $@

do

#4 判断文件是否存在

if [ -e $file ]

then

#5. 获取父目录

pdir=$(cd -P $(dirname $file); pwd)

#6. 获取当前文件的名称

fname=$(basename $file)

ssh $host "mkdir -p $pdir"

rsync -av $pdir/$fname $host:$pdir

else

echo $file does not exists!

fi

done

done

1.执行权限

chmod u+x xsync

2.分享该脚本

sudo xsync ./xsync

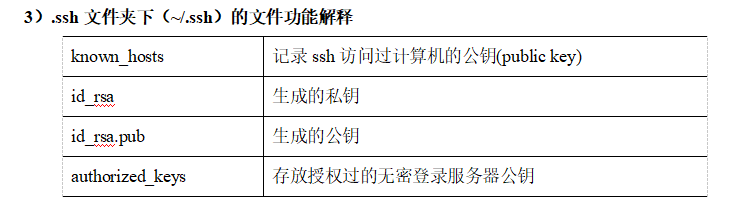

(3)设置ssh免密登录

可以考虑使用xshell的工具—发送到所有会话节省操作步骤。

1.生成公钥和私钥

ssh-keygen -t rsa

2.拷贝公钥

ssh-copy-id hadoop102

ssh-copy-id hadoop103

ssh-copy-id hadoop104

后续可以查找ssh自动批量生成并分发钥匙

3.集群配置

(1)核心配置文件

1.找到core-site.xml

cd $HADOOP_HOME/etc/hadoop

vim core-site.xml

2.添加内容

<configuration>

<!--指定HDFS中NameNode的地址 -->

<property>

<name>fs.defaultFS</name>

<value>hdfs://hadoop102:9820</value>

</property>

<!-- 指定Hadoop运行时产生文件的存储目录 -->

<property>

<name>hadoop.tmp.dir</name>

<value>/opt/module/hadoop-3.1.3/data</value>

</property>

<!-- 通过web界面操作hdfs的权限 -->

<property>

<name>hadoop.http.staticuser.user</name>

<value>atguigu</value>

</property>

<!-- 后面hive的兼容性配置 -->

<property>

<name>hadoop.proxyuser.atguigu.hosts</name>

<value>*</value>

</property>

<property>

<name>hadoop.proxyuser.atguigu.groups</name>

<value>*</value>

</property>

</configuration>

(2)HDFS配置文件

1.vim hdfs-site.xml

2.添加内容

<configuration>

<property>

<name>dfs.namenode.secondary.http-address</name>

<value>hadoop104:9868</value>

</property>

</configuration>

(3)YARN配置文件

1.vim yarn-site.xml

2.添加内容

<configuration>

<!-- Reducer获取数据的方式-->

<property>

<name>yarn.nodemanager.aux-services</name>

<value>mapreduce_shuffle</value>

</property>

<!-- 指定YARN的ResourceManager的地址-->

<property>

<name>yarn.resourcemanager.hostname</name>

<value>hadoop103</value>

</property>

<!-- 环境变量通过从NodeManagers的容器继承的环境属性,对于mapreduce应用程序,除了默认值 hadoop op_mapred_home应该被添加外。属性值 还有如下-->

<property>

<name>yarn.nodemanager.env-whitelist</name>

<value>JAVA_HOME,HADOOP_COMMON_HOME,HADOOP_HDFS_HOME,HADOOP_CONF_DIR,CLASSPATH_PREPEND_DISTCACHE,HADOOP_YARN_HOME,HADOOP_MAPRED_HOME</value>

</property>

<!-- 解决Yarn在执行程序遇到超出虚拟内存限制,Container被kill -->

<property>

<name>yarn.nodemanager.pmem-check-enabled</name>

<value>false</value>

</property>

<property>

<name>yarn.nodemanager.vmem-check-enabled</name>

<value>false</value>

</property>

<!-- 后面hive的兼容性配置 -->

<property>

<name>yarn.scheduler.minimum-allocation-mb</name>

<value>512</value>

</property>

<property>

<name>yarn.scheduler.maximum-allocation-mb</name>

<value>4096</value>

</property>

<property>

<name>yarn.nodemanager.resource.memory-mb</name>

<value>4096</value>

1.yarn虚拟内存的另一种处理方式

<!-- 每个容器请求的最小内存资源(以MB为单位)。-->

<property>

<name>yarn.scheduler.minimum-allocation-mb</name>

<value>512</value>

</property>

<!-- 每个容器请求的最大内存资源(以MB为单位)。-->

<property>

<name>yarn.scheduler.maximum-allocation-mb</name>

<value>2048</value>

</property>

<!-- 容器虚拟内存与物理内存之间的比率。-->

<property>

<name>yarn.nodemanager.vmem-pmem-ratio</name>

<value>4</value>

</property>

(4)MapReduce配置文件

1.vim mapred-site.xml

2.添加内容

<?xml version="1.0" encoding="UTF-8"?>

<?xml-stylesheet type="text/xsl" href="configuration.xsl"?>

<configuration>

<!-- 指定MR运行在Yarn上 -->

<property>

<name>mapreduce.framework.name</name>

<value>yarn</value>

</property>

</configuration>

<!-- MR App Master环境变量。-->

<property>

<name>yarn.app.mapreduce.am.env</name>

<value>HADOOP_MAPRED_HOME=${HADOOP_HOME}</value>

</property>

<!-- MR MapTask环境变量。-->

<property>

<name>mapreduce.map.env</name>

<value>HADOOP_MAPRED_HOME=${HADOOP_HOME}</value>

</property>

<!-- MR ReduceTask环境变量。-->

<property>

<name>mapreduce.reduce.env</name>

<value>HADOOP_MAPRED_HOME=${HADOOP_HOME}</value>

</property>

<!-- 开启日志聚集 -->

<property>

<name>yarn.log-aggregation-enable</name>

<value>true</value>

</property>

<!-- 保存的时间7天 -->

<property>

<name>yarn.log-aggregation.retain-seconds</name>

<value>604800</value>

</property>

</configuration>

(5)配置workers

1.vim /opt/module/hadoop-3.1.3/etc/hadoop/workers

2.添加内容

hadoop102

hadoop103

hadoop104

(6)分发配置文件

xsync /opt/module/hadoop-3.1.3/etc/hadoop/

4.启动集群

(1)第一次启动格式化NN

hdfs namenode -format

重复格式化则运行批量删除脚本clean

1.vim/opt/module/hadoop/bin/clean

2.添加内容

#!/bin/bash

for host in hadoop102 hadoop103 hadoop104

do

#删除内容,主要用于重复格式化

ssh $host rm -rf $HADOOP_HOME/data $HADOOP_HOME/logs

ssh $host sudo rm -rf /tmp/*

done

(2)编写批量启动脚本mycluter

1.vim/opt/module/hadoop/bin/mycluster

2.添加内容

if [ $# -ne 1 ]

then

echo "args number error!!!"

exit

fi

case $1 in

"start")

ssh hadoop102 $HADOOP_HOME/sbin/start-dfs.sh

ssh hadoop103 $HADOOP_HOME/sbin/start-yarn.sh

;;

"stop")

ssh hadoop102 $HADOOP_HOME/sbin/stop-dfs.sh

ssh hadoop103 $HADOOP_HOME/sbin/stop-yarn.sh

;;

*)

echo "args info error!!!"

;;

esac

echo “ ———————- 启动 historyserver ———————-“

ssh hadoop102 “/opt/module/hadoop-3.1.3/bin/mapred —daemon start historyserver”

;;

echo “ ———————- 关闭 historyserver ———————-“

ssh hadoop102 “/opt/module/hadoop-3.1.3/bin/mapred —daemon stop historyserver”

(3)编写jsp批量检查脚本jspall

1.1.vim/opt/module/hadoop/bin/japall

2.添加内容

#!/bin/bash

for host in hadoop102 hadoop103 hadoop104

do

echo "=========================$host============================"

ssh $host jps

done

(4)组件逐一启动/停止

1.分别启动/停止HDFS组件

hdfs --daemon start/stop namenode/datanode/secondarynamenode

2.启动/停止YARN

yarn --daemon start/stop resourcemanager/nodemanager

(5)模块逐一启动/停止

1.整体启动/停止HDFS

start-dfs.sh/stop-dfs.sh

2.整体启动/停止YARN

start-yarn.sh/stop-yarn.sh

(6)错误日志查看

1.cd hadoop根目录下的logs文件夹

2.找到出现问题的组件的日志文件

3.查看信息

tail -n 100 xxx

5.配置历史服务器

1.vim mapred-site.xml

2.添加内容

<!-- 历史服务器端地址 -->

<property>

<name>mapreduce.jobhistory.address</name>

<value>hadoop102:10020</value>

</property>

<!-- 历史服务器web端地址 -->

<property>

<name>mapreduce.jobhistory.webapp.address</name>

<value>hadoop102:19888</value>

</property>

3.分发配置

xsync $HADOOP_HOME/etc/hadoop/mapred-site.xml

4.在102启动历史服务器

mapred --daemon start historyserver

5.查看jobHistory

http://hadoop102:19888/jobhistory

6.配置日志聚集

可以看到程序运行详情(job对应的logs)

1.vim yarn-site.xml

2.添加内容

<!-- 开启日志聚集 -->

<property>

<name>yarn.log-aggregation-enable</name>

<value>true</value>

</property>

<!-- 访问路径-->

<property>

<name>yarn.log.server.url</name>

<value>http://hadoop102:19888/jobhistory/logs</value>

</property>

<!-- 保存的时间7天 -->

<property>

<name>yarn.log-aggregation.retain-seconds</name>

<value>604800</value>

</property>

7.集群时间同步

在公网环境不需要集群时间同步。内网需要

配置其中一个节点为时间服务器(root)

1.102关闭ntp服务和自启动

sudo systemctl stop ntpd

sudo systemctl disable ntpd

2.修改ntp配置

sudo vim /etc/ntp.conf

(1)授权网段上的机器可以查询并同步

去掉#

restrict 192.168.1.0 mask 255.255.255.0 nomodify notrap

(2)集群在局域网中,不使用其他互联网上的时间

加上#

#server 0.centos.pool.ntp.org iburst

#server 1.centos.pool.ntp.org iburst

#server 2.centos.pool.ntp.org iburst

#server 3.centos.pool.ntp.org iburst

(3)节点无网络后使用本地时间提供时间同步

添加

server 127.127.1.0

fudge 127.127.1.0 stratum 10

3,修改ntpd文件

sudo vim /etc/sysconfig/ntpd

增加

SYNC_HWCLOCK=yes

4.重启服务和自启

systemctl start ntpd

systemctl enable ntpd

非时间服务器配置

1.每10分钟与时间服务器同步一次

crontab -e

2.编写定时任务

*/10 * * * * /usr/sbin/ntpdate hadoop102

8.后续可以考虑的配置

(1)hfds-checkpoint的设置