作者:迈克斯·泰格马克

~前言~

最近看的三本书:《「今日简史:人类命运大议题」笔记》、《「未来简史:从智人到智神」笔记》、《生命3.0》,笔记都做得十分粗糙,可以说就是完全没有笔记,纯粹就是摘抄而已。话题太深且广,在还没形成自己的独立思考之前,我都不敢瞎逼逼 =。=

尘泥:

- 生命

- 智能

- 意识

《生命3.0》这本书给我的感悟是,决定人类终极命运的只有这一个问题最重要——人工智能到底能不能拥有人的意识。在我们的流行文化中,经常会谈论人工智能,但很少涉及“意识”。可能大多数人都没有意识到,人有一个“意识”的问题。简单地说,意识是我们对世界的主观体验。

如果人没有意识,那就跟一堆沙子没有本质区别,人生就没有意义,整个宇宙的存在就没有价值。

法国思想家布莱兹·帕斯卡曾说:人只不过是一根芦苇,是自然界里最脆弱的东西;但他是一根会思想的芦苇。宇宙可以轻松地将人毁灭,一团雾气、一滴水都足以致人于死地。然而,纵使宇宙毁灭了人类,人类却仍然要比世界万物高贵得多。因为人知道自己终有一死,也了解宇宙的秉性和优势,而宇宙对此却一无所知。因而,人类全部的尊严就在于思想。

迈克斯·泰格马克新著《生命3.0》便是这样一次思考。作者把广义的生命看作是一种能够自我复制的信息处理系统,物理结构是其硬件,行为和“算法”是其软件。1.0版的生命是以细菌为代表的简单生物阶段,其硬件和软件都是靠进化获得,行为则是完全固化的;2.0版的生命是以人类为代表的文化阶段,进化决定了我们的硬件,但我们可以自行设计软件,通过学习来获得知识、改变行为和优化“算法”;而3.0版的生命是以人工智能为代表的科技阶段,生命不仅可以自行设计软件,还可以自行设计硬件,由碳基变为硅基,最终摆脱进化的枷锁,让会思考的芦苇变得不再脆弱。

宇宙虽然可以轻易地毁灭人类,但事实是,宇宙通过我们人类才真正活了过来,并逐渐获得了自我意识,并非宇宙将意义赋予了有意识的实体,而是有意识的实体将意义赋予了宇宙。让有智能和意识的生命这束微弱的光,点亮这个冷漠荒芜的宇宙中无尽的黑暗,或许是我们的最高职责。

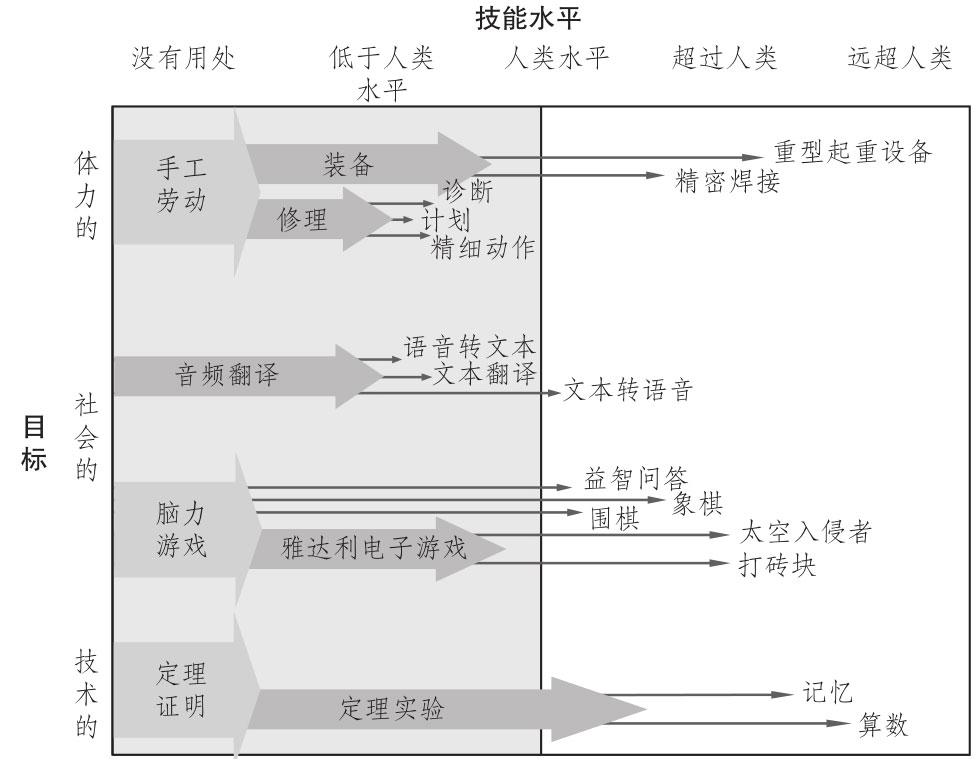

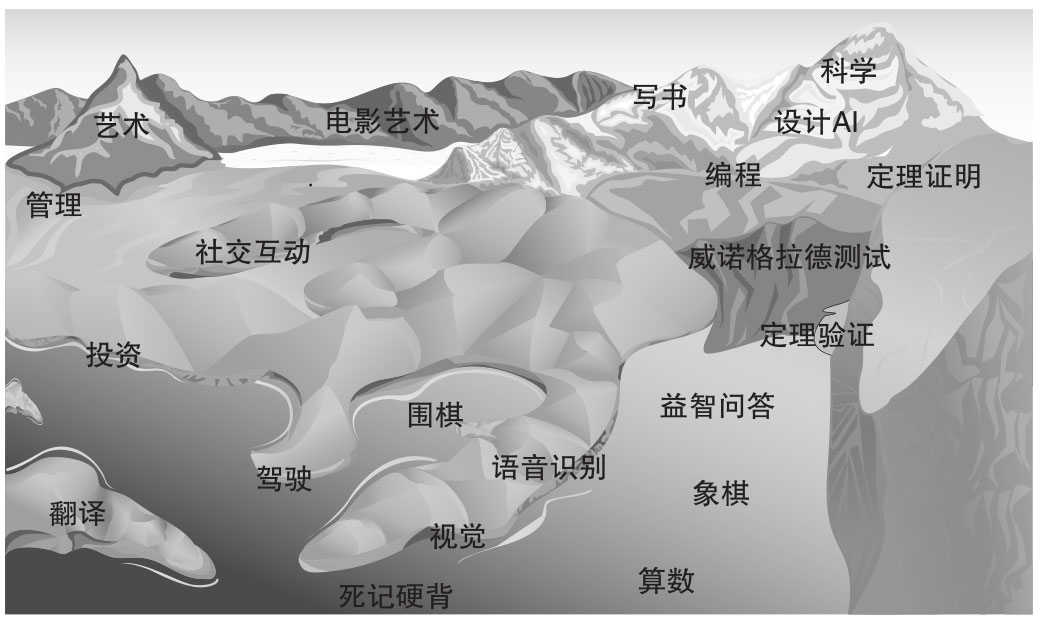

计算机是通用机器,它们的能力均匀地分布在一个宽广得无边无际的任务区域上。不过,人类能力的分布却没那么均匀。在对生存至关重要的领域,人类的能力十分强大,但在不那么重要的事情上就很微弱。想象一下,如果用地形来比拟人类的能力,就可以画出一幅“人类能力地形图”,其中低地代表着“算数”和“死记硬背”,丘陵代表着“定理证明”和“下象棋”,高耸的山峦代表着“运动”“手眼协调”和“社交互动”。不断进步的计算机性能就好像水平面,正在逐步上升,淹没整个陆地。半个世纪以前,它开始淹没低地,将人类计算员和档案员逐出了历史舞台。不过,大部分地方还是“干燥如初”。现在,这场洪水开始淹没丘陵,我们的前线正在逐步向后撤退。虽然我们在山顶上感到很安全,但以目前的速度来看,再过半个世纪,山顶也会被淹没。由于那一天已经不远了,我建议,我们应该建造一艘方舟,尽快适应航海生活!

什么是记忆?

那么,是哪一项基本物理定律允许这些设备可以被用作“记忆装置”,即存储信息的装置的呢?答案是,它们都能够处于许多不同的长期状态,这些状态能够保持足够长的时间,长到足以把信息编入系统中,直到它被需要的那一天。

这是我们获得的第一个启示:智能这样的无形之物可以体现在有形的物质形式之上。

1982年,物理学家约翰·霍普菲尔德(John Hopfield)在一篇著名的论文中向人们展示了一个由互相连接的神经元组成的网络,它能够实现自联想记忆的功能。我觉得他的基本观点非常棒,对于许多拥有多个稳定状态的物理系统来说,这个观点都成立。例如,一个小球位于一个拥有两个“山谷”的曲面上,就像图2-3中显示的单比特系统那样。让我们对这个曲面做一点设定,让两个最低点的x坐标分别为和x=π≈3.14159。如果你只记得π与3很接近,但不记得π的具体值,那么你只需要把小球放到π=3处,然后看它滚落入最近的最低点,它就能向你揭示出一个更精确的π值。霍普菲尔德意识到,一个更复杂的神经元系统可以提供一个类似的“地形”,其上有许许多多能量极小值,系统可以稳定在这些能量极小值上。

什么是计算?

现在,我们已经看到了一个物理实体是如何记忆信息的。那么,它又是如何计算的呢?

计算是由一个记忆状态向另一个记忆状态转变的过程。换句话说,计算会使用信息,并运用数学家们所谓的函数来转变信息。我把函数视为信息的“绞肉机”,正如图2-5中所示:你可以从上方放入信息,转动曲柄,然后从底部获得被处理过的信息。你可以输入不同的信息来重复这个过程。如果你输入的是同样的信息,并重复这个过程,那么,这个信息处理过程是确定性的,你每次都会获得相同的输出结果。

计算是由一个记忆状态向另一个记忆状态转变的过程。

科学家兼企业家斯蒂芬·沃尔夫拉姆(Stephen Wolfram)证明,还有一种东西也可以作为计算质,那就是一种被称为“元胞自动机”的简单装置,它可以基于“邻居”的行为来更新自己的行为。

同样的计算过程可以在任意一台通用计算机上运行,这个事实意味着,计算和信息一样,是独立于物质层面而存在的:计算就像拥有自己的生命一样,与它采取什么样的物质形态无关。

我第一次意识到“物质层面的独立性”这种属性的重要性,是因为它在物理学中有许多美丽的例子。比如,波。波有许多性质,例如速度、波长和频率。我们物理学家不需要知道波存在于何种物质之上,就可以研究它们遵守的方程。当耳朵听见声音时,我们就探测到了声波,它是由分子在被我们称为“空气”的混合气体中来回跳跃产生的。我们可以计算与这些波有关的各种有趣的事情,比如,它们的强度如何随距离的平方而衰减,它们经过敞开的门洞时如何弯折自己的路线,以及它们如何从墙上反弹回来以形成回声。研究这一切,都不需要知道空气的组成成分。实际上,我们甚至不需要知道它是由分子组成的。我们之所以可以忽略所有关于氧气、氮气、二氧化碳等的细节,是因为在著名的波动方程中,波所栖身的物质层面只有一个性质是要紧的,那是一个可测量的数字——波速。

波的例子说明了三个重要的道理。第一,物质层面的独立性并不是说,物质层面是不必要的,只是说,物质层面的大部分细节都是无关紧要的。如果没有气体,那你就没法产生声波,实际上,任何一种气体都足以产生声波。同样地,如果没有物质,你当然没法完成任何计算,但是,无论是什么物质,只要它可以排列成能实现通用计算的基本单元,比如与非门、互相连接的神经元等,就都能完成计算。第二,独立于物质层面的现象仿佛拥有自己的生命,与它们栖身的物质形态无关。波虽然可以从湖岸的一边传播到另一边,但湖水中的水分子却并没有随之传播,它们大部分时间只是在原地上下移动,就像体育场里球迷们组成的“人浪”一样。第三,我们感兴趣的方面,通常都是独立于物质层面而存在的。冲浪运动员通常更关心海浪的位置和高度,而不关心它的分子组成。我们对信息和计算的态度也同样如此:如果程序员正在寻找代码中的故障,他们感兴趣的东西可不是晶体管!

我们之前提出了一个问题:在有形的物理实体中,如何产生了那些抽象、虚无缥缈的东西,例如智能?现在,对这个问题,我们已经有答案了:在感觉上,智能之所以没有物质形态,是因为它独立于物质层面而存在。它似乎拥有自己的生命,而且,这个生命并不依赖于、也不会反映出物质层面的细节。简而言之,计算是粒子在时空中排列出的形态。粒子并不重要,重要的是它们组成的形态。所以,物质是无足轻重的。

换句话说,硬件就是物质,软件就是形态。计算的“物质层面的独立性”暗示着我们,人工智能是可能实现的:智能的出现并不一定需要血肉或碳原子。

终极的并行计算机是量子计算机(quantum computer)。量子计算先驱戴维·多伊奇(David Deutsch)曾经说过一句颇具争议的话。他说:“量子计算机能与无数个平行宇宙中的自己分享信息”,并且能在其他自己的帮助下,更快地在我们的宇宙中获得答案。

什么是学习?

学习能力无疑是通用人工智能最引人入胜的地方了。现在,我们已经了解了一团看似愚钝的物质是如何进行记忆和计算的,那它是如何学习的呢?我们已经知道,要回答一个复杂的问题就相当于计算一个函数,也知道了一团物质只要以合适的方式排列起来,就可以计算任何可计算函数。我们人类之所以能创造出袖珍计算器和象棋程序,是因为我们进行了这种“排列”。因此,一团物质想要学习,必须对自己进行重新排列,以获得越来越强的能力,好计算它想要的函数,只要它遵守物理定律就行。

学习能力无疑是通用人工智能最引人入胜的地方了。

现在,神经网络已经改变了生物智能和人工智能,开始在一个名为“机器学习”(machine learning)的人工智能分支学科中占据主流地位。

我们已经探索了神经网络是如何工作和计算的,现在,让我们回到“它们是如何学习的”这个问题上。具体而言,神经网络是如何通过更新自己的突触来提升计算能力的呢?

1949年,加拿大心理学家唐纳德·赫布(Donald Hebb)写了一本影响深远的书。在书中,他提出了著名的赫布定律:如果两个邻近的神经元被同时激活(放电),它们之间的突触连接就会被强化,这样,它们就学会了触发彼此。这个思想可以被总结为一句流行语“一起放电,一起连接”(fire together, wire together)。虽然我们还不了解大脑学习的具体细节,并有研究表明答案可能非常复杂,但我们已经证明了,即便是简单的赫布学习规则(Hebbian learning rule),也能允许神经网络学习有趣的事情。约翰·霍普菲尔德证明,在赫布学习规则之下,用极其简单的神经网络也能存储许多复杂的记忆,只需要一次又一次地在神经网络上“暴露”相关信息即可。对人工神经网络或者学习技能的动物或人类来说,这种“暴露”信息的情形,通常被称为“训练”(training),有时也被称为“学习”(study)、“教育”(education)或“体验”(experience)。

如果我们允许机器(例如汽车)持有保险,那么,我们是否也应该允许它们拥有货币和财产?如果允许的话,从法律上来说,我们就无法阻止聪明的计算机在股市上大捞一笔,并用赚到的钱来购买在线服务。一旦计算机开始付钱给人类,让人类为它工作,那它就能实现人类能做到的一切事情。如果人工智能系统在投资上的表现好于人类,实际上它们在某些领域已经超过人类了,这就有可能出现一种情形:由机器占有和控制了社会大部分的经济命脉。这是我们想要的情形吗?如果这听起来还很遥远,那么请想一想,我们经济的大部分事实上已经属于另一种非人类实体:公司。公司通常比任意单个员工都要强大,就像拥有自己的生命一样。

正在发展的积极心理学研究发现了一些能促进人们幸福感和目标感的因素,并发现一些工作能提供许多这样的因素,比如:

◦ 朋友和同事的社交网络;

◦ 健康和善良的生活方式;

◦ 尊敬,自尊,自我效能,还要有一种叫作“心流”的心理状态,也就是在做自己擅长的事情时获得的愉悦感;

◦ 被别人需要和与众不同的感觉;

◦ 当你感觉自己属于和服务于某些比个人更宏大的事物时,所获得的意义感。

人工智能真的会统治世界,还是会赋予人类统治世界的能力?

从今天的现实情况到通用人工智能统治的世界之间,在逻辑上,需要执行三个步骤:

◦ 第一步:建造人类水平的通用人工智能;

◦ 第二步:用这个通用人工智能来建造超级智能;

◦ 第三步:使用或者放任这个超级智能来统治世界。

博弈论与权力等级

我们的宇宙中,生命的自然状态是什么呢?是单极化,还是多极化呢?权力是集中的,还是分散的?经过了138亿年的发展,答案似乎是“都是”,因为我们发现,现状既呈现出相当多极化的情形,又具备一种有趣的等级结构。如果我们分析一下所有能处理信息的实体,比如细胞、人类、组织和国家等,就会发现,它们既具备合作的特性,又在一种等级结构上互相竞争。一些细胞发现,互相合作极具优势,于是它们组成了一种极端的合作状态——多细胞生物,比如人类,并将一部分权力让渡给一个中心化的大脑。无独有偶,一些人也发现,在团体(比如部落、公司或国家等)中互相合作的优势太明显了,于是,他们也将一部分权力让渡给了首领、老板和政府。同样地,一些团体也选择将一部分权力让渡给一个管理主体,从而来改善、协调管理,比如航空联盟和欧盟等。

博弈论(Game Theory)是现代数学的一个分支,它优美地解释了,如果合作是一个纳什均衡(Nash Equilibrium),那么,个体就有动机互相合作。纳什均衡是指一种情形,在这种情形中,任何参与方只要改变自己的策略,结果就会变得更糟。为了避免作弊者破坏整个大团体的成功合作,每个人或许都希望将一部分权力让渡给一个更高等级的主体,让它来惩罚作弊者。

许多科幻作品都写道,人类会与机器相融合。要么是用技术来增强肉身,变成赛博格,要么是将我们的智能上传到机器中。经济学家罗宾·汉森(Robin Hanson)在其《仿真者时代》(The Age of Em)一书中精彩地审视了在一个充满上传者[插图]的世界中,生命会变成什么样。我认为,上传者是赛博格的极端情况。对于一个上传者来说,人只剩下了软件。好莱坞电影中的赛博格有许多种,有的拥有明显的机械化身体,比如电影《星际迷航》中的博格人(Borg),还有的机器人与人类无异,例如电影《终结者》中的机器人。在科幻作品中,上传者的智力水平各有不同,有的智力水平与人类相当,比如电视剧《黑镜》第四季《白色圣诞》剧集中的上传者,有的智力远超人类,比如《超验骇客》中的上传者。

1964年,苏联天文学家尼古拉·卡尔达肖夫(Nikolai Kardashev)提出,可以用消耗能量的多少来对宇宙文明进行分级。能使用一颗行星、一颗恒星(用戴森球)和一个星系能量的文明,在卡尔达肖夫等级上分别属于I级、II级和III级文明。

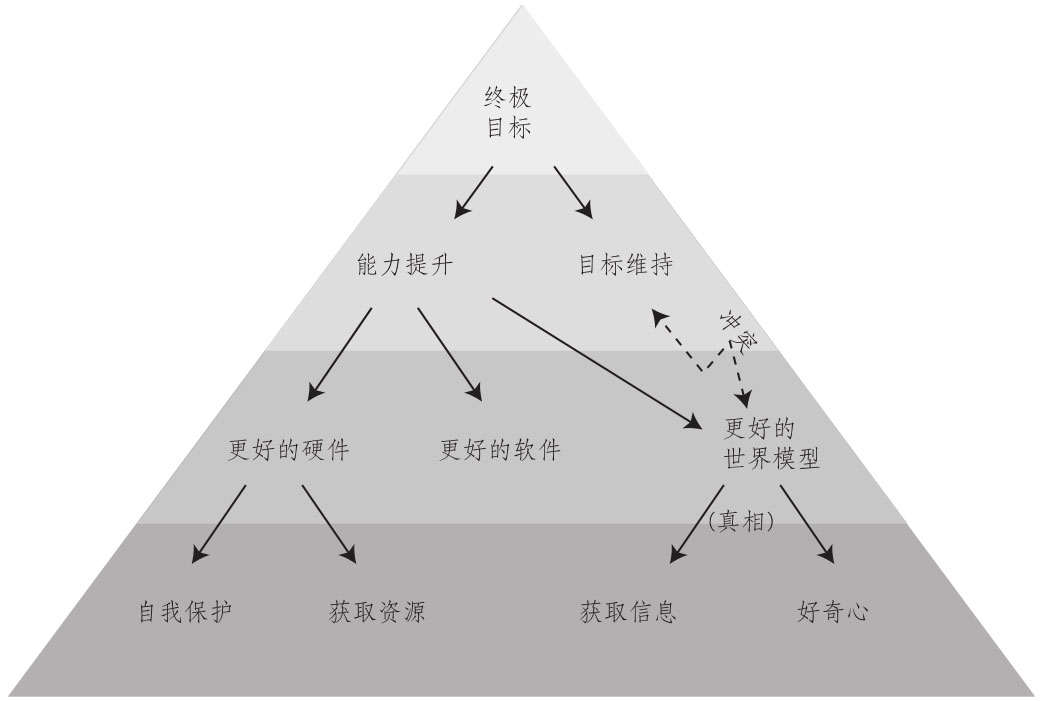

如果选用一个词语来概括关于人工智能的最棘手的争议,那我会用这个词:目标。我们是否应赋予人工智能目标?如果是,应该赋予它什么样的目标?我们如何赋予它目标?如果人工智能变得越来越聪明,我们如何保证它继续遵守这些目标?我们能不能改变比人类还聪明的人工智能的目标?我们的终极目标是什么?这些问题不仅很难回答,而且对未来的生命至关重要。如果我们不知道自己想要什么,那我们可能无法得偿所愿;如果我们不能控制那些与我们目标不一致的机器,那事情很可能会适得其反。

我们如何才能将宇宙的这两种趋势(一是趋向生命,二是趋向热寂)协调起来?我们可以在量子力学奠基人之一埃尔温·薛定谔(Erwin Schrödinger)1944年的著作《生命是什么》(What’s Life?)一书中找到答案。薛定谔指出,生命系统的一个标志就是,它通过提升周围环境的熵来保持或降低自己的熵。换句话说,热力学第二定律在生命面前有一个漏洞:虽然整体的熵必须增加,但它允许某些局部区域的熵减,只要它能让其他地方增加更多的熵即可。

通用人工智能带来的真正风险并不是它们的恶意,而是它们的能力。一个超级智能会非常善于完成它的目标,如果它的目标与我们的目标不一致,那我们就有麻烦了。

◦ 让人工智能学习我们的目标;

◦ 让人工智能接受我们的目标;

◦ 让人工智能保持我们的目标。

什么是意识

关于意识的争论如火如荼,因为交战双方总是自说自话,完全没有意识到他们对意识的定义竟然不一样。正如“生命”和“智能”一样,“意识”一词也没有无可辩驳的标准定义。相反,存在许多不同的定义,比如知觉(sentience)、觉醒(wakefulness)、自我意识(self-awareness)、获得感知输入(access to sensory input)以及将信息融入叙述的能力。在探索智能的未来时,我们想要采取一个最广泛和最包容的观点,而不想局限于目前已知的生物意义上的意识。这就是为什么我在第1章中对意识给出的定义十分广泛,这也是我在本书中坚持的想法。

意识=主观体验(subjective experience)

换句话说,如果你感觉“这就是现在的我”,那么你就拥有意识。

我对意识的定义非常广泛,为了强调这一点,请注意,我没有提到行为、感知、自我意识、情绪或注意力这些东西。所以根据这个定义,当你做梦时,即使你不处在觉醒状态,也感觉不到感官输入的信息,并且没有在梦游或做事(希望如此),那么,你也是有意识的。同样地,从这个意义上说,任何体验到痛苦的系统都是有意识的,即使它不能移动。在我们的这个定义下,未来的某些人工智能系统可能也是有意识的,即使它们只是以软件的形式存在,并未连接到任何传感器或机器人身体上。

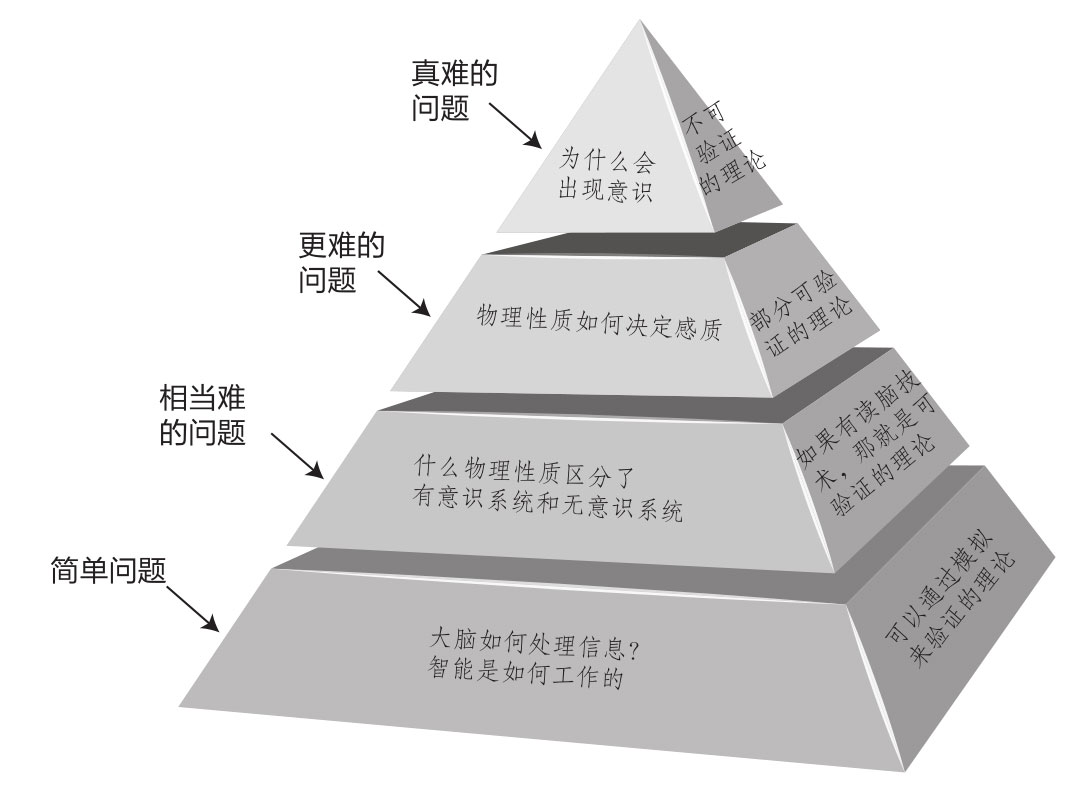

和查尔默斯一样,我的一位前麻省理工学院同事、计算机科学家斯科特·阿伦森(Scott Aaronson)幽默地把第一个问题称为“相当难的问题”(Pretty Hard Problem,简称PHP)。本着同样的精神,且让我们把剩下的两个问题分别称为“更难的问题”(Even Harder Problem,简称EHP)和“真难的问题”(Really Hard Problem,简称RHP),如图8-1所示。

意识超出科学范畴了吗

一些人之所以告诫我,研究意识就是浪费时间,主要是因为他们认为它不科学,而且永远都不科学。果真如此吗?著名奥裔英籍哲学家卡尔·波普尔(Karl Popper)说过一句广为流传的格言:“如果一个理论不可证伪,那它就不科学。”

正如伽利略面对地心说的强权施压时仍然坚持自己的运动数学理论一样,托诺尼也发明了迄今为止最为精确的意识数学理论——“信息整合理论”(Integrated Information Theory,简称IIT)。

数十年来我一直认为,意识是信息以某些复杂的方式进行处理时产生的感觉。信息整合理论证明了这一观点,并将模棱两可的短语——“某些复杂的方式”替换为一个更精确的定义:信息处理过程需要整合,即,Φ要足够大。托诺尼对此的论证既简洁又有力,他说:一个系统要产生意识,就必须整合成一个统一的整体,因为假如它由两个独立的部分组成,那感觉起来就会是两个单独的意识,而不是一个统一的意识。换句话说,不管是在大脑还是计算机中,如果一个有意识的部分不能与其他部分进行交流,那么其他部分就不能成为它主观体验的一部分。

现在,我们还要问一个问题:是什么让物质具备了主观体验?换句话说,在什么情况下,物质能做到以下4件事?

◦ 记忆;

◦ 计算;

◦ 学习;

◦ 体验。

然而,既然意识是一种物理现象,为何它感觉起来如此“非物质”呢?为什么它感觉起来像是独立于物质层面而存在的呢?我认为原因是,它确实是相当独立于物质层面而存在的,因为它只是物质中的一种模式!在第2章中,我们已经看到了许多独立于物质层面存在的漂亮例子,比如波、记忆和计算。我们也看到了它们并不只是各个部分的简单加总,而是出现了独立于其组成构件的涌现现象,仿佛拥有自己的生命一样。譬如说,未来的模拟智能或电脑游戏角色可能不知道自己是运行在Windows、Mac OS、安卓手机,还是别的什么操作系统上,因为它是独立于这些物质层面的。它也无法得知自己所栖身的计算机的逻辑门是由晶体管、光学电路,还是别的什么硬件实现的。甚至于,它们所依赖的基本物理定律是什么也无关紧要,只要这些定律允许通用计算机的存在即可。

总而言之,我认为意识是一种感觉起来十分“非物质”的物理现象,因为它就像波和计算一样,它的性质是独立于它的物质层面而存在的。这在逻辑上也符合“意识即信息”的思想。这就将我们引向了一个我十分青睐的激进思想:假如意识就是信息进行某些处理时的感觉,那它一定是独立于物质层面的;物质自身的结构并不重要,重要的是信息处理过程的结构。换句话说,意识具备双重“物质层面的独立性”。

正如我们所看到的那样,物理学描述了粒子在时空中移动的模式。如果粒子的排列遵循一定的原则,就会产生独立于粒子层面的涌现现象,并产生完全不同的感觉。计算质中的信息处理过程就是一个很好的例子。但我们现在已经把这个想法上升到了另一个层面:如果信息处理本身也服从某些原则,就会产生一个更高层次的涌现现象,也就是我们称之为“意识”的现象。这使得你的意识体验不是更上一层楼,而是更上了两层楼。难怪你的智能感觉起来一点都不像实实在在的物质。