KDD 2020 dual-view sequential learning inter-attention intra-attention dynamic external memory history attention memory classification Alibaba

Problem

本文是阿里云团队基于EHR(Electronic Health Record)辅助医疗诊断和用药决策的相关工作。(说白了就是用了一段时间的药,决定下一步用什么药)。

探讨问题是如何建模multi-seq的inter-view interactions。

抽象成算法问题即,在给定不同长度的sequence 和

时,通过发现两个Sequence之间的关系,来增强对目标的预测。

Method

解决思路:用Attention和MANN(Memory Augmented NeuralNetwork)提取和学习对偶序列信息。

重点解法是,通过 inter-attention (跨sequence的attention机制,把sequence和sequence之间的关联关系进行强化)

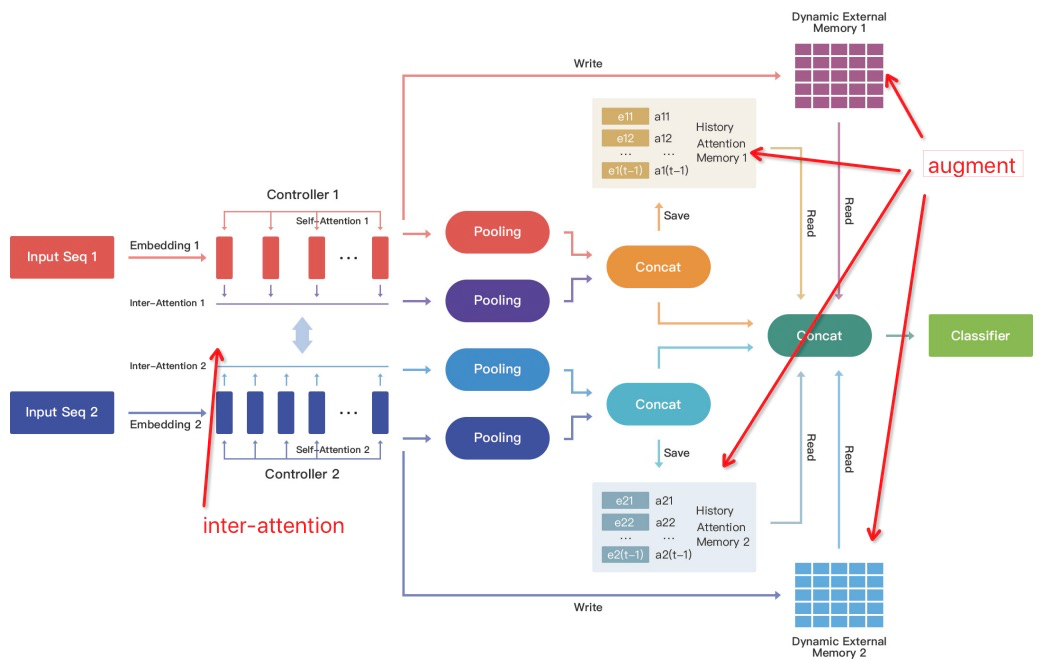

结构图如下,属于标准的工业界解法,像multi-head attention啥的,都是非常成熟的。重点关注论文的改进部分(红箭头标出)

Inter-Attention

Attention(Q, K, V) 中的Q从Seq 1来,K,V从Seq 2来。

Dynamic External Memory:

Ref:Hybrid computing using a neural network with dynamic external memory

文中提到了DNC:Differentiable Neural Computer

主要用来存放global-knowledge,当你认为所有的task具备一些domain knowledge的时候,可以用,另外在domain/task transfer/fusion的时候,也可以对每个domain/task设置一个memory来存放domain或task所特有的信息。

具体做法是对Self-Attention后的向量和一个矩阵相乘,再做mean-pooling。

History attention memory

为了捕获对象的历史contribution,把历史前k次vector embedding加权记录下来

其中是历史的权重,等于

学到。

Experiment

在EHR的ICU用药数据集上做了实验,根据病情和用药流程,预估下次用药类型。

DRG是指以出院患者信息为依据,综合考虑患者的主要诊断和主要治疗方式,结合个体体征如年龄、并发症和伴随病,将疾病的复杂程度和费用相似的病例分到同一个(DRG)组中,从而让不同强度和复杂程度的医疗服务之间有了客观对比依据。

DRG包含两个序列:诊断序列和治疗序列,对病患进行DRG分组。

Conclusion

两个Sequence的整合挺不错,可以考虑扩展到Multi-Sequence、Hierarchical-Sequence、Cross Domain/Task Sequence的协同学习。