前言

在日常说话时,我们懂得见人说人话,见鬼说鬼话。回到当前的语音产品,无论你是人是鬼,我都用同样的话语来应付你。怎样才能为语音交互赋予”见风使舵”的能力呢?其中最关键的一项输入参数,便是识别人的当前情绪。

情绪识别

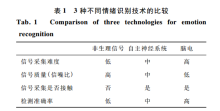

对应于不同的情绪诱发方法,情绪识别方法也各不相同,常见的情绪识别方法主要分成两大类:基于非生理信号的识别和基于生理信号的识别。基于非生理信号的情绪识别方法主要包括对面部表情和语音语调的识别。面部表情识别方法是根据表情与情绪间的对应关系来识别不同的情绪,在特定情绪状态下人们会产生特定的面部肌肉 运动和表情模式,如心情愉悦时嘴角角上翘,眼部会出现环形褶皱; 愤怒时会皱眉,睁大眼睛等。目前,面部表情识别多采用图像识别的方法来实现。语音语调识别方法是根据不同情绪状态下人们的语言表达方式的不同来实现的,如心情愉悦时说话的语调会比较欢快,烦躁时语调会比较沉闷。基于非生理信号识别方法的优点是操作简单,不需要特殊设备。缺点是不能保证情绪识别的可靠性,因为人们可以通过伪装面部表情和语音语调来掩饰自己的真实情绪,而这种伪装往往不易被发现。其次,对于患有某些特殊疾病的残疾人来说,基于非生理信号识别的方法往往难以实现。

基于生理信号的情绪识别方法,主要包括基于自主神经系统( autonomic nervous system) 的情绪识别和基 于 中 枢 神 经 系 统( central nervous system) 的情绪识别。基于自主神经系统的识别方法是指通过测量心率、皮 肤 阻 抗、呼吸等生理信号来识别对应的情绪状态。美国麻省理工学院的 Picard 等人通过对人体自主神经系统的测量和分析,识别出了平静、生气、厌恶、忧伤、愉悦、浪漫、开心和畏惧等 8 种不同的情绪。这些自主神经系统的生理信号虽然无法伪装,能够得到真 实 的 数 据,但 是 由 于 准 确率低且缺乏合理的评价标准,因此不太适合于实际应用。基于中枢神经系统的识别方法,是指通过分析不同情绪状态下大脑发出的不同信号来识别相应的情绪。这种方法不易被伪装,并且与其他生理信号识别方法相比识别率较高,因此越来越多的被应用于情绪 识 别研究。

语音情绪识别

对于车载语音来说,当前大部分的智能汽车都会搭载摄像头,通过摄像头对人脸进行识别,以及通过声音对情绪进行识别,两者叠加可以得到较为准确的情绪判断,而且在行车过程中,驾驶员的视线很少做大幅度频繁的变动,因此就让摄像头成功捕获到人脸的机率更大。但对于当前大部分的语音产品,其是不带摄像头的(考虑到现在好多产品都毫无底线的采集用户语音,要是带上摄像头,那这些企业就真的是360度无死角全方位监视你了),因此通过声音来识别情绪便成为了其主要的方法。

参考资料:

https://baike.baidu.com/item/%E6%83%85%E7%BB%AA%E8%AF%86%E5%88%AB/2053306?fr=aladdin