恭喜你完成了基础介绍章节。你在这个非常令人兴奋的领域有了一个很好的开端。在继续阅读本课程的其余部分之前,有几件简单的事情你应该知道,关于不同的人工智能及其工作原理。

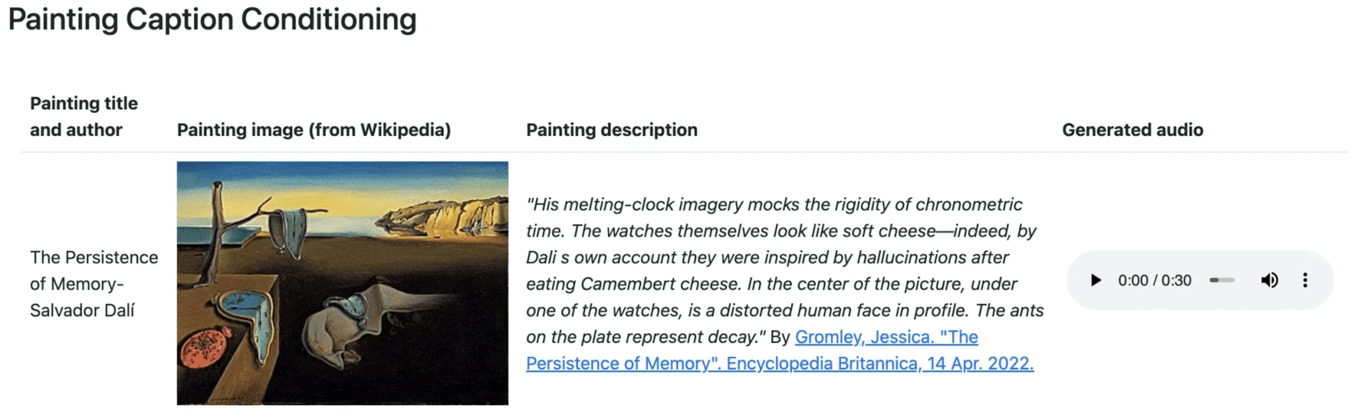

从图像生成音频

不同的人工智能们

成千上万,甚至可能有数百万个人工智能存在。有些可能要比另一些优秀。不同的人工智能可以生成图像、音乐、文本,甚至视频。请注意,这些都是生成人工智能,基本上是创造东西的人工智能。还有用于判别的人工智能,即分类事物的人工智能。例如,你可以使用图像分类器来确定一张图片是猫还是狗。在本课程中,我们不会使用任何判别人工智能。

目前仅有少数生成式人工智能足够先进,可以在提示工程中生效。在本课程中,我们主要使用 GPT-3 和 ChatGPT。正如我们在上一页中提到的那样,ChatGPT 是一个聊天机器人,而 GPT-3 不是。它们通常在回答相同问题时会产生不同的响应。如果你是开发人员,我建议使用 GPT-3,因为它更可复现的。如果你不是开发人员,我建议使用ChatGPT,因为它更易于使用。本课程中的大多数技术都可以应用于这两个人工智能。然而,其中一些技术只适用于 GPT-3,因此如果你想使用本课程中的所有技术的话,我们鼓励你使用 GPT-3。

在图像生成部分,我们还将使用 Stable Diffusion 和 DALLE。在这里可以查看更多相关的人工智能。

这些人工智能是如何工作的呢?

本节介绍了流行的生成式文本人工智能的方面。这些人工智能的大脑由数十亿个人工神经元组成。这些神经元的结构被称为 transformer 架构,它是一种相当复杂的神经网络类型。你需要了解的是:

- 这些人工智能只是数学函数。它们更像是f(成千上万的变量) = 成千上万种可能的输出,而不是 f(x)\=x2f(x) = x^2f(x)\=x2 这样的简单函数。

- 这些人工智能通过将句子分解成称为标记(tokens)的单词/子单词(例如,AI 可能将 “I don’t like” 作为 “”I”, “don”, “‘t” “like””)(译注:由于中文 token 化的表现形式和英文并不完全相同,这里保持英文示例,感兴趣的同学可以在 OpenAI 提供的在线工具自行体验)来理解句子。然后,每个标记都被转换为一组数字,以便人工智能进行处理。

- 这些人工智能根据前面的单词/标记预测句子中的下一个单词/标记(例如,人工智能可能会在 “I don’t like” 后面预测 “apples”)。它们写下的每个标记都基于它们以前看到和写下的标记;每次它们写下一个新标记时,它们都会停下来思考下一个标记应该是什么。

- 这些人工智能同时查看每个标记。它们不像人类那样从左到右或从右到左阅读。

请理解,“思考”、“大脑”和“神经元”这些词是拟人化的表述(zoomorphism),实际上是对模型所做的事情的比喻。这些模型并不真正思考,它们只是数学函数。它们不是真正的大脑,它们只是人工神经网络。它们不是真正的生物神经元,它们只是数字。

这是一个非常活跃的研究和哲学领域。这种描述与它们的本质相去甚远,旨在缓和大众媒体对人工智能作为像人类一样思考/行动的存在的描绘。话虽如此,如果你真的想拟人化人工智能,那就去做吧!似乎大多数人都这样做,这甚至可能有助于学习它们。

备注

- d2l.ai 是了解人工智能工作原理的好资源。