- 一、先创建一个master虚拟机配置一个主机,使用克隆在配置从机然后修改相关的配置

- 配置hosts

- 二、接着配置密钥,可以让彼此三台虚拟机进行无密码的登陆访问

- 生成公钥密钥对

- 将子节点的公钥拷贝到主节点并添加进authorized_keys

- 将主节点的authorized_keys文件分别替换子节点的authorized_keys文件

- 三、安装hadoop

- 四、配置hadoop配置文件(如果主机名字不是master的话下面所有配置的master全部变为你的自己主机名字)

- hadoop-env.sh中

- The java implementation to use.

export JAVA_HOME=/opt/java/jdk1.8.0_181

(红色为新添加的内容,其他的代码是文件中原有的)

# The jsvc implementation to use. Jsvc is required to run secure datanodes

# that bind to privileged ports to provide authentication of data transfer

# protocol. Jsvc is not required if SASL is configured for authentication of

# data transfer protocol using non-privileged ports.

#export JSVC_HOME=${JSVC_HOME}

export HDFS_NAMENODE_USER=root

export HDFS_DATANODE_USER=root

export HDFS_SECONDARYNAMENODE_USER=root

export YARN_RESOURCEMANAGER_USER=root

export YARN_NODEMANAGER_USER=root - User for YARN daemons

export HADOOP_YARN_USER=${HADOOP_YARN_USER:-yarn} - resolve links - $0 may be a softlink

export YARN_CONF_DIR=”${YARN_CONF_DIR:-$HADOOP_YARN_HOME/conf}”

# some Java parameters

export JAVA_HOME=/opt/java/jdk1.8.0_181

(红色为新添加的内容,其他的代码是文件中原有的)

一、先创建一个master虚拟机配置一个主机,使用克隆在配置从机然后修改相关的配置

1.先关闭主机防火墙:

service iptables stop

chkconfig iptables off

2.安装jdk,因为当前新建的一个虚拟机会有系统默认安装的jdk所以此时需要先删除当前安装的jdk版本信息,同时配置jdk的path路径

(1)、卸载master上原有的jdk

先查找当前的jdk版本:rpm -qa|grep jdk

然后删除当前系统默认安装的jdk版本:rpm -e —nodeps jdk-xxxxx

(2)、接着安装rz文件传输工具

yum list lrzsz

yum install lrzsz.x86_64

在目录/opt/java

使用rz命令上传jdk的tar包

jdk-8u181-linux-x64.tar.gz

解压jdk

tar -zxvfjdk-8u181-linux-x64.tar.gz

(3)添加环境变量:

vim /etc/profile

下面是在编辑下面加上的路径配置:

export JAVA_HOME=/opt/java/jdk1.8.0_181

export PATH=$JAVA_HOME/bin:$PATH

export CLASSPATH=$JAVA_HOME/lib:$JAVA_HOME/lib/dt.jar:$JAVA_HOME/lib/tools.jar

source /etc/profile

查看是否安装成功

java -version

3.设定固定ip

vim /etc/sysconfig/network-scripts/ifcfg-ens33

TYPE=”Ethernet”

PROXY_METHOD=”none”

BROWSER_ONLY=”no”

BOOTPROTO=”static”

DEFROUTE=”yes”

IPV4_FAILURE_FATAL=”no”

IPV6INIT=”yes”

IPV6_AUTOCONF=”yes”

IPV6_DEFROUTE=”yes”

IPV6_FAILURE_FATAL=”no”

IPV6_ADDR_GEN_MODE=”stable-privacy”

NAME=”ens33”

UUID=”94f69da1-f3e8-4879-988d-684752993352”

DEVICE=”ens33”

ONBOOT=”yes”

IPADDR=192.168.137.235

NETMASK=255.255.255.0

GATEWAY=192.168.137.1

DNS1=192.168.137.1

如果不能上网,虚拟机改成桥接模式,添加无线连接,与宿主机同一个网段。

设置网络时间或同步服务器时间。查系统时间命令: date

1设置网络时间:

上海

ntpdate ntp.api.bz

时区:

tzselect

生效:

cp /usr/share/zoneinfo/Asia/Shanghai /etc/localtime

4.设置主机名:

配置主节点名(192.168.137.235)

vim /etc/sysconfig/network

添加内容:

NETWORKING=yes

HOSTNAME=master

配置两台子节点名(192.168.137.236)和(192.168.137.237)这些在各自的机子上配置

vim /etc/sysconfig/network

添加内容:

NETWORKING=yes

HOSTNAME=slaver1

vim /etc/sysconfig/network

添加内容:

NETWORKING=yes

HOSTNAME=slaver2

5.设置hosts文件

配置hosts

打开主节点的hosts文件,要将文件的前两行注释掉 (注释当前主机的信息)并在文件中添加所有hadoop集群的主机信息。

vim /etc/hosts

192.168.137.235 master

192.168.137.236 slaver1

192.168.137.237 slaver2

保存之后,将主节点的hosts分别拷贝到其他两个子节点

scp /etc/hosts root@192.168.137.236:/etc/

scp /etc/hosts root@192.168.137.237:/etc/

然后分别执行(重启服务器也可以不执行下面的语句): /bin/hostsname hostsname

例如:master上执行 /bin/hostsname master,使之生效。

二、接着配置密钥,可以让彼此三台虚拟机进行无密码的登陆访问

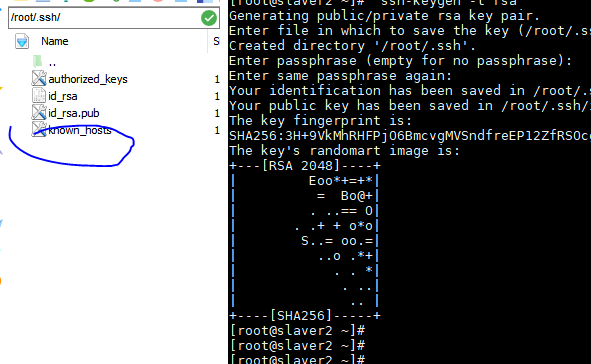

生成公钥密钥对

在每个节点上分别执行:

ssh-keygen -t rsa

一直按回车直到生成结束

执行结束之后每个节点上的/root/.ssh/目录下生成了两个文件 id_rsa 和 id_rsa.pub

其中前者为私钥,后者为公钥

在主节点上执行:

cp id_rsa.pub authorized_keys

将子节点的公钥拷贝到主节点并添加进authorized_keys

将两个子节点的公钥拷贝到主节点上,分别在两个子节点上执行:

scp ~/.ssh/id_rsa.pub root@master:~/.ssh/id_rsa_slaver1.pub

scp ~/.ssh/id_rsa.pub root@master:~/.ssh/id_rsa_slaver2.pub

然后在主节点上,将拷贝过来的两个公钥合并到authorized_keys文件中去

主节点上执行:

cat id_rsa_slaver1.pub>> authorized_keys

cat id_rsa_slaver2.pub>> authorized_keys

这里的配置方式可以有多种操作步骤,最终目的是每个节点上的/root/.ssh/authorized_keys文件中都包含所有的节点生成的公钥内容。

将主节点的authorized_keys文件分别替换子节点的authorized_keys文件

主节点上用scp命令将authorized_keys文件拷贝到子节点的相应位置

scp authorized_keys root@slaver1:/root/.ssh/

scp authorized_keys root@slaver2:/root/.ssh/

最后测试是否配置成功

在master上分别执行

ssh slaver1

ssh slaver2

能正确跳转到两台子节点的操作界面即可,同样在每个子节点通过相同的方式登录主节点和其他子节点也能无密码正常登录就表示配置成功。

如果不成功,配置下known_hosts 文件

三、安装hadoop

此时和jdk一样,我们需要在usr下面建立一个文件夹,用rz命令在创建的文件夹下面操作

在master主机上安装hadoop

wget https://mirrors.bfsu.edu.cn/apache/hadoop/common/hadoop-3.3.1/hadoop-3.3.1.tar.gz

安装位置自定,例如安装在/usr目录下面

下载hadoop包,放在/usr目录下,解压hadoop

tar -zxvf /usr/hadoop-3.3.1.tar.gz

在usr下面生成hadoop-3.3.1目录

配置环境变量:

vim /etc/profile

在末尾添加:

export HADOOP_HOME=/usr/ hadoop-3.3.1

export PATH=$PATH:$HADOOP_HOME/bin:$HADOOP_HOME/sbin

保存后使新编辑的profile生效:

source /etc/profile

四、配置hadoop配置文件(如果主机名字不是master的话下面所有配置的master全部变为你的自己主机名字)

需要配置的文件的位置为/hadoop-3..3.1/etc/hadoop,需要修改的有以下几个

core-site.xml:配置hadoop集群的元数据地址和数据访问入口地址,还可以配置权限

hdfs-site.xml:主键配置名称节点产生的元数据目录(dfs/name)和数据节点产生的数据目录(dfs/data),还可以配置文件副本数量

mapred-site.xml:这个文件在hadoop2.x里的功能被削弱,原本是用来配置MR任务需要占用的硬件资源的配置文件,还有secondeNameNode的地址。还可以配置资源调度算法。关于资源分配这部分被放入了yarn-site.xml里。

Yarn-site.xml:资源调度算法,MR任务执行过程资源默认占用配置。还有权限相关(比如多队列,多用户)

hadoop-env.sh

yarn-env.sh

core-site.xml

hdfs-site.xml

mapred-site.xml

yarn-site.xml

slaves

其中

hadoop-env.sh和yarn-env.sh里面都要添加jdk的环境变量:

hadoop-env.sh中

增加

export HDFS_NAMENODE_USER=root

export HDFS_DATANODE_USER=root

export HDFS_SECONDARYNAMENODE_USER=root

export YARN_RESOURCEMANAGER_USER=root

export YARN_NODEMANAGER_USER=root

The java implementation to use.

export JAVA_HOME=/opt/java/jdk1.8.0_181

(红色为新添加的内容,其他的代码是文件中原有的)

# The jsvc implementation to use. Jsvc is required to run secure datanodes

# that bind to privileged ports to provide authentication of data transfer

# protocol. Jsvc is not required if SASL is configured for authentication of

# data transfer protocol using non-privileged ports.

#export JSVC_HOME=${JSVC_HOME}

export HDFS_NAMENODE_USER=root

export HDFS_DATANODE_USER=root

export HDFS_SECONDARYNAMENODE_USER=root

export YARN_RESOURCEMANAGER_USER=root

export YARN_NODEMANAGER_USER=root

yarn-env.sh中

User for YARN daemons

export HADOOP_YARN_USER=${HADOOP_YARN_USER:-yarn}

resolve links - $0 may be a softlink

export YARN_CONF_DIR=”${YARN_CONF_DIR:-$HADOOP_YARN_HOME/conf}”

# some Java parameters

export JAVA_HOME=/opt/java/jdk1.8.0_181

(红色为新添加的内容,其他的代码是文件中原有的)

core-site.xml中

workers中

注释掉

localhost

添加:

master

slaver1

slaver2

拷贝hadoop安装文件到子节点

注意:这里我们修改hadopp的安装路径,要和我们master安装的路径保持一致

主节点上执行:

scp -r /usr/hadoop-3.3.1 root@slaver1:/usr

scp -r /usr/hadoop-3.3.1 root@slaver2:/usr

拷贝profile到子节点

主节点上执行:

scp /etc/profile root@slaver1:/etc/

scp /etc/profile root@slaver2:/etc/

在两个子节点上分别使新的profile生效:

source /etc/profile

格式化主节点的namenode

主节点上进入hadoop目录

然后执行:

./bin/hadoop namenode —format

新版本用下面的语句不用hadoop命令了

./bin/hdfs namenode —format

因为当前路径的位置有时命令变为hdfs namenode —format

提示:successfully formatted表示格式化成功

启动hadoop

主节点上在hadoop目录下执行:

注意:我们需要找到sbin目录上的当前路径进行执行

./sbin/start-all.sh

同理sbin/start-all.sh

停止: sbin/stop-all.sh

主节点上jps进程有:

NameNode

SecondaryNameNode

ResourceManager

每个子节点上的jps进程有:

DataNode

NodeManager

如果这样表示hadoop集群配置成功

验证:我们在浏览器上面输入主机的ip+50070

http://192.168.137.235:8088/cluster