控制器模式解析

k8s 项目通过一个称作"控制器模式"(controller pattern)的设计方法,来统一地实现对各种不同的对象或者资源进行的编排操作。#k8s核心就是用一个东西去控制另一个东西,所有的内容都是被控制的。容器镜像虽然好用,但是容器这样一个"沙盒"的概念,对于描述应用来说太过简单。好比,集装箱固然好用,如果它四面都光秃秃的,吊车还怎么把这个集装箱吊起来并摆放好呢?所以,Pod 对象,其实就是容器的升级版。它对容器进行了组合,添加了更多的属性和字段。这就好比给集装箱四面安装了吊环,使得 Kubernetes 这架"吊车",可以更轻松地操作它。而 k8s 操作这些"集装箱"的逻辑,都由控制器(Controller)完成

回顾 Deployment 这个最基本的控制器对象。之前讲过一个 nginx-deployment 的例子:

例1:

apiVersion: apps/v1

kind: Deployment

metadata:

name: nginx-deployment

spec:

selector:

matchLabels:

app: nginx

replicas: 2

template:

metadata:

labels:

app: nginx

spec:

containers:

- name: nginx

image: nginx:1.7.9

ports:

- containerPort: 80

这个 Deployment 定义的编排动作为:

确保携带了 app=nginx 标签的 Pod 的个数,永远等于 spec.replicas 指定的个数,即 2 个。如果在这个集群中,携带 app=nginx 标签的 Pod 的个数大于 2 的时候,就会有旧的 Pod 被删除;反之,就会有新的 Pod 被创建。

究竟是 Kubernetes 项目中的哪个组件,在执行这些操作呢?

kube-controller-manager 组件:这个组件,就是一系列控制器的集合

所有控制器:

deployment job podautoscaler

cloud disruption namespace

replicaset serviceaccount volume

cronjob garbagecollector nodelifecycle replication statefulSet daemonSet

上面的每一个控制器,都以独有的方式负责某种编排功能。而Deployment,正是这些控制器中的一种。

而被控制对象的定义,则来自于一个"模板"。比如,Deployment 里的 template 字段。

Deployment 这个 template 字段里的内容,跟一个标准的 Pod 对象的 API 定义,丝毫不差。而所有被这个 Deployment 管理的 Pod 实例,都是根据这个 template 字段的内容创建出来的。

对 Deployment 以及其他类似的控制器,做一个总结:

如图,类似 Deployment 的一个控制器,都是由两部分组成:

上半部分的控制器定义(包括期望状态)

下半部分的被控制对象的模板组成的。

也正是在这个统一的编排框架下,不同的控制器可以在具体执行过程中,设计不同的业务逻辑,从而达到不同的编排效果。

这个实现思路,正是 k8s 进行容器编排的核心原理。

项目:Nginx使用卷挂载

1.node1节点创建将要挂载目录,并写index.html

[root@k8s-node1 ~]# mkdir /var/data

[root@k8s-node1 ~]# cat /var/data/index.html

linux

2.创建deployment

[root@k8s-master prome]# cat nginx-dep1.yaml

apiVersion: apps/v1

kind: Deployment

metadata:

name: nginx-deployment

spec:

selector:

matchLabels:

app: nginx

replicas: 1

template:

metadata:

labels:

app: nginx

spec:

nodeName: k8s-node1 #必须指定调度到node1上,因为node1上才有/var/data目录

containers:

- name: nginx

image: daocloud.io/library/nginx

ports:

- containerPort: 80

volumeMounts: #定义挂载卷

- mountPath: "/usr/share/nginx/html"

name: nginx-vol

volumes: #定义共享卷

- name: nginx-vol

hostPath:

path: /var/data

3.创建service

[root@k8s-master prome]# cat nginx_svc.yaml

apiVersion: v1

kind: Service

metadata:

name: nginx-svc

spec:

type: NodePort

ports:

- port: 8081

nodePort: 30010

targetPort: 80

selector:

app: nginx

4.访问测试

弹性伸缩/滚动升级

概念:

将一个集群中正在运行的多个 Pod 版本,交替地逐一升级的过程,就是"滚动更新"。

实验:

[root@kub-k8s-master prome]# kubectl get deploy

NAME READY UP-TO-DATE AVAILABLE AGE

dep01 2/2 2 2 4h41m

nginx-deployment 2/2 2 2 5h13m

我们将nginx-deploument的副本数量变成4个,现在2个

[root@kub-k8s-master prome]# vim deployment.yaml #修改如下内容

将replicas: 2

修改为:

replicas: 4

创建上节儿的:nginx-deployment

[root@kub-k8s-master prome]# kubectl apply -f deployment.yaml --record

deployment.apps/nginx-deployment configured

--record 记录下每次操作所执行的命令,以方便后面查看

检查nginx-deployment 创建后的状态信息:

[root@kub-k8s-master prome]# kubectl get deploy

NAME READY UP-TO-DATE AVAILABLE AGE

dep01 2/2 2 2 4h53m

nginx-deployment 4/4 4 4 5h25m

返回结果中四个状态字段含义:

DESIRED:

如果有就表示用户期望的 Pod 副本个数(spec.replicas 的值);

CURRENT:

当前处于 Running 状态的 Pod 的个数;

UP-TO-DATE:

当前处于最新版本的 Pod 的个数,所谓最新版本指的是 Pod 的 Spec 部分与 Deployment 里 Pod 模板里定义的完全一致;

AVAILABLE:

当前已经可用的 Pod 的个数,即:既是 Running 状态,又是最新版本,并且已经处于 Ready(健康检查正确)状态的 Pod 的个数。只有这个字段,描述的才是用户所期望的最终状态。

修改 Deployment:

[root@kub-k8s-master prome]# kubectl get deploy

NAME READY UP-TO-DATE AVAILABLE AGE

dep01 2/2 2 2 4h59m

nginx-deployment 4/4 4 4 5h32m

将dep01的副本将2变为3个

[root@kub-k8s-master prome]# kubectl edit deployment/dep01

# reopened with the relevant failures.

#

apiVersion: apps/v1

...

spec:

progressDeadlineSeconds: 600

replicas: 3 #将这里原来的2改为3

revisionHistoryLimit: 10

selector:

matchLabels:

...

保存退出,vim的方式

[root@kub-k8s-master prome]# kubectl edit deployment/dep01

deployment.apps/dep01 edited

[root@kub-k8s-master prome]# kubectl get deploy

NAME READY UP-TO-DATE AVAILABLE AGE

dep01 3/3 3 3 5h16m

nginx-deployment 4/4 4 4 5h48m

进行版本的升级

创建一个新的deploy

[root@kub-k8s-master prome]# cp nginx-depl.yml nginx-depl02.yml

[root@kub-k8s-master prome]# vim nginx-depl02.yml

apiVersion: apps/v1

kind: Deployment

metadata:

name: dep02 #注意修改

spec:

selector:

matchLabels:

app: web1

replicas: 2

template:

metadata:

name: testnginx9

labels:

app: web1

spec:

containers:

- name: testnginx9

image: daocloud.io/library/nginx:1.14 #注意修改

ports:

- containerPort: 80

[root@kub-k8s-master prome]# kubectl apply -f nginx-depl02.yml

deployment.apps/dep02 created

[root@kub-k8s-master prome]# kubectl get pods

NAME READY STATUS RESTARTS AGE

dep01-58f6d4d4cb-997jw 1/1 Running 0 16m

dep01-58f6d4d4cb-g6vtg 1/1 Running 0 5h32m

dep02-78dbd944fc-47czr 1/1 Running 0 44s

dep02-78dbd944fc-4snsj 1/1 Running 0 25s

[root@k8s-node1 ~]# docker exec -it 7e491bb33dcd /bin/bash

root@dep02-8594cd6447-z5mzs:/# nginx -v

nginx version: nginx/1.14.2

将nginx的版本从1.14升级到1.16

[root@kub-k8s-master prome]# kubectl edit deployment/dep02

# Please edit the object below. Lines beginning with a '#' will be ignored,

# and an empty file will abort the edit. If an error occurs while saving this file will be

...

spec:

containers:

- image: daocloud.io/library/nginx:1.16 #将这里原来的nginx:1.14修改为nginx:1.16

imagePullPolicy: Always

name: testnginx9

ports:

- containerPort: 80

...

保存退出,vim的方式

[root@kub-k8s-master prome]# kubectl edit deployment/dep01

deployment.apps/dep01 edited

这时可以通过查看 Deployment 的 Events,看到这个”滚动更新”的流程:

[root@kub-k8s-master prome]# kubectl describe deployment dep02

...

Events:

Type Reason Age From Message

---- ------ ---- ---- -------

Normal ScalingReplicaSet 50s deployment-controller Scaled up replica set dep02-846bf8775b to 2

Normal ScalingReplicaSet 9s deployment-controller Scaled up replica set dep02-58f8d5678 to 1

Normal ScalingReplicaSet 8s deployment-controller Scaled down replica set dep02-846bf8775b to 1

Normal ScalingReplicaSet 8s deployment-controller Scaled up replica set dep02-58f8d5678 to 2

Normal ScalingReplicaSet 5s deployment-controller Scaled down replica set dep02-846bf8775b to 0

如此交替进行,新 ReplicaSet 管理的 Pod 副本数,从 0 个变成 1 个,再变成 2 个,最后变成 3 个。而旧的 ReplicaSet 管理的 Pod 副本数则从 3 个变成 2 个,再变成 1 个,最后变成 0 个。这样,就完成了这一组 Pod 的版本升级过程。

验证

[root@kub-k8s-master prome]# kubectl get pods

NAME READY STATUS RESTARTS AGE

dep02-78dbd944fc-69t8x 1/1 Running 0 11h

dep02-78dbd944fc-7cn86 1/1 Running 0 11h

[root@kub-k8s-master prome]# kubectl exec -it dep02-78dbd944fc-69t8x /bin/bash

root@dep02-78dbd944fc-69t8x:/# nginx -v

nginx version: nginx/1.16.1

root@dep02-78dbd944fc-69t8x:/# exit

“滚动更新”的好处:

在升级刚开始的时候,集群里只有 1 个新版本的 Pod。如果这时,新版本 Pod 有问题启动不起来,那么"滚动更新"就会停止,从而允许开发和运维人员介入。而在这个过程中,由于应用本身还有两个旧版本的 Pod 在线,所以服务并不会受到太大的影响。

版本回滚

查看版本历史

[root@kub-k8s-master prome]# kubectl rollout history deployment/dep02

deployment.apps/dep02

REVISION CHANGE-CAUSE

1 <none>

2 <none>

回滚到以前的旧版本:

把整个 Deployment 回滚到上一个版本:

[root@kub-k8s-master prome]# kubectl rollout undo deployment/dep02

deployment.apps/dep02 rolled back

查看回滚状态

[root@kub-k8s-master prome]# kubectl rollout status deployment/dep02

deployment "dep02" successfully rolled out

验证:

[root@kub-k8s-master prome]# kubectl get pods

NAME READY STATUS RESTARTS AGE

dep02-8594cd6447-pqtxk 1/1 Running 0 55s

dep02-8594cd6447-tt4h4 1/1 Running 0 51s

[root@kub-k8s-master prome]# kubectl exec -it dep02-8594cd6447-tt4h4 /bin/bash

root@dep02-8594cd6447-tt4h4:/# nginx -v

nginx version: nginx/1.14.2

回滚到更早之前的版本:

- 使用 kubectl rollout history 命令查看每次 Deployment 变更对应的版本。

[root@kub-k8s-master prome]# kubectl rollout history deployment/dep02

deployment.apps/dep02

REVISION CHANGE-CAUSE

2 <none>

3 <none>

由于在创建这个 Deployment 的时候,指定了—record 参数,所以创建这些版本时执行的 kubectl 命令,都会被记录下来。

查看每个版本对应的 Deployment 的 API 对象的细节:

[root@kub-k8s-master prome]# kubectl rollout history deployment/dep02 --revision=3

deployment.apps/dep02 with revision #3

Pod Template:

Labels: app=web1

pod-template-hash=8594cd6447

Containers:

testnginx9:

Image: daocloud.io/library/nginx:1.14

Port: 80/TCP

Host Port: 0/TCP

Environment: <none>

Mounts: <none>

Volumes: <none>

2.在 kubectl rollout undo 命令行最后,加上要回滚到的指定版本的版本号,就可以回滚到指定版本了。

[root@kub-k8s-master prome]# kubectl rollout undo deployment/dep02 --to-revision=2

deployment.apps/dep02 rolled back

验证:

[root@kub-k8s-master prome]# kubectl get pods

NAME READY STATUS RESTARTS AGE

dep02-78dbd944fc-8nvxl 1/1 Running 0 86s

dep02-78dbd944fc-sb9sj 1/1 Running 0 88s

[root@kub-k8s-master prome]# kubectl exec -it dep02-78dbd944fc-8nvxl /bin/bash

root@dep02-78dbd944fc-8nvxl:/# nginx -v

nginx version: nginx/1.16.1

课后了解

你听说过金丝雀发布(Canary Deployment)和蓝绿发布(Blue-Green Deployment)吗?你能说出它们是什么意思吗?

部署DASHBOARD应用

注意:最后部署成功之后,因为有5种方式访问dashboard:我们这里只使用Nodport方式访问

1. Nodport方式访问dashboard,service类型改为NodePort

2. loadbalacer方式,service类型改为loadbalacer

3. Ingress方式访问dashboard

4. API server方式访问 dashboard

5. kubectl proxy方式访问dashboard

1.下载yaml文件:

可以自己下载,也可以使用子目录中的内容自己创建

[root@kub-k8s-master ~]# wget wget https://raw.githubusercontent.com/kubernetes/dashboard/v2.4.0/aio/deploy/recommended.yaml

将名称空间修改为默认kube-system

[root@kub-k8s-master ~]# sed -i '/namespace/ s/kubernetes-dashboard/kube-system/g' recommended.yaml

2.下载镜像

由于yaml配置文件中指定的镜像

node节点机器都下载镜像,不下载,node节点会自动拉取

[root@kub-k8s-master ~]# docker pull kubernetesui/dashboard:v2.4.0

[root@kub-k8s-master ~]# docker pull kubernetesui/metrics-scraper:v1.0.7

3.修改yaml文件

NodePort方式:为了便于本地访问,修改yaml文件,将service改为NodePort 类型:

[root@kub-k8s-master ~]# vim recommended.yaml

...

30 ---

31

32 kind: Service

33 apiVersion: v1

34 metadata:

35 labels:

36 k8s-app: kubernetes-dashboard

37 name: kubernetes-dashboard

38 namespace: kube-system

39 spec:

40 type: NodePort #增加type: NodePort

41 ports:

42 - port: 443

43 targetPort: 8443

44 nodePort: 31260 #增加nodePort: 31260

45 selector:

46 k8s-app: kubernetes-dashboard

47

48 ---

4.创建应用:

[root@kub-k8s-master ~]# kubectl apply -f recommended.yaml

namespace/kubernetes-dashboard created

serviceaccount/kubernetes-dashboard created

service/kubernetes-dashboard created

secret/kubernetes-dashboard-certs created

secret/kubernetes-dashboard-csrf created

secret/kubernetes-dashboard-key-holder created

configmap/kubernetes-dashboard-settings created

role.rbac.authorization.k8s.io/kubernetes-dashboard created

clusterrole.rbac.authorization.k8s.io/kubernetes-dashboard created

rolebinding.rbac.authorization.k8s.io/kubernetes-dashboard created

clusterrolebinding.rbac.authorization.k8s.io/kubernetes-dashboard created

deployment.apps/kubernetes-dashboard created

service/dashboard-metrics-scraper created

deployment.apps/dashboard-metrics-scraper created

查看Pod 的状态为running说明dashboard已经部署成功:

[root@kub-k8s-master ~]# kubectl get pod -n kube-system -o wide | grep dashboard

Dashboard 会在 kube-system namespace 中创建自己的 Deployment 和 Service:

[root@kub-k8s-master ~]# kubectl get deployment kubernetes-dashboard -n kube-system

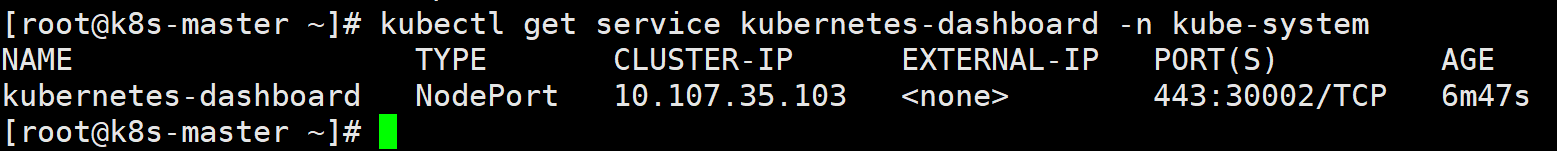

[root@kub-k8s-master ~]# kubectl get service kubernetes-dashboard -n kube-system

5.访问dashboard

官方参考文档:

查看service,TYPE类型已经变为NodePort,端口为31260

[root@kub-k8s-master ~]# kubectl get service -n kube-system | grep dashboard

kubernetes-dashboard NodePort 10.108.97.179 <none> 443:31260/TCP 101s

查看dashboard运行在那台机器上面

[root@kub-k8s-master ~]# kubectl get pods -n kube-system -o wide

通过浏览器访问:https://master:31260

因为我的应用运行在master上,又是NodePort方式,所以直接访问master的地址

登录界面如下(用火狐,别用谷歌):

Dashboard 支持 Kubeconfig 和 Token 两种认证方式,这里选择Token认证方式登录:

上面的Token先空着,不要往下点,接下来制作token

创建登录用户

1、利用命令行模式创建,并获取token

创建service account并绑定默认cluster-admin管理员集群角色:

# 创建用户

kubectl create serviceaccount dashboard-admin -n kube-system

# 用户授权

kubectl create clusterrolebinding dashboard-admin --clusterrole=cluster-admin --serviceaccount=kube-system:dashboard-admin

# 获取用户Token

kubectl describe secrets -n kube-system $(kubectl -n kube-system get secret | awk '/dashboard-admin/{print $1}')

2、利用yaml文件的方式创建用户并绑定clusterrole

官方参考文档:

https://github.com/kubernetes/dashboard/wiki/Creating-sample-user

创建dashboard-adminuser.yaml:

[root@kub-k8s-master ~]# vim dashboard-adminuser.yaml

---

apiVersion: v1

kind: ServiceAccount

metadata:

name: admin-user

namespace: kube-system

---

apiVersion: rbac.authorization.k8s.io/v1

kind: ClusterRoleBinding

metadata:

name: admin-user

roleRef:

apiGroup: rbac.authorization.k8s.io

kind: ClusterRole

name: cluster-admin

subjects:

- kind: ServiceAccount

name: admin-user

namespace: kube-system

执行yaml文件:

[root@kub-k8s-master ~]# kubectl create -f dashboard-adminuser.yaml

serviceaccount/admin-user created

clusterrolebinding.rbac.authorization.k8s.io/admin-user created

说明:上面创建了一个叫admin-user的服务账号,并放在kube-system命名空间下,并将cluster-admin角色绑定到admin-user账户,这样admin-user账户就有了管理员的权限。默认情况下,kubeadm创建集群时已经创建了cluster-admin角色,直接绑定即可。

查看admin-user账户的token

[root@kub-k8s-master ~]# kubectl -n kube-system describe secret $(kubectl -n kube-system get secret | grep admin-user | awk '{print $1}')

把获取到的Token复制到登录界面的Token输入框中:

成功登陆dashboard:

使用Dashboard

Dashboard 界面结构分为三个大的区域:

- 顶部操作区,在这里用户可以搜索集群中的资源、创建资源或退出。

- 左边导航菜单,通过导航菜单可以查看和管理集群中的各种资源。菜单项按照资源的层级分为两类:Cluster 级别的资源 ,Namespace 级别的资源 ,默认显示的是 default Namespace,可以进行切换

- 中间主体区,在导航菜单中点击了某类资源,中间主体区就会显示该资源所有实例,比如点击 Pods。

K8s持久化存储PV和PVC

1.PV和PVC的引入

Volume 提供了非常好的数据持久化方案,不过在可管理性上还有不足。

拿前面 AWS EBS 的例子来说,要使用 Volume,Pod 必须事先知道如下信息:

当前 Volume 来自 AWS EBS。

EBS Volume 已经提前创建,并且知道确切的 volume-id。

Pod 通常是由应用的开发人员维护,而 Volume 则通常是由存储系统的管理员维护。开发人员要获得上面的信息:

要么询问管理员。

要么自己就是管理员。

这样就带来一个管理上的问题:应用开发人员和系统管理员的职责耦合在一起了。如果系统规模较小或者对于开发环境这样的情况还可以接受。但当集群规模变大,特别是对于生成环境,考虑到效率和安全性,这就成了必须要解决的问题。

Kubernetes 给出的解决方案是 PersistentVolume 和 PersistentVolumeClaim。

PersistentVolume (PV) 是外部存储系统中的一块存储空间,由管理员创建和维护。与 Volume 一样,PV 具有持久性,生命周期独立于 Pod。

PersistentVolumeClaim (PVC) 是对 PV 的申请 (Claim)。PVC 通常由普通用户创建和维护。需要为 Pod 分配存储资源时,用户可以创建一个 PVC,指明存储资源的容量大小和访问模式(比如只读)等信息,Kubernetes 会查找并提供满足条件的 PV。

有了 PersistentVolumeClaim,用户只需要告诉 Kubernetes 需要什么样的存储资源,而不必关心真正的空间从哪里分配,如何访问等底层细节信息。这些 Storage Provider 的底层信息交给管理员来处理,只有管理员才应该关心创建 PersistentVolume 的细节信息。

2.通过NFS实现持久化存储

2.1 配置nfs

k8s-master nfs-server

k8s-node1 k8s-node2 nfs-client

所有节点安装nfs

yum install -y nfs-common nfs-utils

在master节点创建共享目录

[root@k8s-master k8s]# mkdir /nfsdata

授权共享目录

[root@k8s-master k8s]# chmod 666 /nfsdata

编辑exports文件

[root@k8s-master k8s]# vim /etc/exports

/nfsdata *(rw,no_root_squash,no_all_squash,sync)

配置生效

启动rpc和nfs(注意顺序)

[root@k8s-master k8s]# systemctl start rpcbind

[root@k8s-master k8s]# systemctl start nfs

作为准备工作,我们已经在 k8s-master 节点上搭建了一个 NFS 服务器,目录为 /nfsdata:

2.2 创建PV

下面创建一个 PV mypv1,配置文件 nfs-pv1.yml 如下:

[root@k8s-master ~]# vim nfs-pv1.yml

apiVersion: v1

kind: PersistentVolume

metadata:

name: mypv1

spec:

capacity:

storage: 1Gi

accessModes:

- ReadWriteOnce

persistentVolumeReclaimPolicy: Recycle

storageClassName: nfs

nfs:

path: /nfsdata

server: 192.168.153.148 #指定nfs目录所在的机器的地址

① capacity 指定 PV 的容量为 1G。

② accessModes 指定访问模式为 ReadWriteOnce,支持的访问模式有:

ReadWriteOnce – PV 能以 read-write 模式 mount 到单个节点。

ReadOnlyMany – PV 能以 read-only 模式 mount 到多个节点。

ReadWriteMany – PV 能以 read-write 模式 mount 到多个节点。

③ persistentVolumeReclaimPolicy 指定当 PV 的回收策略为 Recycle,支持的策略有:

Retain – 需要管理员手工回收。

Recycle – 清除 PV 中的数据,效果相当于执行 rm -rf /nfsdata/*。

Delete – 删除 Storage Provider 上的对应存储资源,例如 AWS EBS、GCE PD、Azure Disk、OpenStack Cinder Volume 等。

④ storageClassName 指定 PV 的 class 为 nfs。相当于为 PV 设置了一个分类,PVC 可以指定 class 申请相应 class 的 PV。

⑤ 指定 PV 在 NFS 服务器上对应的目录。

创建 mypv1:

[root@k8s-master ~]# kubectl apply -f nfs-pv1.yml

STATUS 为 Available,表示 mypv1 就绪,可以被 PVC 申请。

2.3 创建PVC

接下来创建 PVC mypvc1,配置文件 nfs-pvc1.yml 如下:

[root@k8s-master ~]# cat nfs-pvc1.yml

apiVersion: v1

kind: PersistentVolumeClaim

metadata:

name: mypvc1

spec:

accessModes:

- ReadWriteOnce

resources:

requests:

storage: 1Gi

storageClassName: nfs

PVC 就很简单了,只需要指定 PV 的容量,访问模式和 class。

执行命令创建 mypvc1:

[root@k8s-master ~]# kubectl apply -f nfs-pvc1.yml

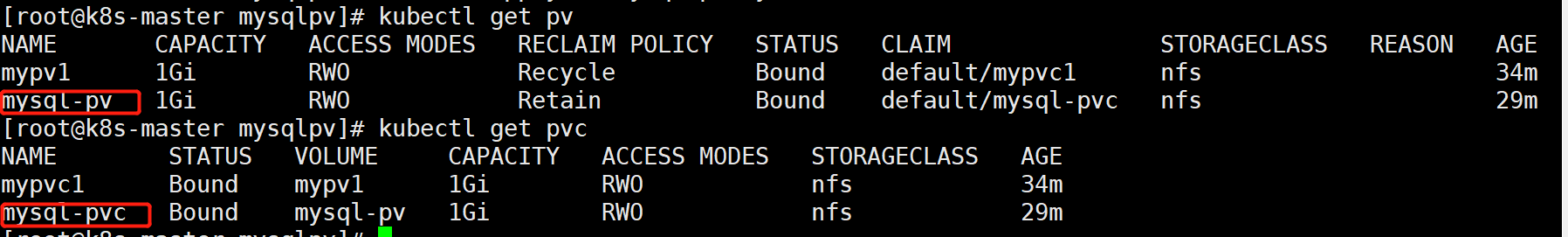

从 kubectl get pvc 和 kubectl get pv 的输出可以看到 mypvc1 已经 Bound 到 mypv1,申请成功。

2.4创建pod

上面已经创建好了pv和pvc,pod中直接使用这个pvc即可

[root@k8s-master ~]# cat pod1.yml

apiVersion: v1

kind: Pod

metadata:

name: mypod1

spec:

containers:

- name: mypod1

image: busybox

args:

- /bin/sh

- -c

- sleep 30000

volumeMounts:

- mountPath: "/mydata"

name: mydata

volumes:

- name: mydata

persistentVolumeClaim:

claimName: mypvc1

与使用普通 Volume 的格式类似,在 volumes 中通过 persistentVolumeClaim 指定使用 mypvc1 申请的 Volume。

通过命令创建mypod1:

[root@k8s-master ~]# kubectl apply -f pod1.yml

2.5验证

[root@k8s-master ~]# kubectl exec -it mypod1 /bin/sh

/ # ls mydata/

/ # echo "youngfit" > mydata/hello.txt

/ # ls mydata/

hello.txt

/ # exit

[root@k8s-master ~]# ls /nfsdata/ #也可在nfs的共享目录中查看到,说明卷共享成功

hello.txt

[root@k8s-master ~]# cat /nfsdata/hello.txt

youngfit

可见,在 Pod 中创建的文件 /mydata/hello.txt 确实已经保存到了 NFS 服务器目录 /nfsdata中。

如果不再需要使用 PV,可用删除 PVC 回收 PV。

在这里,可以尝试在任何一方删除文件,文件在两端都会消失;

3.PV的回收

当 PV 不再需要时,可通过删除 PVC 回收。未删除pvc之前 pv的状态是Bound

删除pod

[root@k8s-master pvc]# kubectl delete pod mypod1

删除pvc

[root@k8s-master pvc]# kubectl delete pvc mypvc1

再次查看pv的状态

[root@k8s-master pvc]# kubectl get pv

删除pvc之后pv的状态变为Available,,此时解除绑定后则可以被新的 PVC 申请。

/nfsdata文件中的文件被删除了

因为 PV 的回收策略设置为 Recycle,所以数据会被清除,

但这可能不是我们想要的结果。如果我们希望保留数据,可以将策略设置为 Retain

[root@k8s-master pvc]# vim nfs-pv1.yml

[root@k8s-master pvc]# kubectl apply -f nfs-pv1.yml

回收策略已经变为 Retain,通过下面步骤验证其效果:

重新创建mypvc1

[root@k8s-master pvc]# kubectl apply -f nfs-pvc1.yml

重新创建pod,引用mypvc1

[root@k8s-master pvc]# kubectl apply -f pod1.yml

进入pod中,创建文件

[root@k8s-master pvc]# kubectl exec -it mypod1 /bin/sh

/ # echo 'youngfit' > mydata/hello.txt

/ # ls mydata/

hello.txt

/ # exit

在nfs目录下检验

[root@k8s-master pvc]# ls /nfsdata/

hello.txt

[root@k8s-master pvc]# cat /nfsdata/hello.txt

youngfit

删除pod

[root@k8s-master pvc]# kubectl delete -f pod1.yml

pod "mypod1" deleted

[root@k8s-master pvc]# ls /nfsdata/

hello.txt

删除pvc(mypvc1)

[root@k8s-master pvc]# kubectl delete pvc mypvc1

persistentvolumeclaim "mypvc1" deleted

[root@k8s-master pvc]# ls /nfsdata/

hello.txt

[root@k8s-master pvc]# cat /nfsdata/hello.txt

youngfit

发现数据仍然保留

虽然 mypv1 中的数据得到了保留,但其 PV 状态会一直处于 Released,不能被其他 PVC 申请。为了重新使用存储资源,可以删除并重新创建 mypv1。删除操作只是删除了 PV 对象,存储空间中的数据并不会被删除。

[root@k8s-master pvc]# ls /nfsdata/

hello.txt

[root@k8s-master pvc]# kubectl delete pv mypv1

persistentvolume "mypv1" deleted

[root@k8s-master pvc]# ls /nfsdata/

hello.txt

[root@k8s-master pvc]# kubectl apply -f nfs-pv1.yml

persistentvolume/mypv1 created

[root@k8s-master pvc]# kubectl get pod

No resources found in default namespace.

[root@k8s-master pvc]# kubectl get pv

新建的 mypv1 状态为 Available,已经可以被 PVC 申请。

PV 还支持 Delete 的回收策略,会删除 PV 在 Storage Provider 上对应存储空间。NFS 的 PV 不支持 Delete,支持 Delete 的 Provider 有 AWS EBS、GCE PD、Azure Disk、OpenStack Cinder Volume 等。

4. PV/PVC的静态供给

所有节点下载nfs

yum install -y nfs-common nfs-utils

master节点作为nfs服务端

[root@k8s-master k8s]# cat /etc/exports

/data/opv *(rw,no_root_squash,no_all_squash,sync)

[root@k8s-master k8s]# mkdir /data/opv

[root@k8s-master k8s]# chmod 777 -R /data/opv

master节点操作

#1.定义pv

[root@k8s-master pvc2]# cat pv-pod.yaml

apiVersion: v1

kind: PersistentVolume

metadata:

name: my-pv

spec:

capacity:

storage: 5Gi

accessModes:

- ReadWriteMany

nfs:

path: /data/opv #nfs服务端共享的目录

server: 192.168.153.148 #nfs服务器的地址

[root@k8s-master pvc2]# kubectl apply -f pv-pod.yaml

#2.定义pvc和deployment

[root@k8s-master pvc2]# cat pvc-pod.yaml

apiVersion: apps/v1

kind: Deployment

metadata:

name: nginx-deployment

spec:

replicas: 2

selector:

matchLabels:

app: nginx

template:

metadata:

labels:

app: nginx

spec:

containers:

- name: nginx

image: daocloud.io/library/nginx

#启用数据卷的名字为wwwroot,并挂载到nginx的html目录下

volumeMounts:

- name: wwwroot

mountPath: /usr/share/nginx/html

ports:

- containerPort: 80

#定义数据卷名字为wwwroot,类型为pvc

volumes:

- name: wwwroot

persistentVolumeClaim:

claimName: my-pvc

---

# 定义pvc的数据来源,根据容量大小来匹配pv

apiVersion: v1

kind: PersistentVolumeClaim

metadata:

#对应上面的名字

name: my-pvc

spec:

accessModes:

- ReadWriteMany

resources:

requests:

storage: 5G

[root@k8s-master pvc2]# kubectl apply -f pvc-pod.yaml

#3,暴露一下端口

[root@k8s-master pvc2]# cat pv-service.yaml

apiVersion: v1

kind: Service

metadata:

name: pv-svc

spec:

type: NodePort

ports:

- port: 8080

nodePort: 30001

targetPort: 80

selector: #选择器

app: nginx

#4.nfs服务器操作

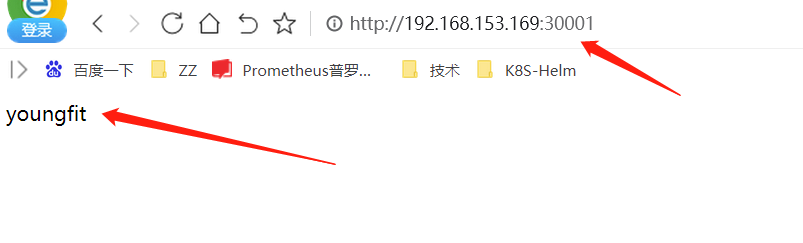

[root@k8s-master pvc2]# echo youngfit >> /data/opv/index.html

#5.访问,看效果

5.PV的动态供给

前面的例子中,我们提前创建了 PV,然后通过 PVC 申请 PV 并在 Pod 中使用,这种方式叫做静态供给(Static Provision)。

与之对应的是动态供给(Dynamical Provision),即如果没有满足 PVC 条件的 PV,会动态创建 PV。相比静态供给,动态供给有明显的优势:不需要提前创建 PV,减少了管理员的工作量,效率高。

动态供给是通过 StorageClass 实现的,StorageClass 定义了如何创建 PV,下面是两个例子。

StorageClass standard

StorageClass slow:

这两个 StorageClass 都会动态创建 AWS EBS,不同在于 standard 创建的是 gp2 类型的 EBS,而 slow 创建的是 io1 类型的 EBS。不同类型的 EBS 支持的参数可参考 AWS 官方文档。

StorageClass 支持 Delete 和 Retain 两种 reclaimPolicy,默认是 Delete。

与之前一样,PVC 在申请 PV 时,只需要指定 StorageClass 和容量以及访问模式,比如:

除了 AWS EBS,Kubernetes 支持其他多种动态供给 PV 的 Provisioner,完整列表请参考 https://kubernetes.io/docs/concepts/storage/storage-classes/#provisioner

6.PV&PVC在应用中的持久化存储

[root@k8s-master pv]# kubectl delete -f pod1.yml

[root@k8s-master pv]# cat pod1.yml

apiVersion: apps/v1

kind: Deployment

metadata:

name: mydep

spec:

selector:

matchLabels:

app: busy

replicas: 1

template:

metadata:

labels:

app: busy

spec:

containers:

- name: mypod1

image: busybox

args:

- /bin/sh

- -c

- sleep 30000

volumeMounts:

- mountPath: "/mydata"

name: mydata

volumes:

- name: mydata

persistentVolumeClaim:

claimName: mypvc1

[root@k8s-master pv]# kubectl apply -f pod1.yml

[root@k8s-master pv]# kubectl exec -it mydep-6b4f9c68b9-mqtcl /bin/sh

/ # echo youngfit > mydata/qf.txt

/ # exit

查看pod运行在了哪个节点,将节点关闭。发现另外一个节点,会接手,而且数据仍然存在

7.PV&PVC在应用在Mysql的持久化存储实战项目

下面演示如何为 MySQL 数据库提供持久化存储,步骤为:

- 创建 PV 和 PVC。

- 部署 MySQL。

- 向 MySQL 添加数据。

- 模拟节点宕机故障,Kubernetes 将 MySQL 自动迁移到其他节点。

- 验证数据一致性。

首先创建 PV 和 PVC,配置如下:

mysql-pv.yml

[root@k8s-master mysqlpv]# cat mysql-pv.yml

apiVersion: v1

kind: PersistentVolume

metadata:

name: mysql-pv

spec:

capacity:

storage: 1Gi

accessModes:

- ReadWriteOnce

persistentVolumeReclaimPolicy: Retain

storageClassName: nfs

nfs:

path: /nfsdata/mysql-pv

server: 192.168.153.148

[root@k8s-master mysqlpv]# kubectl apply -f mysqlpv.yml

mysql-pvc.yml

[root@k8s-master mysqlpv]# cat mysql-pvc.yml

apiVersion: v1

kind: PersistentVolumeClaim

metadata:

name: mysql-pvc

spec:

accessModes:

- ReadWriteOnce

resources:

requests:

storage: 1Gi

storageClassName: nfs

[root@k8s-master mysqlpv]# kubectl apply -f mysql-pvc.yml

接下来部署 MySQL,配置文件如下:

[root@k8s-master mysqlpv]# cat mysqlpod.yml

apiVersion: v1

kind: Service

metadata:

name: mysql

spec:

ports:

- port: 3306

selector:

app: mysql

---

apiVersion: apps/v1

kind: Deployment

metadata:

name: mysql

spec:

selector:

matchLabels:

app: mysql

template:

metadata:

labels:

app: mysql

spec:

containers:

- image: daocloud.io/library/mysql:5.7.5-m15 #这里的镜像一定要选对,能确保拉取到,而且能使用变量

name: mysql

env:

- name: MYSQL_ROOT_PASSWORD

value: password

ports:

- containerPort: 3306

name: mysql

volumeMounts:

- name: mysql-persistent-storage

mountPath: /var/lib/mysql

volumes:

- name: mysql-persistent-storage

persistentVolumeClaim:

claimName: mysql-pvc

[root@k8s-master mysqlpv]# kubectl apply -f mysqlpod.yml

PVC mysql-pvc Bound 的 PV mysql-pv 将被 mount 到 MySQL 的数据目录 /var/lib/mysql。

MySQL 被部署到 k8s-node1

① 切换到数据库 mysql。

② 创建数据库表 my_id。

③ 插入一条数据。

④ 确认数据已经写入。

关闭 k8s-node1,模拟节点宕机故障。

[root@k8s-master mysqlpv]# kubectl exec -it mysql-6654fcb867-mqtcl /bin/bash

root@mysql-6654fcb867-mqtcl:/# mysql -uroot -p'password'

mysql> create database feige;

mysql> create table feige.t1(id int);

mysql> insert into feige.t1 values(2);

[root@k8s-node1 ~]# poweroff

验证数据的一致性:

由于node1节点已经宕机,node2节点接管了这个任务,pod转移,需要等待一段时间,我这里等待了8分钟左右。。

进入新的pod中,数据仍然存在,持久化成功。很安全

[root@k8s-master mysqlpv]# kubectl exec -it mysql-6654fcb867-mqtcl /bin/bash

root@mysql-6654fcb867-mqtcl:/# mysql -uroot -p'password'

mysql> select * from feige.t1;

+------+

| id |

+------+

| 1 |

| 2 |

+------+

2 rows in set (0.01 sec)

MySQL 服务恢复,数据也完好无损。

8.PV/PVC动态供给项目实战

提前说明:由于本次动态实战,我在v1.22.2版本中,尝试多次未成功,采用了v1.19.0版本的k8s集群;

Dynamic Provisioning机制工作的核心在于StorageClass的API对象。

StorageClass声明存储插件,用于自动创建PV

当我们k8s业务上来的时候,大量的pvc,此时我们人工创建匹配的话,工作量就会非常大了,需要动态的自动挂载相应的存储

我们需要使用到StorageClass,来对接存储,靠他来自动关联pvc,并创建pv。

Kubernetes支持动态供给的存储插件:

https://kubernetes.io/docs/concepts/storage/storage-classes/

因为NFS不支持动态存储,所以我们需要借用这个存储插件。

nfs动态相关部署可以参考:

https://github.com/kubernetes-incubator/external-storage/tree/master/nfs-client/deploy

部署步骤:

8.0部署nfs

3个节点都下载:

# yum -y install nfs-utils rpcbind

主节点配置nfs服务端

[root@master pvc-test]# mkdir /opt/container_data

[root@master pvc-test]# chmod 777 -R /opt/container_data

[root@master pvc-test]# cat /etc/exports

/opt/container_data *(rw,no_root_squash,no_all_squash,sync)

[root@master pvc-test]# systemctl start rpcbind

[root@master pvc-test]# systemctl start nfs

8.1定义一个storage

[root@master pvc-test]# cat storageclass-nfs.yaml

apiVersion: storage.k8s.io/v1

kind: StorageClass

metadata:

name: managed-nfs-storage

provisioner: fuseim.pri/ifs

8.2部署授权

因为storage自动创建pv需要经过kube-apiserver,所以要进行授权

创建1个sa(serviceaccount)

创建1个clusterrole,并赋予应该具有的权限,比如对于一些基本api资源的增删改查;

创建1个clusterrolebinding,将sa和clusterrole绑定到一起;这样sa就有权限了;

然后pod中再使用这个sa,那么pod再创建的时候,会用到sa,sa具有创建pv的权限,便可以自动创建pv;

[root@master pvc-test]# cat rbac.yaml

apiVersion: v1

kind: ServiceAccount

metadata:

name: nfs-client-provisioner

---

kind: ClusterRole

apiVersion: rbac.authorization.k8s.io/v1

metadata:

name: nfs-client-provisioner-runner

rules:

- apiGroups: [""]

resources: ["persistentvolumes"]

verbs: ["get", "list", "watch", "create", "delete"]

- apiGroups: [""]

resources: ["persistentvolumeclaims"]

verbs: ["get", "list", "watch", "update"]

- apiGroups: ["storage.k8s.io"]

resources: ["storageclasses"]

verbs: ["get", "list", "watch"]

- apiGroups: [""]

resources: ["events"]

verbs: ["list", "watch", "create", "update", "patch"]

---

kind: ClusterRoleBinding

apiVersion: rbac.authorization.k8s.io/v1

metadata:

name: run-nfs-client-provisioner

subjects:

- kind: ServiceAccount

name: nfs-client-provisioner

namespace: default

roleRef:

kind: ClusterRole

name: nfs-client-provisioner-runner

apiGroup: rbac.authorization.k8s.io

8.3部署一个自动创建pv的服务

这里自动创建pv的服务由nfs-client-provisioner 完成

[root@master pvc-test]# cat deployment-nfs.yaml

kind: Deployment

apiVersion: apps/v1

metadata:

name: nfs-client-provisioner

spec:

selector:

matchLabels:

app: nfs-client-provisioner

replicas: 1

strategy:

type: Recreate

template:

metadata:

labels:

app: nfs-client-provisioner

spec:

# imagePullSecrets:

# - name: registry-pull-secret

serviceAccount: nfs-client-provisioner

containers:

- name: nfs-client-provisioner

#image: quay.io/external_storage/nfs-client-provisioner:latest

image: lizhenliang/nfs-client-provisioner:v2.0.0

volumeMounts:

- name: nfs-client-root

mountPath: /persistentvolumes

env:

- name: PROVISIONER_NAME

#这个值是定义storage里面的那个值

value: fuseim.pri/ifs

- name: NFS_SERVER

value: 172.17.0.21

- name: NFS_PATH

value: /opt/container_data

volumes:

- name: nfs-client-root

nfs:

server: 172.17.0.21

path: /opt/container_data

参数解释:

strategy:

type: Recreate

==========================================================================================

Recreate:设置spec.strategy.type=Recreate,该策略下将杀掉正在运行的Pod,然后创建新的。

RollingUpdate:设置spec.strategy.type=RollingUpdate,滚动更新,即逐渐减少旧Pod的同时逐渐增加新Pod。

其中默认的RollingUpdate滚动更新策略的“边删除边更新”保证了在更新期间的服务可用性,在使用这个策略时,有两个可定义参数:

spec.strategy.RollingUpdate.maxUnavailable:更新过程中Pod数量可以低于Pod期望副本的数量或百分比(默认25%)

spec.strategy.RollingUpdate.maxSurge:更新过程中Pod数量可以超过Pod期望副本的数量或百分比(默认25%)

创建:

[root@master pvc-test]# kubectl apply -f storageclass-nfs.yaml

[root@master pvc-test]# kubectl apply -f rbac.yaml

[root@master pvc-test]# kubectl apply -f deployment-nfs.yaml

查看创建好的storage:

[root@master storage]# kubectl get sc

nfs-client-provisioner 会以pod运行在k8s中,

[root@master storage]# kubectl get pod

NAME READY STATUS RESTARTS AGE

nfs-client-provisioner-855887f688-hrdwj 1/1 Running 0 77s

4、部署有状态服务,测试自动创建pv

部署yaml文件参考:https://kubernetes.io/docs/tutorials/stateful-application/basic-stateful-set/

我们部署一个nginx服务,让其html下面自动挂载数据卷,

[root@master pvc-test]# cat nginx.yaml

apiVersion: v1

kind: Service

metadata:

name: nginx

labels:

app: nginx

spec:

ports:

- port: 80

name: web

clusterIP: None

selector:

app: nginx

---

apiVersion: apps/v1

kind: StatefulSet

metadata:

name: web

spec:

serviceName: "nginx"

replicas: 2

selector:

matchLabels:

app: nginx

template:

metadata:

labels:

app: nginx

spec:

containers:

- name: nginx

image: nginx

ports:

- containerPort: 80

name: web

volumeMounts:

- name: www

mountPath: /usr/share/nginx/html

volumeClaimTemplates:

- metadata:

name: www

spec:

accessModes: [ "ReadWriteOnce" ]

storageClassName: "managed-nfs-storage"

resources:

requests:

storage: 1Gi

[root@master pvc-test]# kubectl apply -f nginx.yaml

1.20以后版本出现问题

问题描述

在部署 statefulset 类型的工作负载时,动态创建 PV/PVC 是一种比较常用的配置方式,动态创建 PV/PVC 的方法基本如下:

- 1、创建自己的 StorageClass 备用。

- 2、创建 statefulset ,在 yaml 文件的 volumeClaimTemplates 块,添加 StorageClass 的名字。

说回今天遇到的问题,在部署 VictoriaMetric 时,想使用阿里云的 nfs 做为外部存储,以进一步提高可用性。先使用 mysql 的 demo 案例(yaml 示例见这里 k8s-yaml-hub[1]),来测试下 statefulset 的在使用 nfs 时的分布情况。

一直启动不起来,查看 pvc 和 pods 信息如下:

- 1、PVC 一直处于 pending 状态;

- 2、mysql pods 显示:0/3 nodes are available: 3 pod has unbound immediate PersistentVolumeClaims.

原因分析

从上边的现象来看,是 PVC 没有创建成功,动态 PVC 中,是 provisioner 中来负责创建,查看其日志,看到如下错误信息:

Events:

Type Reason Age From Message

—— ——— —— —— ———-

Warning FailedScheduling 60m default-scheduler 0/3 nodes are available: 3 pod has unbound immediate PersistentVolumeClaims.

Warning FailedScheduling 60m default-scheduler 0/3 nodes are available: 3 pod has unbound immediate PersistentVolumeClaims.

Google 之后,找到主要原因是,官方在 k8s 1.20 中基于对性能和统一apiserver调用方式的初衷,移除了对 SelfLink 的支持,而 nfs-provisioner 需要 SelfLink 该项功能。

解决方法:

修改 apiserver 的配置文件,重新启用 SelfLink 功能。针对 K8S,可添加如下配置:

# /etc/kubernetes/manifests/kube-apiserver.yaml

spec:

containers:

- command:

- kube-apiserver

...

- --feature-gates=RemoveSelfLink=false # 增加

然后重启kubelet

systemctl restart kubelet

重新创建pod,提示创建成功

进入其中一个容器,创建一个文件:

[root@master pvc-test]# kubectl exec -it web-0 /bin/sh

# cd /usr/share/nginx/html

# touch 1.txt

直接在web-1的目录下,创建一个文件:

[root@master pvc-test]# touch /opt/container_data/default-www-web-1-pvc-5efd9492-c13d-414b-8df3-68b0c37961dd/2.txt

而且,删除一个pod web-0,数据仍然存在,不会丢失。保证了数据持久化;

小结

本章我们讨论了 Kubernetes 如何管理存储资源。

emptyDir 和 hostPath 类型的 Volume 很方便,但可持久性不强,Kubernetes 支持多种外部存储系统的 Volume。

PV 和 PVC 分离了管理员和普通用户的职责,更适合生产环境。我们还学习了如何通过 StorageClass 实现更高效的动态供给。

最后,我们演示了如何在 MySQL 中使用 PersistentVolume 实现数据持久性。