在不同的业务场景下,应该选择普通索引,还是唯一索引?

假设你在维护一个市民系统,每人都有一个唯一的身份证号。如果市民系统需要按照身份证号查姓名,就会执行SQL:

select name from CUser where id_card = 'xxxxxxxyyyyyyzzzzz';

- 所以,你一定会考虑在id_card字段上建索引。

由于身份证号字段较大,不建议把身份证号当做主键。那么现在有两个选择:要么给id_card字段创建唯一索引,要么创建一个普通索引。如果业务代码保证不会写入重复的身份证号,那么这两个选择逻辑上都正确。

现在我要问你的是,从性能的角度考虑,你选择唯一索引还是普通索引呢?选择的依据是什么呢?

简单起见,我们用第4篇文章《深入浅出索引(上)》中的例子来说明,假设字段 k 上的值都不重复。

图1 InnoDB的索引组织结构

接下来,我们就从这两种索引对查询语句和更新语句的性能影响来进行分析。

查询过程

假设执行查询 select id from T where k=5。这个查询语句在索引树上查找的过程:先从B+树树根开始,按层搜索到叶结点(图右下角的数据页),然后可以认为数据页内部通过二分法来定位记录。

- 对于普通索引来说,查找到满足条件的第一个记录(5,500)后,需要查找下一个记录,直到碰到第一个不满足k=5条件的记录。

- 对于唯一索引来说,由于索引定义了唯一性,查找到第一个满足条件的记录后,就停止继续检索。

那么,这个不同带来的性能差距会有多少呢?答案是,微乎其微。InnoDB的数据是按数据页为单位来读写的:当需要读一条记录的时候,并不是将这个记录本身从磁盘读出来,而是以页为单位,将其整体读入内存。在InnoDB中,每个数据页的大小默认是16KB。

因为引擎是按页读写的,所以,当找到k=5的记录时,它所在的数据页就都在内存里了。那么,对普通索引来说,要多做的那一次“查找和判断下一条记录”的操作,就只需要一次指针寻找和一次计算。

更新过程

为了说明普通索引和唯一索引对 更新语句性能 的影响,需要先跟你介绍一下change buffer。

当需要更新一个数据页时,

- 如果数据页在内存中就直接更新,

- 如果数据页没在内存中,在不影响数据一致性的前提下,InooDB会将这些更新操作缓存在change buffer中,这样就不必从磁盘读入数据页了。在下次查询访问这个数据页时,将数据页读入内存,然后执行change buffer中与这个页有关的操作。通过这种方式就能保证这个数据逻辑的正确性。

说明:change buffer是可以持久化的数据。即,change buffer在内存中有拷贝,也会被写入到磁盘上。

将change buffer中的操作应用到原数据页,得到最新结果的过程称为merge。

- 访问这个数据页会触发merge外,

- 系统有后台线程会定期merge。

- 在数据库正常关闭(shutdown)的过程中,也会执行merge操作。

显然,如果能将更新操作先记录在change buffer,减少读磁盘,语句的执行速度会得到明显的提升。而且,数据读入内存需要占用buffer pool,所以这种方式还能够避免占用内存,提高内存利用率。

那么,什么条件下可以使用change buffer呢?

- change buffer的机制

对于唯一索引:比如,要插入(4,400),就要先判断现在表中是否已经存在k=4的记录,而这必须要将数据页读入内存。如果都已经读入到内存了,那直接更新内存会更快,没必要使用change buffer。

因此,唯一索引的更新就不能使用change buffer,实际上也只有普通索引可以使用。

change buffer用的是buffer pool里的内存,不能无限增大。innodb_change_buffer_max_size=50,表示change buffer的大小最多只能占用buffer pool的50%。

- innodb处理插入流程

现在再看看如果要在这张表中插入一个新记录(4,400),InnoDB的处理流程是怎样的。

第一种情况是,这个记录要更新的目标页在内存中。这时,InnoDB的处理流程如下:

- 对于唯一索引来说,找到3和5之间的位置,判断到没有冲突,插入这个值,语句执行结束;

- 对于普通索引来说,找到3和5之间的位置,插入这个值,语句执行结束。

普通索引和唯一索引对更新语句性能影响的差别,只是一个判断,只耗费微小的CPU时间。但这不是关注的重点。

第二种情况是,这个记录要更新的目标页不在内存中。这时,InnoDB的处理流程如下:

- 对于唯一索引来说,需要将数据页读入内存,判断到没有冲突,插入这个值,语句执行结束;

- 对于普通索引来说,将更新记录在change buffer,语句执行就结束了。change buffer减少磁盘访问,更新性能明显提升。

总结

- 使用change buffer对更新过程的加速作用

- change buffer只限于用在普通索引的场景下,而不适用于唯一索引。

change buffer的使用场景

问题:普通索引的所有场景,使用change buffer都可以起到加速作用吗?

因为merge是真正进行数据更新的时刻,而change buffer是将记录的变更动作缓存下来。所以在一个数据页做merge之前,change buffer记录的变更越多(即:这个页面上要更新的次数越多),收益就越大。

因此,对于写多读少的业务来说,页面在写完以后马上被访问到的概率比较小,此时change buffer的使用效果最好。这种业务模型常见的就是账单类、日志类的系统。

反过来,假设一个业务的更新模式是写入之后马上会做查询,那么即使满足了条件,将更新先记录在change buffer,但之后由于马上要访问这个数据页,会立即触发merge过程。这样随机访问IO的次数不会减少,反而增加了change buffer的维护代价。

索引选择和实践

回到我们文章开头的问题,普通索引和唯一索引应该怎么选择?

其实,这两类索引在查询能力上没差别,主要考虑的是对更新性能的影响。所以尽量选择普通索引。

- 特例:如果所有的更新后面,都马上伴随着对这个记录的查询,那么你应该关闭change buffer。

- 实际使用,普通索引和change buffer的配合使用,对于数据量大的表的更新优化还是很明显的。

特别地,在使用机械硬盘时,change buffer这个机制的收效是非常显著的。所以,当你有一个类似“历史数据”的库,并且出于成本考虑用的是机械硬盘时,那你应该特别关注这些表里的索引,尽量使用普通索引,然后把change buffer 尽量开大,以确保这个“历史数据”表的数据写入速度。

change buffer 和 redo log

理解了change buffer的原理,你可能会联想到我在前面文章中和你介绍过的redo log和WAL。备注:这里,你可以再回顾下第2篇文章[《日志系统:一条SQL更新语句是如何执行的?》](https://time.geekbang.org/column/article/68633)。

现在在表上执行插入语句:mysql> insert into t(id,k) values(id1,k1),(id2,k2);

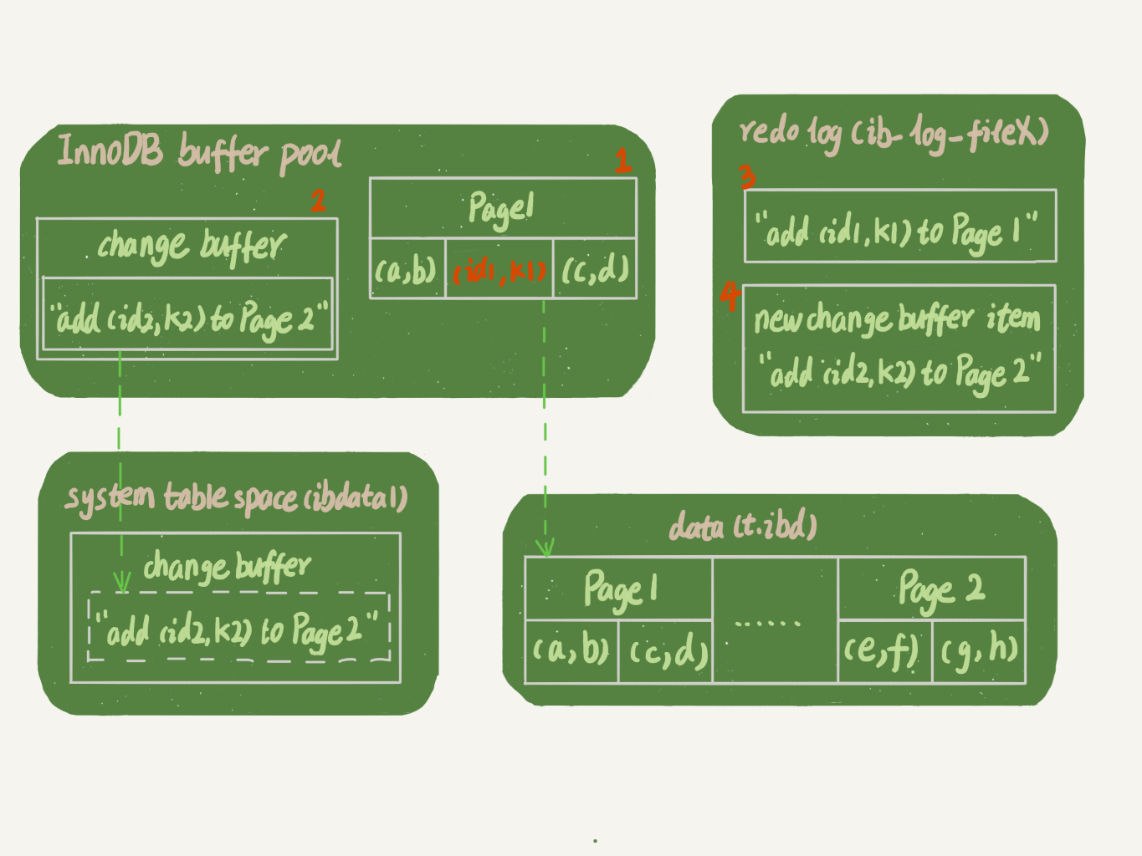

这里,假设当前k索引树的状态,查找到位置后,k1所在的数据页在内存(InnoDB buffer pool)中,k2所在的数据页不在内存中。如图2所示是带change buffer的更新过程状态图。

图2 带change buffer的更新过程

这条更新语句涉及四个部分:内存、redo log(ib_log_fileX)、 数据表空间 (t.ibd)、系统表空间 (ibdata1)

这条更新语句做了如下的操作(按照图中的数字顺序):

- Page 1在内存中,直接更新内存;

- Page 2没在内存中,就在内存的change buffer区域,记录下“我要往Page 2插入一行”这个信息

- 将上述两个动作记入redo log中(图中3和4)。

所以,执行这条更新语句的成本很低:写了两处内存,然后写了一处磁盘(两次操作合在一起写了一次磁盘),而且还是顺序写的。同时,图中的两个虚线箭头是后台操作,不影响更新的响应时间。

那在这之后的读请求,要怎么处理呢?

比如,执行 select from t where k in (k1, k2)。这里,我画了这两个读请求的流程图。

`如果读语句发生在更新语句后不久,*内存中的数据都还在,那么此时的这两个读操作就与系统表空间(ibdata1)和 redo log(ib_log_fileX)无关了。所以,我在图中就没画出这两部分。`

图3 带change buffer的读过程

从图中可以看到:

- 读Page 1的时候,直接从内存返回。有几位同学在前面问到,WAL之后如果读数据,是不是一定要读盘,是不是一定要从redo log里面把数据更新以后才可以返回?其实不用。图3这个状态中,虽然磁盘上还是之前的数据,但是这里直接从内存返回结果,结果是正确的。

- 要读Page 2的时候,需要把Page 2从磁盘读入内存中,然后应用change buffer里面的操作日志,生成一个正确的版本并返回结果。可以看到,直到需要读Page 2时,这个数据页才会被读入内存。

所以,简单地对比这两个机制在提升更新性能上的收益:redo log 主要节省的是随机写磁盘的IO消耗(转成顺序写),而change buffer主要节省的则是随机读磁盘的IO消耗。

小结

- 从普通索引和唯一索引的选择开始,和你分享了数据的查询和更新过程

- 然后说明了change buffer的机制以及应用场景,最后讲到了索引选择的实践。

- 由于唯一索引用不上change buffer的优化机制。因此从性能角度优先考虑非唯一索引。

思考题

通过图2你可以看到,change buffer一开始是写内存的,那么如果这个时候机器掉电重启,会不会导致change buffer丢失呢?change buffer丢失可不是小事儿,再从磁盘读入数据可就没有了merge过程,就等于是数据丢失了。会不会出现这种情况呢?

不会丢失。虽然是只更新内存,但是在事务提交的时候,我们把change buffer的操作也记录到redo log里了,所以崩溃恢复的时候,change buffer也能找回来。

merge的过程是否会把数据直接写回磁盘?这是个好问题。这里,我再为你分析一下。

merge的执行流程是这样的:

- 从磁盘读入数据页到内存(老版本的数据页);

- 从change buffer里找出这个数据页的change buffer 记录(可能有多个),依次应用,得到新版数据页;

- 写redo log。这个redo log包含了数据的变更和change buffer的变更。

到这merge过程就结束了。这时,数据页和内存中change buffer对应的磁盘位置都还没修改,属于脏页,之后各自刷回自己的物理数据,就是另外一个过程了。

补充:

评论区对“是否使用唯一索引”有较多讨论,主要纠结在“业务可能无法确保”的情况。这里说明一下:

- 首先,业务正确性优先。本文的前提是“业务代码已经保证不会写入重复数据”的情况下,讨论性能问题。如果业务不能保证,或者业务就是要求数据库来做约束,那没得选,必须创建唯一索引。此时,本文的意义在于:如果碰上了大量插入数据慢、内存命中率低时,可以提供一个排查思路。

- 然后,在一些“归档库”的场景,可以考虑使用唯一索引。比如,线上数据只需要保留半年,然后历史数据保存在归档库。这时候,归档数据已经是确保没有唯一键冲突了。要提高归档效率,可以考虑把表里面的唯一索引改成普通索引。