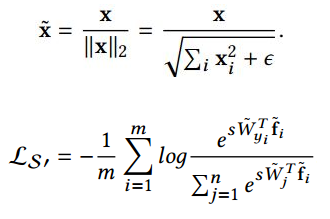

L2-Softmax与A-softmax不同,它并没有选择权重W归一化,而选择了对特征x 进行归一化,同时并乘尺度因子进行放大。

L2-softmax通过实验证明,进行特征归一化之后,每个类会变得更“窄”,例如在人脸数据上每个类的 feature 变得更加集中。

因此使用 feature normalization 之后,能让不同的类学出的 embedding在角度方向上更具有可区分性。

特征归一化后,特征向量都固定映射到半径为1的球面上,便于理解和优化,但这样也会压缩特征表达的空间;乘尺度因子s,相当于将特征放大到半径为S的超球面上。

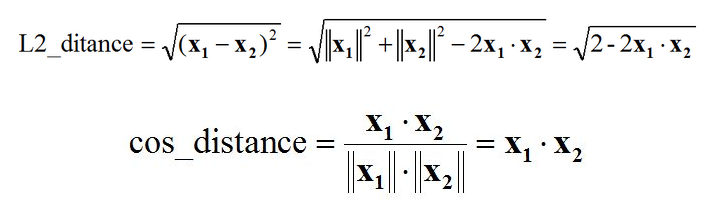

归一化特征之后,使用L2距离和cos距离计算人脸特征相似度时,两者意义等价,计算量也相同。