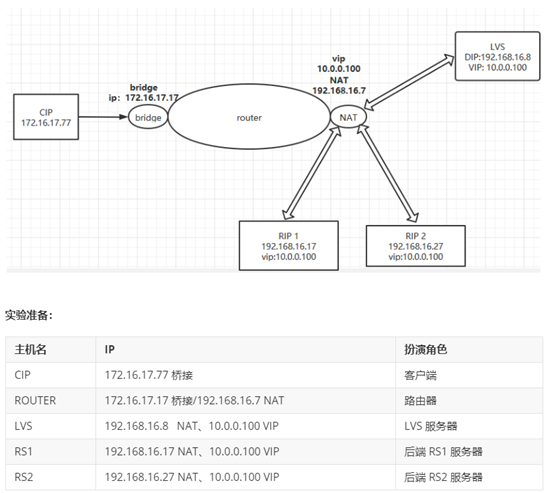

1、DR模式下vip不在同一网段上实现过程(夸网段)

1.1 准备客户机

配置客户机的网卡(桥接模式)

[root@client ~]# vim /etc/sysconfig/network-scripts/ifcfg-eth0BOOTPROTO="static"DEFROUTE="yes"NAME="eth0"DEVICE="eth0"ONBOOT="yes"IPADDR=172.16.17.77NETMASK=255.255.255.0GATEWAY=172.16.17.17DNS1=8.8.8.8

1.2 准备一台主机充当路由器

需要配置两个网卡接口

- eth0:172.16.17.17(桥接)

- eth1:192.168.16.7(NAT) ```bash [root@router ~]# vim /etc/sysconfig/network-scripts/ifcfg-eth0 NAME=”eth0” DEVICE=”eth0” ONBOOT=”yes” BOOTPROTO=”static” DEFROUTE=”yes” IPADDR=172.16.17.17 NETMASK=255.255.255.0 [root@router ~]# vim /etc/sysconfig/network-scripts/ifcfg-eth1 NAME=”eth1” DEVICE=”eth1” ONBOOT=”yes” BOOTPROTO=”static” DEFROUTE=”yes” IPADDR=192.168.16.7 NETMASK=255.255.255.0

[root@router ~]# echo ‘net.ipv4.ip_forward=1’ >> /etc/sysctl.conf [root@router ~]# sysctl -p

- 在eth1网卡在添加一个网段```baship addr add 10.0.0.0/24 dev eth1

1.3 准备两台后端real server

RS1和RS2的网卡配置一摸一样,仅ip地址不同

[root@RS1 ~]# vim /etc/sysconfig/network-scripts/ifcfg-eth0BOOTPROTO="static"DEFROUTE="yes"NAME="eth0"DEVICE="eth0"ONBOOT="yes"IPADDR=192.168.16.17NETMASK=255.255.255.0GATEWAY=192.168.16.7DNS1=8.8.8.8

修改后端RS的arp响应和通告级别,添加VIP地址

[root@RS1 ~]# echo 1 > /proc/sys/net/ipv4/conf/all/arp_ignore[root@RS1 ~]# echo 1 > /proc/sys/net/ipv4/conf/lo/arp_ignore[root@RS1 ~]# echo 2 > /proc/sys/net/ipv4/conf/all/arp_announce[root@RS1 ~]# echo 2 > /proc/sys/net/ipv4/conf/lo/arp_announce[root@RS1 ~]# ifconfig lo:1 10.0.0.100/32

1.4 配置LVS主机

[root@lvs ~]#cat /etc/sysconfig/network-scripts/ifcfg-eth0DEVICE=eth0NAME=eth0BOOTPROTO=staticIPADDR=192.168.16.8NETMASK=255.255.255.0GATEWAY=192.168.16.7ONBOOT=yes

1.5 测试

在后端RS两台服务器上装上httpd服务,并配置网页 ```bash [root@RS1 ~]# yum install -y httpd [root@RS1 ~]# hostname -I > /var/www/html/index.html [root@RS1 ~]# systemctl enable —now httpd

RS2同样的配置

- 实现LVS规则```bash[root@lvs ~]#dnf -y install ipvsadm[root@lvs ~]#ipvsadm -A -t 10.0.0.100:80 -s rr[root@lvs ~]#ipvsadm -a -t 10.0.0.100:80 -r 192.168.16.17:80 -g[root@lvs ~]#ipvsadm -a -t 10.0.0.100:80 -r 192.168.16.17:80 -g[root@lvs ~]#ipvsadm -LnIP Virtual Server version 1.2.1 (size=4096)Prot LocalAddress:Port Scheduler Flags-> RemoteAddress:Port Forward Weight ActiveConn InActConnTCP 10.0.0.100:80 rr-> 192.168.16.17:80 Route 1 0 0-> 192.168.16.27:80 Route 1 0 0

- 测试

[root@client ~]#curl 10.0.0.100192.168.16.17[root@client ~]#curl 10.0.0.100192.168.16.27

2、CentOS7.6 中 nfs 客户端使用 /etc/fstab 实现开机自动挂载

vim /etc/fstab10.0.0.8:/data/www /data/nfs nfs default,_netdev 0 0

3、CentOS7.6 中 nfs 客户端使用 autofs 实现使用 nfs 时实时挂载

3.1 首先在nfs服务器上创建一个共享目录

[root@nfs ~]# mkdir /data/www[root@nfs ~]# yum install -y nfs-utils[root@nfs ~]# vim /etc/exports/data/www *(rw)[root@nfs ~]# systemctl start nfs-server[root@nfs ~]# exportfs -v/data/www <world>(sync,wdelay,hide,no_subtree_check,sec=sys,rw,secure,root_squash,no_all_squash)[root@nfs ~]# echo "heihei" > /data/www/1.txt

3.2 在需要自动挂载的服务上执行以下命令

```bash [root@auto ~]# yum install -y autofs

在/etc/auto.master里面添加以下路径内容

/1/2/3 /etc/test.nfs

创建/etc/test.nfs文件

[root@auto ~]# vim /etc/test.nfs nfs -fstype=nfs 10.0.39.8:/data/www [root@auto ~]# systemctl start autofs

<a name="Gu2wK"></a>## 3.3 在自动挂载的服务器上测试```bash[root@auto ~]# tree /1/2/3//1/2/3/0 directories, 0 files[root@auto ~]# ls /1/2/3/nfs1.txt[root@auto ~]# cat /1/2/3/nfs/1.txtheihei[root@auto ~]# dfFilesystem 1K-blocks Used Available Use% Mounted ondevtmpfs 910300 0 910300 0% /devtmpfs 924716 0 924716 0% /dev/shmtmpfs 924716 8884 915832 1% /runtmpfs 924716 0 924716 0% /sys/fs/cgroup/dev/nvme0n1p5 157209600 2471056 154738544 2% //dev/nvme0n1p2 10475520 106160 10369360 2% /data/dev/nvme0n1p1 1998672 125584 1751848 7% /boottmpfs 184940 0 184940 0% /run/user/010.0.39.8:/data/www 10475520 105984 10369536 2% /1/2/3/nfs