主节点配置:

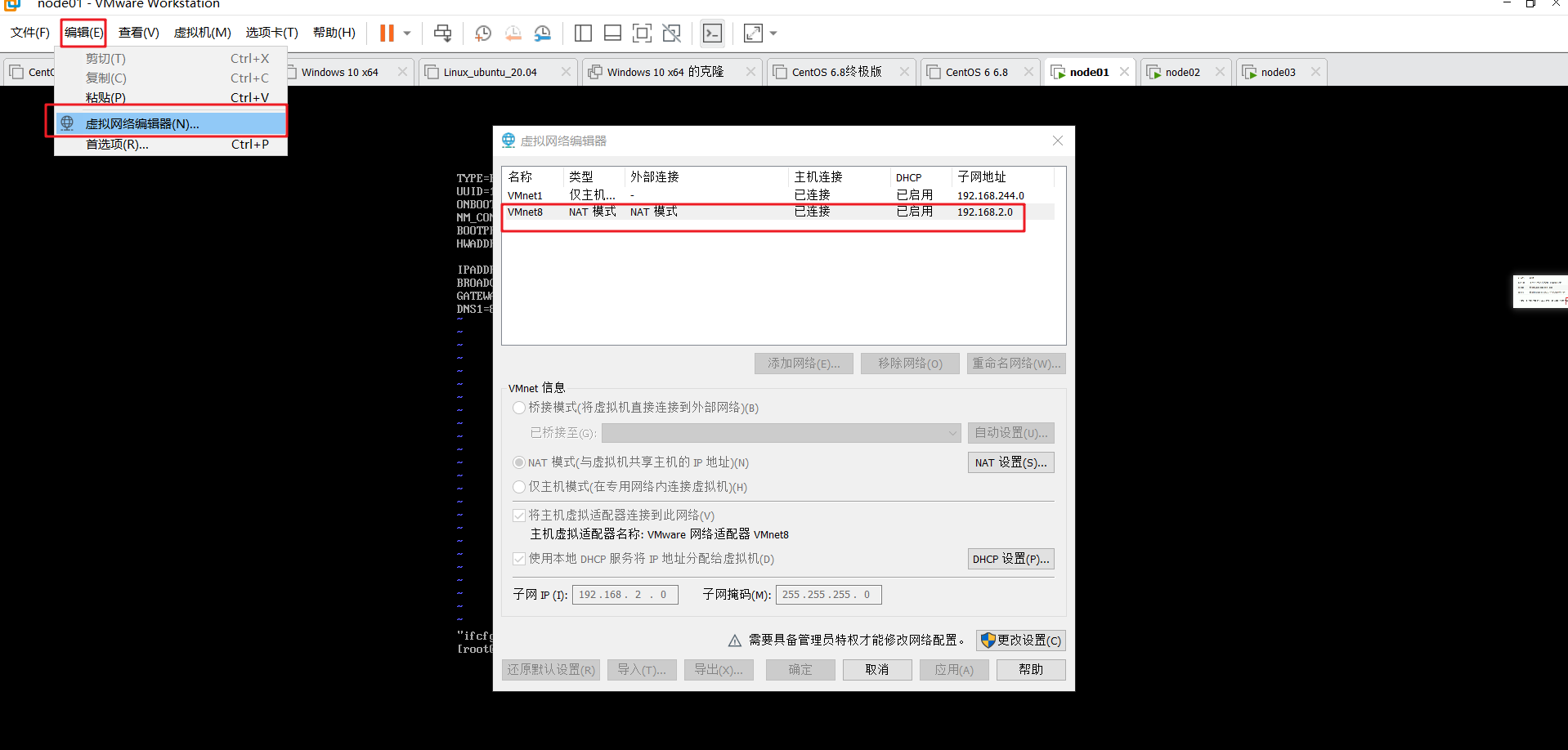

这个是在虚拟机中的设置,进入方法如下图:

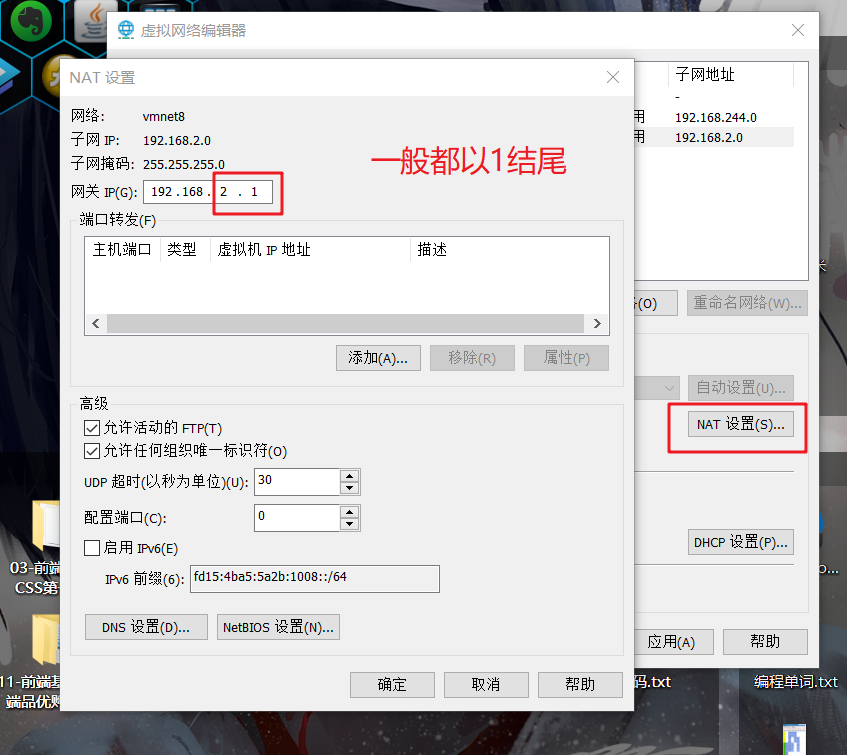

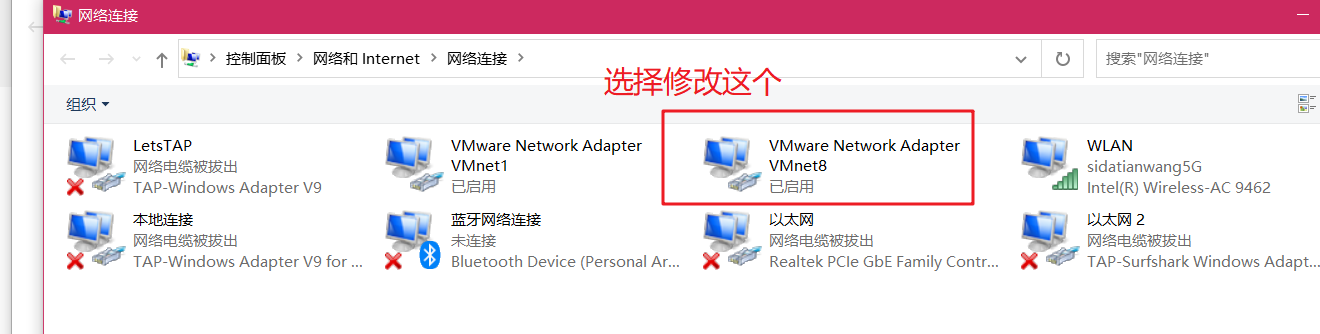

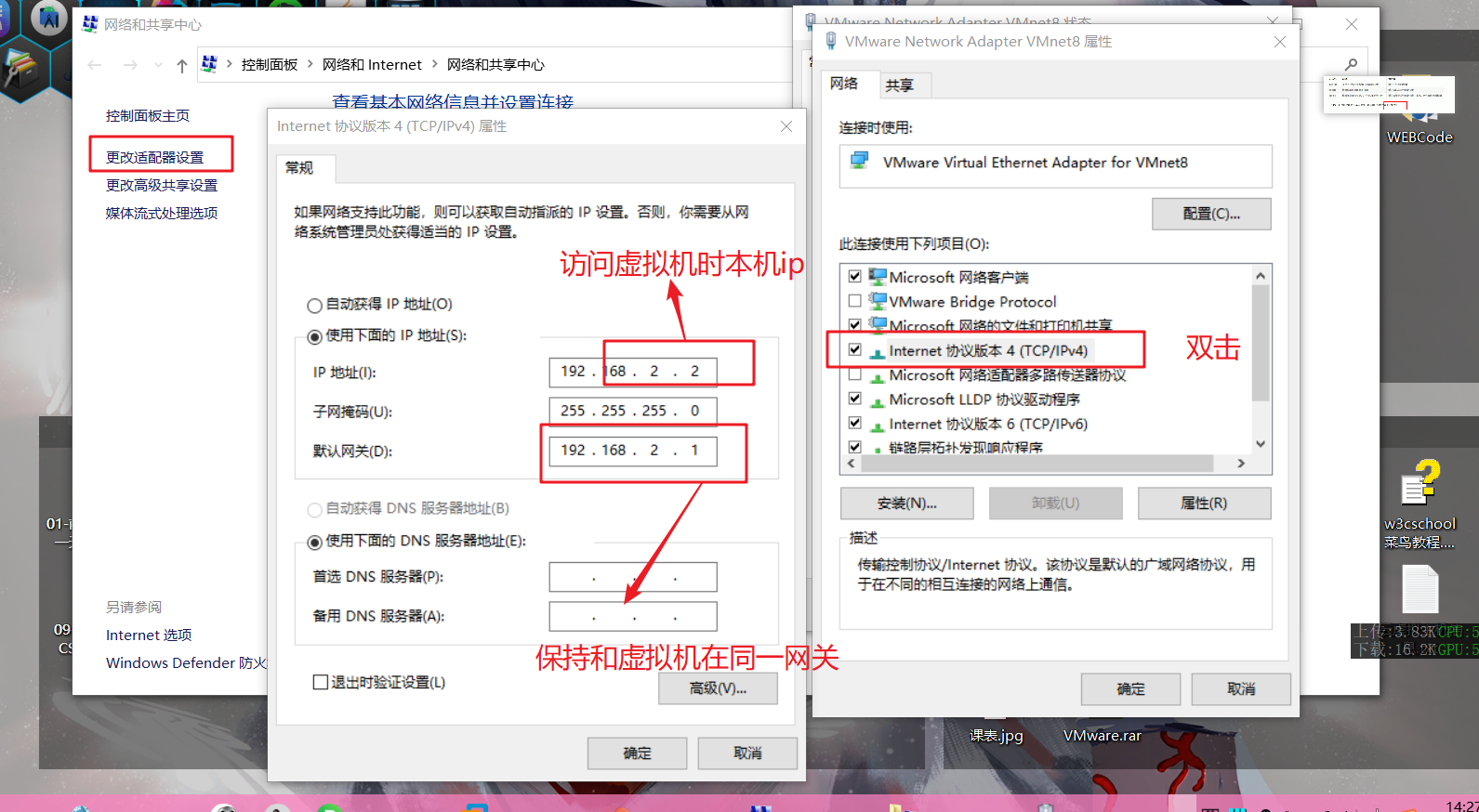

配置方法直接上图吧:

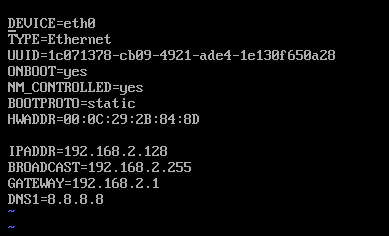

使用命令:vi /etc/sysconfig/network-scripts/ifcfg-eth0 修改文件如下:

下载需要的版本

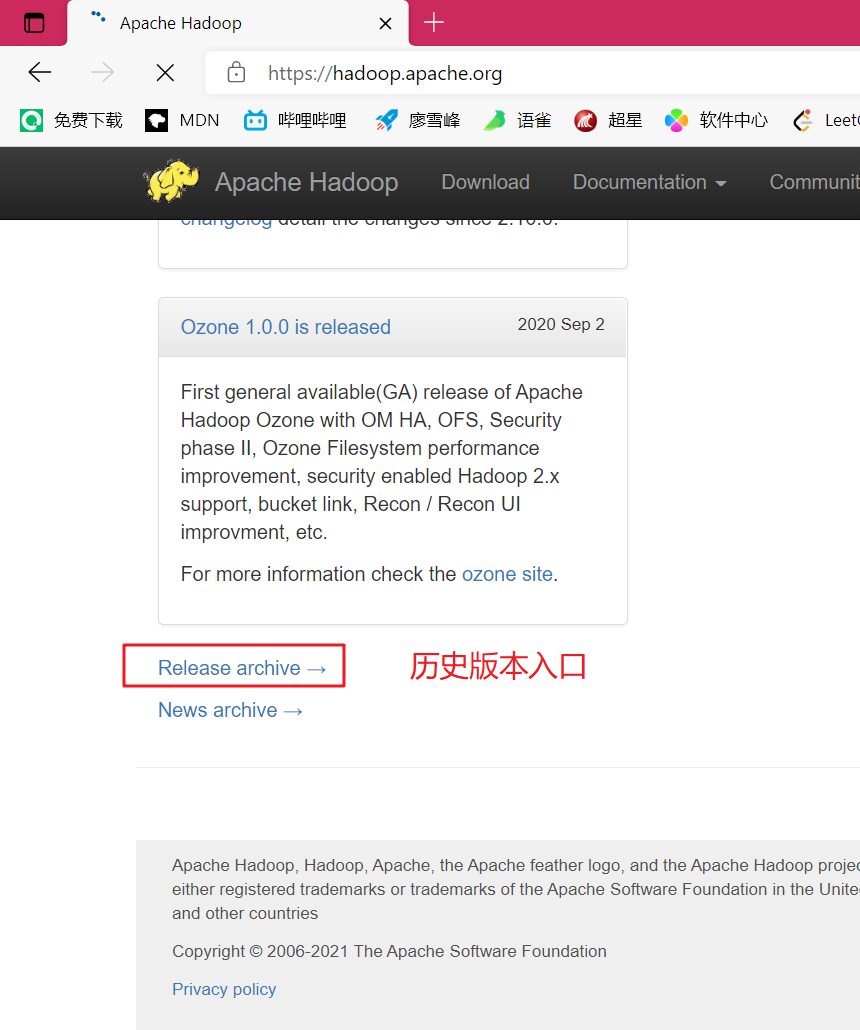

书上需要的版本比较老旧,所以说一下找历史版本的入口。

打开官网地址,打开后将页面拉到底部如下:

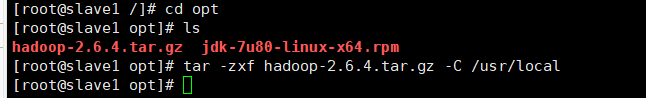

安装(解压)

安装命令:

tar -zxf hadoop-2.6.4.tar.gz -C /user/local

进入解压文件目录修改文件

cd /usr/local/hadoop-2.6.4/etc/hadoop/

修改配置文件

core-site.xml:这个是Hadoop的核心配置文件 ```xmlfs.defaultFS hdfs://slave1:8020 hadoop.tmp.dir /var/log/hadoop/tmp

将文件的内容修改如上,其中salve1是自己Linux的系统主机名,下面的那个是Hadoop的文件临时目录。- `hadoop-env.sh:`Hadoop运行基本环境的配置,需要修改JDK的实际位置,```xmlexport JAVA_HOME=/usr/java/jdk1.7.0_80

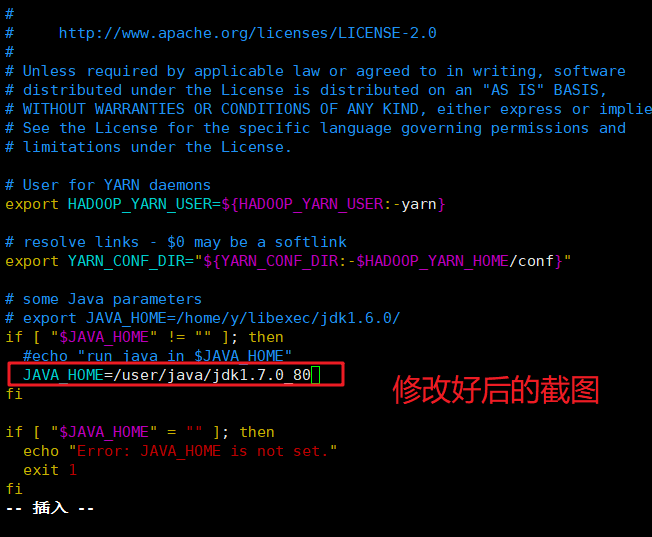

yarn-env.sh:YARN框架运行环境的配置,同样是修改JDK的安装位置。JAVA_HOME=/user/java/jdk1.7.0_80

mapred-site.xml:MapReduce的相关配置,这文件是由mapred-site.xml.template复制得到的,所以要使用下面发复制命令# cp mapred-site.xml.template mapred-site.xml修改后的文件: ```xml

mapreduce.framework.name yarn mapreduce.jobhistory.address slave1:10020 mapreduce.jobhistory.webapp.address slave1:19888

其中slave1是要修改为自己的电脑主机名。

- `yarn-site.xml:`YARN框架的配置。只用修改前面的主机名即可,后面的代码不用修改

```xml

<?xml version="1.0"?>

<configuration>

<property>

<name>yarn.resourcemanager.hostname</name>

<value>salve1</value>

</property>

<property>

<name>yarn.resourcemanager.address</name>

<value>${yarn.resourcemanager.hostname}:8032</value>

</property>

<property>

<name>yarn.resourcemanager.scheduler.address</name>

<value>${yarn.resourcemanager.hostname}:8030</value>

</property>

<property>

<name>yarn.resourcemanager.webapp.address</name>

<value>${yarn.resourcemanager.hostname}:8088</value>

</property>

<property>

<name>yarn.resourcemanager.webapp.https.address</name>

<value>${yarn.resourcemanager.hostname}:8090</value>

</property>

<property>

<name>yarn.resourcemanager.resource-tracker.address</name>

<value>${yarn.resourcemanager.hostname}:8031</value>

</property>

<property>

<name>yarn.resourcemanager.admin.address</name>

<value>${yarn.resourcemanager.hostname}:8033</value>

</property>

<property>

<name>yarn.nodemanager.local-dirs</name>

<value>/data/hadoop/yarn/local</value>

</property>

<property>

<name>yarn.log-aggregation-enable</name>

<value>true</value>

</property>

<property>

<name>yarn.nodemanager.remote-app-log-dir</name>

<value>/data/tmp/logs</value>

</property>

<property>

<name>yarn.log.server.url</name>

<value>http://master:19888/jobhistory/logs/</value>

<description>URL for job history server</description>

</property>

<property>

<name>yarn.nodemanager.vmem-check-enabled</name>

<value>false</value>

</property>

<property>

<name>yarn.nodemanager.aux-services</name>

<value>mapreduce_shuffle</value>

</property>

<property>

<name>yarn.nodemanager.aux-services.mapreduce.shuffle.class</name>

<value>org.apache.hadoop.mapred.ShuffleHandler</value>

</property>

<property>

<name>yarn.nodemanager.resource.memory-mb</name>

<value>2048</value>

</property>

<property>

<name>yarn.scheduler.minimum-allocation-mb</name>

<value>512</value>

</property>

<property>

<name>yarn.scheduler.maximum-allocation-mb</name>

<value>4096</value>

</property>

<property>

<name>mapreduce.map.memory.mb</name>

<value>2048</value>

</property>

<property>

<name>mapreduce.reduce.memory.mb</name>

<value>2048</value>

</property>

<property>

<name>yarn.nodemanager.resource.cpu-vcores</name>

<value>1</value>

</property>

</configuration>

slaves:改文件保存有slave节点的信息,在文件中添加下列代码即可slave1 slave2 slave3hdfs-site.xml:HDFS的相关配置文件。注意要修改主机名 ```xml <?xml version=”1.0” encoding=”UTF-8”?> <?xml-stylesheet type=”text/xsl” href=”configuration.xsl”?>

- 上述文件修改好后还要做主机间的映射,修改`/etc/hosts`文件,本次搭建了4台机器,所以要在文件后面添加下列代码,其中前面为每台机器的IP地址,都要做相应的修改。

```xml

192.168.2.128 master master.centos.com

192.168.2.130 slave1 slave1.centos.com

192.168.2.131 slave2 slave2.centos.com

192.168.2.132 slave3 slave3.centos.com

到此,主节点的配置就Ko了!