SVM原理

SVM是一种二类分类模型。它的基本模型是在特征空间中寻找间隔最大化的分离超平面的线性分类器。(间隔最大是它有别于感知机)

(1)当训练样本线性可分时,通过硬间隔最大化,学习一个线性分类器,即线性可分支持向量机。

(2)当训练数据近似线性可分时,引入松弛变量,通过软间隔最大化,学习一个线性分类器,即线性支持向量机:

(3)当训练数据线性不可分时,通过使用核技巧及软间隔最大化,学习非线性支持向量机。

注:以上各SVM的数学推导应该熟悉:硬间隔最大化(几何间隔)—-学习的对偶问题—-软间隔最大化(引入松弛变量)—-非线性支持向量机(核技巧)。

硬间隔

https://blog.csdn.net/qq_43601378/article/details/121971356

线性可分

支持向量到超平面的距离

软间隔

https://zhuanlan.zhihu.com/p/148598449

求软硬间隔的最优解

拉格朗日函数

- 引入

拉格朗日乘数法 | 约束条件/求极值 | 拉格朗日乘数法 | | —- | —- | |

|

|  |

|

|

|  |

|

(多了约束条件后的求解函数) |原始和对偶优化问题 | | 原始优化 | 对偶优化 | | —- | —- | —- | | 函数 |

|

|

|

| 说明 |

|

| 说明 |  |

|  |

|KKT条件

- 总结:

- 先把不等式约束条件转化为等式约束条件。 how?→ 引入 松弛变量,即KKT乘子

- 再把等式约束转化为无约束优化问题。 how? → 引入拉格朗日乘子

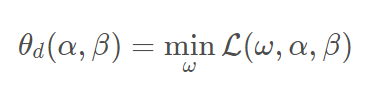

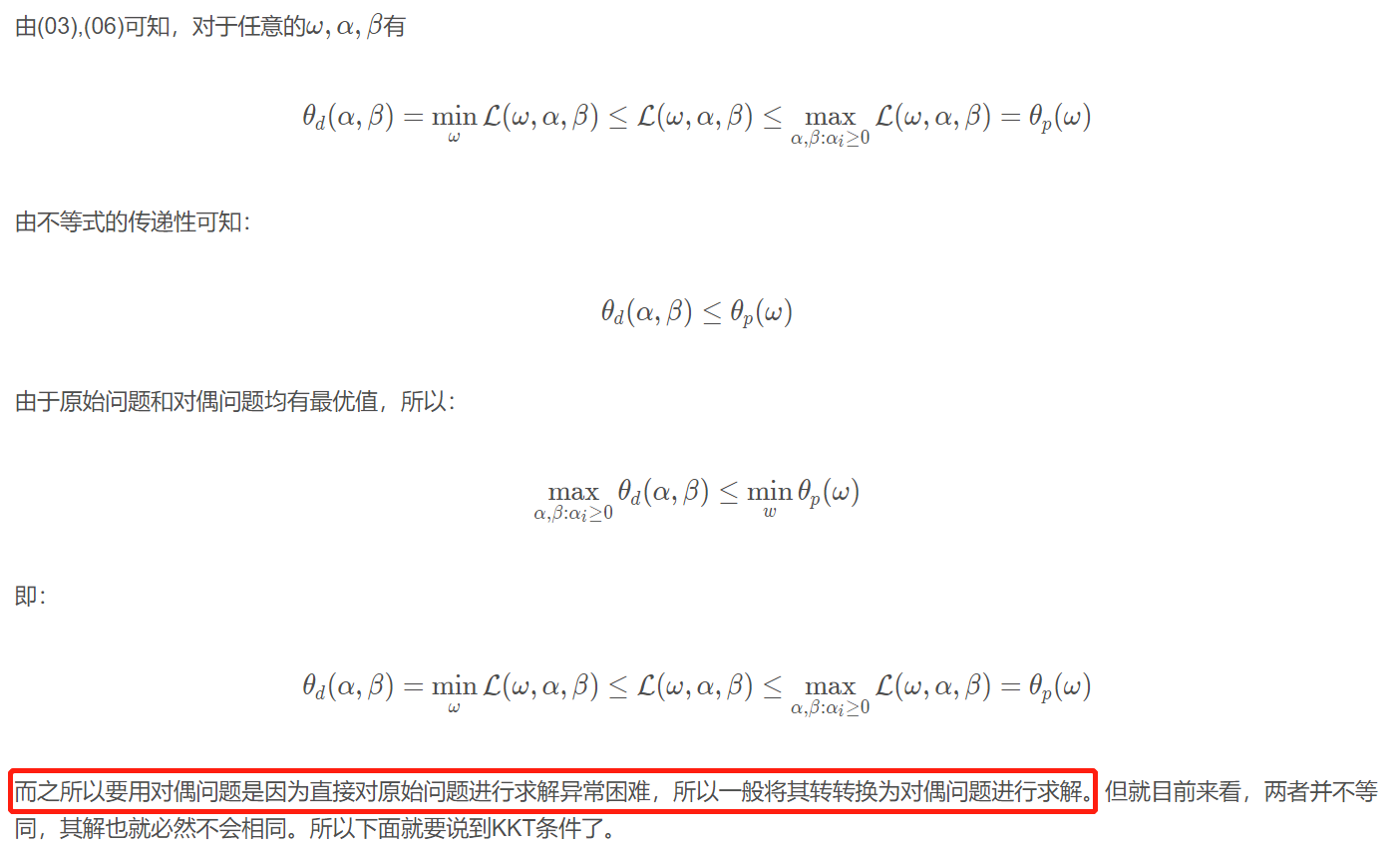

如果由于约束太多,求拉格朗日函数最优解不好求时,可以转化为对其对偶问题求解

KKT条件

KKT条件:用来求解不等式约束下最优问题

- 拉格朗日乘数法:可用来求解等式约束下最优化问题

具体求解过程

https://blog.csdn.net/the_lastest/article/details/78569092参考链接

https://zhuanlan.zhihu.com/p/149104728

https://blog.csdn.net/The_lastest/article/details/78574813