是什么

客户端的读请求可以被集群中的任意一台机器处理,如果读请求在节点上注册了监听器,这个监听器也是由所连接的 Zookeeper 机器来处理。

对于写请求,这些请求会同时发给其它 Zookeeper 机器并且达成一致后,请求才会返回。

因此,随着 Zookeeper 的集群机器增多,读请求的吞吐会提高但是写请求的吞吐会下降。

有序性是 Zookeeper 中非常重要的一个特性,所有的更新都是全局有序的,每个更新都有一个唯一的时间戳,这个时间戳称为 zxid(ZookeeperTransactionId)。也就是读请求的返回结果中会带有这个 Zookeeper 最新的 zxid。

提供了什么

- 文件系统

- 通知机制

Zookeeper提供一个多层级的节点命名空间(znode)。与文件系统不同的是,这些节点都可以设置关联的数据,而文件系统中只有文件节点可以存放数据而目录节点不行。

Zookeeper 为了保证高吞吐和低延迟,在内存中维护了这个树状的目录结果,这种特性使得 Zookeeper 不能用于存放大量的数据,每个节点的存放数据上限为 1M

四种类型的 znode

- persistent(持久化目录节点)

persistent_sequential(持久化顺序编号目录节点)

客户端与 Zookeeper 断开连接后,该节点依旧存储,只是 Zookeeper 给该节点名称进行顺序编号

ephemeral(临时目录节点)

- ephemeral_sequential(临时顺序编号目录节点)

通知机制

client 端会对某个 znode 建立一个 watcher 事件,当该 znode 发生变化时,这些 client 会受到 zk 的通知,然后 client 可以根据 znode 变化来做出业务上的改变等。

命名服务(文件系统)

配置管理(文件系统、通知机制)

集群管理(文件系统、通知机制)

所谓集群管理无外乎两点:是否有机器退出和加入、选举master。

对于第一点,所有机器约定在父目录下创建临时目录节点,然后监听父目录节点的子节点变化消息。一旦有机器挂掉,该机器与 zookeeper 的连接断开,其所创建的临时目录节点被删除,所有其它机器都收到通知。

对于第二点,所有机器创建临时顺序编号目录节点,每次选取编号最小的机器作为 master 就好。

分布式锁(文件系统、通知机制)

有了 zookeeper 的一致性文件系统,锁的问题变得容易。锁服务可以分为两类:一个是保持独占,另一个是控制时序。

对于第一类,我们将 zookeeper 上的一个 znode 看作是一把锁,通过 createznode 的方式来实现。所有的客户端都去创建 /distribute_lock 节点,最终成功创建的那个客户端也即拥有了这把锁。用完删除掉自己创建的 /distribute_lock 就释放出锁。

对于第二类,/distribute_lock 已经预先存在,所有客户端在它下面创建临时顺序编号目录节点,和 master 一样,编号最小的获得锁,用完删除,依次方便。

在获取分布式锁的时候在 locker 节点下创建顺序节点,释放锁的时候删除该临时节点。

- 客户端调用

createNode()方法在 locker 下创建临时顺序节点,然后调用getChildren("locker")来获取 locker 下面的所有子节点,注意此时不用设置任何的 watcher。- 客户端获取到所有的子节点 path 之后,如果发现自己创建的节点在所有创建的子节点中序号最小,那么就认为该客户端获取到了锁。反之说明自己还没获取到锁,此时客户端需要找到比自己小的那个节点,然后对其调用

exist()方法,同时对齐注册事件监听器。- 之后让这个被关注的节点删除,则客户端的 watch 会收到相应通知,此时在判断自己创建的节点是否是 locker 子节点是否是 locker 子节点中序号最小的,如果是则获取到了锁。

队列管理(文件系统、通知机制)

两种类型的队列:

同步队列:当一个队列的成员都聚齐时,这个队列才可用,否则一直等待所有成员到达

在约定目录下创建临时目录节点,监听节点数目是否我们要求的数目。

队列按照 FIFO 方式进行入队和出队操作。

和分布式锁服务中的控制时序场景基本原理一致,入列有编号,出列按编号。 在特定的目录下创建 persistent_sequential 节点,创建成功时 wather 通知等待的队列,队列删除序列中最小的节点用以消费。 此场景下 zookeeper 的 znode 用于消息存储,znode 存储的数据就是消息队列中的消息内容,sequential 序列号就是消息的编号,按序取出即可。由于创建的节点是持久化的,所以不必担心队列消息的丢失问题。

数据复制

从客户端读写访问的透明度来看,数据复制集群系统分为下面两种:

写主(WriteMaster)

对数据的修改提交给指定的节点。读无此限制,可以读取任何一个节点。这种情况下客户端需要对读与写进行区别,俗称读写分离。

写任意(WriteAny)

对数据的修改可提交给任意的节点,跟读一样。这种情况下,客户端对集群节点的角色与变化透明。 对 zookeeper 来说,它采用的方式是写任意。通过增加机器,它的读吞能力和响应能力扩展性非常好,而写,随着机器的增多吞吐能力肯定下降(这也是它建立 ovserver 的原因),而响应能力取决于具体实现方式,是延迟复制保持最终一致性,还是立即复制快速响应。

工作原理

zookeeper 的核心是原子广播,这个机制保证了各个 Server 之间的同步。实现这个机制的协议叫做 zab 协议。zab 协议有两种模式:恢复模式(选主)和广播模式(同步)。

当服务启动或者在领导者崩溃后,zab 就进入了恢复模式,当领导者别选举出来,且大多数 Server 完成了和 Leader 的状态同步以后,恢复模式就结束了。状态同步保证了 leader 和 Server 具有相同的系统状态。

如何保证事务的顺序一致性

zookeeper 采用了递增的事务 Id 来标识,所有的 proposal(提议)都在被提出的时候加上了 zxid,zxid 实际上是一个 64 位的数字。

高 32 位是 epoch 用来标识 leader 是否发生变化,如果有新的 leader 产生出来,epoch 会自增。

低 32 位用来递增计数。当新产生 proposal 的时候,会依据数据库两阶段过程,首先会向其它的 server 发出事务执行请求,如果超过半数的机器都能执行并且能够成功,那么就会开始执行。

Server 工作状态

- LOOKING:当 Server 不知道 leader 是谁,正在搜寻

- LEADING:当前 Server 即为选举出来的 leader

- FOLLOWING:leader 已经选举出来,当前 Server 与之同步

如何选主 leader

当 leader 崩溃或者 leader 失去大多数的 follower,这时 zk 进入恢复模式,恢复模式需要重新选举出一个新的 leader,让所有的 Server 都恢复到一个正确的状态。

zk 的选举算法有两种:一种是基于 basicpaxos 实现的,另外一种是基于 fastpaxos 算法实现的。系统默认的选举算法为 fastpaxos。

选主流程(basicpaxos)

- 选举线程由当前 Server 发起选举的线程担任,其主要功能是对投票结果进行统计,并选出推荐的 Server

- 选举线程首先向所有 Server 发起一次询问(包括自己)

- 选举线程收到回复后,验证是否是自己发起的询问(验证 zxid 是否一致),然后获取对方的 id(myid),并存储到当前询问列表中,最后获取对方提议的 leader 相关信息(id,zxid),并将这些信息存储到当此选举的投票记录表中

- 收到所有 Server 的回复以后,就计算出 zxid 最大的那个 Server,并将这个 Server 相关信息设置成下一次要投票的 Server

- 线程将当前 zxid 最大的 Server 设置为当前 Server 要推荐的 leader,如果此时获胜的 Server 获得 n/2+1 的 Server 票数,设置当前推荐的 leader 为获胜的 Server,将根据获胜的 Server 相关信息设置自己的状态,否则,继续这个过程,直到 leader 被选举出来。

通过流程分析我们可以得出:

- 要使 leader 获得多数 Server 的支持,则 Server 总数必须是 2n+1,且存活的Server 数目不得少于 n+1。每个 Server 启动后都会重复以上流程。

- 在恢复模式下,如果是刚从崩溃状态恢复的或者刚启动的 Server 还会从磁盘快照中恢复数据和会话信息,zk 会记录事务日志并定期进行快照,方便在恢复时进行状态恢复

fastpaxos 流程是在选举工程中,某 Server 首先向所有 Server 提议自己要成为 leader,当其它 Server 收到提议后,解决 epoch和 zxid 的冲突,并接受对方的提议,然后向对方发送接受提议完成的消息,重复这个流程,最后一定能选举出 leader。

同步流程

选完 leader 以后,zk 就进入状态同步过程:

- leader 等待 server 连接

- follower 连接 leader,将最大的 zxid 发送给 leader

- leader 根据 follower 的 zxid 确定同步点

- 完成同步后通知 follower 已经成为 uptodate 状态

- follower 收到 uptodate 消息后,又可以重新接受 client 的请求进行服务了

分布式通知和协调

对于系统调度来说:操作人员发送通知实际是通过控制台改变某个节点的状态,然后 zk 将这些变化发送给注册了这个节点的 watcher 的所有客户端。

对于执行情况汇总:每个工作进程都在某个目录下创建一个临时节点。并携带工作的进度数据,这样汇总的进程可以监控目录子节点的变化获得工作进度的实时的全局情况。

zk 负载均衡和 nginx 负载均衡区别

zk 的负载均衡是可以调控,nginx 只是能调权重,其它需要可控的都需要自己写插件。

但是 nginx 的吞吐量比 zk 大很多。

watcher 机制

官方声明:一个 watcher 事件是一个一次性的触发器,当被设置了 watcher 的数据发生了 变化的时候,则服务器将这个改变发送给设置了 watcher 的客户端,以便通知它们。

- 一次性触发数据发生改变时,一个 watcher event 会被发送到 client,但是 client 只会收到一次这样的信息。

- watcher event 异步发送 watchet 的通知事件从 server 发送到 client 是异步的,这就存在一个问题,不通的客户端和服务器之间通过 socket 进行通信,由于网络延迟或其它因素导致客户端在不通的时刻监听到事件,由于 zk 本身提供了 orderingguarantee,即客户端监听事件后才会感知到它所监听的 znode 发生了变化。所有我们使用 zk 不能期望着能够监控到节点每次的变化。zk 只能保证最终一致性,而无法保证强一致性。

- zk 有数据监视和子数据监视。getdata() andexists() 设置数据监视、getchildren() 设置子节点监视

- 注册 watcher getData、exists、getChildren

- 触发 watcher create、delete、setData

- setData() 会触发 znode 上设置的 datawatcher(如果 set 成功的话)。一个成功的 create 操作会触发被创建的 znode 上的数据 watcher 以及父节点时尚的 childwatcher。而一个成功的 delete 操作将会同时触发一个 znode 的datawather 和 childwatch(因为这样就没有子节点了),同时也会触发其父节点的 childwatch

- 当一个客户端俩捏到新的服务器上,watch 将会被以任意会话事件触发。当与一个服务器失去连接大的时候,是无法接受到 watcher 的。当 client 重新连接时,如果需要,所有先前注册过的 watch ,都会被重新注册。

BASE 理论

Basically Available(基本可用)

在分布式系统出现故障,允许损失部分可用性(服务降级、页面降级)。

Soft State(软状态)

允许分布式系统出现中间状态。而且中间状态不影响系统的可用性。这里的中间状态是指不同的数据备份节点之间的数据更新可以出现延时的最终一致性。

Eventually Consistent(最终一致性)

数据备份节点经过一段时间达到一致性。

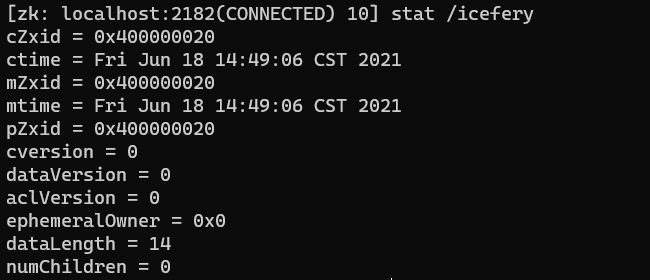

cZxid |

|

|---|---|

ctime |

创建节点的时间 |

mZxid |

最后修改节点的事务 ID |

mtime |

最后修改节点的时间 |

pZxid |

表示该节点的子节点列表是最后一次修改的事务 ID,添加子节点或删除子节点会影响子节点列表,但是修改子节点的数据则不影响该 ID。(只有子节点列表变更了才会变更 pZxid) |

cversion |

子节点版本号,子节点每次修改该版本号 +1 |

dataVersion |

数据版本号,数据每次修改该版本号 +1 |

aclVersion |

权限版本号,权限每次修改该版本号 +1 |

ephemeralOwner |

创建该临时节点的会话 sessionID(如果该节点是持久节点,那么这个属性值为 0) |

dataLength |

该节点的长度 |

numChildren |

该节点拥有的直接子节点的数量 |

Session

客户端与服务端的连接是基于 TCP 长连接。

ACL

权限组合字符串:create、delete、read、write、admin(设置权限)

# worldsetAcl /icefery world:anyone:cdrwa# 增加用户和密码addauth digest icefery:123456# authsetAcl /icefery auth:icefery:123456:cdrwa# ipsetAcl /icefery/ip ip:192.168.137.6:cdrwa