- 【实验目的】

- 【实验原理】

- 【实验环境】

- 【实验内容】

- 【实验步骤】

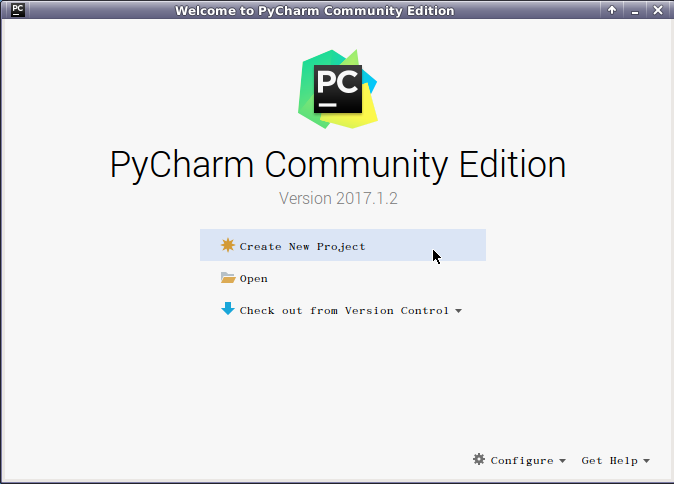

- 1.开启Pycharm,选择Create New Project。

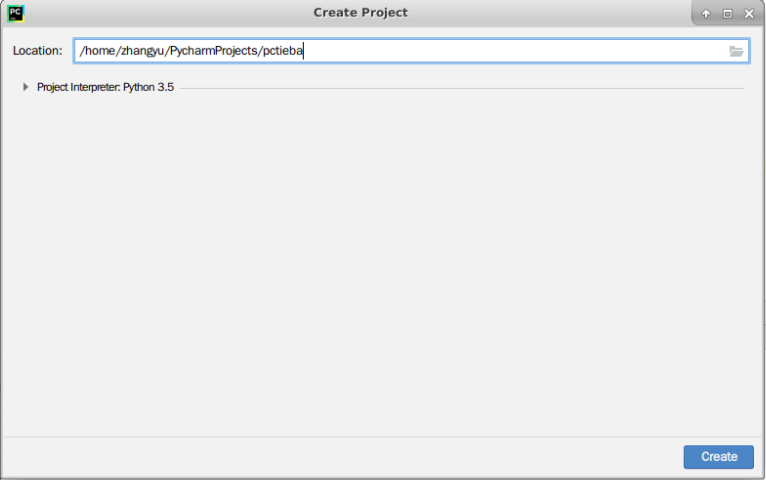

- 2.在Location的默认路径后输入pctieba,点击Create。

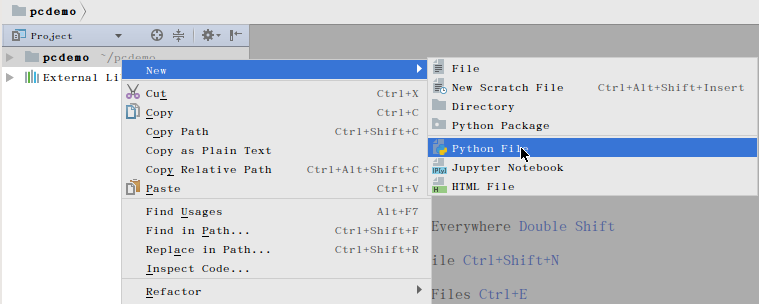

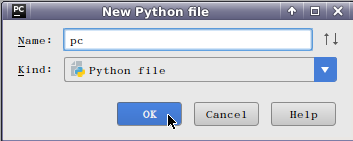

- 3.右键点击pctieba,选择New=>Python File,创建名为pc的python文件。

- 4.选择我们要爬取的网站。

- 5.编写代码来获取该网页源码

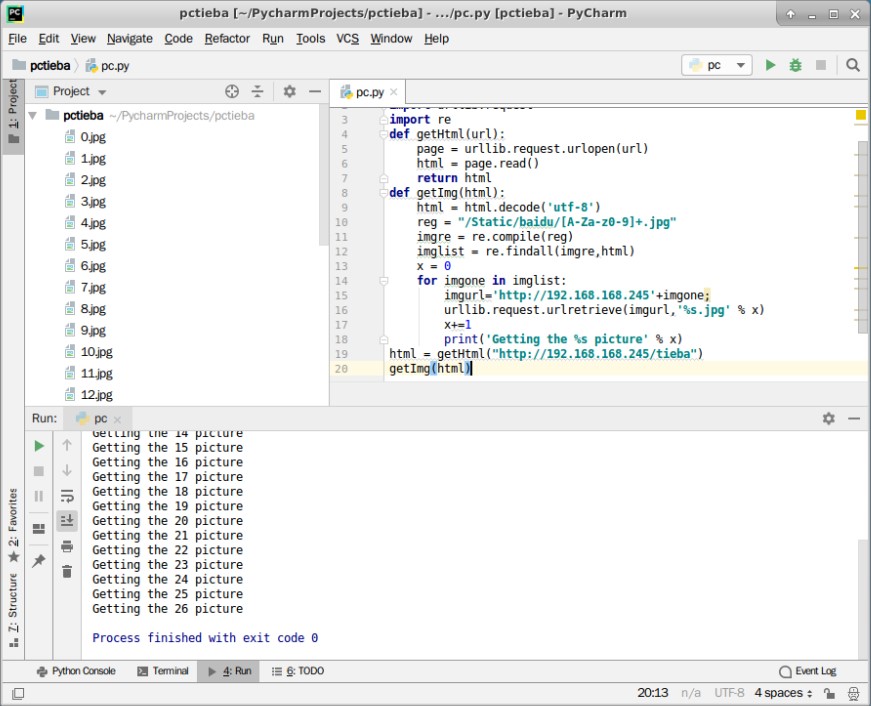

- 6.编写代码来爬取网页上的所有图片,其中compile方法用于将正则字符串编译成正则表达式对象,urlretrieve用于下载制定url内容到本地:

- 7.完整代码为:

- 8.在PyCharm页面单机右键选择Run ‘pc’运行代码,运行结束,本页面共爬取了26张图片。

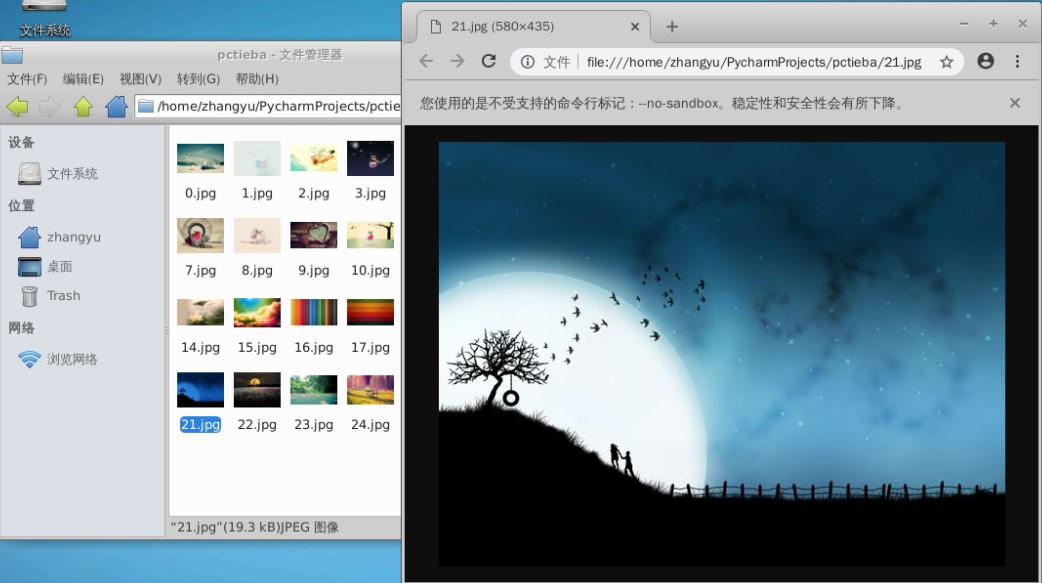

- 9.打开本地文件夹/home/zhangyu/PycharmProjects/pctieba来查看我们爬取的图片

【实验目的】

1.了解爬虫基础知识

2.练习使用Python爬取贴吧图片

【实验原理】

网络爬虫,即Web Spider,是一个很形象的名字。把互联网比喻成一个蜘蛛网,那么Spider就是在网上爬来爬去的蜘蛛。网络蜘蛛是通过网页的链接地址来寻找网页的。从网站某一个页面(通常是首页)开始,读取网页的内容,找到在网页中的其它链接地址,然后通过这些链接地址寻找下一个网页,这样一直循环下去,直到把这个网站所有的网页都抓取完为止。如果把整个互联网当成一个网站,那么网络蜘蛛就可以用这个原理把互联网上所有的网页都抓取下来。这样看来,网络爬虫就是一个爬行程序,一个抓取网页的程序。

抓取网页的过程其实和读者平时使用浏览器浏览网页的道理是一样的。比如说在浏览器的地址栏中输入www.baidu.com这个地址。打开网页的过程其实就是浏览器作为一个浏览的“客户端”,向服务器端发送了 一次请求,把服务器端的文件“抓”到本地,再进行解释、展现。HTML是一种标记语言,用标签标记内容并加以解析和区分。浏览器的功能是将获取到的HTML代码进行解析,然后将原始的代码转变成我们直接看到的网站页面。

【实验环境】

Linux Ubuntu 16.04

Python 3.5

PyCharm

【实验内容】

【实验步骤】

1.开启Pycharm,选择Create New Project。

2.在Location的默认路径后输入pctieba,点击Create。

3.右键点击pctieba,选择New=>Python File,创建名为pc的python文件。

4.选择我们要爬取的网站。

我们来爬取贴吧的图片,URL为:http://192.168.1.100:40000/tieba

我们的目标是将本页面的所有图片爬取下来,右键单击页面,选择查看网页源码,如下:

5.编写代码来获取该网页源码

#coding=utf-8import urllib.requestimport redef getHtml(url):page = urllib.request.urlopen(url)html = page.read()return htmlhtml = getHtml("http://192.168.1.100:40000/tieba")print(html)

在源码中,我们要截取的是jpg格式的图片,格式为:src=”http://192.168.1.100:40000/Static/baidu/0713b31bb051f8197aa4e7c6dbb44aed2f73e7bf.jpg“

我们来设计正则表达式来匹配该格式:

reg = "/Static/baidu/[A-Za-z0-9]+.jpg"

6.编写代码来爬取网页上的所有图片,其中compile方法用于将正则字符串编译成正则表达式对象,urlretrieve用于下载制定url内容到本地:

def getImg(html):html = html.decode('utf-8')reg = "/Static/baidu/[A-Za-z0-9]+.jpg"imgre = re.compile(reg)imglist = re.findall(imgre,html)x = 0for imgurl in imglist:imgurl='http://192.168.1.100:40000'+imgone;urllib.request.urlretrieve(imgurl,'%s.jpg' % x)x+=1print('Getting the %s picture' % x)getImg(html)

7.完整代码为:

#coding=utf-8import urllib.requestimport redef getHtml(url):page = urllib.request.urlopen(url)html = page.read()return htmldef getImg(html):html = html.decode('utf-8')reg = "/Static/baidu/[A-Za-z0-9]+.jpg"imgre = re.compile(reg)imglist = re.findall(imgre,html)x = 0for imgone in imglist:imgurl='http://192.168.1.100:40000'+imgone;urllib.request.urlretrieve(imgurl,'%s.jpg' % x)x+=1print('Getting the %s picture' % x)html = getHtml("http://192.168.1.100:40000/tieba")getImg(html)