Author: Jackiechan

Version: 9.0.2

开放平台项目笔记

本文件主要是记录一些项目配置文件,工具类等不容易记住或者重复性比较多的内容

写在前面

这里主要是写一些我们的约定

| 约定名 | 约定值 |

|---|---|

| 工程groupid | com.qianfeng |

| 工程artifactId | openplatform |

| module模块名 | openapi-xxx xxx代表模块名 |

| 包名 | com.qianfeng.openplatform.模块名.具体细分 |

一、 工程pom文件

为了授课编写代码的便捷性,我们的项目采用一个Project,多个module的方式,所以我们会在项目的最外层添加我们的Springboot

和Spring Cloud配置

<!--SpringBoot 父依赖--><parent><groupId>org.springframework.boot</groupId><artifactId>spring-boot-starter-parent</artifactId><version>2.1.9.RELEASE</version></parent><!--SpringCloud工具集--><dependencyManagement><dependencies><dependency><groupId>org.springframework.cloud</groupId><artifactId>spring-cloud-dependencies</artifactId><version>Greenwich.SR5</version><scope>import</scope><type>pom</type></dependency></dependencies></dependencyManagement>

二 、日志文件(logback-spring.xml)

我们的日志使用的是Springboot自带的logback,下面为logback的配置文件,我们按照模块区分日志,主要就是保存位置的区别

<?xml version="1.0" encoding="UTF-8"?><configuration scan="true" scanPeriod="6000000" debug="false"><property name="LOG_PATTERN" value="%date{HH:mm:ss.SSS} %-5p [%t:%c{1}:%L] - %msg%n"/><!--将日志文件的保存位置修改为自定义的路径,当前的配置是在项目的目录中新建一个logs目录,在logs中创建具体的模块的日志目录.--><property name="LOG_PATH" value="./logs/config/"/><!-- 系统级配置文件 开始 --><appender name="STDOUT" class="ch.qos.logback.core.ConsoleAppender"><layout class="ch.qos.logback.classic.PatternLayout"><Pattern>${LOG_PATTERN}</Pattern></layout></appender><!-- stdout --><appender name="rootstdout"class="ch.qos.logback.core.rolling.RollingFileAppender"><File>${LOG_PATH}rootstdout.log</File><rollingPolicy class="ch.qos.logback.core.rolling.FixedWindowRollingPolicy"><FileNamePattern>${LOG_PATH}rootstdout.%i.log.zip</FileNamePattern><MinIndex>1</MinIndex><MaxIndex>20</MaxIndex></rollingPolicy><triggeringPolicyclass="ch.qos.logback.core.rolling.SizeBasedTriggeringPolicy"><MaxFileSize>10MB</MaxFileSize></triggeringPolicy><layout class="ch.qos.logback.classic.PatternLayout"><Pattern>${LOG_PATTERN}</Pattern></layout></appender><!-- debug --><appender name="rootDebug" class="ch.qos.logback.core.rolling.RollingFileAppender"><File>${LOG_PATH}root-debug.log</File><rollingPolicy class="ch.qos.logback.core.rolling.FixedWindowRollingPolicy"><FileNamePattern>${LOG_PATH}root-debug.%i.log.zip</FileNamePattern><MinIndex>1</MinIndex><MaxIndex>10</MaxIndex></rollingPolicy><triggeringPolicy class="ch.qos.logback.core.rolling.SizeBasedTriggeringPolicy"><MaxFileSize>10MB</MaxFileSize></triggeringPolicy><layout class="ch.qos.logback.classic.PatternLayout"><Pattern>${LOG_PATTERN}</Pattern></layout><filter class="ch.qos.logback.classic.filter.LevelFilter"><level>DEBUG</level><onMatch>ACCEPT</onMatch><onMismatch>DENY</onMismatch></filter></appender><!-- info --><appender name="rootInfo" class="ch.qos.logback.core.rolling.RollingFileAppender"><File>${LOG_PATH}root-info.log</File><rollingPolicy class="ch.qos.logback.core.rolling.FixedWindowRollingPolicy"><FileNamePattern>${LOG_PATH}root-info.%i.log.zip</FileNamePattern><MinIndex>1</MinIndex><MaxIndex>10</MaxIndex></rollingPolicy><triggeringPolicy class="ch.qos.logback.core.rolling.SizeBasedTriggeringPolicy"><MaxFileSize>10MB</MaxFileSize></triggeringPolicy><layout class="ch.qos.logback.classic.PatternLayout"><Pattern>${LOG_PATTERN}</Pattern></layout><filter class="ch.qos.logback.classic.filter.LevelFilter"><level>INFO</level><onMatch>ACCEPT</onMatch><onMismatch>DENY</onMismatch></filter></appender><!-- warn --><appender name="rootWarn" class="ch.qos.logback.core.rolling.RollingFileAppender"><File>${LOG_PATH}root-warn.log</File><rollingPolicy class="ch.qos.logback.core.rolling.FixedWindowRollingPolicy"><FileNamePattern>${LOG_PATH}root-warn.%i.log.zip</FileNamePattern><MinIndex>1</MinIndex><MaxIndex>10</MaxIndex></rollingPolicy><triggeringPolicy class="ch.qos.logback.core.rolling.SizeBasedTriggeringPolicy"><MaxFileSize>10MB</MaxFileSize></triggeringPolicy><layout class="ch.qos.logback.classic.PatternLayout"><Pattern>${LOG_PATTERN}</Pattern></layout><filter class="ch.qos.logback.classic.filter.LevelFilter"><level>WARN</level><onMatch>ACCEPT</onMatch><onMismatch>DENY</onMismatch></filter></appender><!-- error --><appender name="rootError" class="ch.qos.logback.core.rolling.RollingFileAppender"><File>${LOG_PATH}root-error.log</File><rollingPolicy class="ch.qos.logback.core.rolling.TimeBasedRollingPolicy"><FileNamePattern>${LOG_PATH}root-error.%d{yyyy-MM-dd}.log</FileNamePattern><MaxHistory>30</MaxHistory></rollingPolicy><layout class="ch.qos.logback.classic.PatternLayout"><Pattern>${LOG_PATTERN}</Pattern></layout><filter class="ch.qos.logback.classic.filter.LevelFilter"><level>Error</level><onMatch>ACCEPT</onMatch><onMismatch>DENY</onMismatch></filter></appender><springProfile name="local"><root level="info"><!-- 本地测试时使用,将日志打印到控制台,实际部署时请注释掉 --><appender-ref ref="STDOUT"/><appender-ref ref="rootstdout"/><appender-ref ref="rootDebug"/><appender-ref ref="rootInfo"/><appender-ref ref="rootWarn"/><appender-ref ref="rootError"/></root></springProfile><springProfile name="dev"><root level="info"><!-- 本地测试时使用,将日志打印到控制台,实际部署时请注释掉 --><appender-ref ref="rootstdout"/><appender-ref ref="rootDebug"/><appender-ref ref="rootInfo"/><appender-ref ref="rootWarn"/><appender-ref ref="rootError"/></root></springProfile><springProfile name="prod"><root level="info"><!-- 本地测试时使用,将日志打印到控制台,实际部署时请注释掉 --><appender-ref ref="rootstdout"/><appender-ref ref="rootDebug"/><appender-ref ref="rootInfo"/><appender-ref ref="rootWarn"/><appender-ref ref="rootError"/></root></springProfile><include resource="org/springframework/boot/logging/logback/base.xml"/><jmxConfigurator/></configuration>

三、 多配置文件

实际开发中,为了方便测试,我们会有多个不同的配置文件,比如本地的,测试服务器的等,为了减少修改,我们一般会将配置文件按照具体场景单独写,在运行的时候通过指定加载配置文件的方式来执行

比如我们假设我们的项目有 local和prod两个不同的配置,则我们会创建application.yml主文件, application-local.yml和application-prod.yml 三个文件,其中local和prod代表的就是我们的前面的配置

我们有两种方式可以选择,我们在项目中可能会采用两种方式混用的情况

3.1 方式1

此方式是通过在主文件中指定加载文件后缀的方式来进行加载对应的配置文件

3.1.1 application.yml主文件

server:

port: 12000

spring:

profiles:

active: local #通过这个属性指定文件的后缀,则程序会自动加载application-local.yml文件,如果需要prod只需要修改为prod然后启动即可

3.1.2 local文件

此文件仅仅为演示

spring:

application:

name: test-profile

eureka:

client:

service-url:

defaultZone: http://localhost:20000/eureka

instance:

prefer-ip-address: true #显示 ip

3.1.3 prod文件

此文件仅仅为演示

spring:

application:

name: test-profile

eureka:

client:

service-url:

defaultZone: http://test.qfjava.cn:20000/eureka

instance:

prefer-ip-address: true #显示 ip

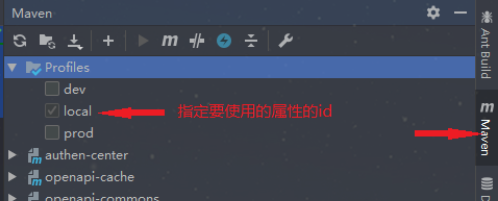

3.2 方式2

此方式是通过在对应的项目的pom文件中指定属性名,然后在application.yml中通过变量名引入,在启动时候通过maven属性指定的方式来选择,假设我们的配置文件仍然是local和prod

3.2.1 pom文件

<!--

指定属性,可以让我们的application.yml引入

-->

<profiles>

<profile>

<!--

当前属性的id,唯一

-->

<id>local</id>

<activation>

<activeByDefault>true</activeByDefault>

</activation>

<!--

当前id对应的具体的参数的值,当我们通过选中上面id对应的值时候,就会使用这个值,这两个值可以一样,可以不一样

当使用这个值的时候会加载application-local.yml文件

-->

<properties>

<profileActive>local</profileActive>

</properties>

</profile>

<profile>

<id>prod</id>

<activation>

<activeByDefault>false</activeByDefault>

</activation>

<properties>

<profileActive>prod</profileActive>

</properties>

</profile>

</profiles>

3.2.2 application.yml 主文件

server:

port: 12000

spring:

profiles:

active: '@profileActive@' #设置我们的加载的maven配置文件的后缀为这个属性的值,通过指定maven的启动参数来选中

3.2.3 启动

在启动程序前,在maven的选项中选择要使用的属性的id,然后启动程序即可

| 选择使用的配置文件 |

|---|

|

四、 注册中心(openapi-eureka)

我们的项目使用的是eureka作为注册中心,其使用相对简单,配置方便

4.1 pom中的依赖

下面的内容主要是依赖相关的内容

<!--

eureka server 的依赖,注意是server

-->

<dependencies>

<dependency>

<groupId>org.springframework.cloud</groupId>

<artifactId>spring-cloud-starter-netflix-eureka-server</artifactId>

</dependency>

<!--

和安全相关的依赖包,我们访问 eureka的需要密码,此处为了操作方便,不使用密码

-->

<!-- <dependency>-->

<!-- <groupId>org.springframework.boot</groupId>-->

<!-- <artifactId>spring-boot-starter-security</artifactId>-->

<!-- </dependency>-->

</dependencies>

4.2 application.yml

程序启动的主要配置

server:

port: 20000 #程序运行的端口,可以自定义修改

spring:

application:

name: openapi-eureka #程序的名字

#配置 eureka 页面的登陆的账号和密码,需要配合security依赖使用,为了操作方便,就不配置了

# security:

# user:

# name: admin

# password: admin

eureka:

client:

service-url:

defaultZone: http://localhost:20000/eureka #我们的注册中心的地址

#单机版的配置,集群只需要启动多个eureka并相互作为客户端配置其他eureka地址即可,为了方便演示,我们使用单机版

fetch-registry: false

register-with-eureka: false

4.3 安全配置类(可选)

本配置文件取决于是否启用了security密码操作,因为开启了csrf验证,我们使用了端口,所以我们的eureka客户端会无法注册到当前注册中心,本配置是为了让客户端可以注册到eureka,如果没有使用security 可以忽略

@EnableWebSecurity

public class EurekaConfig extends WebSecurityConfigurerAdapter

{

@Override

protected void configure(HttpSecurity http) throws Exception {

http.csrf().disable()//禁用掉 csrf 跨域攻击,以免我们的服务无法注册到 eureka

.authorizeRequests()//需要认证所有的请求

.mvcMatchers("/eureka/**").permitAll()//符合以上路径规则的放行

.mvcMatchers("/actuator/**").permitAll()//放行

.anyRequest().authenticated().and().httpBasic();//剩余的所有的请求都需要验证

}

}

4.4 SpringBoot主程序

@SpringBootApplication

//启用eureka 注册中心的注解,必须添加

@EnableEurekaServer

public class EurekaStartApp {

public static void main (String[] args){

SpringApplication.run(EurekaStartApp.class,args);

}

}

五、 统一配置中心(openapi-configserver)

在我们的项目中,我们的一些配置并不是一成不变的,我们可能会经常发生变化, 比如我的redis服务器地址,我们的mq服务器地址等,当我们发生变化的时候,我们需要将所有引入这些内容的服务器都重新替换配置文件并部署,但是我们的服务器是集群,可能会有数量不明确的机器在使用,这样的情况下,维护就变得非常的繁琐,我们通过一个统一的配置中心,让我们所有需要的服务器都从配置中间下载配置文件,这样我们只需要将配置中心对应的配置文件修改即可,这样我们就需要搭建一个统一的配置中心,

我们使用的是SpringCloud ConfigServer来搭建,并将文件保存到git中,通过使用mq来进行批量更新

5.1 pom中的依赖

<dependencies>

<!--

注意 config 的server 没有 starter,个人猜测应该是个 bug

-->

<dependency>

<groupId>org.springframework.cloud</groupId>

<artifactId>spring-cloud-config-server</artifactId>

</dependency>

<dependency>

<groupId>org.springframework.cloud</groupId>

<artifactId>spring-cloud-starter-netflix-eureka-client</artifactId>

</dependency>

</dependencies>

5.2 application.yml主配置文件

server:

port: 12000

spring:

application:

name: openapi-configserver #我们的程序在eureka中的名字

#配置我们保存配置文件的位置

cloud:

config:

server:

git:

uri: https://gitee.com/yangl729953102/{application} #我们的配置文件保存的位置,在码云上,{application}是个通配符,代表的是从当前配置中心找配置文件的应用程序的名字

# username:

# password:

eureka:

client:

service-url:

#这是如果注册中心是带密码的

# defaultZone: http://admin:admin@localhost:20000/eureka

defaultZone: http://localhost:20000/eureka

instance:

prefer-ip-address: true #显示 ip

5.4 SpringBoot主程序

@SpringBootApplication

//开启配置中心服务端

@EnableConfigServer

//开启服务注册,会向eureka中注册当前服务,可以忽略编写,在使用eureka的情况下效果等于@EnableEurekaClient

@EnableDiscoveryClient

public class ConfigServerStartApp {

public static void main (String[] args){

SpringApplication.run(ConfigServerStartApp.class,args);

}

}

六、 缓存服务(openapi-cache)

我们的缓存模块,当前使用的是 redis,缓存模块我们设计为是一个独立的 web 项目

原因是因为如果我们设置为依赖包,如果缓存模块发生变化,需要重新打包发布然后让所有依赖

缓存的功能都需要重新更新依赖以及打包上线,这样就不符合我们的项目的拆分的目的,所以

我们的缓存设计为 web 程序,这样我们的缓存发生变化的时候只要返回结果不变,内部如何变化只需要重启缓存功能就可以

6.1 pom中的依赖

<dependencies>

<dependency>

<groupId>org.springframework.boot</groupId>

<artifactId>spring-boot-starter-web</artifactId>

</dependency>

<dependency>

<groupId>org.springframework.cloud</groupId>

<artifactId>spring-cloud-starter-netflix-eureka-client</artifactId>

</dependency>

<!--

操作 redis 的依赖包

-->

<dependency>

<groupId>org.springframework.boot</groupId>

<artifactId>spring-boot-starter-data-redis</artifactId>

</dependency>

<!--

统一配置中心的客户端,注意没有 client

-->

<dependency>

<groupId>org.springframework.cloud</groupId>

<artifactId>spring-cloud-starter-config</artifactId>

</dependency>

<!--

用于做降级的依赖包,当我们的程序内部发生问题的时候快速返回降级数据给调用者,防止我们的程序因等待导致出现问题,最终导致调用者出现级联失败

-->

<dependency>

<groupId>org.springframework.cloud</groupId>

<artifactId>spring-cloud-starter-netflix-hystrix</artifactId>

</dependency>

</dependencies>

<!--

bootstrap.yml 如果无法使用 '@profileActive@'来获取我们的值,添加以下配置来让它可以访问

-->

<build>

<resources>

<resource>

<directory>src/main/resources</directory>

<filtering>true</filtering>

</resource>

</resources>

</build>

<profiles>

<profile>

<id>local</id>

<activation>

<activeByDefault>true</activeByDefault>

</activation>

<properties>

<profileActive>local</profileActive>

</properties>

</profile>

<profile>

<id>prod</id>

<activation>

<activeByDefault>false</activeByDefault>

</activation>

<properties>

<profileActive>prod</profileActive>

</properties>

</profile>

</profiles>

6.2 bootstrap.yml

因为我们需要从config-server中获取配置,所以我们的一些配置需要放到bootstrap.yml中, application.yml放端口等其他配置,redis的配置可以在git仓库中配置

#因为我们的 redis 的服务器放在 git中,但是我们程序启动起来初始化对象的时候必须有服务器地址了

#当前配置文件的优先级是最高的,在 spring 初始化对象之前就会先加载这个配置文件,所以我们把从git 上面加载配置文件的过程写入到这里面

#来保证我们的程序在初始化对象之前就把服务器信息加载回来了,这样才能保证后续的初始化不会出现错误

spring:

application:

name: openapi-cache

# redis:

# host: 127.0.0.1

# port: 6379

#需要告诉我们的程序,config-server 在 eureka 中叫什么,以及告诉 configserver 我要加载个配置文件

cloud:

config:

discovery:

enabled: true #开始通过服务发现来找 config server

service-id: OPENAPI-CONFIGSERVER #设置 config server 的服务的名字

label: master #设置我们的配置文件在 git 中属于什么分支,属于 master 分支

profile: '@profileActive@' #因为我们一个仓库里面可以写好多个不同的配置文件,那么这个属性告诉 config server 我们要加载哪个后缀的配置文件

eureka:

client:

service-url:

#这是如果注册中心是带密码的

# defaultZone: http://admin:admin@localhost:20000/eureka

defaultZone: http://localhost:20000/eureka

instance:

prefer-ip-address: true #显示 ip

6.3 application.yml

server:

port: 21000

编写启动类

@SpringBootApplication

@EnableDiscoveryClient

@EnableCircuitBreaker//熔断降级

public class OpenapiCacheApp {

public static void main(String[] args) {

SpringApplication.run(OpenapiCacheApp.class,args);

}

}

6.4 Redis配置类

设置RedisTemplate的key和value的序列化方式

package com.qf.config;

import com.fasterxml.jackson.annotation.JsonAutoDetect;

import com.fasterxml.jackson.annotation.PropertyAccessor;

import com.fasterxml.jackson.databind.ObjectMapper;

import org.springframework.cache.CacheManager;

import org.springframework.cache.annotation.CachingConfigurerSupport;

import org.springframework.cache.interceptor.KeyGenerator;

import org.springframework.context.annotation.Bean;

import org.springframework.context.annotation.Configuration;

import org.springframework.data.redis.cache.RedisCacheConfiguration;

import org.springframework.data.redis.cache.RedisCacheManager;

import org.springframework.data.redis.cache.RedisCacheWriter;

import org.springframework.data.redis.connection.lettuce.LettuceConnectionFactory;

import org.springframework.data.redis.core.RedisTemplate;

import org.springframework.data.redis.serializer.Jackson2JsonRedisSerializer;

import org.springframework.data.redis.serializer.StringRedisSerializer;

@Configuration

public class RedisConfig extends CachingConfigurerSupport {

@Override

public KeyGenerator keyGenerator() {

return (target, method, params) -> {

StringBuilder stringBuilder = new StringBuilder();

stringBuilder.append(target.getClass().getName());

stringBuilder.append(method.getName());

for (Object param : params) {

stringBuilder.append(params.toString());

}

return stringBuilder.toString();

};

}

@Bean

public CacheManager cacheManager(LettuceConnectionFactory connectionFactory) {

RedisCacheWriter writer = RedisCacheWriter.lockingRedisCacheWriter(connectionFactory);

RedisCacheConfiguration config = RedisCacheConfiguration.defaultCacheConfig();

RedisCacheManager cacheManager = new RedisCacheManager(writer, config);

return cacheManager;

}

/**

* springboot 默认帮我们创建的RedisTemplate的key和value的序列化方式是jdk默认的方式,所以呢我们有时候手动向redis中添加的数据可能无法被查询解析出来,所以我们需要修改序列化方式

*

* @param connectionFactory

* @return

*/

@Bean

public RedisTemplate<String, Object> redisTemplate(LettuceConnectionFactory connectionFactory) {

RedisTemplate<String, Object> redisTemplate = new RedisTemplate<>();

redisTemplate.setConnectionFactory(connectionFactory);

StringRedisSerializer stringRedisSerializer = new StringRedisSerializer();

redisTemplate.setKeySerializer(stringRedisSerializer); //设置key的序列化方式

redisTemplate.setHashKeySerializer(stringRedisSerializer);//设置hash类型的数据的key的序列化方式

Jackson2JsonRedisSerializer jackson2JsonRedisSerializer = new Jackson2JsonRedisSerializer(Object.class);

ObjectMapper objectMapper = new ObjectMapper();

objectMapper.setVisibility(PropertyAccessor.ALL, JsonAutoDetect.Visibility.ANY);

objectMapper.enableDefaultTyping(ObjectMapper.DefaultTyping.NON_FINAL);//非final类型的数据才会被序列化

jackson2JsonRedisSerializer.setObjectMapper(objectMapper);

redisTemplate.setValueSerializer(jackson2JsonRedisSerializer);//设置value的序列化方式为json

redisTemplate.setHashValueSerializer(jackson2JsonRedisSerializer);

return redisTemplate;

}

}

6.5 核心操作

编写redis中常用命令对应的功能代码

package com.qf.service;

import java.util.Map;

import java.util.Set;

/**

* 我们的缓存的业务定义,用于声明我们当前缓存对外提供的功能

*/

public interface CacheService {

/**

* 向redis中保存字符串类型的数据

*

* @param key

* @param value

* @param expireTime 有效期, 如果是-1代表永久, 其他负数按照我们自己定义的要求,取绝对值,0代表-1,时间单位是毫秒值

* @return 成功返回true

* @throws Exception

*/

boolean save2Redis(String key, String value, long expireTime) throws Exception;

/**

* 从redis中查询String类型是数据

*

* @param key

* @return

* @throws Exception

*/

String getFromRedis(String key) throws Exception;

/**

* 从redis中删除指定的key

*

* @param key

* @return

* @throws Exception

*/

boolean deleteKey(String key) throws Exception;

/**

* 设置过期时间

*

* @param key

* @param expireTime 有效期, 如果是-1代表永久, 其他负数按照我们自己定义的要求,取绝对值,0代表-1

* @return

* @throws Exception

*/

boolean expire(String key, long expireTime) throws Exception;

/**

* 获取一个自增的数字

*

* @param key

* @return

* @throws Exception

*/

Long getAutoIncrementId(String key) throws Exception;

/**

* 获取指定key的set类型的集合数据

*

* @param key

* @return

* @throws Exception

*/

Set<Object> sMembers(String key) throws Exception;

/**

* 向redis中指定key的set中添加数据

*

* @param key

* @param member

* @return

* @throws Exception

*/

Long sAdd(String key, String member) throws Exception;

/**

* 向redis中指定key的set中添加数据集合

*

* @param key

* @param members

* @return

* @throws Exception

*/

Long sAdd(String key, String... members) throws Exception;

/**

* 从redis中移除指定key对应的set中的某个值

*

* @param key

* @param member

* @return

* @throws Exception

*/

Long sRemove(String key, String member) throws Exception;

/**

* 向redis中的hash类型数据中添加指定的内容

*

* @param key

* @param field

* @param value

* @return

* @throws Exception

*/

boolean hSet(String key, String field, String value) throws Exception;

/**

* 从hash中获取指定属性的值

*

* @param key

* @param field

* @return

* @throws Exception

*/

String hGet(String key, String field) throws Exception;

/**

* 获取指定hash中的所有的数据

*

* @param key

* @return

* @throws Exception

*/

Map<Object, Object> hGetAll(String key) throws Exception;

/**

* 批量向hash中添加数据

*

* @param key

* @param values

* @return

* @throws Exception

*/

boolean hMSet(String key, Map<Object, Object> values) throws Exception;

/**

* 查看符合表达式的key的集合

*

* @param partten

* @return

* @throws Exception

*/

Set<String> findKeyByPartten(String partten) throws Exception;

/**

* 自增指定步长的数据并返回

*

* @param key

* @param delta

* @return

* @throws Exception

*/

Long getAutoIncrementId(String key, long delta) throws Exception;

/**

* 从hash中的指定属性上面获取一个自增数据

*

* @param key

* @param field

* @param delta

* @return

* @throws Exception

*/

Long hIncrementId(String key, String field, long delta) throws Exception;

/**

* setnx的方式存放值

*

* @param key

* @param value

* @param expireTime

* @return

* @throws Exception

*/

boolean setNx(String key, String value, long expireTime) throws Exception;

}

编写Service对应的实现类

package com.qf.service.impl;

import com.qf.service.CacheService;

import org.springframework.beans.factory.annotation.Autowired;

import org.springframework.data.redis.core.RedisTemplate;

import org.springframework.stereotype.Service;

import java.util.Map;

import java.util.Set;

import java.util.concurrent.TimeUnit;

@Service

public class CacheServiceImpl implements CacheService {

@Autowired

private RedisTemplate<String, Object> redisTemplate;

@Override

public boolean save2Redis(String key, String value, long expireTime) throws Exception {

if (expireTime == 0) {//按照我们自己的要求,如果是0 代表是-1

expireTime = -1;

} else if (expireTime < -1) { //如果小于-1 代表的是取绝对值

expireTime = Math.abs(expireTime);

}

redisTemplate.opsForValue().set(key, value);

if (expireTime > 0) {

//需要设置有效期,时间单位是毫秒值

redisTemplate.expire(key, expireTime, TimeUnit.MILLISECONDS);

}

return true;

}

@Override

public String getFromRedis(String key) throws Exception {

return (String) redisTemplate.opsForValue().get(key);

}

@Override

public boolean deleteKey(String key) throws Exception {

return redisTemplate.delete(key);

}

@Override

public boolean expire(String key, long expireTime) throws Exception {

if (expireTime == 0) {//按照我们自己的要求,如果是0 代表是-1

expireTime = -1;

} else if (expireTime < -1) { //如果小于-1 代表的是取绝对值

expireTime = Math.abs(expireTime);

}

if (expireTime > 0) {

//代表需要设置有效期

return redisTemplate.expire(key, expireTime, TimeUnit.MILLISECONDS);

} else {

//代表需要的是持久化数据

return redisTemplate.persist(key);

}

}

@Override

public Long getAutoIncrementId(String key) throws Exception {

return redisTemplate.opsForValue().increment(key);

}

@Override

public Set<Object> sMembers(String key) throws Exception {

return redisTemplate.opsForSet().members(key);

}

@Override

public Long sAdd(String key, String member) throws Exception {

return redisTemplate.opsForSet().add(key, member);

}

@Override

public Long sAdd(String key, String... members) throws Exception {

return redisTemplate.opsForSet().add(key, members);

}

@Override

public Long sRemove(String key, String member) throws Exception {

return redisTemplate.opsForSet().remove(key, member);

}

@Override

public boolean hSet(String key, String field, String value) throws Exception {

redisTemplate.opsForHash().put(key, field, value);

return true;

}

@Override

public String hGet(String key, String field) throws Exception {

Object o = redisTemplate.opsForHash().get(key, field);

return o == null ? null : o.toString();

}

@Override

public Map<Object, Object> hGetAll(String key) throws Exception {

return redisTemplate.opsForHash().entries(key);

}

@Override

public boolean hMSet(String key, Map<Object, Object> values) throws Exception {

redisTemplate.opsForHash().putAll(key, values);

return true;

}

@Override

public Set<String> findKeyByPartten(String partten) throws Exception {

return redisTemplate.keys(partten);

}

@Override

public Long getAutoIncrementId(String key, long delta) throws Exception {

return redisTemplate.opsForValue().increment(key, delta);

}

@Override

public Long hIncrementId(String key, String field, long delta) throws Exception {

return redisTemplate.opsForHash().increment(key, field, delta);

}

@Override

public boolean setNx(String key, String value, long expireTime) throws Exception {

if (expireTime == 0) {//按照我们自己的要求,如果是0 代表是-1

expireTime = -1;

} else if (expireTime < -1) { //如果小于-1 代表的是取绝对值

expireTime = Math.abs(expireTime);

}

redisTemplate.opsForValue().setIfAbsent(key, value);

if (expireTime > 0) {

//需要设置有效期,时间单位是毫秒值

redisTemplate.expire(key, expireTime, TimeUnit.MILLISECONDS);

}

return true;

}

}

编写Controller

package com.qf.controller;

import com.netflix.hystrix.contrib.javanica.annotation.HystrixCommand;

import com.qf.service.CacheService;

import com.qf.utils.RedisUtil;

import org.slf4j.Logger;

import org.slf4j.LoggerFactory;

import org.springframework.beans.factory.annotation.Autowired;

import org.springframework.web.bind.annotation.*;

import java.util.Map;

import java.util.Set;

@RestController

@RequestMapping("/cache")

public class CacheController {

private static Logger logger = LoggerFactory.getLogger(CacheController.class);

@Autowired

private CacheService cacheService;

@PostMapping("/set/{key}/{value}/{expireTime}")

//降级的配置

@HystrixCommand(fallbackMethod = "save2RedisFallback")

public boolean save2Redis(@PathVariable String key, @PathVariable String value, @PathVariable long expireTime) throws Exception {

RedisUtil.checkNull(key);

RedisUtil.checkNull(value);

return cacheService.save2Redis(key, value, expireTime);

}

@GetMapping("/get/{key}")

//降级的配置

@HystrixCommand(fallbackMethod = "getFromRedisFallback")

public String getFromRedis(@PathVariable String key) throws Exception {

RedisUtil.checkNull(key);

return cacheService.getFromRedis(key);

}

@PostMapping("/delete/{key}")

public boolean deleteKey(@PathVariable String key) throws Exception {

RedisUtil.checkNull(key);

return cacheService.deleteKey(key);

}

@PostMapping("/expire/{key}/{expireTime}")

public boolean expire(@PathVariable String key, @PathVariable long expireTime) throws Exception {

RedisUtil.checkNull(key);

return cacheService.expire(key, expireTime);

}

@GetMapping("/getid/{key}")

public Long getAutoIncrementId(@PathVariable String key) throws Exception {

RedisUtil.checkNull(key);

return cacheService.getAutoIncrementId(key);

}

@GetMapping("/smembers/{key}")

public Set<Object> sMembers(@PathVariable String key) throws Exception {

RedisUtil.checkNull(key);

return cacheService.sMembers(key);

}

@PostMapping("/sadd/{key}/{member}")

public Long sAdd(@PathVariable String key, @PathVariable String member) throws Exception {

RedisUtil.checkNull(key);

RedisUtil.checkNull(member);

return cacheService.sAdd(key, member);

}

@PostMapping("/sadds/{key}")

public Long sAdd(@PathVariable String key, String[] members) throws Exception {

RedisUtil.checkNull(key);

return cacheService.sAdd(key, members);

}

@PostMapping("/sremove/{key}/{member}")

public Long sRemove(@PathVariable String key, @PathVariable String member) throws Exception {

RedisUtil.checkNull(key);

RedisUtil.checkNull(member);

return cacheService.sRemove(key, member);

}

@PostMapping("/hset/{key}/{field}/{value}")

public boolean hSet(@PathVariable String key, @PathVariable String field, @PathVariable String value) throws Exception {

RedisUtil.checkNull(key);

RedisUtil.checkNull(field);

RedisUtil.checkNull(value);

return cacheService.hSet(key, field, value);

}

@GetMapping("/hget/{key}/{field}")

public String hGet(@PathVariable String key, @PathVariable String field) throws Exception {

RedisUtil.checkNull(key);

RedisUtil.checkNull(field);

return cacheService.hGet(key, field);

}

@GetMapping("/hgetall/{key}")

public Map<Object, Object> hGetAll(@PathVariable String key) throws Exception {

RedisUtil.checkNull(key);

return cacheService.hGetAll(key);

}

@PostMapping("/hmset/{key}")

public boolean hMSet(@PathVariable String key, @RequestBody Map<Object, Object> values) throws Exception {

RedisUtil.checkNull(key);

return cacheService.hMSet(key, values);

}

@GetMapping("/keys/{partten}")

public Set<String> findKeyByPartten(@PathVariable String partten) throws Exception {

RedisUtil.checkNull(partten);

return cacheService.findKeyByPartten(partten);

}

@GetMapping("/increment/{key}/{delta}")

public Long getAutoIncrementId(@PathVariable String key, @PathVariable long delta) throws Exception {

RedisUtil.checkNull(key);

return cacheService.getAutoIncrementId(key, delta);

}

@GetMapping("/hIncrementid/{key}/{field}/{delta}")

public Long hIncrementId(@PathVariable String key, @PathVariable String field, @PathVariable long delta) throws Exception {

RedisUtil.checkNull(key);

RedisUtil.checkNull(field);

return cacheService.hIncrementId(key, field, delta);

}

@PostMapping("/setnx/{key}/{value}/{expireTime}")

public boolean setNx(@PathVariable String key, @PathVariable String value, @PathVariable long expireTime) throws Exception {

RedisUtil.checkNull(key);

RedisUtil.checkNull(value);

return cacheService.setNx(key, value, expireTime);

}

/**

* 保存数据到缓存中的降级的方法

*

* @param key

* @param value

* @param expireTime

* @return

* @throws Exception

*/

public boolean save2RedisFallback(String key, String value, long expireTime) throws Exception {

logger.error("save2Redis 出现异常,进行降级,{}:{}",key,value);

return false;

}

@HystrixCommand(fallbackMethod = "getFromRedisFallback")

public String getFromRedisFallback(String key) throws Exception {

logger.error("getFromRedi 出现异常,进行降级,{}",key);

return null;

}

}

编写Utils

package com.qf.utils;

import com.qf.constans.ExceptionDict;

import com.qf.exception.RedisException;

import org.springframework.util.StringUtils;

public class RedisUtil {

/**

* 用于判断指定内容是不是为空

* @param source

*/

public static void checkNull(String source) {

if (StringUtils.isEmpty(source)) {

throw new RedisException("参数为空", ExceptionDict.CONTENT_NULL_EXCEPTION);

}

}

}

编写Exception

package com.qf.exception;

public class RedisException extends RuntimeException {

public RedisException() {

}

private String message;

private String code;

public RedisException(String message, String code) {

this.message = message;

this.code = code;

}

@Override

public String getMessage() {

return message;

}

public void setMessage(String message) {

this.message = message;

}

public String getCode() {

return code;

}

public void setCode(String code) {

this.code = code;

}

}

创建openapi-commons子工程(步骤省略,直接拷贝过来即可)

在openapi-cache工程的pom.xml文件中,导入openapi-commons

<dependency>

<groupId>com.qf</groupId>

<artifactId>openapi-commons</artifactId>

<version>1.0-SNAPSHOT</version>

</dependency>

6.6 其他内容

我们的服务需要包含降级操作,当程序内部出现问题的时候快速失败,返回数据给调用者,因此注意,我们的controller代码中需要配置hystrix

七、 运营管理平台(openapi-web-master)

在之前的时候我们通过ssm将我们的管理平台进行了代码编写,当整合到我们的大工程中的时候,因为现在使用的是springboot,所以我们需要将项目进行改造

7.1 pom依赖替换

<!--

我们将依赖替换为各种starter

-->

<dependencies>

<dependency>

<groupId>org.springframework.boot</groupId>

<artifactId>spring-boot-starter-web</artifactId>

</dependency>

<dependency>

<groupId>org.mybatis.spring.boot</groupId>

<artifactId>mybatis-spring-boot-starter</artifactId>

<version>2.1.1</version>

</dependency>

<dependency>

<groupId>com.alibaba</groupId>

<artifactId>druid-spring-boot-starter</artifactId>

<version>1.1.21</version>

</dependency>

<dependency>

<groupId>mysql</groupId>

<artifactId>mysql-connector-java</artifactId>

<scope>runtime</scope>

<version>5.1.47</version>

</dependency>

<dependency>

<groupId>com.github.pagehelper</groupId>

<artifactId>pagehelper-spring-boot-starter</artifactId>

<version>1.2.10</version>

</dependency>

<dependency>

<groupId>org.projectlombok</groupId>

<artifactId>lombok</artifactId>

<version>1.18.12</version>

</dependency>

<dependency>

<groupId>org.springframework.cloud</groupId>

<artifactId>spring-cloud-starter-netflix-eureka-client</artifactId>

</dependency>

<dependency>

<groupId>org.springframework.cloud</groupId>

<artifactId>spring-cloud-starter-openfeign</artifactId>

</dependency>

<dependency>

<groupId>org.springframework.boot</groupId>

<artifactId>spring-boot-starter-data-redis</artifactId>

</dependency>

<!--

用于发送 mq 消息的

-->

<dependency>

<groupId>org.springframework.cloud</groupId>

<artifactId>spring-cloud-starter-stream-rabbit</artifactId>

</dependency>

<dependency>

<groupId>com.qianfeng</groupId>

<artifactId>openapi-commons</artifactId>

<version>1.0</version>

</dependency>

<dependency>

<groupId>org.springframework.cloud</groupId>

<artifactId>spring-cloud-starter-netflix-hystrix</artifactId>

</dependency>

</dependencies>

7.2 application配置文件

因为使用的是springboot,会简化大量的配置文件,因此删除之前的所有的和ssm相关的配置文件,通过一个application.yml来进行配置

spring:

datasource:

password: qishimeiyoumima

username: root

driver-class-name: org.gjt.mm.mysql.Driver

url: jdbc:mysql://localhost:3306/openapi-admin?characterEncoding=utf8&serverTimezone=Asia/Shanghai&useSSL=false

application:

name: openapi-web-master

#redis服务器的设置应当通过config server来获取,此处为了方便代码编写,故此直接写在这里,具体的配置可以参考 cache模块的配置

rabbitmq:

host: 192.168.3.29

port: 8800

eureka:

client:

service-url:

defaultZone: http://localhost:20000/eureka

instance:

prefer-ip-address: true #显示 ip

#别名

mybatis:

type-aliases-package: com.qianfeng.openapi.web.master.pojo

#开启feign的降级

feign:

hystrix:

enabled: true

### Ribbon 配置

ribbon:

# 连接超时

ConnectTimeout: 2000

# 响应超时

ReadTimeout: 5000

hystrix:

shareSecurityContext: true

command:

default:

execution:

isolation:

thread:

# 熔断器超时时间,默认:1000/毫秒

timeoutInMilliseconds: 5000

7.3 CacheService Feign

因为我们的缓存中的数据是通过管理平台添加到缓存中的,因此我们需要调用缓存服务,需要引入feign

当前文档中 不具体写明降级的方法的具体实现

//fallback为降级类,需要实现当前接口

@FeignClient(value = "OPENAPI-CACHE", fallback = CacheServiceFallback.class)

public interface CacheService {

@RequestMapping(value = "/cache/get/{key}", method = RequestMethod.GET)

String get(@PathVariable("key") String key);

@RequestMapping(value = "/cache/setnx/{key}/{value}", method = RequestMethod.POST)

boolean setnx(@PathVariable("key") String key, @PathVariable("value") String value, @RequestParam("expireSecond") long expireSecond);

@RequestMapping(value = "/cache/delete/{key}", method = RequestMethod.POST)

boolean del(@PathVariable("key") String key);

@RequestMapping(value = "/cache/hmset/{key}", method = RequestMethod.POST)

boolean hmset(@PathVariable("key") String key, @RequestBody Map<String, Object> map);

@RequestMapping(value = "/cache/set/{key}/{value}/{expiretime}", method = RequestMethod.POST)

void set(@PathVariable("key") String key, @PathVariable("value") String value, @PathVariable("expiretime") long expireSecond);

@RequestMapping(value = "/cache/reverseRangeWithScores", method = RequestMethod.POST)

List<String> reverseRangeWithScores(@RequestParam("key") String key, @RequestParam("start") int start, @RequestParam("end") int end);

@PostMapping("/cache/hset/{key}/{field}/{value}")

void hSet(@PathVariable String key, @PathVariable String field, @PathVariable String value) throws Exception;

@GetMapping("/cache/hget/{key}/{field}")

String hGet(@PathVariable String key, @PathVariable String field) throws Exception;

@PostMapping("/cache/sadd/{key}/{value}")

Long sAdd(@PathVariable String key,@PathVariable String value, @RequestParam(defaultValue = "-1") long expireTime) throws Exception;

@PostMapping("/cache/sremove/{key}/{value}")

public Long sRemove(@PathVariable("key") String key,@PathVariable("value") String value) throws Exception;

/**

* 效果和上面的hmset 一样,只不过当我们存放的数据是对象的时候 也是自动转换为json

* @param key

* @param data

* @return

*/

@RequestMapping(value = "/cache/hmset/{key}", method = RequestMethod.POST)

boolean hmset(@PathVariable("key") String key, @RequestBody Object data);

}

7.3 service修改

我们的service的事务修改为注解模式,并且在我们的业务中,需要将原先的增删改代码中添加修改redis的操作

此处以ApiMappingService为例子

@Service

@Transactional

public class ApiMappingServiceImpl implements ApiMappingService {

@Autowired

private ApiMappingMapper apiMappingMapper;

@Autowired

private CacheService cacheService;

@Autowired

private SendAPIRoutingChangeStream sendAPIRoutingChangeStream;

//数据在redis中的key的前缀,后续可以通过统一的常量类来设置

private final String GATEWAY_REDIS_KEY = "APINAME:";

@Override

public void addApiMapping(ApiMapping mapping) {

apiMappingMapper.addApiMapping(mapping);

cacheService.hmset(GATEWAY_REDIS_KEY + mapping.getGatewayApiName(), mapping);

//此处后续可以添加mq来发送更新数据到网关,减少网关请求缓存的频率,后续添加代码

}

@Override

public void updateApiMapping(ApiMapping mapping) {

apiMappingMapper.updateApiMapping(mapping);

if (mapping.getState() == 1) {

//如果状态还是1 则是更新数据

cacheService.hmset(GATEWAY_REDIS_KEY + mapping.getGatewayApiName(),mapping);

}else{

//如果状态是0 则代表禁用,因此从缓存中删除

cacheService.del(GATEWAY_REDIS_KEY + mapping.getGatewayApiName());

}

//发送消息

//此处后续可以添加mq来发送更新数据到网关,减少网关请求缓存的频率,后续添加代码

}

@Override

public PageInfo<ApiMapping> getMappingList(ApiMapping criteria, int page, int pageSize) {

PageHelper.startPage(page, pageSize);

return new PageInfo<>(apiMappingMapper.getMappingList(criteria));

}

@Override

public ApiMapping getMappingById(int id) {

return apiMappingMapper.getMappingById(id);

}

@Override

public void deleteMapping(int[] ids) {

if (ids == null || ids.length == 0) {

return;

}

for (int id : ids) {

ApiMapping mapping = apiMappingMapper.getMappingById(id);

if (mapping != null) {

mapping.setState(0);

apiMappingMapper.updateApiMapping(mapping);

cacheService.del(GATEWAY_REDIS_KEY + mapping.getGatewayApiName());

//发送消息

//此处后续可以添加mq来发送更新数据到网关,减少网关请求缓存的频率,后续添加代码

}

}

}

}

7.3 主程序

@SpringBootApplication

@MapperScan("com.qianfeng.openapi.web.master.mapper")

@EnableEurekaClient

@EnableFeignClients

@EnableTransactionManagement//开启事务管理

public class WebMasterStartApp {

public static void main (String[] args){

SpringApplication.run(WebMasterStartApp.class,args);

}

}

八、 网关中心

网关的主要作用是对请求进行校验,鉴权,转发,记录日志等功能

8.1 动态路由

8.1.1 介绍

我们知道, zuul是一个反向代理网关,可以代理我们的微服务,但是在实际开发中,我们不会让网关直接显式的代理我们的服务,而是通过动态路由的方式来进行代理,而我们也知道,所谓代理服务就是最终知道请求哪个服务中的哪个地址,参数是什么,所以我们只要想办法告诉zuul这些内容即可

那我们怎么知道用户要请求的是哪个服务的哪个地址呢,同时zuul又通过什么方式来进行转发的呢

zuul中主要是通过RequestContext这个类来进行处理的

我们通过下面的两个方法来指定我们的 服务id和内部的请求地址,其中请求地址包含参数或者是是rest风格地址

那么上面的两个参数如何获得呢, 我们可以给每个服务的每个地址指定一个标识,用户传递标识后,我们通过标识来获取到服务id和请求地址,然后设置到过去,这个就是我们管理平台中定义的路由映射

按照我们的管理平台的逻辑,它将数据放到了redis中,所以我们只要从redis中根据用户传递的标识来进行获取数据,然后设置过去即可

context.put(FilterConstants.SERVICE_ID_KEY, serviceId);

context.put(FilterConstants.REQUEST_URI_KEY, url);

8.1.2 关键代码

创建openapi-zuul工程,导入依赖

<dependencies>

<dependency>

<groupId>org.springframework.cloud</groupId>

<artifactId>spring-cloud-starter-netflix-zuul</artifactId>

</dependency>

<dependency>

<groupId>org.springframework.cloud</groupId>

<artifactId>spring-cloud-starter-netflix-eureka-client</artifactId>

</dependency>

<dependency>

<groupId>org.springframework.cloud</groupId>

<artifactId>spring-cloud-starter-openfeign</artifactId>

</dependency>

<dependency>

<groupId>org.springframework.cloud</groupId>

<artifactId>spring-cloud-starter-netflix-hystrix</artifactId>

</dependency>

<dependency>

<groupId>com.qf</groupId>

<artifactId>openapi-commons</artifactId>

<version>1.0-SNAPSHOT</version>

</dependency>

<!--actuator是监控系统健康,http://ip:port/actuator/routes获取监控端点信息 -->

<dependency>

<groupId>org.springframework.boot</groupId>

<artifactId>spring-boot-starter-actuator</artifactId>

</dependency>

<!--jwt-->

<dependency>

<groupId>io.jsonwebtoken</groupId>

<artifactId>jjwt</artifactId>

<version>0.9.1</version>

</dependency>

</dependencies>

创建application.yml文件

spring:

application:

name: openapi-zuul

eureka:

client:

service-url:

defaultZone: http://localhost:20000/eureka

instance:

prefer-ip-address: true

server:

port: 31000

management:

endpoints:

web:

exposure:

include: '*' #打开所有的监控管理地址

zuul:

ignored-services: '*' #忽略所有的服务,不在代理列表中显示

routes:

openapi-cache: '/*' #配置将所有的请求都转发到openapi-cache缓存服务,目的是保证我们的zuul可以使用,但是实际开发中我们不会将请求转到缓存,可以写一个没有任何功能的测试服务来进行代理

创建启动类

package com.qf;

import org.springframework.boot.SpringApplication;

import org.springframework.boot.autoconfigure.SpringBootApplication;

import org.springframework.cloud.client.discovery.EnableDiscoveryClient;

import org.springframework.cloud.netflix.zuul.EnableZuulProxy;

import org.springframework.cloud.openfeign.EnableFeignClients;

@SpringBootApplication

@EnableZuulProxy

@EnableDiscoveryClient

@EnableFeignClients

public class OpenapiZuulApp {

public static void main (String[] args){

SpringApplication.run(OpenapiZuulApp.class,args);

}

}

创建路由过滤器

package com.qf.filters;

import com.fasterxml.jackson.core.JsonProcessingException;

import com.fasterxml.jackson.databind.ObjectMapper;

import com.netflix.zuul.ZuulFilter;

import com.netflix.zuul.context.RequestContext;

import com.netflix.zuul.exception.ZuulException;

import com.qf.feign.CacheService;

import com.qianfeng.openplatform.commons.beans.BaseResultBean;

import com.qianfeng.openplatform.commons.constans.ExceptionDict;

import com.qianfeng.openplatform.commons.constans.SystemParams;

import org.springframework.beans.factory.annotation.Autowired;

import org.springframework.cloud.netflix.zuul.filters.support.FilterConstants;

import org.springframework.stereotype.Component;

import javax.servlet.http.HttpServletRequest;

import javax.servlet.http.HttpServletResponse;

import java.util.Enumeration;

import java.util.Map;

/**

* 当前过滤器的主要作用是根据用户传递的标识来获取到用户实际想要访问的服务的id和地址,然后再进行转发

*/

@Component

public class RouterFilter extends ZuulFilter {

@Autowired

private CacheService cacheService;

@Autowired

private ObjectMapper objectMapper;

/**

* 当前过滤器是在我们请求的时候执行的,而我们所有的请求都是转到了缓存服务,

* 我们应该在转发之前就将请求转到另外的服务,所以是前置过滤器

*

* @return

*/

@Override

public String filterType() {

return FilterConstants.PRE_TYPE;

}

@Override

public int filterOrder() {

//我们刚才分析过,我们这个过滤器是在前面的各种校验过滤器成功之后才执行的,

// 所以它理论上是最后一个前置过滤器,所以order稍微高一些

return 100;

}

@Override

public boolean shouldFilter() {

return true;//是否启用

//return RequestContext.getCurrentContext().sendZuulResponse();// 根据之前的过滤器结果来决定是否启用当前过滤器

}

@Override

public Object run() throws ZuulException {

//如何拿到请求对象

RequestContext currentContext = RequestContext.getCurrentContext();

HttpServletRequest request = currentContext.getRequest();

//从请求中获取用户的标识数据

//我们应该从用户的请求参数中获取这个数据,那么请求的参数名是什么,

// 我们怎么知道,所以我们作为服务端就要定义规则,我们要求用户必须通过method参数来传递

String gatewayApiName = request.getParameter("gatewayApiName");

//从redis根据用户传递的标识获取路由信息

try {

//获取当前参数的路由映射关系map,这里面放的就是我们的标识对应的服务的id和地址等信息,

// 根据这个信息我们可以拿到要访问的地址和服务id,然后进行服务的跳转

Map<Object, Object> apiMapingInfo = cacheService.hGetAll(SystemParams.METHOD_REDIS_PRE + gatewayApiName);

//获取服务id和地址

if (apiMapingInfo != null&&apiMapingInfo.size()>0) {

Object serviceId = apiMapingInfo.get("serviceId");//我们要访问的服务的id

String insideApiUrl = (String) apiMapingInfo.get("insideApiUrl");//我们要访问的地址

//通过requestcontext设置我们的请求服务id和地址即可

//设置我们要访问的地址

currentContext.put(FilterConstants.SERVICE_ID_KEY, serviceId);

//我们请求中传递的普通参数会一起跟随转发过去

//但是经过我们的测试,我们的rest风格的请求是无法实现的转发的,因为我们在定义请求映射的时候就通过占位符来声明了请求的路径, 比如 test01_02 对应的是/testservice01/test02/{name}这个地址

//我们应该将/testservice01/test02/{name}中的{name}实际替换为我们的真正的参数,否则我们的请求就会吧{name}作为真正的参数传递到下游的服务中,导致参数出现问题

//我们应该想办法替换掉参数,怎么替换呢?我们需要知道用户请求的参数的中一一对应的关系,比如用户传递了name age两个参数,我们如何区分哪个对应哪个

//所以我们作为服务端要开始定义规则,我们定义的规则是我们占位符中的名字和请求参数中的名字必须保持一致,这个我们只需要将请求参数中对应的值替换掉占位符就可以了

//比如我们服务请求的地址是/testservice01/test02/{name},那么用户必须传递一个叫name的参数比如name=lisi,我们只需要将lisi替换掉{name}就可以

//因为我们不清楚到底有什么占位符,所以比较难替换,所以我们使用逆向思维,我们看看用户传递了什么请求参数,将请求参数进行遍历,然后看看这个参数有没有对应的占位符,有的话就替换掉

Enumeration<String> parameterNames = request.getParameterNames();//获取所有的参数名

while (parameterNames.hasMoreElements()) {

String paramName = parameterNames.nextElement();//获取当前的参数名

insideApiUrl = insideApiUrl.replace("{" + paramName + "}", request.getParameter(paramName));//将符合当前遍历的参数名的占位符替换为请求参数的值

}

currentContext.put(FilterConstants.REQUEST_URI_KEY, insideApiUrl);

return null;//返回值没有任何意义

}

} catch (Exception e) {

e.printStackTrace();

}

//说明路由失败,拦截请求,返回错误信息

currentContext.setSendZuulResponse(false);

HttpServletResponse response = currentContext.getResponse();

// response.setContentType("text/html;charset=utf-8");

//currentContext.setResponseBody("路由失败,检查参数");

BaseResultBean bean = new BaseResultBean();

bean.setCode(ExceptionDict.ROUTING_ERROR);

bean.setMsg("与 "+gatewayApiName+" 相关的服务没有找到,请确认后再重试");

response.setContentType("appliaction/json;charset=utf-8");

try {

currentContext.setResponseBody(objectMapper.writeValueAsString(bean));

} catch (JsonProcessingException e) {

e.printStackTrace();

}

return null;

}

}

8.2 请求参数校验

8.2.1 介绍

通过上面的功能,我们发现我们要求用户必须传递mehtod参数来获取请求的数据,但是如果用户没有传递的话,我们去查询缓存也没有任何意义,所以我们在查询之前要求用户必须传递这个参数, 所以我们必须校验用户有没有传递,校验的方式很简单,我们只要查询下这个参数有没有值即可, 但是我们怎么知道我们需要校验哪些参数呢,如果需要校验的参数发生变化怎么办,我们需要知道发生了变化, 所以我们在运营管理平台中将这些参数同步到了缓存中,所以我们只需要从缓存中获取即可,然后遍历获取数据即可

8.2.2 关键代码

关键代码,主要是说明逻辑

package com.qf.filters;

import com.fasterxml.jackson.core.JsonProcessingException;

import com.fasterxml.jackson.databind.ObjectMapper;

import com.netflix.zuul.ZuulFilter;

import com.netflix.zuul.context.RequestContext;

import com.netflix.zuul.exception.ZuulException;

import com.qf.feign.CacheService;

import com.qianfeng.openplatform.commons.beans.BaseResultBean;

import com.qianfeng.openplatform.commons.constans.ExceptionDict;

import com.qianfeng.openplatform.commons.constans.SystemParams;

import org.springframework.beans.factory.annotation.Autowired;

import org.springframework.cloud.netflix.zuul.filters.support.FilterConstants;

import org.springframework.stereotype.Component;

import org.springframework.util.StringUtils;

import javax.servlet.http.HttpServletRequest;

import javax.servlet.http.HttpServletResponse;

import java.util.Set;

/**

* 当前过滤器主要针对的是整个网关中公共的系统参数的校验,判断用户有没有按照我们的要求传递必须的参数

*/

@Component

public class SystemParamsFilter extends ZuulFilter {

@Autowired

private CacheService cacheService;

@Autowired

private ObjectMapper objectMapper;

@Override

public String filterType() {

return FilterConstants.PRE_TYPE;

}

/**

* 我们应该先判断用户有没有传递参数,没有的话就返回错误数据

*

* @return

*/

@Override

public int filterOrder() {

return 10;

}

@Override

public boolean shouldFilter() {

return true;

}

@Override

public Object run() throws ZuulException {

RequestContext context=RequestContext.getCurrentContext();

//我们要做的事情是判断有没有传递我们要求的参数

//需要的数据内容: 1 我们要求传递的参数是什么

//我们如何知道我们要求传递的参数

HttpServletRequest request = context.getRequest();

try {

//我们保存在了redis中,所以从redis中查询即可

Set<Object> systemparamsSet = cacheService.sMembers(SystemParams.SYSYTEMPARAMS);

//当我们有了数据之后,怎么知道用户有没有传递呢?

//只要遍历我们的参数,挨个获取一次数据,没有值的都是没有传递的

if (systemparamsSet != null) {

for (Object param : systemparamsSet) {

String value = request.getParameter(param.toString());//获取当前参数的值

if (StringUtils.isEmpty(value)) {

//代表当前参数没有传递

context.setSendZuulResponse(false);

HttpServletResponse response = context.getResponse();

response.setContentType("appliaction/json;charset=utf-8");

BaseResultBean bean = new BaseResultBean();

bean.setCode(ExceptionDict.SYSTEMPARAM_MISSED);

bean.setMsg("必须传递参数名为:"+param+"的数据");

try {

context.setResponseBody(objectMapper.writeValueAsString(bean));

} catch (JsonProcessingException e) {

e.printStackTrace();

}

}

}

}

} catch (Exception e) {

e.printStackTrace();

}

return null;

}

}

8.3 服务参数校验

除了所有服务都共同的参数之外,还有一些是每个服务必须传递的参数,我们也需要对这些参数进行校验,方式和系统参数一致,只不过系统参数在redis中的key是固定的,每个服务的参数和具体服务标识相关,所以只需要根据用户传递的标识找到这个服务需要的参数进行校验即可,此处我们不对代码进行编写,大家自己按照上面的思路编写

8.4 时间戳校验

8.4.1介绍

我们的服务为了防止请求被拦截后对数据进行修改,所以我们会要求用户传递时间戳过来,我们会对时间戳的有效期进行校验,比如我们要求有效期为1分钟,当用户传递的有效期和服务器收到的i系统时间差超过1分钟的时候,我们将认为请求无效

8.4.2 核心代码

package com.qf.filters;

import com.fasterxml.jackson.core.JsonProcessingException;

import com.fasterxml.jackson.databind.ObjectMapper;

import com.netflix.zuul.ZuulFilter;

import com.netflix.zuul.context.RequestContext;

import com.netflix.zuul.exception.ZuulException;

import com.qianfeng.openplatform.commons.beans.BaseResultBean;

import com.qianfeng.openplatform.commons.constans.ExceptionDict;

import org.springframework.beans.factory.annotation.Autowired;

import org.springframework.cloud.netflix.zuul.filters.support.FilterConstants;

import org.springframework.stereotype.Component;

import javax.servlet.http.HttpServletRequest;

import javax.servlet.http.HttpServletResponse;

import java.text.SimpleDateFormat;

import java.util.Date;

/**

* 当前过滤器主要是对用户请求的时间进行校验,判断是否在我们要求的时间范围内

*/

@Component

public class TimestampFilter extends ZuulFilter {

private SimpleDateFormat simpleDateFormat = new SimpleDateFormat("yyyy-MM-dd HH:mm:ss");

@Autowired

private ObjectMapper objectMapper;

@Override

public String filterType() {

return FilterConstants.PRE_TYPE;

}

@Override

public int filterOrder() {

return 20;

}

@Override

public boolean shouldFilter() {

return RequestContext.getCurrentContext().sendZuulResponse();

}

@Override

public Object run() throws ZuulException {

//获取到用户传递的时间戳,我们要求的是到秒级别,同时我们要求传递的时间戳格式为yyyy-MM-dd HH:mm:ss

RequestContext context = RequestContext.getCurrentContext();

HttpServletRequest request = context.getRequest();

String timestamp = request.getParameter("timestamp");

//获取当前的系统时间

//比较两个时间是不是在允许的范围差内

try {

Date requestDate = simpleDateFormat.parse(timestamp);//转换请求时间为date对象

System.out.println(requestDate+"-----------");

long currentTimeMillis = System.currentTimeMillis();//获取当前时间的毫秒值

long requestDateTime = requestDate.getTime();

if (currentTimeMillis - requestDateTime < 0 || currentTimeMillis - requestDateTime > 60000) {

//如果当前服务器的时间小于用户的传递时间或者是当前服务器的时间和用户的请求时间差大于1分钟,则代表请求无效

//抛出异常的原因是因为我们可能会出现日期转换异常,也需要给用户提示相应的错误信息,所以在这里直接抛出异常,下面捕获即可

throw new RuntimeException();

}

} catch (Exception e) {

e.printStackTrace();

context.setSendZuulResponse(false);

HttpServletResponse response = context.getResponse();

response.setContentType("appliaction/json;charset=utf-8");

BaseResultBean bean = new BaseResultBean();

bean.setCode(ExceptionDict.SYSTEMPARAM_TIME_STAMP_ERROR);

bean.setMsg("时间戳格式不对");

try {

context.setResponseBody(objectMapper.writeValueAsString(bean));

} catch (JsonProcessingException ex) {

ex.printStackTrace();

}

}

return null;

}

}

8.5 签名校验

8.5.1 介绍

因为每次请求执行的操作可能包含敏感操作,比如牵扯到扣费等,因此我们需要对用户的请求进行验证,以防止被他人非法请求,我们使用的方式是通过签名进行校验,通过比较用户在请求时候生成传递的签名和服务器计算生成的签名进行比较,一致则通过,不一致则不通过,

8.5.2 规则描述

因为牵扯到数据的计算,所以必须存在一定的规则,并且规则要保证双方采用的一致,我们的规则如下:

将请求参数按照参数名的字典顺序进行组合 比如传递的参数是method=taobao.order,get&appkey=abcdef

组合后的参数为appkeyabcdefmethodtaobao.order,get

在上面的数据前面拼上用户的appsecret 比如用户的appsecret为asdfghj 则结果为asdfghjappkeyabcdefmethodtaobao.order,get

将上面的结果生成MD5值如 dasdasdasdasd,并将md5值以 sign为参数名添加到请求参数中

最终的请求参数为method=taobao.order,get&appkey=abcdef&sign=dasdasdasdasd

服务端收到参数后,将除了sign外的参数按照上面的顺序再次生成sign值,并和用户传递的比较,一致则通过

8.5.3 工具类

package com.qf.utils;

import java.security.MessageDigest;

import java.security.NoSuchAlgorithmException;

import java.util.Iterator;

import java.util.Map;

import java.util.TreeMap;

public class Md5Util {

/**

* 二行制转字符串

*/

private static String byte2hex(byte[] b) {

StringBuffer hs = new StringBuffer();

String stmp = "";

for (int n = 0; n < b.length; n++) {

stmp = (Integer.toHexString(b[n] & 0XFF));

if (stmp.length() == 1)

hs.append("0").append(stmp);

else

hs.append(stmp);

}

return hs.toString().toUpperCase();

}

/***

* 对请求的参数排序,生成定长的签名

* @param paramsMap 排序后的字符串

* @param secret 密钥

* */

public static String md5Signature(Map<String, String> paramsMap, String secret) {

String result = "";

StringBuilder sb = new StringBuilder();

Map<String, String> treeMap = new TreeMap<String, String>();

treeMap.putAll(paramsMap);

sb.append(secret);

Iterator<String> iterator = treeMap.keySet().iterator();

while (iterator.hasNext()) {

String name = (String) iterator.next();

sb.append(name).append(treeMap.get(name));

}

sb.append(secret);

try {

MessageDigest md = MessageDigest.getInstance("MD5"); /**MD5加密,输出一个定长信息摘要*/

result = byte2hex(md.digest(sb.toString().getBytes("utf-8")));

} catch (Exception e) {

throw new RuntimeException("sign error !");

}

return result;

}

/**

* Calculates the MD5 digest and returns the value as a 16 element

* <code>byte[]</code>.

*

* @param data Data to digest

* @return MD5 digest

*/

public static byte[] md5(String data) {

return md5(data.getBytes());

}

/**

* Calculates the MD5 digest and returns the value as a 16 element

* <code>byte[]</code>.

*

* @param data Data to digest

* @return MD5 digest

*/

public static byte[] md5(byte[] data) {

return getDigest().digest(data);

}

/**

* Returns a MessageDigest for the given <code>algorithm</code>.

*

* @param

* @return An MD5 digest instance.

* @throws RuntimeException when a {@link NoSuchAlgorithmException} is

* caught

*/

static MessageDigest getDigest() {

try {

return MessageDigest.getInstance("MD5");

} catch (NoSuchAlgorithmException e) {

throw new RuntimeException(e);

}

}

}

8.5.4 核心代码

package com.qf.filters;

import com.fasterxml.jackson.core.JsonProcessingException;

import com.fasterxml.jackson.databind.ObjectMapper;

import com.netflix.zuul.ZuulFilter;

import com.netflix.zuul.context.RequestContext;

import com.netflix.zuul.exception.ZuulException;

import com.qf.feign.CacheService;

import com.qf.utils.Md5Util;

import com.qianfeng.openplatform.commons.beans.BaseResultBean;

import com.qianfeng.openplatform.commons.constans.ExceptionDict;

import com.qianfeng.openplatform.commons.constans.SystemParams;

import org.springframework.beans.factory.annotation.Autowired;

import org.springframework.cloud.netflix.zuul.filters.support.FilterConstants;

import org.springframework.stereotype.Component;

import javax.servlet.http.HttpServletRequest;

import javax.servlet.http.HttpServletResponse;

import java.util.Enumeration;

import java.util.HashMap;

import java.util.Map;

/**

* 当前的过滤器主要作用是用于校验用户的请求中的签名是否正确,来判断是否是合法的请求

*/

@Component

public class SignFilter extends ZuulFilter {

@Autowired

private CacheService cacheService;

@Autowired

private ObjectMapper objectMapper;

@Override

public String filterType() {

return FilterConstants.PRE_TYPE;

}

@Override

public int filterOrder() {

return 30;

}

@Override

public boolean shouldFilter() {

return RequestContext.getCurrentContext().sendZuulResponse();

}

@Override

public Object run() throws ZuulException {

/**

* 首先回顾下我们的规则, 我们的规则是将用户传递的参数中除了签名之外的数据 按照key的字典顺序进行排序,然后将排序后数据按照keyvaluekeyvalue的方式进行拼接字符串

* 然后再获取用户的签名的秘钥,进行拼接,得到一个新的字符串,然后计算md5值,将计算的结果和用户传递的数据进行比较,一直则放行

* 我们需要的数据就是用户传递的参数, 用户的app的秘钥,用户传递的签名

*/

RequestContext context = RequestContext.getCurrentContext();

HttpServletRequest request = context.getRequest();

Enumeration<String> parameterNames = request.getParameterNames();//获取所有的参数的名字

Map<String, String> signMap = new HashMap<>();//用于保存除了签名之前的数据

while (parameterNames.hasMoreElements()) {

String name = parameterNames.nextElement();//获取每一个参数的名字

if (!"sign".equalsIgnoreCase(name)) {

signMap.put(name, request.getParameter(name));//保存除了sign之外的数据

}

}

//我们现在要获取appsecret

String app_key = request.getParameter("app_key");//获取应用的app key

try {

// Map<Object, Object> appInfoMap = cacheService.hGetAll(SystemParams.APPKEY_REDIS_PRE + app_key);

// if (appInfoMap != null) {

// Object appSecret = appInfoMap.get("appSecret");

// }

//和上面获取方式一样

String appSecret = cacheService.hGet(SystemParams.APPKEY_REDIS_PRE + app_key, "appSecret");

String md5Signature = Md5Util.md5Signature(signMap, appSecret);//计算用户传递的参数应该得到的签名

String sign = request.getParameter("sign");//用户传递的签名

System.err.println("系统计算的签名:" + md5Signature);

System.err.println("用户传递的签名:" + sign);

if (md5Signature.equalsIgnoreCase(sign)) {

return null;//校验通过

}

} catch (Exception e) {

e.printStackTrace();

}

//不管发生什么情况导致的校验失败,最终都会来这里执行代码

context.setSendZuulResponse(false);

HttpServletResponse response = context.getResponse();

response.setContentType("appliaction/json;charset=utf-8");

BaseResultBean bean = new BaseResultBean();

bean.setCode(ExceptionDict.SYSTEMPARAM_SIGN_ERROR);

bean.setMsg("签名校验失败");

try {

context.setResponseBody(objectMapper.writeValueAsString(bean));

} catch (JsonProcessingException ex) {

ex.printStackTrace();

}

return null;

}

}

8.6 幂等性校验

8.6.1 介绍

我们的很多请求不允许用户重复发起请求,一般情况下所有的修改类型的操作都不允许,比如添加,删除,更新操作,但是查询操作一般都可以重复请求,这就是请求的幂等性,对于有幂等性要求的服务每次都需要发起新请求,即便是请求参数一致,但是时间戳肯定也不一致,最终签名也不一致,对于幂等性的校验也非常简单,因为幂等性的请求签名一定是一致的,所以我们只要判断当前传递的签名有没有出现过即可,我们只要以签名作为key,随便放个数据到redis中,判断的时候从redis之前key获取数据,如果有则代表重复,没有则代表没有请求过,不重复,然后放入到redis中一份即可

接口幂等性就是用户对于同一操作发起的一次请求或者多次请求的结果是一致的,不会因为多次点击而产生了副作用。举个最简单的例子,那就是支付,用户购买商品后支付,支付扣款成功,但是返回结果的时候网络异常,此时钱已经扣了,用户再次点击按钮,此时会进行第二次扣款,返回结果成功,用户查询余额返发现多扣钱了,流水记录也变成了两条...这就没有保证接口的幂等性

8.6.2 核心代码

package com.qf.filters;

import com.fasterxml.jackson.core.JsonProcessingException;

import com.fasterxml.jackson.databind.ObjectMapper;

import com.netflix.zuul.ZuulFilter;

import com.netflix.zuul.context.RequestContext;

import com.netflix.zuul.exception.ZuulException;

import com.qf.feign.CacheService;

import com.qianfeng.openplatform.commons.beans.BaseResultBean;

import com.qianfeng.openplatform.commons.constans.ExceptionDict;

import com.qianfeng.openplatform.commons.constans.SystemParams;

import org.springframework.beans.factory.annotation.Autowired;

import org.springframework.cloud.netflix.zuul.filters.support.FilterConstants;

import org.springframework.stereotype.Component;

import javax.servlet.http.HttpServletRequest;

import javax.servlet.http.HttpServletResponse;

/**

* 这个是针对所有需要幂等性校验的服务进行的过滤器

*/

@Component

public class IdempotentsFilter extends ZuulFilter {

@Autowired

private CacheService cacheService;

@Autowired

private ObjectMapper objectMapper;

@Override

public String filterType() {

return FilterConstants.PRE_TYPE;

}

@Override

public int filterOrder() {

return 40;

}

/**

* 如果前面的过滤器拦截了请求,则不执行,同时如果当前请求的服务是一个非幂等性的服务,也不需要进行拦截,所以此处需要两个判断条件

*/

@Override

public boolean shouldFilter() {

//根据用户请求的服务,获取到服务的信息,然后看看服务是不是需要幂等性的要求

RequestContext context = RequestContext.getCurrentContext();

HttpServletRequest request = context.getRequest();

String gatewayApiName = request.getParameter("gatewayApiName");//用户要请求的服务的名字

//通过查询redis来获取这个服务的幂等性

boolean isIdempotents = true;//幂等性默认是true

try {

String idempotents = cacheService.hGet(SystemParams.METHOD_REDIS_PRE + gatewayApiName,"idempotents");

isIdempotents = "1".equals(idempotents);//判断是不是幂等性的,1表示幂等,0表示非幂等

} catch (Exception e) {

e.printStackTrace();

}

System.out.println("isIdempotents:"+isIdempotents);

return context.sendZuulResponse() && isIdempotents;//启用的条件中包含了是不是幂等性要求的服务

}

@Override

public Object run() throws ZuulException {

//我们当前的过滤器是要判断请求是不是已经执行过一次了

//根据我们的要求我们需要什么数据来进行这个判断

//当前的请求是什么?我们如何区分的

//我们如何知道请求已经执行过一次了,大家注意,我们遇到这个如何判断,如何区分,怎么样xxx之类的需求的时候一般都是需要数据去做比较,那么数据一定是保存在某个地方,比如某个变量,放在数据库,放在缓存,或者是在什么容器中等等

//我们想一下,要想判断请求是不是执行过,需要请求有一个唯一的可以区分的标识,签名,签名是唯一的,因为不同的参数会有不同的签名,不同的app会有不同的appkey,相同的app不同的服务会有不同的method,相同的服务会有不同的参数,相同的参数中会有不同的时间戳

//如果一切都一样,说明就是一个一样的请求

//请求被执行过一次之后我们可以将标识保存起来,当下次请求再来的时候我们拿到签名去看看这个标识存在还是不存在,不存在则代表没有执行过,存在则代表执行过

//实际上我们可以签名作为key向redis中保存任意一个数据,我们首先获取,没有就代表没有,有就代表执行过

RequestContext context = RequestContext.getCurrentContext();

HttpServletRequest request = context.getRequest();

String sign = request.getParameter("sign");//获取用户传递的签名

try {

String idempotents = cacheService.getFromRedis(SystemParams.IDEMPOTENTS_REDIS_PRE + sign);//获取当前签名对应的数据

//如果不为空则代表是已经请求过了,如果为空则代表没有请求国

if (idempotents != null) {

context.setSendZuulResponse(false);

HttpServletResponse response = context.getResponse();

response.setContentType("appliaction/json;charset=utf-8");

BaseResultBean bean = new BaseResultBean();

bean.setCode(ExceptionDict.SYSTEMPARAM_IDEMPOTENTS_ERROR);

bean.setMsg("当前服务不允许重复提交数据");

try {

context.setResponseBody(objectMapper.writeValueAsString(bean));

} catch (JsonProcessingException ex) {

ex.printStackTrace();

}

}else{

//有效期不会是永久的,因为一旦时间戳过期了,用户一定要传递新的时间,那么签名一定会发生变化,所以我们的有效期和时间戳的有效期保持一致即可

cacheService.save2Redis(SystemParams.IDEMPOTENTS_REDIS_PRE + sign, System.currentTimeMillis()+"",60000);

}

} catch (Exception e) {

e.printStackTrace();

}

return null;

}

}

8.7 限流

8.7.1 介绍

对于开放平台中的一些免费的接口或者是针对一个用户方位所有的免费接口会存在限制次数的问题,比如我们当前平台的规则是每个用户每天可以访问所有免费接口多少次,因此,当用户访问免费接口的时候我们需要对他现在剩余的次数进行校验,如果还有免费次数,则允许访问,所以我们只要知道当前服务是不是免费的,以及用户有没有剩余次数即可

8.7.2 核心代码

/**

*

* 此过滤器的主要作用是针对所有免费的服务进行统一次数的访问限制

* 需要注意:我们的免费接口的限制次数一般不会是永久的,一般比如一天限制多少次,或者是一周或者是 1 个月等等,所以每次进入新的统计周日的时候需要恢复用户的限制次数

* 比如一天 10 万次,当天用完了,当晚上 0 点的时候需要给用户恢复次数,所以需要一个定时任务,但是也要注意,这个定时任务应该要保证一定能执行,所以必须是保证高可用的分布式任务

*

* @Author jackiechan

*/

package com.qf.filters;

import com.fasterxml.jackson.core.JsonProcessingException;

import com.fasterxml.jackson.databind.ObjectMapper;

import com.netflix.zuul.ZuulFilter;

import com.netflix.zuul.context.RequestContext;

import com.netflix.zuul.exception.ZuulException;

import com.qf.feign.CacheService;

import com.qianfeng.openplatform.commons.beans.BaseResultBean;

import com.qianfeng.openplatform.commons.constans.ExceptionDict;

import com.qianfeng.openplatform.commons.constans.SystemParams;

import org.springframework.beans.factory.annotation.Autowired;

import org.springframework.cloud.netflix.zuul.filters.support.FilterConstants;

import org.springframework.stereotype.Component;

import javax.servlet.http.HttpServletRequest;

import javax.servlet.http.HttpServletResponse;

/**

* 当前过滤器的主要作用是对免费的接口进行限流,判断用户是否还有免费次数可以访问

*

*/

@Component

public class LimitFilter extends ZuulFilter {

@Autowired

private CacheService cacheService;

@Autowired

private ObjectMapper objectMapper;

@Override

public String filterType() {

return FilterConstants.PRE_TYPE;

}

/**

* 当前过滤器的级别比路由的低一些,原因是我们必须要保证用户访问的是一个正确的服务才进行次数扣除,所以我们通过路由的过滤器来进行了这个合法性的判断

* 大家注意并不是说路由的过滤器执行了就代表服务请求了,而是要等所有的前置过滤器都执行完成后才会请求服务,路由过滤器只是用来设置要请求什么服务

* @return

*/

@Override

public int filterOrder() {

return 110;

}

@Override

public boolean shouldFilter() {

//当前的过滤器针对的是免费的服务,所以还是要先判断接口的收费性

RequestContext context = RequestContext.getCurrentContext();

HttpServletRequest request = context.getRequest();

String gatewayApiName = request.getParameter("gatewayApiName");//用户要请求的服务的名字

//通过查询redis来获取这个服务的needfee,默认设置true表示免费

boolean isFree = true;

try {

String free = cacheService.hGet(SystemParams.METHOD_REDIS_PRE + gatewayApiName,"needfee");

isFree = "0".equals(free);//0表示免费,1表示收费

} catch (Exception e) {

e.printStackTrace();

}

return context.sendZuulResponse() && isFree;

}

@Override

public Object run() throws ZuulException {

//我们的目标是判断当前用户是否还有剩余的次数访问这个服务

//我们只需要知道剩余次数是多少就可以了

//我们只需要从redis中自减1得到的结果只要大于等于0就可以了

//获取用户传递的app_key

RequestContext context = RequestContext.getCurrentContext();

HttpServletRequest request = context.getRequest();

String app_key = request.getParameter("app_key");

// String limit = cacheService.hGet(SystemParams.APPKEY_REDIS_PRE + app_key, "limit");

Long times = null;//自减后的剩余次数

try {

times = cacheService.hIncrementId(SystemParams.APPKEY_REDIS_PRE + app_key, "limit", -1L);

//TODO 将剩余的次数同步到数据库中

if (times < 0) {

//不能访问了

context.setSendZuulResponse(false);

HttpServletResponse response = context.getResponse();

response.setContentType("appliaction/json;charset=utf-8");

BaseResultBean bean = new BaseResultBean();

bean.setCode(ExceptionDict.LIMIT_ERROR);

bean.setMsg("超出本日的免费次数限制");

try {

context.setResponseBody(objectMapper.writeValueAsString(bean));

} catch (JsonProcessingException ex) {

ex.printStackTrace();

}

}

} catch (Exception e) {

e.printStackTrace();

}

return null;

}

}

8.8 计费

8.8.1 规则

对于收费的接口,我们需要进行计费扣除,如果用户有钱才会继续访问,没有钱的话就不能访问,本过滤器主要是给用户扣钱的,扣钱后剩余的钱数大于0则即可,不大于0则需要给用户加回去

/**

* 此过滤器是针对收费的服务进行计费使用的,关于计费的策略问题,有可能是按照套餐扣除的,有的时候按照次数计费的,所以我应该是针对不同的情况不同处理

* 假设我们当前的过滤器是按照次数计费的

* 考虑到我们的每次请求的费用很低,所以呢我们在保存用户的钱数的时候我们需要的计量单位也要非常精确,比如我们使用毫来保存 ,1块钱=10000毫

*/

package com.qf.filters;

import com.fasterxml.jackson.core.JsonProcessingException;

import com.fasterxml.jackson.databind.ObjectMapper;

import com.netflix.zuul.ZuulFilter;

import com.netflix.zuul.context.RequestContext;

import com.netflix.zuul.exception.ZuulException;

import com.qf.feign.CacheService;

import com.qianfeng.openplatform.commons.beans.BaseResultBean;

import com.qianfeng.openplatform.commons.constans.ExceptionDict;

import com.qianfeng.openplatform.commons.constans.SystemParams;

import org.springframework.beans.factory.annotation.Autowired;

import org.springframework.cloud.netflix.zuul.filters.support.FilterConstants;

import org.springframework.stereotype.Component;

import javax.servlet.http.HttpServletRequest;

import javax.servlet.http.HttpServletResponse;

/**

* 当前过滤器的主要作用是对收费接口的计费处理

*/

@Component

public class FeeFilter extends ZuulFilter {

@Autowired

private CacheService cacheService;

@Autowired

private ObjectMapper objectMapper;

@Override

public String filterType() {

return FilterConstants.PRE_TYPE;

}

@Override

public int filterOrder() {

return 111;

}

@Override

public boolean shouldFilter() {

//当前的过滤器针对的是免费的服务,所以还是要先判断接口的收费性

RequestContext context = RequestContext.getCurrentContext();

HttpServletRequest request = context.getRequest();

String gatewayApiName = request.getParameter("gatewayApiName");//用户要请求的服务的名字

//通过查询redis来获取这个服务needfee

boolean isFree = true;

try {

String free = cacheService.hGet(SystemParams.METHOD_REDIS_PRE + gatewayApiName, "needfee");

isFree = "1".equals(free);//判断是不是收费的,1表示收费

} catch (Exception e) {

e.printStackTrace();

}

return context.sendZuulResponse() && isFree;

}

@Override

public Object run() throws ZuulException {

RequestContext context = RequestContext.getCurrentContext();

HttpServletRequest request = context.getRequest();

String app_key = request.getParameter("app_key");

//根据appkey找到所属的客户id

try {

String cusId = cacheService.hGet(SystemParams.APPKEY_REDIS_PRE + app_key, "cusId");

if (cusId != null) {

Long money = cacheService.hIncrementId(SystemParams.CUSTOMER_REDIS_PRE + cusId, "money", -2);

if (money < 0) {

//代表用户没钱了,我们要把上面扣除的给加回去,以免用户本来剩余1或者0的时候被我们减成了负数,这不合理

cacheService.hIncrementId(SystemParams.CUSTOMER_REDIS_PRE + cusId, "money", 2);

}else{

//有钱的情况下是不拦截的

return null;

}

}

} catch (Exception e) {

e.printStackTrace();

}

//根据客户id对客户的钱进行计费处理

context.setSendZuulResponse(false);

HttpServletResponse response = context.getResponse();

response.setContentType("appliaction/json;charset=utf-8");

BaseResultBean bean = new BaseResultBean();

bean.setCode(ExceptionDict.FEE_ERROR);

bean.setMsg("你个QB,赶紧充钱");

try {

context.setResponseBody(objectMapper.writeValueAsString(bean));

} catch (JsonProcessingException ex) {

ex.printStackTrace();

}

return null;

}

}

//TODO 计费可能会分为很多情况,我们这个主要针对的就是按次固定扣费, 用户可能针对某个服务或者是针对所有服务有包月或者套餐服务

//TODO 实际应该根据服务的状态或者是客户的现在的套餐状况,以及每个服务的具体的钱数来进行代码编写

8.9 二级缓存动态更新(了解)

8.9.1 介绍

我们的参数过滤,动态路由等数据发生变化的次数比较少,所以没有必要每次都从redis中获取的话会导致redis负载较高,所以我们可以在网关本地存放一次,当数据发生变化的时候动态更新一次网关即可,这样既可以在网关内部将请求处理掉,而不用每次都从redis中获取,本例子以路由映射进行动态更新

8.9.2 本次缓存

我们的网关在程序启动的时候先缓存一份数据到本地,这样请求来的时候就可以直接使用了

8.9.2.1 方式1

我们可以利用servlet的listener来监听程序的启动,在启动的时候从redis中获取一次数据缓存到本地

@WebListener

public class CacheInitListener implements ServletContextListener {

@Autowired

private CacheService cacheService;

@Override

public void contextInitialized(ServletContextEvent sce) {

System.err.println("程序启动了");

//找到所有的和我们的映射相关的数据,保存起来

Set<String> set = cacheService.findKeyByPartten(SystemParams.METHOD_REDIS_PRE+"*");

if (set != null) {

for (String key : set) {

try {

Map<Object, Object> apiInfoMap = cacheService.hGetAll(key);//根据每一个 key 获取到对应的数据

SystemParams.API_ROUTING_MAP.put(key, apiInfoMap);

} catch (Exception e) {

e.printStackTrace();

}

}

}

}

}

8.9.2.2 方式2

我们知道 spring也是通过listener来监听程序启动并初始化对象的,所以我们也可以认为这些对象就是在程序启动的时候创建并初始化的,所以我们可以利用spring创建对象的初始化方法来从redis中查询数据缓存到本地

/**

* spring 有一个 listener,用于初始化对象的,当前对象会在里面被初始化,是不是相当于在 spring 的 listener 内部创建了当前对象

* 这个时候我们再执行一个PostConstruct对应的方法,是不是相当于在 spring 的 listener 中执行了这个方法

* @Author jackiechan

*/

@Component

public class InitApiRouting {

@Autowired

private CacheService cacheService;

@PostConstruct //在构造方法执行之后执行

public void init() {

System.err.println("init方法执行");

Set<String> set = cacheService.findKeyByPartten(SystemParams.METHOD_REDIS_PRE+"*");

if (set != null) {

for (String key : set) {

try {

Map<Object, Object> apiInfoMap = cacheService.hGetAll(key);//根据每一个 key 获取到对应的数据

SystemParams.API_ROUTING_MAP.put(key, apiInfoMap);

} catch (Exception e) {

e.printStackTrace();

}

}

}

}

}

8.9.3 动态更新

8.9.3.1 介绍

当我们在管理平台更新了数据后,我们需要同步到网关中,实时同步的最好方式是由管理平台来主动告诉网关,因此我们通过mq发送消息的方式来通知网关,网关收到消息后查询最新数据即可,我们使用的是springcloud stream的方式

8.9.3.2 依赖导入

在webmaster和zuul中都导入以下依赖

<!--

用于发送 mq 消息的

-->

<dependency>

<groupId>org.springframework.cloud</groupId>

<artifactId>spring-cloud-starter-stream-rabbit</artifactId>

</dependency>

8.9.3.3 stream接口定义

webmaster stream

public interface SendAPIRoutingChangeStream {

@Output("apiroutingchange")//output 声明当前是生产者,会将消息发送到apiroutingchange交换机

MessageChannel message_channel();

}

zuul stream

public interface ReceviedAPIRoutingChangeStream {

@Input("apiroutingchange")//声明当前是消费者,监听是是apiroutingchange交换机,spring 会自动帮我们创建消息队列并绑定到交换机上

SubscribableChannel subscribable_channel();

}

8.9.3.4 消息对象定义

消息类型枚举对象

public enum APIRoutingType {

UPDATE,DELETE //定义了更新和删除路由的类型

}

消息对象

public class APIRoutingMQBean implements Serializable {

private String key;

private APIRoutingType type;

public String getKey() {

return key;

}

public void setKey(String key) {

this.key = key;

}

public APIRoutingType getType() {

return type;

}

public void setType(APIRoutingType type) {

this.type = type;

}

@Override

public String toString() {

return "APIRoutingMQBean{" +

"key='" + key + '\'' +

", type=" + type +

'}';

}

}

8.9.3.5webmaster 服务修改

我们只需要在webmaster的service的增删改操作中发送消息即可

8.9.3.6 zuul stream listener

@Component

public class APIRoutingStreamListener {

@Autowired

private CacheService cacheService;

@StreamListener("apiroutingchange")//监听对应的交换机,实际上是自动创建了一个队列,绑定了这个交换机,监听的实际上是队列

public void onMessage(APIRoutingMQBean bean) {

System.err.println("收到了一个消息" + bean);

switch (bean.getType()) {

case UPDATE:

//从redis 中重新获取当前数据,然后替换掉 map 中的数据或者是添加到 map 中取决于webmster 执行的是添加还是更新操作

String key = bean.getKey();//拿到要获取的数据的 key

try {

Map<Object, Object> apiInfoMap = cacheService.hGetAll(key);

SystemParams.API_ROUTING_MAP.put(key, apiInfoMap);//添加或者替换数据

} catch (Exception e) {

e.printStackTrace();

}

break;

case DELETE:

SystemParams.API_ROUTING_MAP.remove(bean.getKey());//从本地删除

break;

}

}

}

8.10 登陆鉴权

8.10.1 介绍