Nginx简介

Nginx 是高性能的 HTTP 和反向代理的web服务器,处理高并发能力是十分强大的,能经受高负 载的考验,有报告表明能支持高达 50,000 个并发连接数。

其特点是占有内存少,并发能力强,事实上nginx的并发能力确实在同类型的网页服务器中表现较好,中国大陆使用nginx网站用户有:百度、京东、新浪、网易、腾讯、淘宝等。

nginx可以提供的服务

- Nginx 作为 web 服务器

Nginx 可以作为静态页面的 web 服务器,同时还支持 CGI 协议的动态语言,比如 perl、php 等。但是不支持 java。Java 程序只能通过与 tomcat 配合完成

- Nginx做反向代理实现负载均衡(主要)

客户只需要将请求发送到反向代理服务器nginx,由反向代理服务器去选择目标服务器获取数据后,再返回给客户端。利于解决横向增加服务器的扩容问题。

反向代理对于客户端而言隐藏了目标服务器IP地址,其主功能是可以做负载均衡和安全防护。nginx服务器是一个高性能的http web服务器,其能够对代理中的数据作缓冲,不管正向代理还是反向代理,都能加快客户端的访问速度!

- Nginx做正向代理

Nginx 不仅可以做反向代理,实现负载均衡。还能用作正向代理来进行上网等功能。(即通过代理服务器来访问服务器的过程 , 需要在客户端配置代理服务器进行指定网站访问)

正向代理相对于目标服务器而言隐藏了客户端的真实IP地址,主要是为了突破网络访问限制,比如科学上网,还有就是隐藏客户端IP地址。

- Nginx做动静分离(次主要)

为了加快网站的解析速度,可以把动态页面和静态页面由不同的服务器来解析,加快解析速 度。降低原来 单个服务器的压力。

nginx 的优点/特点

承载高并发。 对静态小文件支持很好,性能很高 占用资源少。2万并发、10个线程,内存消耗几百M 功能种类比较多。web,cache,proxy。但每一个功能都不是特别强 基于异步IO模型,支持epoll模型,使得nginx可以支持高并发 利用nginx可以对IP限速,可以限制连接数 配置简单,更灵活 nginx 配合动态服务和Apache有区别。(FASTCGI 接口)

如何选择web服务器

静态业务:高并发、采用nginx,lighttpd,根据自己的掌握程度或公司的要求。动态业务:采用nginx和Apache均可。静态业务+动态业务: 采用nginx和Apache均可。提示方案:nginx做web(Apache,lighttpd)、反向代理(haproxy,lvs,nat)及缓存服务器(squid)也是不错的。思想:我们工作都不要追求一步到位,满足需求的前提下,先用,然后逐步完善。最终建议:对外的业务nginx,对内的业务Apache(yum httpd mysql-server php)。

Nginx 的安装与启动(centos7)

先下载好nginx的安装包, 选择稳定版本,下载地址:http://nginx.org/en/download.html

下载后传至linux系统

nginx安装依赖:GCC、openssl-devel、pcre-devel和 zlib-devel软件库。

yum -y install gccyum -y install gcc-c++yum install pcre pcre-devel -yyum install openssl openssl-devel -y

解压安装nginx:

tar -zxvf nginx-1.20.1.tar.gz 解压文件./configure 完成后执行命令: make && make install

进入安装目录/usr/local/nginx/sbin文件夹,里面有两个文件:nginx 和 nginx.old。

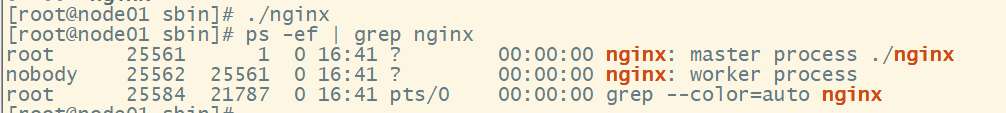

./nginx 即可执行ps -ef | grep nginx 测试是否启动

启动成功!

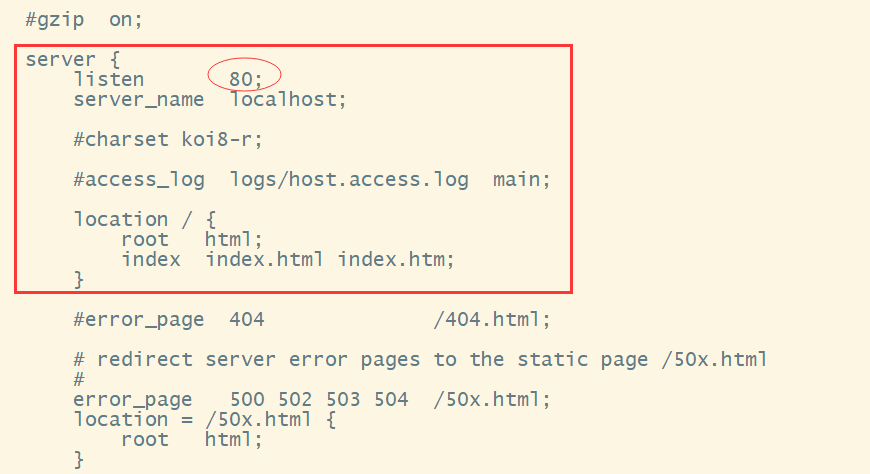

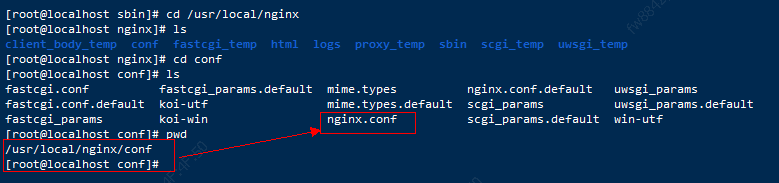

进入目录查看默认端口:**#cat /usr/local/nginx/conf/nginx.conf** 文件

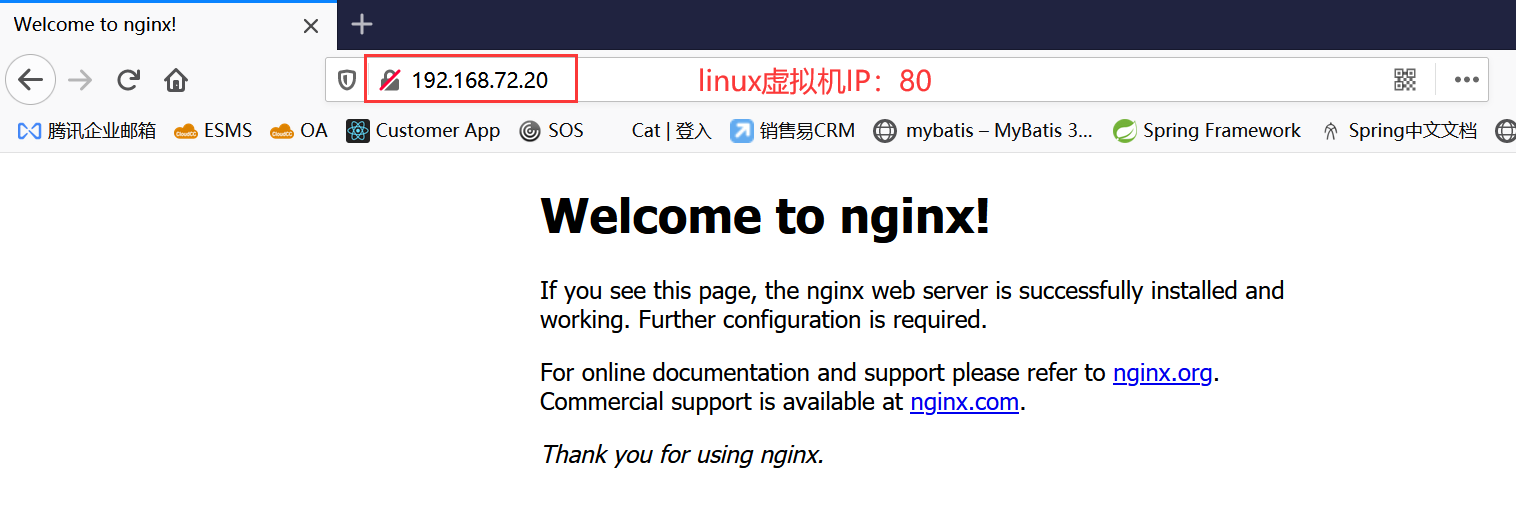

查看到nginx默认端口(默认为80),使用网页的形式测试(像Tomcat一样。)

输入IP:80,则显示:

防火墙问题

在 windows 系统中访问 linux 中 nginx,默认不能访问的,因为防火墙问题 (1)关闭防火墙 (2)开放访问的端口号,80 端口

firewall-cmd --list-all 查看开放的端口号firewall-cmd --zone=public --add-port=80/tcp --permanent 开放端口systemctl restart firewalld.service 重启防火墙

Windows启动nginx

可以直接双击nginx.exe启动或者将下边的脚本保存为bat文件双击运行.

#1.启动CMD-->安装目录--> start nginx 或 nginx.exe #建议使用第一种,第二种会使你的cmd窗口一直处于执行中,不能进行其他命令操作#2.停止nginx.exe -s stop 或 nginx.exe -s quit #stop是快速停止,可能不保存相关信息。quit是完整有序的停止nginx,并保存相关信息.#3.重新载入Nginx配置nginx.exe -s reload #nginx配置有修改,但你不想重启nginx的时候#4.重新打开日志文件nginx.exe -s reopen#5.查看Nginx版本nginx -v

Nginx 的常用命令和配置文件

Nginx常用命令

使用nginx操作命令前提:必须进入到nginx的自动生成目录的下/sbin文件夹下:

cd /usr/local/nginx/sbin

./nginx -v 查看 nginx 的版本号./nginx 启动 nginx./nginx -s stop 关闭nginx./nginx -s reload 重新加载 nginxps -ef | grep nginx 测试是否启动

Nginx配置文件

配置文件位置: /usr/local/nginx/conf/nginx.conf

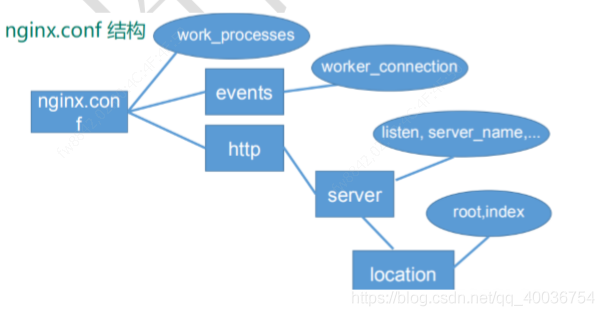

nginx 配置的组成部分:

worker_processes 1;events {worker_connections 1024;}http {include mime.types;default_type application/octet-stream;sendfile on;keepalive_timeout 65;server {listen 80;server_name localhost;location / {root html;index index.html index.htm;}error_page 500 502 503 504 /50x.html;location = /50x.html {root html;}}}

第一部分:全局块

从配置文件开始到 events 块之间的内容,主要会设置一些影响nginx 服务器整体运行的配置指令,主要包括配 置运行 Nginx 服务器的用户(组)、允许生成的 worker process 数,进程 PID 存放路径、日志存放路径和类型以 及配置文件的引入等。

比如上面第一行配置的:worker_processes 1;

这是 Nginx 服务器并发处理服务的关键配置,worker_processes 值越大,可以支持的并发处理量也越多,但是会受到硬件、软件等设备的制约。

第二部分:events块

比如上面的配置:events { worker_connections 1024; }

events 块涉及的指令主要影响 Nginx 服务器与用户的网络连接,常用的设置包括是否开启对多 work process 下的网络连接进行序列化,是否允许同时接收多个网络连接,选取哪种事件驱动模型来处理连接请求,每个 word process 可以同时支持的最大连接数等。

上述例子就表示每个 work process 支持的最大连接数为 1024.

这部分的配置对 Nginx 的性能影响较大,在实际中应该灵活配置。

第三部分:**

http {include mime.types;default_type application/octet-stream;sendfile on;keepalive_timeout 65;server {listen 80;server_name localhost;location / {root html;index index.html index.htm;}error_page 500 502 503 504 /50x.html;location = /50x.html {root html;}}}

这算是 Nginx 服务器配置中最频繁的部分,代理、缓存和日志定义等绝大多数功能和第三方模块的配置都在这里。需要注意的是:http 块也可以包括 http全局块、server 块。<br />**http全局块**<br />http全局块配置的指令包括文件引入、MIME-TYPE 定义、日志自定义、连接超时时间、单链接请求数上限等。<br />**server 块**<br />这块和虚拟主机有密切关系,虚拟主机从用户角度看,和一台独立的硬件主机是完全一样的,该技术的产生是为了 节省互联网服务器硬件成本。<br />每个 http 块可以包括多个 server 块,而每个 server 块就相当于一个虚拟主机。<br />而每个 server 块也分为全局 server 块,以及可以同时包含多个 locaton 块。

- 全局 server 块

最常见的配置是本虚拟机主机的监听配置和本虚拟主机的名称或IP配置。

- location 块

一个 server 块可以配置多个 location 块。

这块的主要作用是基于 Nginx 服务器接收到的请求字符串(例如 server_name/uri-string),对虚拟主机名称 (也可以是IP 别名)之外的字符串(例如 前面的 /uri-string)进行匹配,对特定的请求进行处理。 地址定向、数据缓 存和应答控制等功能,还有许多第三方模块的配置也在这里进行。

Nginx 反向代理

配置实例 1

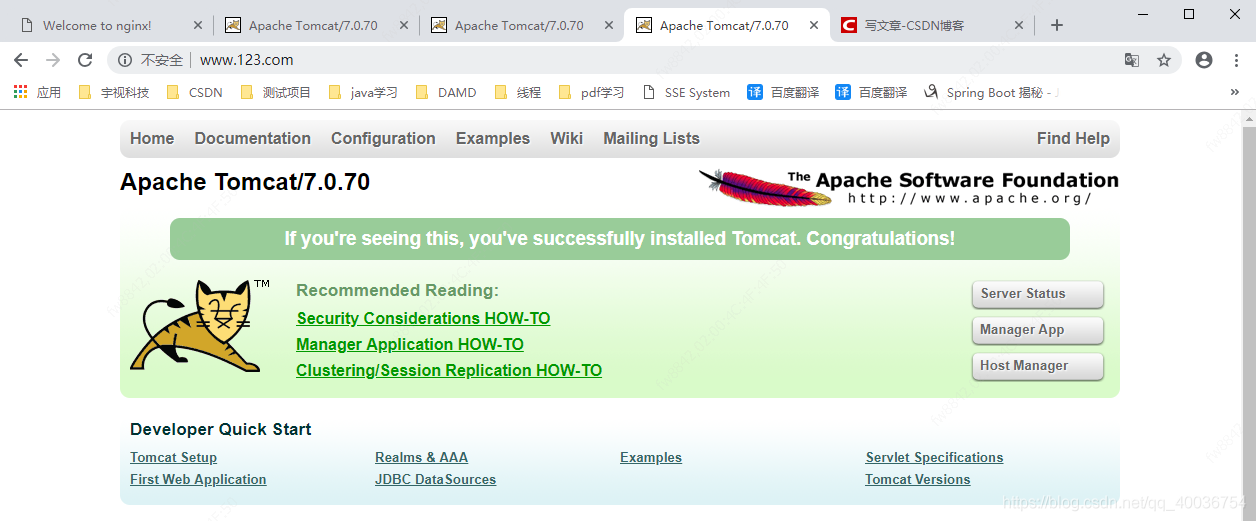

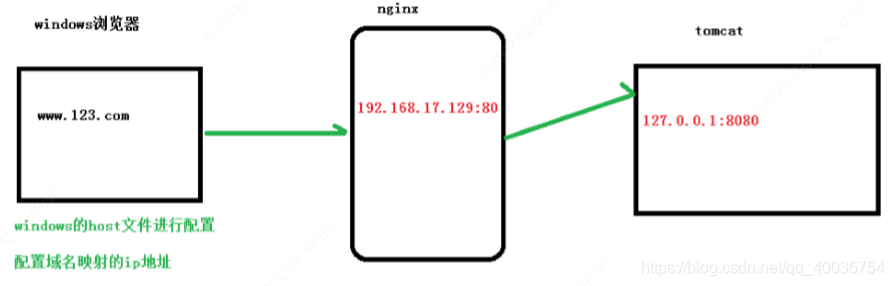

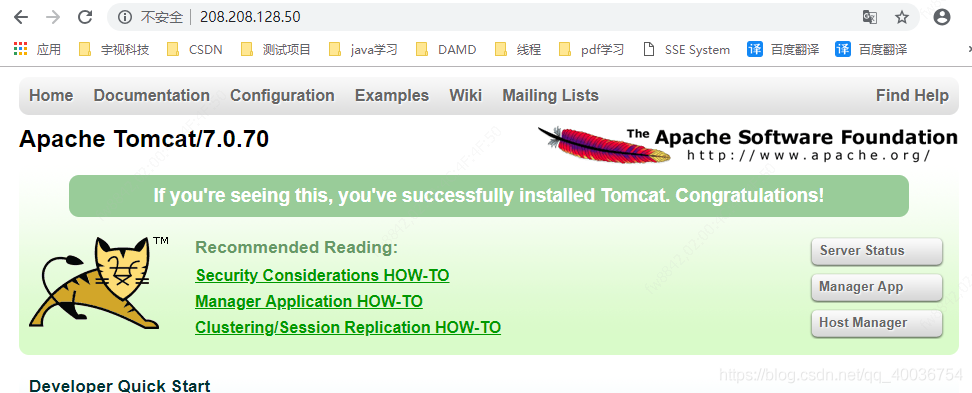

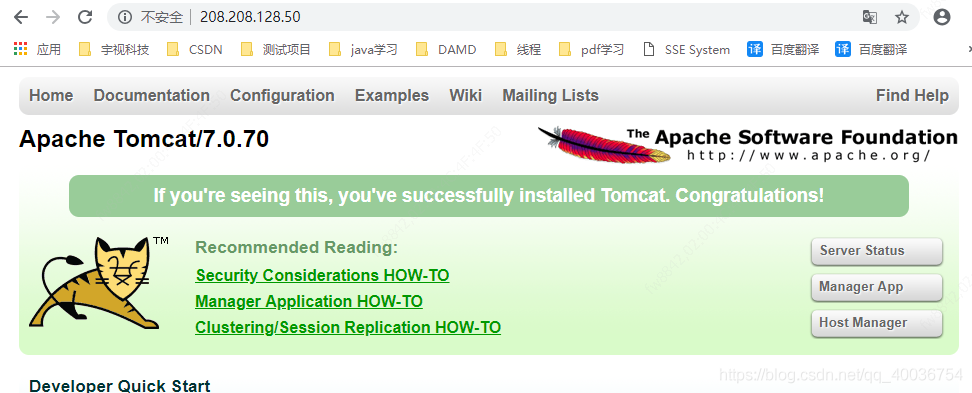

实现效果:打开浏览器,在浏览器地址栏输入地址 www.123.com,跳转到 liunx 系统 tomcat 主页 面中

准备工作

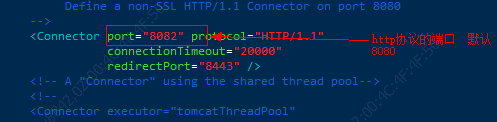

(1)在 liunx 系统安装 tomcat,使用默认端口 8080,如果这里8080被其他应用占用,可以修改端口为80xx。在conf目录下的server.xml配置文件中,如下,将port改为 80xx,其实下面也有类似的Connector 标签,但是要看protocol协议为HTTP/1.1的标签修改即可。

opt/tomcat/tomcat1/conf/server.xml

<Connector port="8080" protocol="HTTP/1.1"connectionTimeout="20000"redirectPort="8443" />

- 进入 tomcat 的 bin 目录中

./startup.sh 启动 tomcat 服务器

对外开放访问的端口 ,也可以直接关闭防火墙

firewall-cmd --list-all 查看开放的端口号firewall-cmd --zone=public --add-port=8080/tcp --permanent 开放端口firewall-cmd --remove-port=8081/tcp --permanent 移除端口systemctl restart firewalld.service 重启防火墙

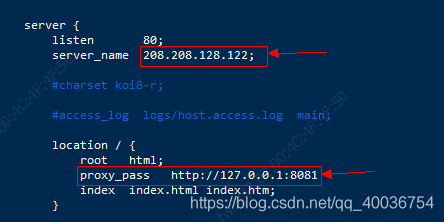

在 nginx 进行请求转发的配置(反向代理配置)# vim /usr/local/nginx/conf/nginx.conf

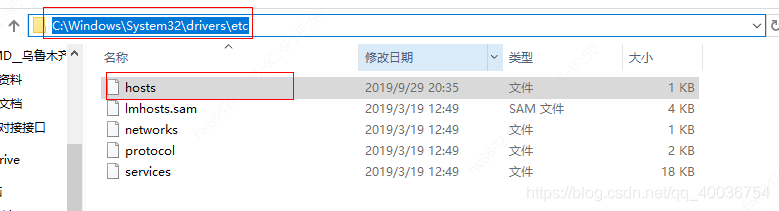

修改windows的host文件, 增加ip域名映射

192.168.72.20 www.shuai.com # 192.168.72.20 为我的虚拟机ip

最终测试,如上配置,我们监听 80 端口,访问域名为 www.123.com,不加端口号时默认为 80 端口,故访问该域名时会跳转到 127.0.0.1:8081 路径上。在浏览器端输入 www.123.com 结果如下

实现过程:

Nginx 反向代理+负载均衡

配置实例2

实现效果:使用 nginx 反向代理,根据访问的路径跳转到不同端口的服务中,且更具加权轮询方式跳转到不同端口

nginx 监听端口为 9001,

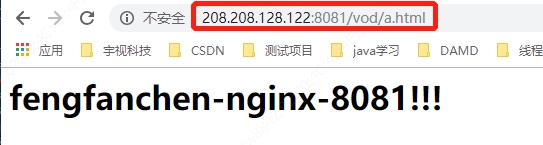

访问 http://127.0.0.1:9001/edu/ 直接跳转到 127.0.0.1:8081

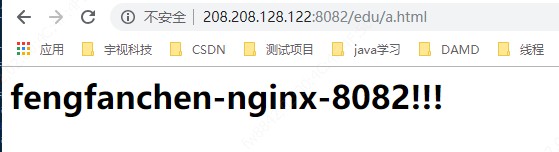

访问 http://127.0.0.1:9001/vod/ 直接跳转到 127.0.0.1:8082

准备工作

准备两个 tomcat,一个 8081 端口,一个 8082 端口。

在/usr/feng/apach-tomcat/下 新建tomcat8081和tomcat8082两个文件夹,将 Tomcat安装包 分别上传到两个文件夹,进行解压缩安装,8081的Tomcat只改一个http协议默认端口号 就行,直接启动即可。

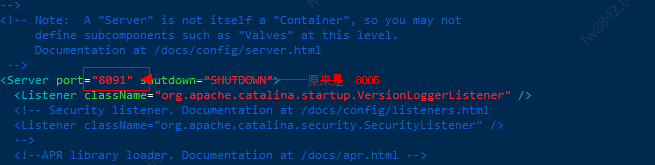

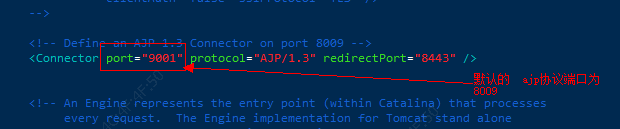

这里需要改8082的端口号,需要修改三个端口,只修改一个端口号的话,是启动不了的,我已经测试过了(如果只修改http协议默认端口的话,8081和8082只会启动一个)。因为默认的都是8080**vim server.xml**修改默认端口号

tomcat8082修改后如下:

1、修改server 的默认端口,由默认8005->8091

2、修改http协议的默认端口,由默认的8080->8082

3、修改默认ajp协议的默认端口,由默认的8009->9001

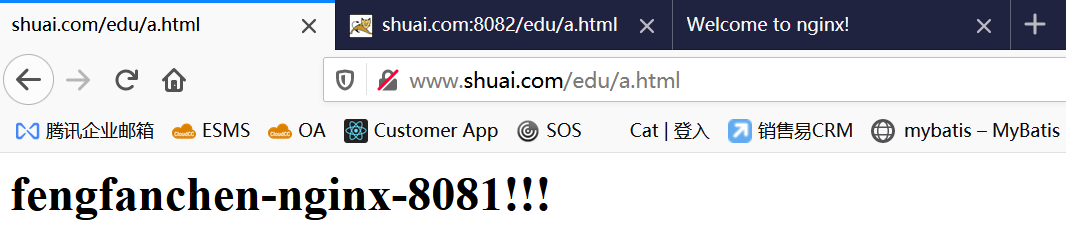

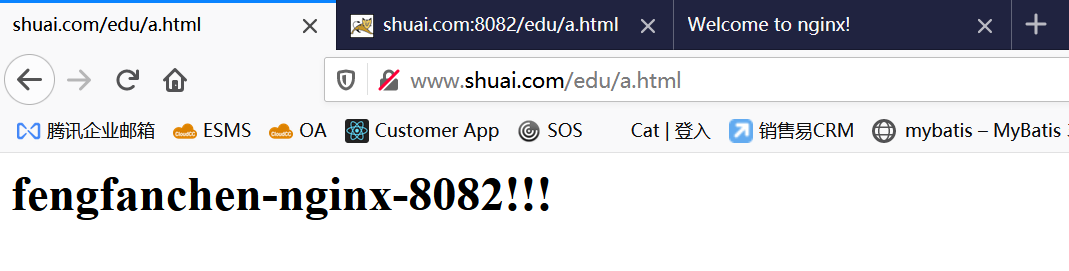

- 并准备好测试的页面

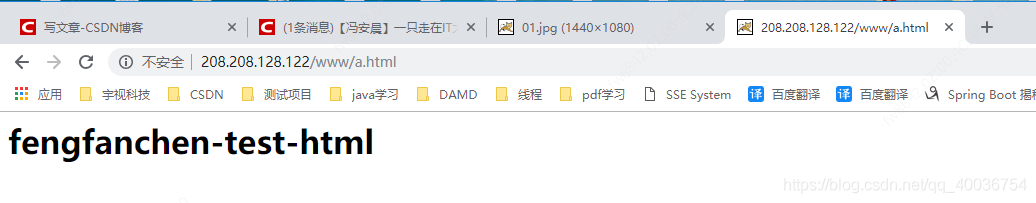

写一个a.html页面,

tomcat8081的tomcat,放到目录 /webapp/vod 下,内容:<h1>fengfanchen-nginx-8081!!!</h1>

tomcat8082的tomcat,放到目录 /webapp/edu 下,内容<h1>fengfanchen-nginx-8082!!!</h1>

测试页面

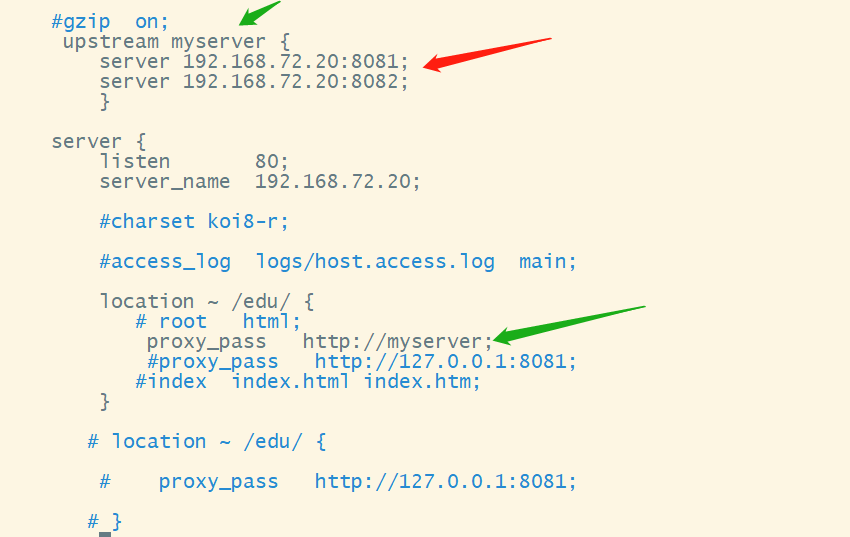

第二步,修改 nginx 的配置文件# vim /usr/local/nginx/conf/nginx.conf

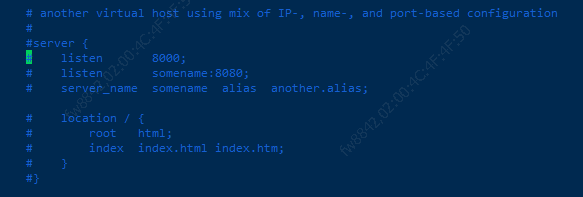

修改 nginx 的配置文件 在 http 块中添加 server{}

修改其中注释的就行。

修改成功后

记得开放防火墙端口:8001,8002,80

- 测试结果,不配置负载均衡策略—默认轮询

nginx 负载均衡4种分配服务器策略

a. 轮询(默认)

b. weight : weight 代表权重, 默认为 1, 权重越高被分配的客户端越多

upstream myserver {server 192.168.72.20:8081 weight=10;server 192.168.72.20:8082 weight=5;}

c. ip_hash: ip_hash 每个请求按访问 ip 的 hash 结果分配,这样每个访客固定访问一个后端服务器

upstream myserver {ip_hash;server 192.168.72.20:8081;server 192.168.72.20:8082;}

d. fair(第三方: 按后端服务器的响应时间来分配请求,响应时间短的优先分配。

upstream myserver {fair;server 192.168.72.20:8081;server 192.168.72.20:8082;}

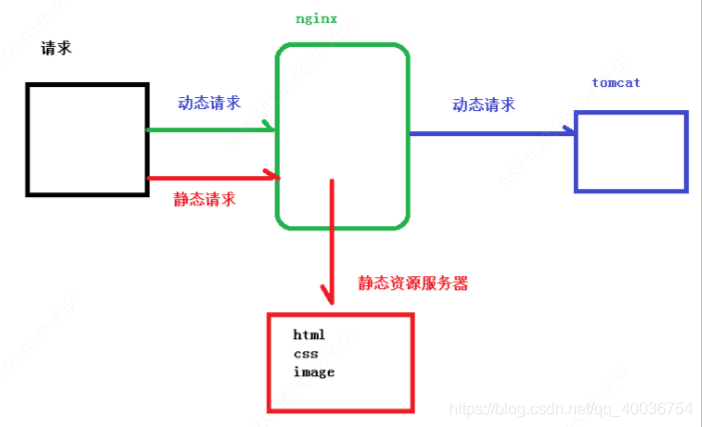

Nginx 动静分离

什么是动静分离?

Nginx 动静分离简单来说就是把动态跟静态请求分开,不能理解成只是单纯的把动态页面和 静态页面物理分离。严格意义上说应该是动态请求跟静态请求分开,可以理解成使用 Nginx 处理静态页面,Tomcat 处理动态页面。

动静分离从目前实现角度来讲大致分为两种:

- 一种是纯粹把静态文件独立成单独的域名,放在独立的服务器上,也是目前主流推崇的方案;

- 另外一种方法就是动态跟静态文件混合在一起发布,通过 nginx 来分开。

通过 location 指定不同的后缀名实现不同的请求转发。

通过 expires 参数设置,可以使 浏览器缓存过期时间,减少与服务器之前的请求和流量。具体 Expires 定义:是给一个资 源设定一个过期时间,也就是说无需去服务端验证,直接通过浏览器自身确认是否过期即可, 所以不会产生额外的流量。此种方法非常适合不经常变动的资源。(如果经常更新的文件, 不建议使用 Expires 来缓存),我这里设置 3d,表示在这 3 天之内访问这个 URL,发送 一个请求,比对服务器该文件最后更新时间没有变化,则不会从服务器抓取,返回状态码 304,如果有修改,则直接从服务器重新下载,返回状态码 200。

准备工作

在Linux 系统中准备 静态资源,用于进行访问。

- www文件夹中 a.html

- image 中的 01.jpg/png… (随便选一张)

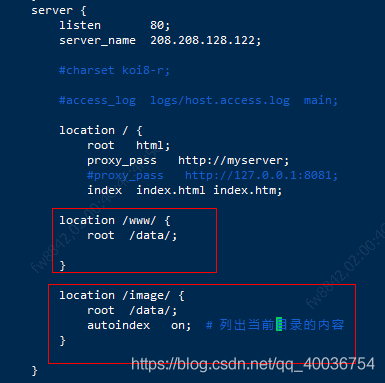

具体配置

在 nginx 配置文件中进行配置

最终测试

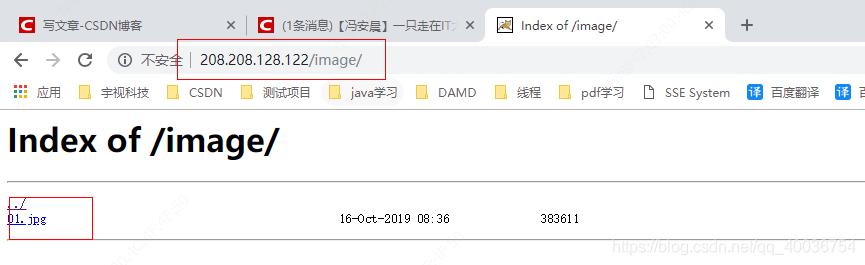

a. 测试 image

http://208.208.128.122/image/

http://208.208.128.122/image/01.jpg

b. 测试 www

http://208.208.128.122/www/a.html

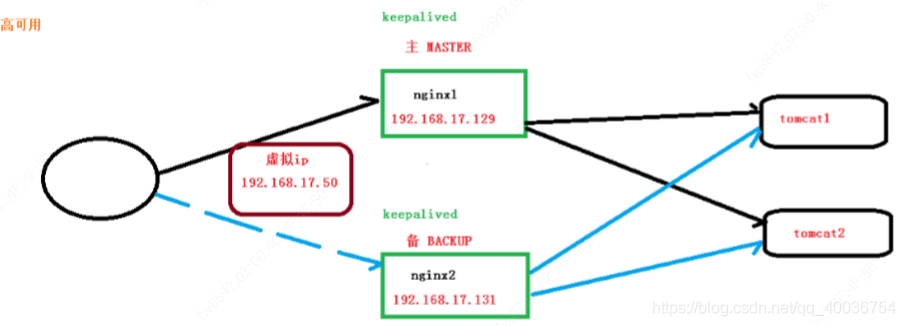

Nginx 集群(高可用)

配置示例流程:

- 需要两台nginx 服务器

- 需要keepalived

- 需要虚拟IP

配置高可用的准备工作

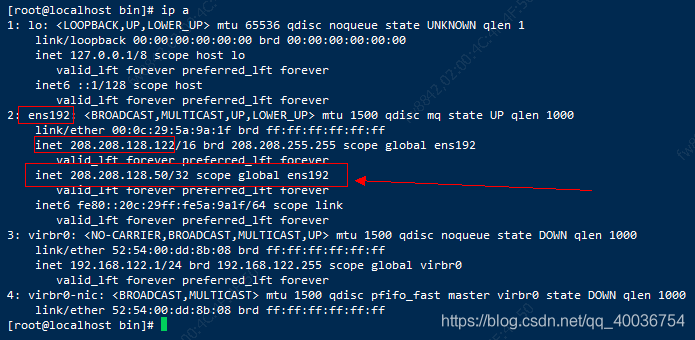

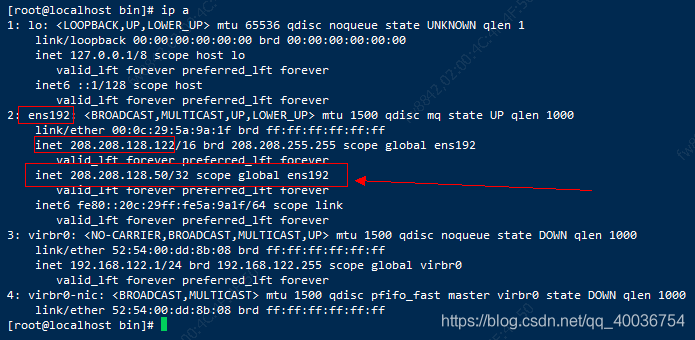

- 需要两台服务器 208.208.128.122 和 208.208.128.85

- 在两台服务器安装 nginx(流程最上面有)

第二台服务器的默认端口 改为 9001 ,运行并测试,如下:

3.在两台服务器安装 keepalived

安装keepalived

a.安装

第一种方式:命令安装

yum install keepalived -y# 查看版本:rpm -q -a keepalived

第二种方式:安装包方式,将压缩包上传至:/usr/feng/

命令如下:

cd /usr/feng/tar -zxvf keepalived-2.0.18.tar.gzcd keepalived-2.0.18./configuremake && make install

b.配置文件(主从配置文件)

修改 keepalived.conf 配置文件**/etc/keepalived/keepalivec.conf **

global_defs {notification_email {acassen@firewall.locfailover@firewall.locsysadmin@firewall.loc}notification_email_from Alexandre.Cassen@firewall.locsmtp_server 208.208.128.122smtp_connect_timeout 30router_id LVS_DEVEL}vrrp_script chk_http_port {script "/usr/local/src/nginx_check.sh"interval 2 #(检测脚本执行的间隔)weight 2}vrrp_instance VI_1 {state MASTER # 备份服务器上将 MASTER 改为 BACKUPinterface ens192 //网卡virtual_router_id 51 # 主、备机的 virtual_router_id 必须相同priority 100 # 主、备机取不同的优先级,主机值较大,备份机值较小advert_int 1authentication {auth_type PASSauth_pass 1111}virtual_ipaddress {208.208.128.50 // VRRP H 虚拟地址}}

c.添加检测脚本

在/usr/local/src 添加检测脚本

#!/bin/bashA=`ps -C nginx –no-header |wc -l`if [ $A -eq 0 ];then/usr/local/nginx/sbin/nginxsleep 2if [ `ps -C nginx --no-header |wc -l` -eq 0 ];thenkillall keepalivedfifi

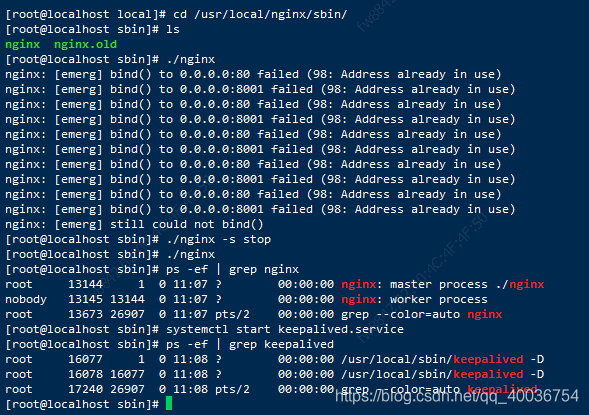

开启nginx 和 keepalived

把两台服务器上 nginx 和 keepalived 启动 :

./nginx 启动nginx # /usr/local/nginx/sbinsystemctl start keepalived.service 启动 keepalived

另一台操作一样!

最终测试

a)在浏览器地址栏输入 虚拟 ip 地址 192.168.17.50

b)把主服务器(192.168.17.129)nginx 和 keepalived 停止,再输入 192.168.17.50

依旧能正常访问!

Nginx 的原理

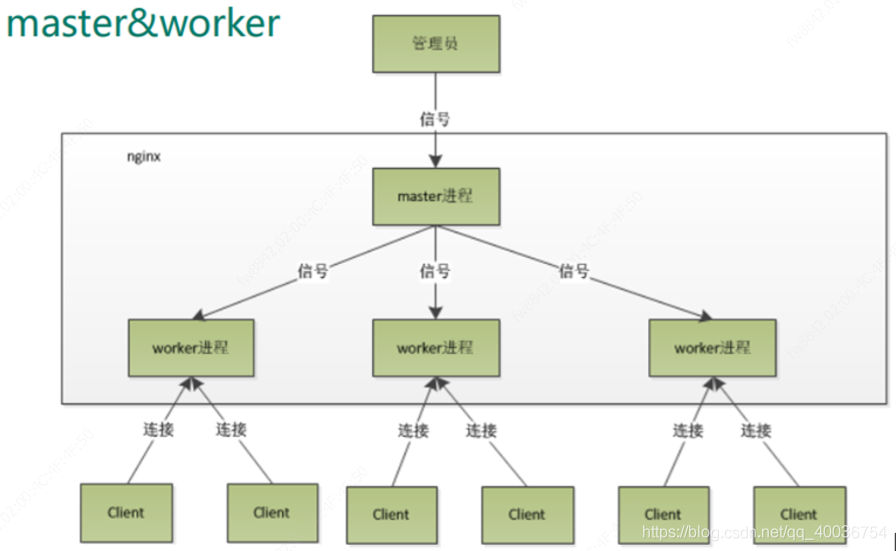

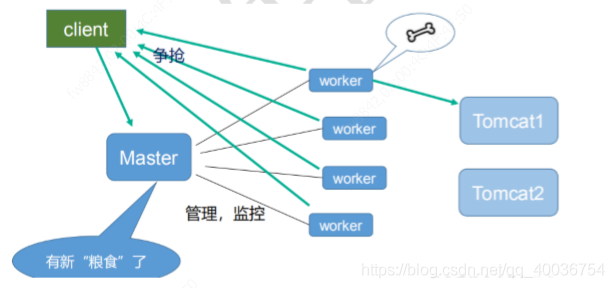

- nginx 启动后,是由两个进程组成的。master(管理者)和worker(工作者)。

- 一个nginx 只有一个master。但可以有多个worker

过来的请求由master管理,worker进行争抢式的方式去获取请求。

master-workers 的机制的好处

- 首先,对于每个 worker 进程来说,独立的进程,不需要加锁,所以省掉了锁带来的开销, 同时在编程以及问题查找时,也会方便很多。可以使用 nginx –s reload 热部署,利用 nginx 进行热部署操作

- 其次,采用独立的进程,可以让互相之间不会 影响,一个进程退出后,其它进程还在工作,服务不会中断,master 进程则很快启动新的 worker 进程。当然,worker 进程的异常退出,肯定是程序有 bug 了,异常退出,会导致当 前 worker 上的所有请求失败,不过不会影响到所有请求,所以降低了风险。

设置多少个 worker

Nginx 同 redis 类似都采用了 io 多路复用机制,每个 worker 都是一个独立的进程,但每个进 程里只有一个主线程,通过异步非阻塞的方式来处理请求, 即使是千上万个请求也不在话 下。每个 worker 的线程可以把一个 cpu 的性能发挥到极致。所以 worker 数和服务器的 cpu 数相等是最为适宜的。设少了会浪费 cpu,设多了会造成 cpu 频繁切换上下文带来的损耗。

worker 数和服务器的 cpu 数相等是最为适宜

连接数 worker_connection

第一个:发送请求,占用了 woker 的几个连接数?

- 答案:2 或者 4

第二个:nginx 有一个 master,有四个 woker,每个 woker 支持最大的连接数 1024,支持的 最大并发数是多少?

- 普通的静态访问最大并发数是:

worker_connections * worker_processes /2, - 而如果是 HTTP 作 为反向代理来说,最大并发数量应该是

worker_connections * worker_processes/4。

这个值是表示每个 worker 进程所能建立连接的最大值,所以,一个 nginx 能建立的最大连接 数,应该是 worker_connections * worker_processes。当然,这里说的是最大连接数,对于 HTTP 请 求 本 地 资 源 来 说 , 能 够 支 持 的 最 大 并 发 数 量 是 worker_connections * worker_processes,如果是支持 http1.1 的浏览器每次访问要占两个连接,所以普通的静态访 问最大并发数是:worker_connections * worker_processes /2,而如果是 HTTP 作 为反向代 理来说,最大并发数量应该是 worker_connections * worker_processes/4。因为作为反向代理服务器,每个并发会建立与客户端的连接和与后端服 务的连接,会占用两个连接。